文章目录

一、深层神经网络(Deep L-layer neural network)

目前为止学习了只有一个单独隐藏层的神经网络的正向传播和反向传播,还有逻辑回归,并且还学到了向量化,这在随机初始化权重时是很重要。本周所要做的是把这些理念集合起来,就可以执行自己的深度神经网络。首先简单复习一下前几周的内容。

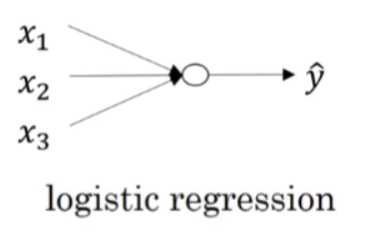

1.逻辑回归

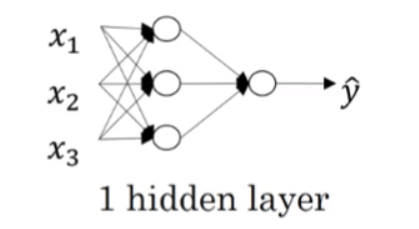

2.只拥有一个隐藏层的神经网络

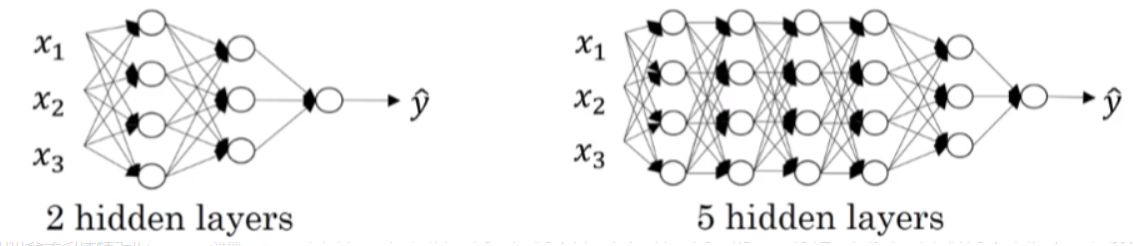

神经网络层数的定义方式: 从左至右,由0开始定义。比如上面的图, x 1 x_1 x1、 x 2 x_2 x2、 x 3 x_3 x3这层是第0层,这层右边的隐藏层是第一层,由此类推。

命名规则上,一般只参考隐藏层个数和输出层。例如,上图中的逻辑回归又叫1 layer NN,1个隐藏层的神经网络叫做2 layer NN,2个隐藏层的神经网络叫做3 layer NN,以此类推。如果是L-layer NN,则包含了L-1个隐藏层,最后的L层是输出层。

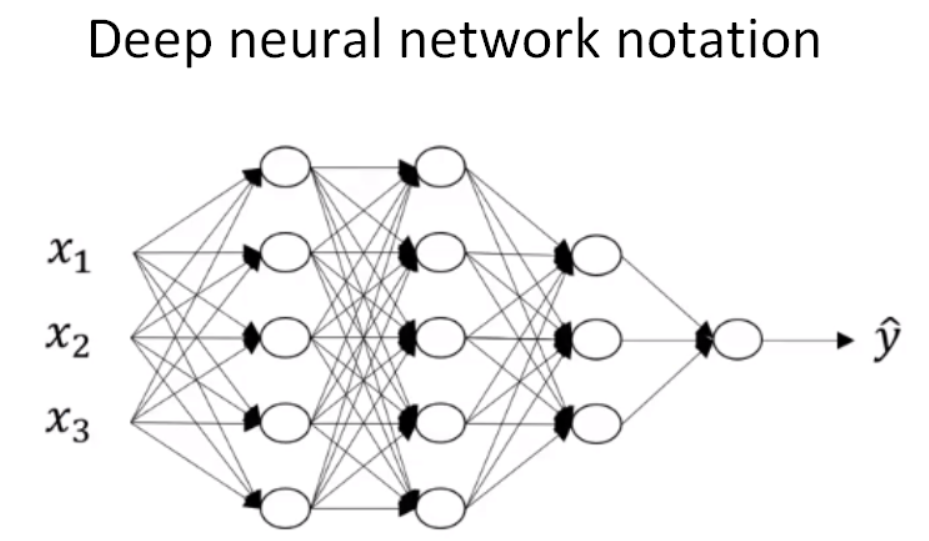

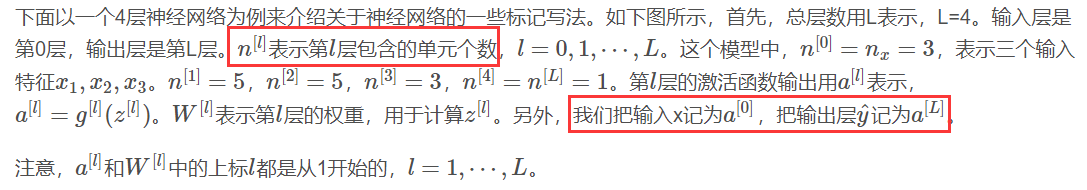

下面以一个4层神经网络为例来介绍关于神经网络的一些标记写法。

输入层是第 0 0 0 层,输出层是第 L L L 层。

最后附上:深度学习符号指南。

二、前向传播和反向传播(Forward and backward propagation)

之前我们学习了构成深度神经网络的基本模块,比如每一层都有前向传播步骤以及一个相反的反向传播步骤,接下来我们要介绍如何实现这些步骤。

1. Forward propagation

Input a a a [ l − 1 ] [l-1] [l−1]

Output a a a [ l ] [l] [l], c a c h e cache cache( z z z [ l ] [l] [l])

前向传播的步骤可以写成: z z z [ l ] [l] [l] = W W W [ l ] [l] [l] · a a a [ l − 1 ] [l-1] [l−1] + b b b [ l ] [l] [l] ——> a a a [ l ] [l] [l]

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?