近日人工智能研究公司OpenAI公布了其大型语言模型的最新版本——GPT-4,可10秒钟做出一个网站,60秒做出一个游戏,参加了多种基准考试测试,它的得分高于88%的应试者;随后百度CEO李彦宏宣布正式推出大语言模型“文心一言”,作为百度全新一代知识增强大语言模型,其能够与人对话互动、回答问题、协助创作、高效便捷地帮助人们获取信息、知识和灵感。

随着这些应用AIGC应用的发布,人工智能变成了街头巷尾人们热议的话题,英伟达CEO黄仁勋在2023年GTC开发者大会上发表了主题演讲时表示:“我们正处于AI的iPhone时刻。”可见AIGC技术对社会的变革性影响,同时也引爆了AI行业对训练和推理的大模型需求。

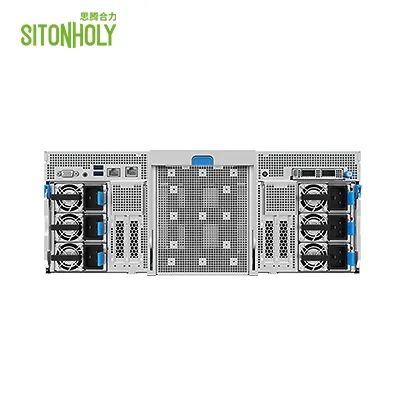

思腾合力是一家人工智能基础架构解决方案供应商,公司成立于 2009年,在成立之初就一直致力于AI 行业,是英伟达的精英级合作伙伴,拥有自主品牌AI服务器及通用服务器,适用于深度学习训练及推理等场景,尤其是思腾合力自有产品IW4221-8GRs,一款专为AI大模型计算打造的新型GPU集群,接下来给大家介绍一下这款服务器的那些让人不可抗拒的优点:

第一 天花板级的算力配置

英伟达是行业翘楚,而A800又是英伟达的明星产品,其算力更是行业望其项背的存在,思腾合力IW4221-8GRs这款产品,单台服务就搭载了8个拥有第三代NVIDIA Tensor Core的A800 GPU,单机可提供 5PFLOPS 的 AI 计算性能,比传统的双路 CPU 服务器提高 300 倍。

任意两个 GPU 之间可以直接进行数据 P2P 交互,GPU 间 P2P 通信速率为 400GB/s;具备更高的带宽和更低的延迟,可以依据不同需求完成GPU-GPU节点内部的高速互联,同时还能在GPU-CPU甚至CPU-CPU之间形成高速互联,特别是GPU与CPU之间的直接互连,提高了系统整体的性能和可扩展性。

搭载2颗Intel 高性能CPU原本,在CPU与GPU的极致配合下原本要花费10小时的双精度模拟过程缩短到4小时之内,多任务处理不卡顿,高效完成训练/推理任务,支持大规模的深度学习模型、高性能计算任务和机器学习工作负载。

第二 算力资源高效利用合理分配

本文介绍了OpenAI的GPT-4和百度的文心一言等大语言模型引发的讨论,强调了AIGC技术的社会影响。同时,讲述了思腾合力的AI服务器IW4221-8GRs的强大性能,包括其天花板级的算力配置、高效GPU协作和英伟达MIG技术的应用。

本文介绍了OpenAI的GPT-4和百度的文心一言等大语言模型引发的讨论,强调了AIGC技术的社会影响。同时,讲述了思腾合力的AI服务器IW4221-8GRs的强大性能,包括其天花板级的算力配置、高效GPU协作和英伟达MIG技术的应用。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?