一、介绍

SadTalker模型是一个基于深度学习的开源模型,主要是用于根据图片和音频文件自动生成人物说话的动画视频。该模型通过接收一张图片和一段音频文件,能够自动生成包含人脸动作(如张嘴、眨眼、移动头部等)的说话动画视频。

二、部署过程

环境配置要求:

系统:Ubuntu20.4系统,

显卡:RTX 3060 12G,

CUDA: 11.3 ,

miniconda3

1.模型下载

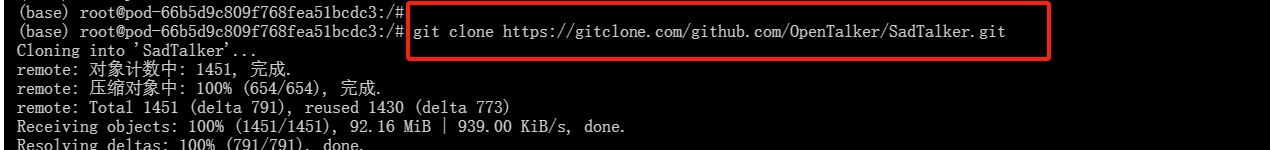

下载SadTalker模型,输入下列指令:

git clone https://gitclone.com/github.com/OpenTalker/SadTalker.git

2.创建虚拟Python环境

首先使用命令进入SadTalker:

cd SadTalker使用下列命令创建名称为sadtalker,python版本号为3.8的虚拟环境

con

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

425

425

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?