Python 爬虫

1.需要用到的库

requests#用于访问html

BeautifulSoup#用于爬取html节点

re#正则表达式,用于匹配字符串

selenium#用于模拟浏览器

...等

2.爬虫的几种方式

1.requests+BeautifulSoup

1.导入库

import requests#Python自带的标准库

from bs4 import BeautifulSoup #此库可通过cmd命令行 pip install bs4的方式安装

2.http请求,以及html获取

try:

url = "https://www.optmv.com"

r = requests.get(url)#requests.get(url)会返回一个与url参数有关的Respon对象

r.encoding = r.appearnt_encoding;#r.encoding的编码格式是通过Respon的r.headers中content-type字段中的charset的值得到的,若headers没有此字段,会导致解码方式不对,出现乱码.r.appearnt_encoding是通过返回的内容得到的,一般比较准,直接赋值给r.encoding即可。

r.raise_for_status()#若requests.get()方法响应码为200以外的数字,会抛异常。

Soup = BeautifulSoup(r.text,"html.parser")#r.text为返回的html

except:

print("解析错误")

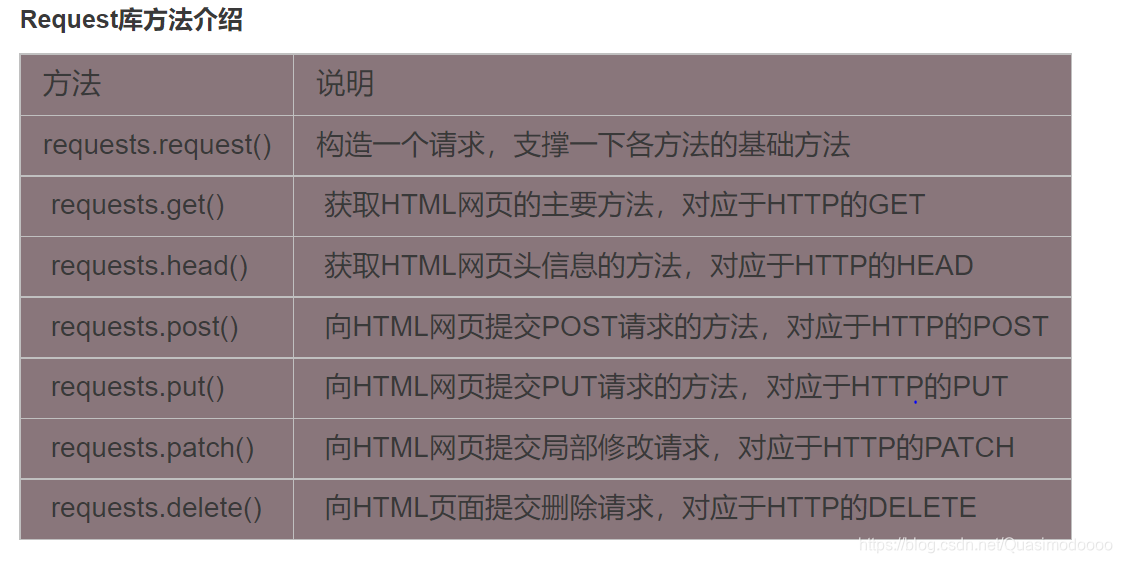

requests几种方法

requests常用的参数除了 url外,还有header,cookie等,用于模仿人操作浏览器而避免被识别为爬虫给屏蔽

4249

4249

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?