原文:https://mp.weixin.qq.com/s/94Ln1Rbmr_9-UEqyhDeM6A

>>加入青稞AI技术交流群,与青年AI研究员/开发者交流最新AI技术

论文:Automatic Expert Discovery in LLM Upcycling via Sparse Interpolated Mixture-of-Experts

链接:https://arxiv.org/abs/2506.12597

当前预训练语言大模型(LLM)虽具备通用能力,但适应专业领域需高昂的指令微调成本;稀疏混合专家(SMoE)架构作为可扩展的性能-效率平衡框架,虽能提升推理效率并灵活扩展模型容量,但其从头训练消耗巨大资源,因此复用密集大模型参数的升级再造(LLM Upcycling)成为更具成本效益的替代方案。

然而现有升级方法存在两大局限:

- 一是依赖人工经验选择可扩展的专家位置(如固定替换FFN层),忽视模型层间动态差异与任务特性;

- 二是缺乏系统机制平衡专家专业化与协作,导致冗余或知识碎片化。

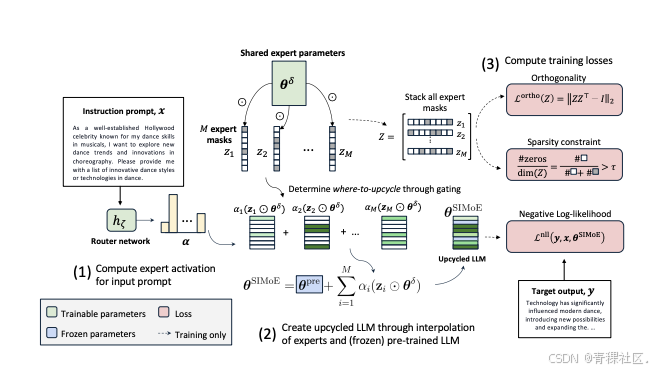

为此,我们提出稀疏插值混合专家(SIMoE)框架,通过结构化稀疏优化自动发现神经元级专家参数子集,创新性地结合共享增量参数与掩码正交惩罚,在减少30%训练内存的同时优化知识协作。

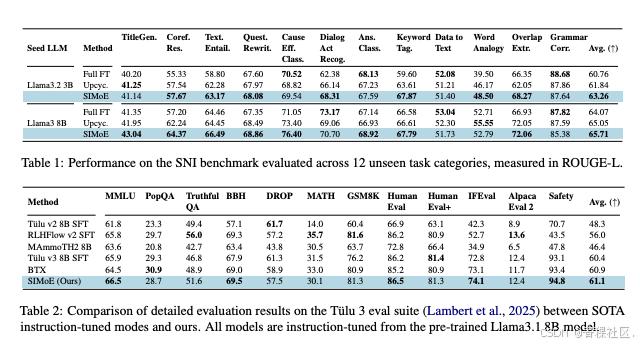

实验表明,该方法在跨任务泛化(SNI基准提升1.6-2.5%)、安全评测(DoAnythingNow提升10%)及计算效率上均显著领先,为指令微调释放大模型的专业适配潜力开辟新范式。

7月26日上午11点,青稞Talk 第66期,香港城市大学博士生陈胜庄,将直播分享《SIMoE:稀疏插值混合专家,大模型升级再造的自动化专家发现框架》。

分享嘉宾

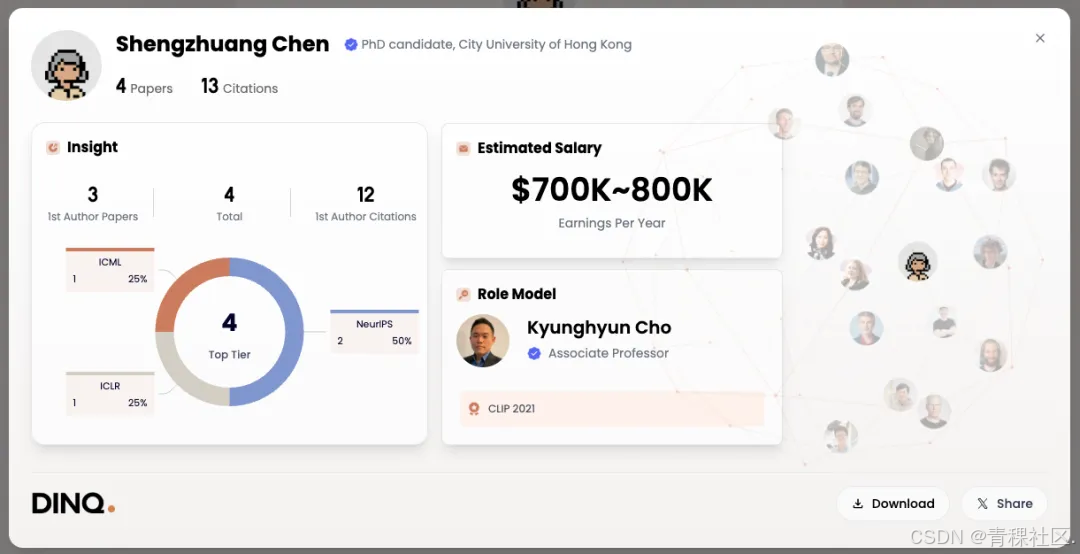

陈胜庄目前是香港城市大学计算机科学在读博士生(2022年至今),师从魏颖教授与马柯德教授。

数据来源:https://dinq.io/scholar?user=kpKst1UAAAAJ

他的核心研究方向为真实动态场景下机器学习泛化问题,通过元学习以及稀疏学习等技术,重点解决基座模型在分布外下游任务上适配的挑战,提升未来下游任务的数据效率、泛化能力和可扩展性。以第一作者在ICML, NeurIPS, ICLR, ACL等顶会发表多篇论文。

主题提纲

SIMoE:稀疏插值混合专家,大模型升级再造的自动化专家发现框架

1、传统稀疏混合专家(SMoE)架构

2、现有的 LLM Upcycling 方案及局限性

3、插值混合专家(SIMoE)框架

4、性能验证及未来研究的探讨

直播时间

7月26日10:00 - 11:00

7435

7435

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?