目 录

第一章 什么是DeepSeek大模型训练

第二章 大模型训练技术与工具的发展现状及趋势分析

第三章 大模型训练的难度和挑战

第四章 大模型训练的目的和作用

第五章 DeepSeek大模型训练的价值和意义

第六章 大模型训练工业应用的价值

第七章 大模型训练机构及岗位需求

第八章 大模型训练从入门到精通

第一章 什么是DeepSeek大模型训练

一、训练定义与核心内容

1. 技术架构

DeepSeek基于Transformer架构,融合稀疏注意力机制和混合专家(MoE)架构,通过自注意力机制处理长文本依赖关系,并通过MoE动态分配计算资源,实现轻量化参数与高性能的平衡。

o 创新点:引入专利数据管理技术减少冗余存储,优化训练效率;

o 模型版本:包括通用大语言模型(如DeepSeek-LLM)、代码模型(DeepSeek-Coder)及MoE模型(DeepSeek-MoE)。

2. 主要训练内容

o 数据准备:需处理PB级多源数据(书籍、网页、对话记录等),并进行去重、脱敏和质量验证;

o 预训练:以自监督学习为主,通过文本片段关联规律建立模型的语言理解能力;

o 微调:针对特定任务(如心理辅导、代码生成)使用监督学习优化模型输出;

o 强化学习(RLHF):结合人类反馈迭代调整模型行为,提升生成内容的准确性和安全性。

二、训练方法与工具

1. 关键训练策略

o 混合专家架构:将模型划分为多个专家子网络,动态分配任务以降低计算复杂度;

o 模型蒸馏:通过知识迁移技术压缩大模型参数,适配低算力环境(如至强平台);

o 分布式训练:依托自建智算集群和万卡算力,支持大规模并行训练。

2. 工具与条件

o 开发框架:Hugging Face Transformers、OpenMind(适配昇腾NPU)、DeepSpeed(分布式优化);

o 硬件需求:高性能GPU(如NVIDIA RTX 4070Ti,显存≥40GB)、大内存(≥32GB)及高速存储;

o 环境配置:Python≥3.8、PyTorch/CUDA、PEFT(参数高效微调库)等。

三、对训练师的要求

1. 技术背景

o 熟悉自然语言处理(NLP)基础理论及Transformer架构原理;

o 掌握PyTorch或MindSpore框架,能编写数据预处理和模型训练代码;

o 了解分布式训练优化策略(如数据并行、模型并行)。

2. 数据处理能力

o 能清洗、标注大规模文本数据,并设计合理的数据增强方案;

o 熟悉多轮对话数据格式转换(如JSON到张量的映射)。

3. 调优经验

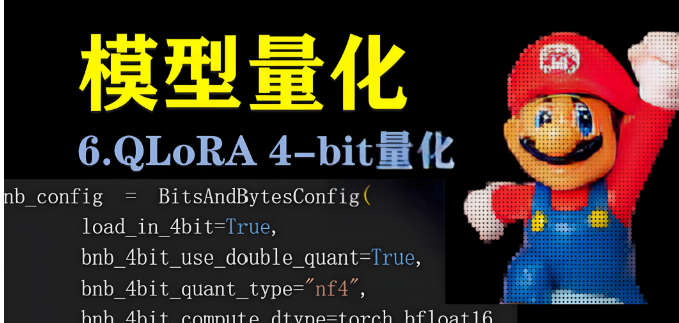

o 具备模型微调经验(如使用LoRA、QLoRA技术),能根据任务调整超参数;

o 理解模型局限性(如知识滞后性、幻觉问题),并能通过RAG或联网搜索补充实时信息。

四、实战案例:心理辅导模型微调

1. 数据准备:使用EmoLLM心理健康数据集,按模型要求格式(如User: [输入] \n\n Assistant: [输出])预处理对话数据;

2. 环境配置:安装Transformers、Datasets等库,加载deepseek-llm-7b-chat模型及分词器;

3. 训练设置:定义数据填充规则(DataCollatorForSeq2Seq),设置学习率、批次大小等参数;

4. 结果验证:通过生成测试观察模型是否以“心理医生口吻”回应。

五、挑战与解决方案

1. 算力限制:可通过量化(如4-bit模型)或使用Ollama+Open WebUI本地部署降低需求;

2. 知识时效性:结合联网搜索功能或上传附件补充最新数据;

3. 输出长度限制:分段生成内容(如长文翻译或代码编写)。

六、小结

DeepSeek的训练以技术创新为核心,依赖高性能硬件、开源工具及专业训练团队,通过多阶段优化实现模型的高效部署与应用。训练师需兼具技术深度与实践经验,方能充分发挥其潜力。

第二章 大模型训练技术与工具的发展现状及趋势分析

一、核心技术及工具

1. 模型架构技术

o 混合专家架构(MoE):通过多个专家模型分工处理不同任务,结合动态路由机制提升模型效率,例如Google的Switch Transformer和DeepSeek-MoE模型。

o 视觉Transformer(ViT):将图像分割为Token序列,利用自注意力机制提取全局特征,Swin Transformer、MAE等改进版本在图像任务中表现突出。

o 扩散模型:基于马尔可夫链生成高质量数据,如Stable Diffusion和DALL·E,广泛应用于图像和视频生成领域。

2. 训练策略与优化

o 分布式训练:采用多GPU/TPU集群并行训练,结合DeepSpeed、Megatron-LM等框架优化显存管理和计算效率。

o 模型压缩与知识蒸馏:通过Phi-4等轻量化模型减少参数规模,适配边缘设备需求。

o 强化学习微调(RL Fine-Tuning):结合人类反馈优化模型行为,如OpenAI的o1模型通过少量样本即可提升特定领域性能。

3. 数据处理技术

o 多模态数据融合:构建统一的多模态词元空间,如GPT-4o实现跨模态对齐,缩短响应时间。

o 合成数据生成:利用GANs、扩散模型生成高质量数据,缓解数据瓶颈,预计2030年合成数据将占主导。

o 半自动化标注工具:结合AI模型预标注和人工校验,提升标注效率,如主动学习技术和跨模态协同标注。

4. 工具与框架

o 深度学习框架:PyTorch、TensorFlow和国产框架(如华为MindSpore、百度PaddlePaddle)支持大规模模型训练。

o 分布式优化库:DeepSpeed的ZeRO优化、NVIDIA的NCCL通信库,以及阿里巴巴的ACCL库(支持RDMA高效传输)。

o 数据处理工具:Hugging Face Datasets、Apache Spark等用于数据清洗与预处理。

5. 硬件基础设施

o 高性能计算芯片:NVIDIA A100/H100 GPU、华为昇腾NPU、Google TPU等提供算力支持。

o 分布式存储与网络:基于RDMA的高速网络(如InfiniBand)减少通信延迟,优化KVCache传输效率。

二、发展现状

1. 技术成熟度

o 模型架构:MoE和ViT已在主流模型中广泛应用,但Transformer架构的算力消耗问题仍未完全解决。

o 训练效率:分布式训练技术逐步成熟,但大规模集群的显存管理和通信开销仍是瓶颈。

o 数据工程:合成数据与半自动标注工具初步落地,但多模态数据融合的质量控制仍需优化。

2. 行业应用

o 通用模型:如GPT-4、文心一言在文本生成领域表现突出,但复杂推理任务(如数学、代码生成)仍有差距。

o 垂直领域:医疗、金融等行业开始部署专用模型,但缺乏高质量领域数据制约效果。

三、未来趋势

1. 技术革新方向

o 多模态融合深化:语言塔与视觉塔的底层特征交互将成为主流,支持更复杂的跨模态任务(如自动驾驶场景)。

o 轻量化与边缘部署:小参数模型(如Phi-4)结合量化技术,推动AI在移动端和物联网设备落地。

o 推理能力增强:强化学习与思维链技术结合,提升模型逻辑推理能力(如科大讯飞X1的“慢思考”机制)。

2. 工具与生态发展

o 自动化训练流水线:从数据标注到模型调优的全流程自动化工具(如AutoML平台)将普及。

o 异构计算优化:新型AI芯片(如存算一体芯片)与框架深度协同,降低训练成本。

o 隐私保护技术:联邦学习与差分隐私技术融入训练流程,确保数据合规性。

3. 行业应用拓展

o 垂直领域专用模型:医疗、教育等领域将涌现更多行业大模型,需解决长尾数据不足问题。

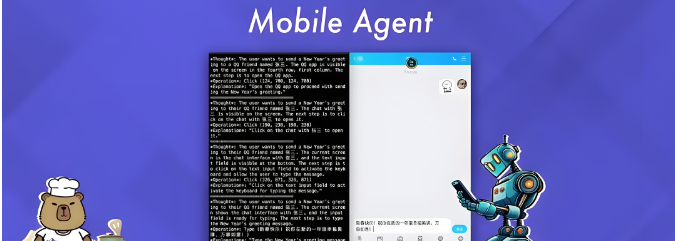

o 实时交互与低延迟:基于边缘计算的Agent(如阿里Mobile-Agent)实现本地化实时推理。

四、总结

大模型训练技术正朝着多模态融合、轻量化、强推理能力的方向演进,工具生态则聚焦于分布式效率提升和自动化流程优化。未来,随着算力硬件创新和数据工程的突破,大模型将进一步渗透至各行业,但其发展仍需解决算力瓶颈、数据质量及隐私安全等挑战。

第三章 大模型训练的难度和挑战

一、算力资源与成本挑战

一、算力资源与成本挑战

1. 硬件需求高昂

o 训练千亿参数模型需万卡级GPU集群(如NVIDIA A100/H100),单次训练成本可达数百万美元(如GPT-3训练成本约460万美元)。

o 显存管理复杂,需应对显存碎片化和通信带宽瓶颈问题。

2. 分布式训练效率低

o 大规模并行训练时,数据同步延迟和通信开销显著增加(如AllReduce操作耗时占比可达30%以上)。

o 模型并行(如流水线并行、张量并行)需精细拆分计算图,易导致负载不均衡。

3. 能耗与环境成本

单次大模型训练能耗相当于数百家庭年用电量(如BLOOM模型训练排放25吨CO₂),引发可持续发展争议。

二、数据工程难题

1. 数据质量与规模要求

o 需处理PB级多模态数据(文本、图像、视频等),但高质量标注数据稀缺,数据噪声和偏见难以根除。

o 数据清洗与预处理耗时占比超过60%,如去重、脱敏、格式对齐等流程复杂。

2. 长尾数据覆盖不足

o 垂直领域(如医疗、法律)的低资源语言或专业术语数据不足,导致模型泛化能力受限。

o 多语言训练时,非英语语种数据量级差异大(如中文数据占比不足10%)。

3. 隐私与合规风险

训练数据可能包含用户隐私或版权内容,需依赖差分隐私和数据合成技术降低风险。

三、模型优化与稳定性问题

1. 训练动力学复杂

o 超参数(如学习率、批次大小)对训练结果敏感,调整成本高(如GPT-4调参耗时数月)。

o 梯度爆炸/消失、损失震荡等问题频发,需依赖混合精度训练和梯度裁剪技术。

2. 模型收敛困难

o 随着模型规模增大,收敛速度显著下降(如万亿参数模型需数月至一年训练周期)。

o 灾难性遗忘问题突出,微调时容易覆盖原有知识。

3. 输出可控性差

生成内容易出现幻觉(Hallucination)或有害输出,需依赖RLHF(人类反馈强化学习)和红队测试反复修正。

四、技术与工程瓶颈

1. 模型架构创新受限

o Transformer架构的自注意力计算复杂度(O(n²))成为瓶颈,长文本处理效率低。

o 稀疏架构(如MoE)虽能降低计算量,但动态路由机制导致训练稳定性下降。

2. 工具链成熟度不足

o 现有框架(如PyTorch、DeepSpeed)对超大规模模型支持有限,调试工具匮乏。

o 开源生态碎片化,国产硬件(如昇腾NPU)与主流框架适配仍需优化。

3. 团队协作复杂度高

需跨领域团队(算法、数据、系统工程师)紧密协作,知识壁垒和沟通成本显著。

五、伦理与社会挑战

1. 公平性与偏见放大

训练数据中的社会偏见被模型放大(如性别、种族歧视),需依赖去偏算法和公平性评估。

2. 滥用风险

模型可能被用于生成虚假信息、钓鱼攻击等,需构建内容水印和溯源机制。

3. 知识产权争议

训练数据版权归属模糊,生成内容的知识产权界定尚未形成共识。

六、行业应对方案与趋势

1. 技术优化

o 采用混合精度训练、模型量化(如4-bit)降低算力需求。

o 探索非Transformer架构(如Mamba、RWKV)突破注意力机制瓶颈。

2. 资源协同

o 发展云计算租赁和算力共享模式(如AWS Trainium实例)。

o 推动绿色AI技术,利用可再生能源降低碳足迹。

3. 数据创新

通过合成数据生成(如Diffusion模型)扩充训练集,减少对真实数据依赖。

4. 政策与标准

建立大模型安全评估体系(如欧盟AI法案),规范数据采集与使用。

七、小结

大模型训练的挑战本质上是技术极限、资源分配与社会责任的三重博弈。尽管通过架构创新(如MoE)、工具优化(如DeepSpeed)和协作模式(开放社区)已取得进展,但算力成本、数据质量、伦理风险等问题仍将持续存在。未来需依赖跨学科合作(算法-硬件-政策)和长期技术积累,才能实现大模型的高效、安全与普惠化发展。

第四章 大模型训练的目的和作用

一、大模型训练的核心目的

大模型训练旨在通过海量数据与复杂架构的结合,实现以下核心目标:

1. 通用智能能力构建

o 通过海量数据训练,使模型具备跨领域、多任务的推理能力.突破传统AI模型的“单任务限制”,建立跨领域、多任务的统一认知、语言理解及逻辑推理能力。比如GPT-4可处理80+种语言的翻译、摘要和创作,可同时处理文本生成、代码编写和数学推理;AlphaGeometry解决国际数学奥林匹克(IMO)级别几何问题;

o 实现从“感知智能”到“认知智能”的跃迁,例如DeepSeek-LLM通过自监督学习理解抽象概念间的隐含关联;

o 推动从“专用AI”向“通用AI”演进,例如Google的PaLM模型同时掌握编程、数学和医疗知识。

2. 知识压缩与泛化

o 将人类知识(如科学文献、行业经验)编码为可调用的参数化表达及可复用的参数化模型。例如PaLM模型掌握138种语言翻译能力;BioGPT模型学习超百万篇论文,支持疾病诊断和药物研发;西门子Industrial Copilot内嵌20万份工程文档,直接生成设备维护方案;

o 通过持续学习适配新任务,减少传统知识库的更新延迟。如Meta的Llama-2模型微调后可在医疗诊断中达到专业医生85%的准确率。

3. 重构人机交互与协作范式

o 构建自然语言交互界面,降低技术使用门槛(如工业场景中工人通过语音指令调用设备维护方案)。

o 提升复杂决策效率,如波士顿咨询实验显示,使用GPT-4的顾问工作效率提升25%。

二、大模型训练的主要成果

1. 技术成果

1) 基础模型能力跃升:生成千亿级参数模型,如GPT-4参数规模达1.8万亿,支持10万token上下文窗口)。具备文本、代码、图像的多模态处理能力。如GPT-4o实现文本、图像、语音的实时交互,响应延迟低于300ms。

2) 行业专用模型:如吉利汽车的“工业仿真大模型”缩短汽车碰撞测试周期70%,华为盘古气象大模型将台风路径预测时间从小时级降至秒级。DeepMind的AlphaFold 3预测蛋白质结构准确率超90%,加速新药研发;

3) 工具链生态:开源框架(如DeepSpeed、Megatron-LM)和低代码平台(如Hugging Face AutoTrain)降低训练门槛,开发者数量3年增长10倍。o 分布式训练工具(如DeepSpeed)使千亿模型训练成本降低60%。

2. 应用成果

1) 生产力工具:ChatGPT企业版帮助员工文档处理效率提升40%,GitHub Copilot使程序员代码编写速度提升55%。Autodesk生成式设计工具减少产品原型迭代次数70%;

2) 创新产品:Midjourney等AIGC工具创造千亿美元市场规模,AI药物发现平台(如Insilico Medicine)缩短新药研发周期至1/3;AIGC经济Midjourney年营收超2亿美元,用户生成图片量日均千万级。AI即服务(AIaaS)AWS Bedrock提供20+预训练模型,企业调用成本低至$0.006/千token。

3) 社会服务:教育领域智能辅导系统(如可汗学院Khanmigo)覆盖全球2000万学生,个性化学习时间节省40%;医疗AI问诊准确率达三甲医院主治医师水平;World Food Programme用AI预测粮食危机,预警准确率提升至85%等。

三、大模型训练的收益分析

1. 直接经济收益

1)企业级应用:

o 麦肯锡研究显示,制造业通过AI优化供应链可降低15-30%成本,能源企业使用预测性维护减少设备停机损失20-50%。

o 微软财报披露,Azure OpenAI服务年收入增速超200%,成为云计算业务核心增长点。

2)商业化产品:

OpenAI年度营收突破16亿美元,ChatGPT付费用户超200万;Stability AI估值超40亿美元。

| 行业 | 典型应用 | 量化收益 | 成本节约 |

| 制造业 | 预测性维护(如通用电气) | 设备停机时间减少45%,维修成本下降30% | 单工厂年节省$500万 |

| 金融 | 智能风控(如蚂蚁集团) | 欺诈交易识别率99.99%,响应时间<50ms | 年减少损失$10亿 |

| 零售 | 动态定价(如亚马逊) | 利润提升8%-15%,库存周转率加快20% | 年增收$7亿(2023年数据) |

| 能源 | 电网优化(如国家电网) | 输电损耗降低5%,故障响应效率提升60% | 年节约运营成本$2.3亿 |

2. 社会效益

1) 生产效率提升:德勤报告指出,AI技术使全球制造业劳动生产率年均增长1.2-1.5%。

2) 就业结构升级:世界经济论坛预测,到2025年AI将创造9700万个新岗位(如AI训练师、提示工程师)。

3) 科学突破加速:AlphaFold 2破解2亿蛋白质结构,推动生物医药研发效率提升百倍。

3. 战略价值

1) 技术壁垒构建:英伟达凭借CUDA生态与GPU算力垄断,市值突破3万亿美元;

2) 国家竞争力:中国“十四五”规划将大模型列为新基建重点,目标2025年AI核心产业规模达4000亿元;

3) 全球影响力:OpenAI与微软合作估值达900亿美元,成为美国科技霸权核心载体。

四、典型案例量化分析

| 应用领域 | 案例 | 量化收益 | 成本节约 |

| 工业制造 | 海尔智能设计系统 | 研发周期缩短30%,材料浪费减少12% | 单产品研发成本降低$50万 |

| 医疗健康 | 腾讯觅影AI辅助诊断 | 肺结节识别准确率99%,阅片速度提升4倍 | 三甲医院年节约放射科人力成本$120万 |

| 金融服务 | 蚂蚁集团智能风控模型 | 欺诈交易识别率提升至99.99%,响应时间<10ms | 年减少欺诈损失超$3亿 |

| 能源环保 | 国家电网设备预测性维护 | 故障预警准确率92%,非计划停电减少40% | 单电厂年维护成本下降$800万 |

五、挑战与收益平衡

1. 训练成本高昂但边际收益递增

o 单次训练成本:GPT-4约6300万美元,但通过API服务已创造超16亿美元年收入。

o 行业模型成本:垂直领域模型(如医疗、法律)训练成本低至百万美元,企业ROI普遍超300%。

2. 长期收益的指数级放大

o 企业级应用:波士顿咨询测算,全面应用AI的企业利润率平均提升38%。

o 国家层面:普华永道预测,2030年AI对全球GDP贡献将达15.7万亿美元,占全球经济总量14%。

六、未来潜力与挑战

1. 潜力方向

o 通用机器人:大模型驱动的人形机器人(如Figure 01)已实现自然语言控制复杂动作。

o 科学发现:Google的AI数学家可自主提出新定理,Nature预测未来50%科学论文将由AI辅助完成。

2. 核心挑战

o 算力瓶颈:训练万亿级模型需万卡集群,电力消耗相当于一个小型城市。

o 伦理风险:生成内容版权争议(如纽约时报起诉OpenAI)、深度伪造技术滥用。

七、小结

大模型训练的终极目标是构建人类社会的智能基础设施,其成果已从实验室走向千行百业,带来生产效率的质变与商业模式的颠覆。尽管面临成本与伦理挑战,但其经济收益(企业降本增效)、社会价值(服务普惠化)和战略意义(国家竞争力)使其成为不可逆的技术革命。未来十年,大模型将像电力一样渗透每个角落,重塑人类文明的发展轨迹。

第五章DeepSeek大模型训练的价值和意义

一、技术创新:重构AI训练范式

1. 高效架构与成本革命

1. 高效架构与成本革命

o DeepSeek通过混合专家模型(MoE)和多头潜在注意力机制(MLA),显著降低计算量和内存消耗。例如,DeepSeek-V3训练成本仅558万美元,远低于同类模型的数亿美元投入,且算力效率提升至280万GPU/小时,仅为Meta Llama-3.1的1/106。

o 多Token训练目标增强了模型预测稳健性,推理时仅需激活部分专家模块,兼顾性能与效率平衡。

2. 算法与工程协同优化

o 采用创新的动态路由机制和稀疏注意力技术,在保证模型性能的同时减少冗余计算。例如,DeepSeek-R1通过优化算法实现GPU集群使用效率行业领先,训练周期缩短至两个月。

二、产业赋能:推动智能化升级

1. 通信与制造领域

o 中国三大电信运营商全面接入DeepSeek,实现网络流量智能优化、用户套餐精准推荐,并开发智能客服系统,用户满意度提升30%。

o 工业场景中,西门子通过微调DeepSeek生成仿真代码,将工艺优化时间从数周缩短至数小时;特斯拉工厂利用模型优化生产线调度,产能提升20%。

2. 消费电子与公共服务

o 智能电视厂商(如海信、长虹)接入DeepSeek后,实现个性化内容推荐、多语言语音交互及AR/VR场景增强,用户日均使用时长增加40%。

o 深圳龙岗区政务系统部署DeepSeek-R1,自动化处理90%的常规咨询,人工客服压力降低50%。

三、战略竞争:重塑全球AI格局

1. 应对美国技术制衡

o DeepSeek-V3在科学、编码等领域的性能超越国际开源模型(如Llama-3.1),其低成本训练模式打破西方算力垄断,推动中国算力规模跃居全球第二。

o 通过国产模型+国产算力+国产云服务的闭环生态,减少对高端AI芯片依赖,加速国产异构芯片(如昇腾NPU)的迭代。

2. 全球影响力扩张

o DeepSeek官网外国用户占比超30%,日活用户突破3000万,成为全球增长最快的AI应用之一,间接推动OpenAI等企业调整开源策略。

四、开源生态:普惠化与商业化平衡

1. 技术普及与开发者赋能

o DeepSeek-R1的开源特性降低中小企业的AI门槛,例如中关村科金基于其开发的金融问答模型准确率提升15%,成本下降70%。

o 开源社区可通过模型蒸馏定制行业小模型(如医疗诊断、法律咨询),形成“基础模型+垂直场景”的生态网络。

2. 商业模式重构

o 免费策略加速用户积累,例如OpenAI和文心一言被迫跟进免费服务,推动行业从“按分计价”转向“流量+数据反哺”模式,通过用户行为数据优化模型迭代。

五、社会价值:效率提升与伦理挑战

1. 生产力与科学突破

模型轻量化推动边缘计算落地,如搭载DeepSeek的安卓手机实现本地化推理,延迟低于10ms。

2. 风险与治理需求

o 数据依赖性可能导致偏见放大(如互联网噪声数据影响模型输出),需结合差分隐私技术优化训练流程。

o 开源治理机制尚未完善,亟需建立伦理框架应对生成内容滥用风险(如虚假信息传播)。

六、小结:AI基础设施的战略意义

DeepSeek大模型训练的价值核心在于技术普惠化、产业智能化与生态自主化:

- 技术层面,其高效架构与低成本模式重构AI研发范式;

- 产业层面,推动通信、制造、政务等领域的全链条升级;

- 战略层面,打破西方技术垄断,构建国产AI闭环生态;

- 社会层面,既加速生产力跃升,也需平衡创新与伦理风险。

未来,随着多模态融合与AI for Science的深化,DeepSeek或将成为驱动新一轮工业革命的核心引擎,但其长期成功仍需依赖技术创新、政策协同与社会共识的同步演进。

第六章 大模型训练工业应用的价值

一、大模型训练与工业制造的结合路径

1. 数据驱动的多模态融合

o 大模型通过整合工业场景中的多源异构数据(如设备传感器时序数据、CAD图纸、质检图像、工艺文档等),构建跨模态理解能力。例如,海尔集团利用大模型分析产品设计数据与用户反馈,生成高保真设计效果图并优化材料利用率。

o 工业互联网平台(如卡奥斯COSMOPlat)作为数据底座,实现生产数据的实时采集、清洗与标注,为大模型提供高质量训练数据。

2. 知识增强与动态适配

o 检索增强生成(RAG):外挂行业知识库(如设备手册、工艺标准),结合实时数据检索提升模型输出的准确性与可追溯性。鞍钢集团通过RAG技术将制度文档问答效率提升60%。

o 领域微调:基于通用大模型(如Transformer架构),利用行业专属数据集(如半导体制造参数)进行参数优化,提升任务精度。例如,西门子Industrial Copilot通过微调将仿真代码生成时间从数周缩短至数小时。

3. 边缘-云协同计算

将部分推理任务部署至边缘设备(如工业网关),结合云端大模型实现低时延响应。英特尔边缘AI架构可将设备故障诊断延迟降至10ms以内,同时减少云端算力消耗。

二、大模型训练解决的工业制造核心问题

1. 研发设计效率提升

大模型通过生成式设计(Generative Design)加速产品迭代,如海尔BaaS工业大脑优化家电结构设计,材料利用率提升12%;吉利汽车利用大模型生成自动驾驶仿真数据,减少物理测试成本。

2. 生产流程优化与质量控制

o 预测性维护:结合LSTM等时序模型分析设备振动数据,实现故障预警(容知日新PHMGPT模型减少非计划停机时间40%)。

o 视觉检测:Transformer架构处理高分辨率图像,识别微米级缺陷(如电路板焊点瑕疵,准确率达99.7%)。

3. 供应链与决策智能化

o 大模型结合强化学习优化排产策略,例如半导体制造中晶圆厂机台分配优化使产能利用率提升15%。

o 自然语言交互支持实时数据分析,如用户提问“当前生产线瓶颈时段”,模型自动生成效率报告与改进建议。

三、应用现状与发展趋势

1. 当前应用现状

1)头部企业实践:

o 海尔:基于大模型的智能设计系统缩短产品研发周期30%。

o 吉利汽车:利用大模型实现自动驾驶数据自动化标注与仿真场景生成。

o 西门子:开发Industrial Copilot生成仿真代码,加速工艺优化。

2)技术瓶颈:

o 数据壁垒与标准化不足(如MES、SCADA系统数据孤岛)。

o 模型可解释性差,安全关键场景(如化工控制)落地受限。

2. 未来发展趋势

- 多模态与跨领域融合:

结合文本、图像、3D点云数据构建统一推理能力,例如汽车装配中同步分析CAD图纸与实时摄像头数据。 - 轻量化与边缘部署:

小参数模型(如Phi-4)结合4-bit量化技术,适配低算力设备。华为星火一体机已实现终端推理优化。 - 垂直领域专用模型:

行业定制化大模型(如矿山、医药)加速涌现,如山东能源盘古矿山大模型实现井下作业远程监控。 - 政策与生态协同:

上海“模速空间”等创新社区推动数据开放与算力共享,长三角区域协作破解语料与算力瓶颈。

四、小结

大模型训练与工业制造的结合已从单一场景试点走向全链条渗透,其核心价值在于重构知识沉淀方式与提升复杂决策效率。未来,随着多模态技术突破与行业生态完善,大模型将进一步推动制造业向“自感知、自决策、自执行”的智能化阶段演进。然而,数据治理、模型可信与成本控制仍是亟待突破的挑战,需产学研协同构建标准化解决方案。

第七章 大模型训练机构及岗位需求

一、使用大模型训练的机构与组织类型

1. 科技公司与AI实验室

1. 科技公司与AI实验室

1) 头部科技企业:如Google(PaLM、Gemini)、微软(Azure OpenAI)、Meta(Llama系列)、华为(盘古大模型),通过大模型驱动核心产品(搜索、云服务、社交平台)。

2) AI初创公司:如OpenAI(GPT系列)、Anthropic(Claude)、Stability AI(Stable Diffusion),专注于生成式AI技术研发。

3) 行业AI解决方案商:如商汤科技、旷视科技,为金融、医疗等垂直领域提供定制化大模型服务。

2. 传统行业巨头

1) 金融行业:摩根大通利用大模型进行高频交易策略优化,平安科技开发风险评估模型。

2) 制造业:特斯拉工厂使用大模型优化生产线调度,西门子通过Industrial Copilot生成工业仿真代码。

3) 医疗健康:强生、辉瑞利用大模型加速药物分子设计,腾讯觅影辅助医学影像诊断。

4) 零售与物流:亚马逊通过大模型实现动态定价和库存预测,顺丰优化物流路径规划。

3. 政府与公共机构

1) 智慧城市管理:新加坡政府利用大模型分析交通流量,降低拥堵率;中国“城市大脑”项目优化公共资源配置。

2) 公共安全:美国国土安全部应用大模型进行网络威胁检测,欧盟通过AI监控非法内容传播。

3) 科研机构:欧洲核子研究中心(CERN)使用大模型分析粒子对撞数据,NASA预测气候变化影响。

4. 教育与研究机构

1) 高校实验室:斯坦福大学CRFM中心研究大模型伦理,清华大学开发中文大模型CPM。

2) 在线教育平台:可汗学院(Khanmigo)、Coursera集成AI助教,提供个性化学习方案。

5. 非营利组织与国际机构

1) 联合国:利用大模型预测粮食危机(WFP项目)、监测气候变化。

2) 公益组织:世界卫生组织(WHO)通过AI分析疫情传播趋势。

二、大模型训练的岗位与职责

1. 核心技术岗位

1) 大模型架构师:设计模型结构(如Transformer变体、MoE路由机制),优化计算效率。

2) 数据工程师:处理PB级多模态数据,构建高质量训练集(去噪、标注、增强)。

3) 分布式系统工程师:管理万卡GPU集群,优化通信协议(NCCL/RDMA)和容错机制。

2. 应用开发岗位

1) AI产品经理:定义大模型落地场景(如智能客服、代码生成),平衡技术可行性与商业需求。

2) 垂直领域专家:医疗、法律等行业的领域知识注入(如微调法律条文解释模型)。

3) 提示工程师(Prompt Engineer):设计高效提示词,提升模型输出准确率(如ChatGPT的“思维链”提示)。

3. 支持与合规岗位

1) AI伦理专家:解决模型偏见、隐私泄露问题,制定合规策略(如GDPR合规)。

2) 模型部署工程师:实现模型轻量化(量化、蒸馏)与边缘端部署(如手机端运行Llama-3)。

三、大模型训练人才需求及增长趋势

1. 需求现状

1)全球范围:

o LinkedIn数据显示,2023年全球AI岗位数量同比增长75%,其中大模型相关职位占40%。

o 美国AI工程师平均年薪达$18万美元(Levels.fyi数据),中国大厂(如腾讯、字节)相关岗位年薪超80万人民币。

2)行业分布:

o 科技行业占比60%(模型研发),金融(15%)、医疗(10%)、制造(8%)紧随其后。

2. 增长驱动因素

1) 技术渗透加速:Gartner预测,2025年70%的企业将使用生成式AI,推动人才需求激增。

2) 政策支持:中国“十四五”规划明确培养500万AI人才,欧盟AI法案催生合规专家需求。

3) 开源生态成熟:Hugging Face等平台降低技术门槛,中小企业开始招募AI团队。

3. 未来趋势(2024-2030)

1) 复合型人才紧缺:既懂技术又熟悉行业的专家缺口最大(如“AI+生物医药”跨学科人才)。

2) 区域差异显著:北美、中国、欧洲占据80%以上需求,东南亚、拉美市场逐步启动。

3) 岗位细分深化:

o 新兴职位:AI审计师(模型可解释性检查)、AI训练数据策展人。

o 传统岗位升级:市场营销人员需掌握AIGC工具(如生成广告文案)。

四、典型案例:人才需求与组织行动

| 机构类型 | 代表企业/组织 | 人才需求重点 | 典型招聘要求 |

| 科技公司 | OpenAI | 大模型研究员、分布式系统工程师 | 博士学位(NLP/ML)+ 千亿参数模型调优经验 + PyTorch/CUDA精通 |

| 金融机构 | 高盛集团 | 量化分析师(AI方向)、风险管理AI专家 | 金融建模经验 + Python/TensorFlow + 大模型在高频交易中的应用案例 |

| 制造企业 | 特斯拉 | 工业AI工程师、机器人控制算法专家 | 熟悉ROS系统 + 多模态大模型(视觉-文本融合) + 生产线优化经验 |

| 政府机构 | 新加坡智慧国办公室 | 公共政策AI顾问、数据治理专家 | 法律/公共管理背景 + AI伦理知识 + 多语言数据处理能力 |

五、小结

大模型训练已成为跨行业、跨领域的核心能力,从科技巨头到传统企业,从政府到非营利组织,均在积极布局。人才需求呈现“技术深度+行业广度”双轨增长,未来五年内复合型人才缺口将持续扩大。对于从业者而言,掌握大模型核心技术(如分布式训练、提示工程)并深耕垂直领域(如医疗、金融),将成为职业发展的关键竞争力。

第八章 大模型训练从入门到精通

一、入门阶段:夯实基础

1. 核心知识储备

1) 数学基础:

o 线性代数:矩阵运算、特征值分解(如Transformer中的注意力计算)。

o 概率与统计:贝叶斯理论、极大似然估计(模型训练的理论基础)。

o 微积分:梯度下降、反向传播(理解优化过程)。

2) 编程能力:

o Python:熟练掌握NumPy、Pandas、Matplotlib库。

o 深度学习框架:PyTorch或TensorFlow的基础使用(张量操作、自动微分)。

3) 机器学习基础:

o 监督学习与无监督学习原理(分类、回归、聚类)。

o 神经网络基础(全连接层、CNN、RNN)。

2. 学习资源

1) 书籍:《深度学习》(花书)、《动手学深度学习》(李沐)。

2) 课程:吴恩达《机器学习》和《深度学习专项课程》(Coursera)。

3) 实践工具:Google Colab(免费GPU环境)、Kaggle入门竞赛。

二、开始阶段:上手大模型训练

1. 核心技能

1)数据处理:

o 文本清洗(正则表达式、NLTK/Spacy分词)、数据增强(回译、随机掩码)。

o 使用Hugging Face Datasets库加载和处理开源数据集(如WikiText、C4)。

2) 模型基础:

o Transformer架构:理解自注意力机制、位置编码、多头注意力。

o 复现小规模模型(如BERT-base、GPT-2-small),掌握模型加载与微调。

3) 工具链入门:

o 使用Hugging Face Transformers库调用预训练模型。

o 掌握基础训练脚本编写(如使用PyTorch Lightning简化训练流程)。

2. 实践项目

1) 微调实战:

o 任务:文本分类(IMDB情感分析)、问答(SQuAD数据集)。

o 工具:Hugging Face Trainer + WandB(可视化训练过程)。

2) 开源模型体验:

本地部署LLaMA-7B或ChatGLM-6B,通过LangChain构建简单应用。

3. 学习资源

o 教程:Hugging Face官方文档、PyTorch官方教程。

o 代码库:Transformers示例代码(GitHub)、Meta开源的LLaMA项目。

三、进阶阶段:深入技术与工程优化

1. 核心技术

1) 分布式训练:

o 数据并行 vs. 模型并行(如Megatron-LM的层内拆分)。

o 工具:DeepSpeed(Zero冗余优化器)、NCCL通信库。

2) 高效训练技术:

o 混合精度训练(FP16/FP8)、梯度裁剪(Gradient Clipping)。

o 参数高效微调(LoRA、QLoRA、Adapter)。

3) 模型调优:

o 超参数搜索(网格搜索、贝叶斯优化)。

o 损失函数设计(对比学习损失、KL散度)。

2. 实践项目

1) 小规模预训练:

o 使用1B参数规模的模型(如GPT-Neo)在领域数据(如医学文献)上继续预训练。

o 优化策略:梯度累积、动态批处理。

2) 模型压缩与部署:

对微调后的模型进行量化(GGML/GGUF格式)、使用Ollama本地部署。

3. 学习资源

1)论文精读:

o 《Attention Is All You Need》(Transformer原论文)。

o 《ZeRO: Memory Optimization Towards Training A Trillion Parameter Models》。

2) 工具:DeepSpeed官方文档、NVIDIA Nsight性能分析工具。

四、精通阶段:突破与创新

1. 高阶能力

1) 架构设计与优化:

o 改进Transformer(如Sparse Attention、FlashAttention)。

o 混合专家模型(MoE)的动态路由设计与实现。

2) 大规模训练工程:

o 万卡集群管理(容错机制、弹性训练)。

o 自定义通信协议(如RDMA网络优化)。

3) 前沿技术探索:

o 多模态大模型(如CLIP、Flamingo)的联合训练。

o 强化学习与人类反馈(RLHF)的工程落地。

2. 实践挑战

1) 自研模型:

o 设计并训练百亿参数级模型(如基于Megatron框架)。

o 构建完整训练流水线(数据预处理→训练→评估→部署)。

2) 解决工业级问题:

o 长文本处理(上下文窗口扩展至1M tokens)。

o 低资源语言模型训练(如非洲小语种)。

3. 学习资源

1) 论文与社区:

o ArXiv每日追踪(关键词:LLM, MoE, RLHF)。

o 参与AI顶会(NeurIPS、ICML)研讨会。

2) 开源项目:

o Meta的LLaMA-2代码库、DeepSeek-MoE技术报告。

o EleutherAI的GPT-NeoX框架。

五、知识体系总结

| 阶段 | 核心知识 | 关键工具 | 能力目标 |

| 入门 | 数学基础、Python、神经网络基础 | PyTorch、Colab | 复现经典模型 |

| 开始 | Transformer、数据工程、微调技术 | Hugging Face、WandB | 独立完成领域微调项目 |

| 进阶 | 分布式训练、模型压缩、超参数优化 | DeepSpeed、Megatron-LM | 优化千亿级模型训练效率 |

| 精通 | 架构创新、RLHF、多模态融合 | 自研框架、集群管理系统 | 设计并训练行业领先的大模型 |

六、持续成长建议

- 保持实践:每月参与1个Kaggle比赛或开源项目贡献。

- 跨领域学习:补充系统架构(CUDA编程)、伦理学知识(AI安全)。

- 社区互动:加入Hugging Face讨论组、国内AI社群(如智源社区)。

- 行业洞察:关注Gartner技术趋势报告、头部企业(OpenAI、DeepMind)技术动态。

通过系统性学习与实践,结合对技术趋势的敏锐洞察,逐步从入门迈向精通,最终成为能够主导大模型研发的核心人才。

【免责声明】本文主要内容均来自于网络公开资料,部分内容引用Ai。仅供参考,责任自负。

821

821

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?