一、研究背景

当前人工智能领域存在显著的知识传播与学习困境:一方面,碎片化的短视频类知识传播形式难以系统性解答核心技术问题;另一方面,人工智能知识体系庞大复杂,学习者既渴望快速掌握核心逻辑,又难以投入大量时间进行系统性学习。在此背景下,本报告基于系列科普内容,系统梳理人工智能从早期符号主义到现代深度学习的核心技术演进,解析关键技术原理与应用逻辑,为相关学习与研究提供结构化参考。

二、人工智能核心技术演进脉络

(一)早期人工智能:符号主义思想

符号主义是人工智能早期的核心思想,其核心逻辑在于将现实世界抽象为符号,通过设定明确的运算规则(即函数),实现对现实世界的解释与预测。典型案例包括基于勾股定理的直角三角形斜边计算、基于牛顿第二定律的力度推导等。该思想认为世间万物均可通过明确的逻辑规律构建精确函数,但在复杂场景中存在显著局限性:例如图像识别、自然语言翻译等任务,人类难以构建出完全匹配实际需求的精确函数,导致技术应用受限。

(二)现代人工智能:联接主义思想

针对符号主义的局限性,连接主义思想应运而生,其核心突破在于放弃对 “精确函数” 的追求,转而通过 “猜测 - 优化 - 逼近” 的思路寻找近似解。具体逻辑如下:

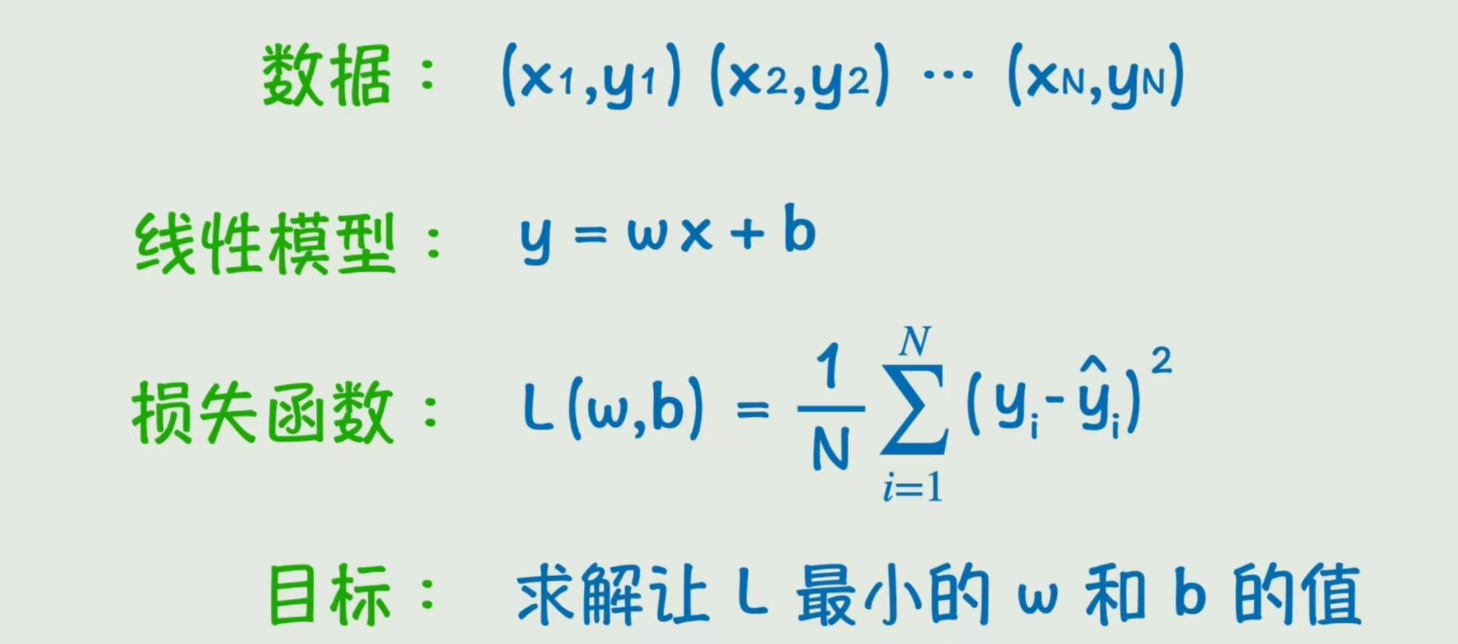

数据建模:将输入变量(X)与输出变量(Y)映射至坐标体系,初步构建简单线性函数(如 Y=WX+B,其中 W 为权重、B 为偏置);

参数优化:通过逐步调整 W 和 B 的值,使函数模型不断贴近真实数据,若无法实现完全吻合,则以 “近似有效” 为目标停止优化;

核心优势:该方法无需预设明确的逻辑规则,仅通过数据驱动即可实现模型优化,成功解决了图像识别、手写数字识别等符号主义难以突破的任务,证明了其技术有效性。

三、神经网络核心技术原理

(一)非线性变换与神经网络构建

线性函数的局限性:简单线性函数仅能拟合线性分布数据,无法应对复杂场景中的非线性关系;

激活函数的引入:通过在 linear 函数外层嵌套非线性运算(如平方、sin/cos 函数等激活函数),将线性关系转化为变化能力更强的非线性关系,实现对复杂数据的拟合;

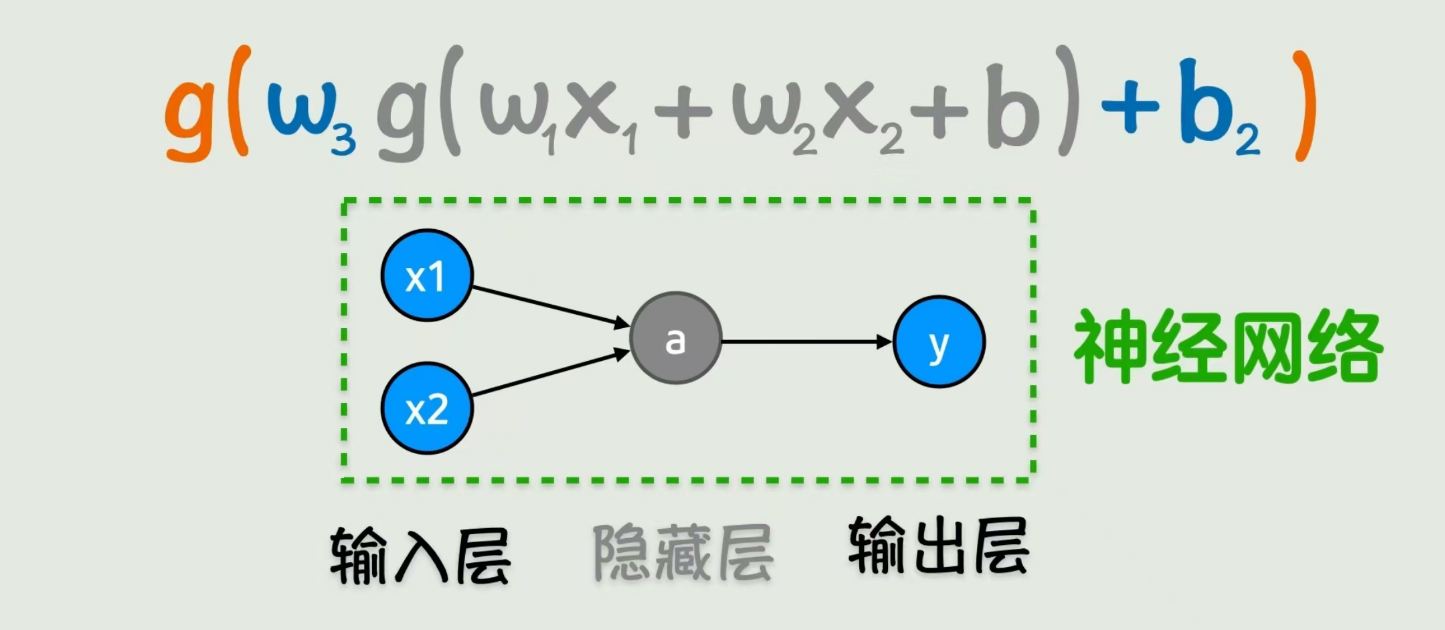

神经网络结构设计:

基础结构:输入层(接收数据变量)、输出层(输出预测结果)构成基本框架,每层包含若干 “神经元”,神经元间的连接代表函数运算关系;

隐藏层扩展:将 “线性变换 + 激活函数” 的组合作为基本单元,通过多层嵌套形成隐藏层,理论上可逼近任意连续函数;

前向传播:信号从输入层经隐藏层向输出层传递,本质是逐层计算复杂非线性函数值的过程。

(二)参数优化核心技术

损失函数定义:用于量化模型预测值(ŷ)与真实值(Y)的误差,常用均方误差公式(通过平方替代绝对值解决优化平滑性问题,同时放大关键误差影响,再通过样本数量平均消除数据规模干扰);

梯度下降算法:

核心目标:寻找使损失函数最小化的参数(W 和 B),对于简单线性模型可通过导数为零直接求解极值点;

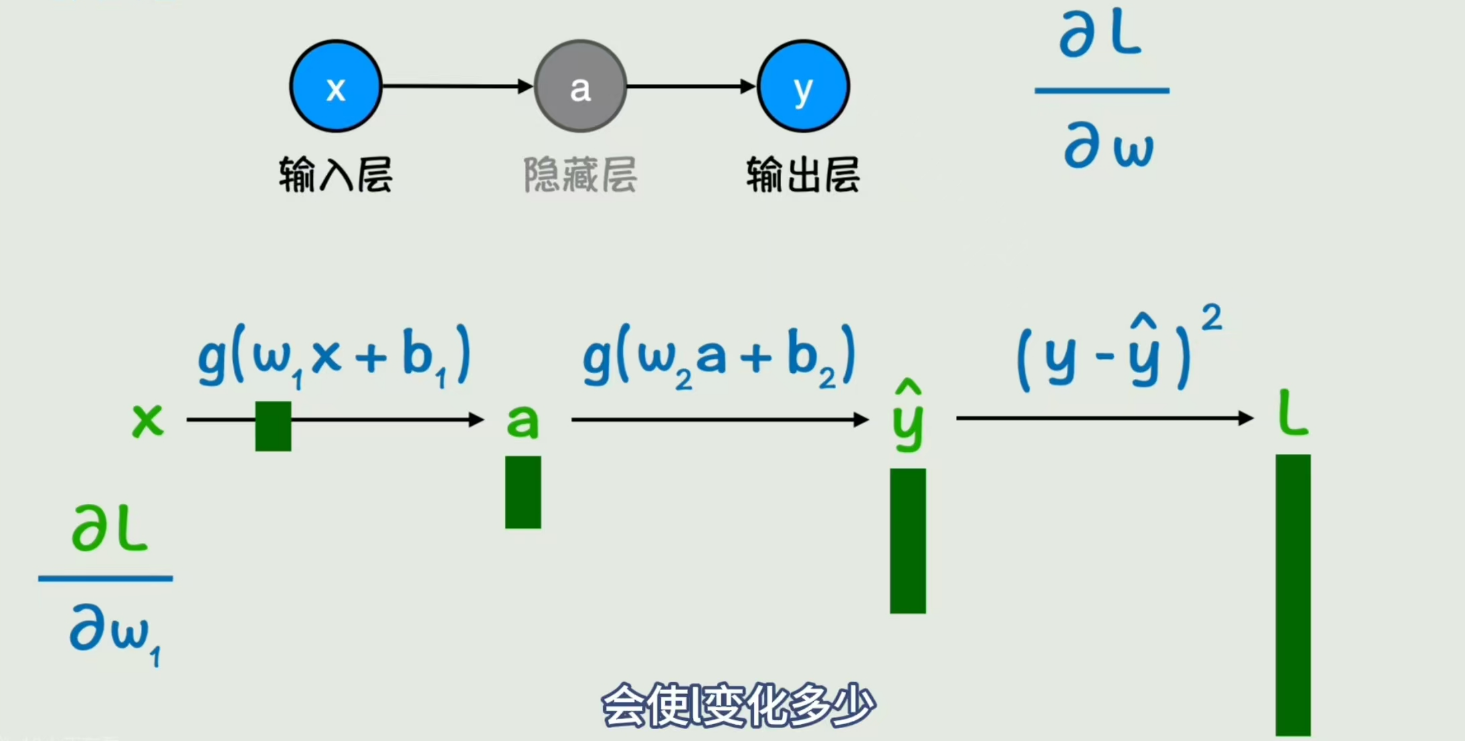

复杂场景优化:针对神经网络的复杂非线性函数,通过 “逐步试探 - 方向调整” 实现优化 —— 计算损失函数对各参数的偏导数(构成梯度向量),将参数向梯度反方向逐步调整,通过学习率控制调整幅度,最终逼近最优解;

反向传播机制:利用复合函数求导的链式法则,从输出层向输入层反向计算各层参数的偏导数,复用中间计算结果减少冗余运算,实现神经网络参数的高效更新。前向传播与反向传播的循环迭代,构成神经网络的完整训练过程。

(三)过拟合问题与解决方案

过拟合现象:模型在训练数据上表现优异,但在未见过的新数据上预测效果较差,本质是模型过度学习训练数据中的噪声而非核心规律,导致泛化能力不足;

核心解决策略:

数据层面:通过数据增强(如图像旋转、翻转、裁剪、加噪等)扩充训练样本,同时提升模型鲁棒性;

模型层面:简化神经网络结构,避免模型复杂度超出数据规律需求;

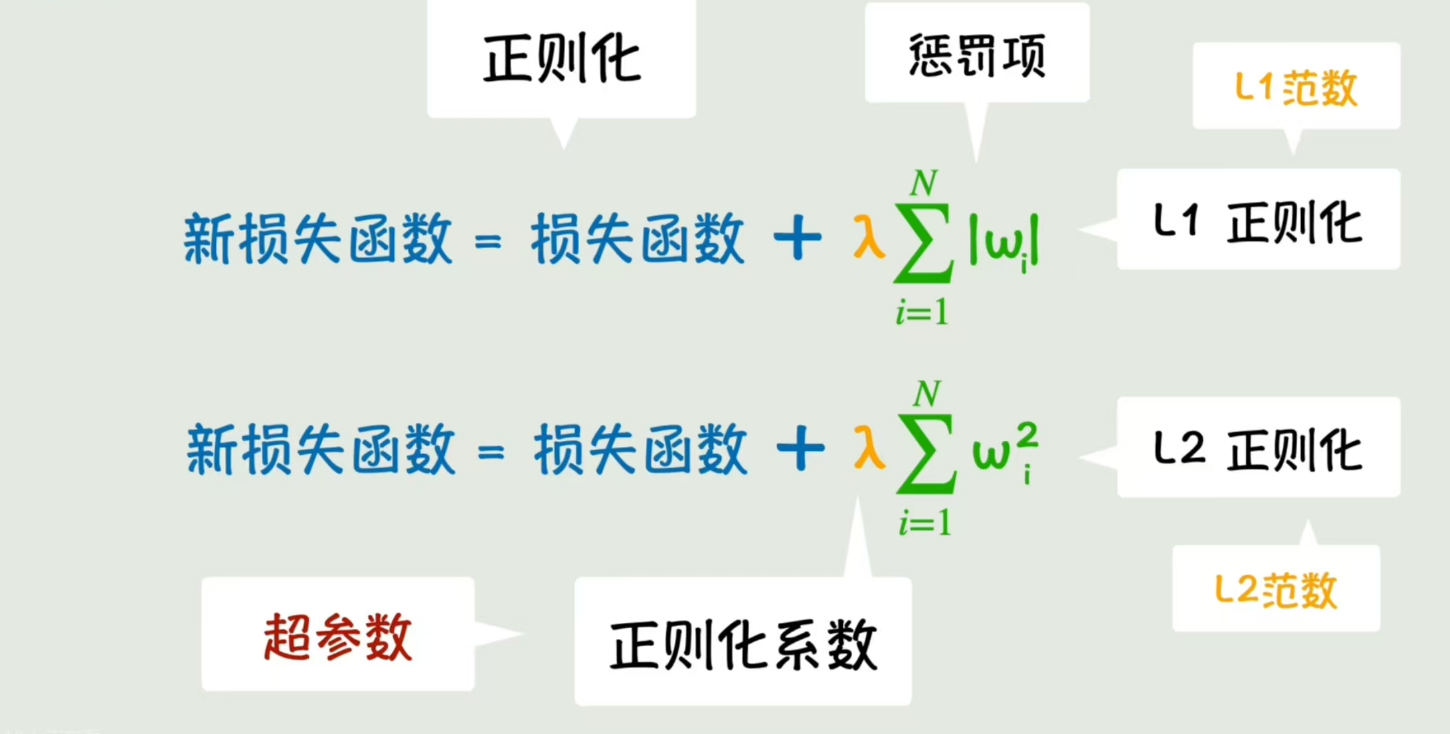

训练层面:采用提前终止训练(避免过度优化)、正则化(L1 正则化通过参数绝对值之和惩罚、L2 正则化通过参数平方和惩罚,抑制参数过度增长)、Dropout(训练中随机丢弃部分参数,避免模型依赖少量关键参数)等方法;

超参数控制:通过正则化系数、学习率等超参数调节优化效果,平衡模型拟合能力与泛化能力。

(四)进阶技术与网络结构

矩阵运算优化:将神经网络的加减乘除运算转化为矩阵运算,一方面简化公式表达,另一方面适配 GPU 并行计算特性,提升训练与推理效率;

卷积神经网络(CNN):

技术突破:针对全连接层参数量庞大、无法保留空间特征的局限性,引入卷积运算替代标准矩阵乘法,通过卷积核对局部特征的提取,减少权重参数数量;

核心结构:由输入层、卷积层(特征提取)、池化层(降维保留关键特征)、全连接层(结果输出)构成,适用于图像识别等静态数据处理场景;

技术优势:可可视化训练过程中的特征提取效果,有效捕捉数据局部模式,显著提升图像识别等任务的准确率。

四、技术应用场景与有效性验证

基础任务验证:手写数字识别、简单图像分类等任务中,连接主义思想下的神经网络模型通过少量参数即可实现高效识别,验证了核心技术的有效性;

实际应用场景:卷积神经网络在图像识别、计算机视觉等领域的广泛应用,解决了传统技术难以处理的复杂场景问题,成为当前人工智能落地的核心技术支撑之一;

技术延伸:基于核心原理衍生的循环神经网络(RNN)、注意力机制、Transformer 架构等,进一步拓展至自然语言处理、语音识别、视频分析等动态数据处理场景,推动大语言模型等前沿技术的发展。

五、技术挑战与发展展望

(一)当前技术挑战

训练优化问题:深层神经网络存在梯度消失(梯度反向传播时逐渐衰减,导致参数更新困难)、梯度爆炸(梯度数值异常增大,参数调整失控)等问题;

效率与开销问题:大规模数据训练时,完整前向传播与反向传播的计算开销较大,收敛速度可能受局部最优解、震荡等因素影响;

技术适配问题:不同场景(静态数据 vs 动态数据)对网络结构存在差异化需求,单一模型难以适配全场景应用。

(二)核心应对策略

针对上述挑战,行业已形成系列成熟解决方案:采用梯度裁剪防止参数更新过大、通过残差网络缓解深层网络梯度衰减、利用权重初始化与数据归一化优化梯度分布、通过动量法、RMSProp、Adam 等自适应优化器加速收敛、采用 Mini-Batch 分割数据降低计算开销等。

(三)未来发展方向

人工智能技术正朝着 “结构优化 - 效率提升 - 场景拓展” 的方向演进:一方面,网络结构将持续创新,适配更多动态数据处理场景;另一方面,优化算法将不断迭代,平衡计算效率与模型效果;此外,随着注意力机制、Transformer 等架构的深化应用,人工智能将从 “识别判断” 向 “创造决策” 升级,推动更多领域的技术革新。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?