DeblurGAN: Blind Motion Deblurring Using Conditional Adversarial Networks

摘要

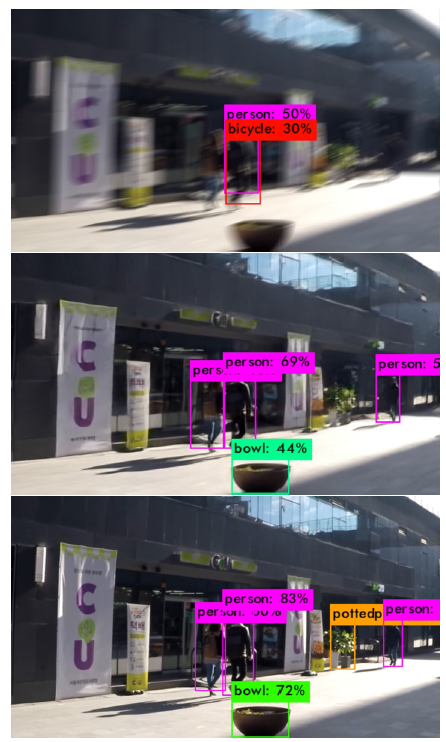

我们提出了一种基于条件GAN和内容丢失的运动去模糊的端到端学习方法。它在峰值信噪比,结构相似性度量和视觉外观方面提高了现有技术水平。去模糊模型的质量也以一种新颖的方式评估现实世界的问题 - 对(去)模糊图像的物体检测。该方法比最接近的竞争对手快5倍。

其次,我们提出了一种从尖锐图像生成合成运动模糊图像的新方法,它允许逼真的数据集增强。

有关模型,培训代码和数据集,请访问 https://github.com/KupynOrest/DeblurGAN

1. Introduction

在没有关于内核或相机移动的信息的情况下,这项工作致力于从单张照片中移除运动模糊。最近在图像超分辨率[18]和绘画[40]的相关领域通过应用生成对抗网络(GAN)[10]取得了很大进展。GAN以能够在图像中保留高纹理细节并创建接近真实图像流形的解决方案而闻名,并且在感知上看起来更具说服力。受近期图像超分辨率[18]和生成对抗网络图像到图像翻译[14]的启发,我们将去模糊视为这种图像到图像翻译的特例。我们介绍了DeblurGAN - 一种基于条件生成对抗网络的方法[22]和一种多组件损失函数。与以前的作品不同,我们使用Wasserstein GAN [2]和Gradient Penalty [11]和感知损失[15]。这鼓励了在感知上难以与真实清晰图像区分的解决方案,并且与使用传统MSE或MAE作为优化目标相比,允许恢复更精细的纹理细节。

我们的贡献是三倍的。首先,我们提出了一种损失和架构,它在运动去模糊中获得了新的最先进的结果,同时比最快的竞争对手快5倍。其次,我们提出了一种基于随机轨迹的方法,用于从一组清晰图像以自动方式生成用于运动去模糊训练的数据集。我们表明,将其与现有的运动去模糊学习数据集相结合,与仅对真实世界图像进行训练相比,可以改善结果。最后,我们提出了一种新的数据集和评估去模糊算法的方法,基于它们如何改进对象检测结果。

2. Related work

2.1. Image Deblurring

模糊模型的常见表述如下:

I B = K ∗ I S + N I_{B}=K * I_{S}+N IB=K∗IS+N

其中 I B I_{B} IB 是模糊图像,K是模糊核, I S I_{S} IS是尖锐的潜像,* 表示卷积运算,N是加性噪声。

整个deblurring方法分为两种类型:盲目和非盲目去模糊。早期作品[33]主要关注非盲目去模糊,假设模糊函数K已知。他们中的大多数依靠经典的Lucy-Richardson算法,Wiener或Tikhonov滤波器来执行反卷积运算并获得 I S I_{S} IS估计。实际上,模糊函数是未知的,因此可以在尖锐的锐利 I S I_{S} IS和模糊核K中找到盲目去模糊算法。为每个像素找到模糊函数是一个不适定的问题,因此大多数现有算法依赖于图像启发式和模糊源的假设。这些方法系列通过考虑图像上的均匀模糊来解决由相机抖动引起的模糊。首先,根据诱导模糊核估计相机运动,然后通过执行反卷积操作来反转效果。从Fergus等人[8]的成功开始,在过去十年中已经开发了许多衍生方法[39] [37] [26] [3]。

一些方法基于迭代方法[8] [39],它通过使用参数先验模型改进了每次迭代的运动内核和清晰图像的估计。然而,运行时间以及停止标准对于那些类型的算法来说是一个重要问题。其他人使用模糊函数的局部线性假设和简单的启发式来快速估计未知内核。这些方法速度很快,但在一小部分图像上运行良好。随着深度学习的成功,在过去几年中,出现了一些基于卷积神经网络(CNN)的方法。 Sun等人 [32]使用CNN估计模糊核,Chakrabarti [6]预测运动核的复傅立叶系数在傅立叶空间中执行非盲去模糊,而Gong [9]使用完全卷积网络移动运动流估计。所有这些方法都使用CNN来估计未知模糊函数。最近,Noorozi [25]和Nah [23]采用无内核的端到端方法,使用多尺度CNN直接去除图像。这些方法能够处理模糊的不同来源。

2.2. Generative adversarial networks

Goodfellow等人介绍了生成对抗网络的概念。 [10],是在两个竞争网络之间定义一个游戏:鉴别器和发生器。发生器接收噪声作为输入并生成样本。鉴别器接收真实和生成的样本,并试图区分它们。生成器的目标是通过生成无法与真实样本区分的感知上令人信服的样本来欺骗鉴别器。从理论的角度来看,生成器G和鉴别器D之间的游戏是最小极大目标:

min G max D E x ∼ P r [ log ( D ( x ) ) ] − E x ~ ∼ P g [ log ( 1 − D ( x ~ ) ) ] \min _{G} \max _{D} \underset{_{x \sim \mathbb{P}_{r}}}{\mathbb{E}}[\log (D(x))] -\underset{\tilde{x} \sim \mathbb{P}_{g}}{\mathbb{E}}[\log (1-D(\tilde{x}))] GminDmaxx∼PrE[log(D(x))]−x~∼PgE[log(1−D(x~))]

其中 P r \mathbb{P}_{r} Pr是数据分布, P g \mathbb{P}_{g} Pg是模型分布,由 x ~ = G ( z ) , z ∼ P ( z ) \tilde{x}=G(z), z \sim P(z) x~=G(z),z∼

本文提出了一种名为DeblurGAN的端到端学习方法,利用条件对抗网络和内容损失进行运动去模糊,提高了现有技术水平。DeblurGAN在峰值信噪比、结构相似性度量和视觉效果上表现优秀,且比同类算法快5倍。此外,文章还介绍了用于生成逼真运动模糊图像的新方法,以及结合真实和合成数据集进行训练以改善去模糊结果的策略。通过对象检测评估,DeblurGAN展示了其在去模糊任务中的优越性能。

本文提出了一种名为DeblurGAN的端到端学习方法,利用条件对抗网络和内容损失进行运动去模糊,提高了现有技术水平。DeblurGAN在峰值信噪比、结构相似性度量和视觉效果上表现优秀,且比同类算法快5倍。此外,文章还介绍了用于生成逼真运动模糊图像的新方法,以及结合真实和合成数据集进行训练以改善去模糊结果的策略。通过对象检测评估,DeblurGAN展示了其在去模糊任务中的优越性能。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?