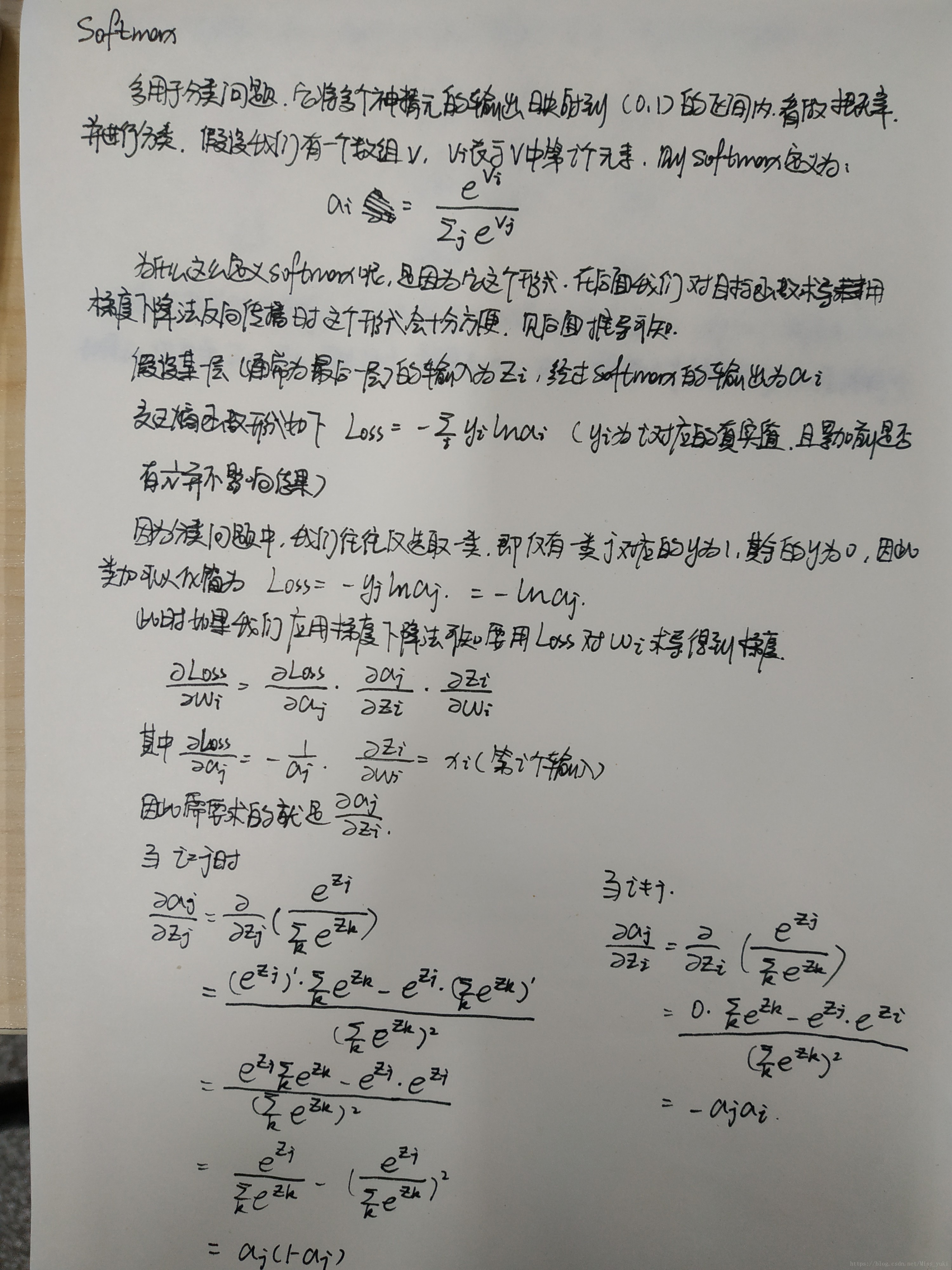

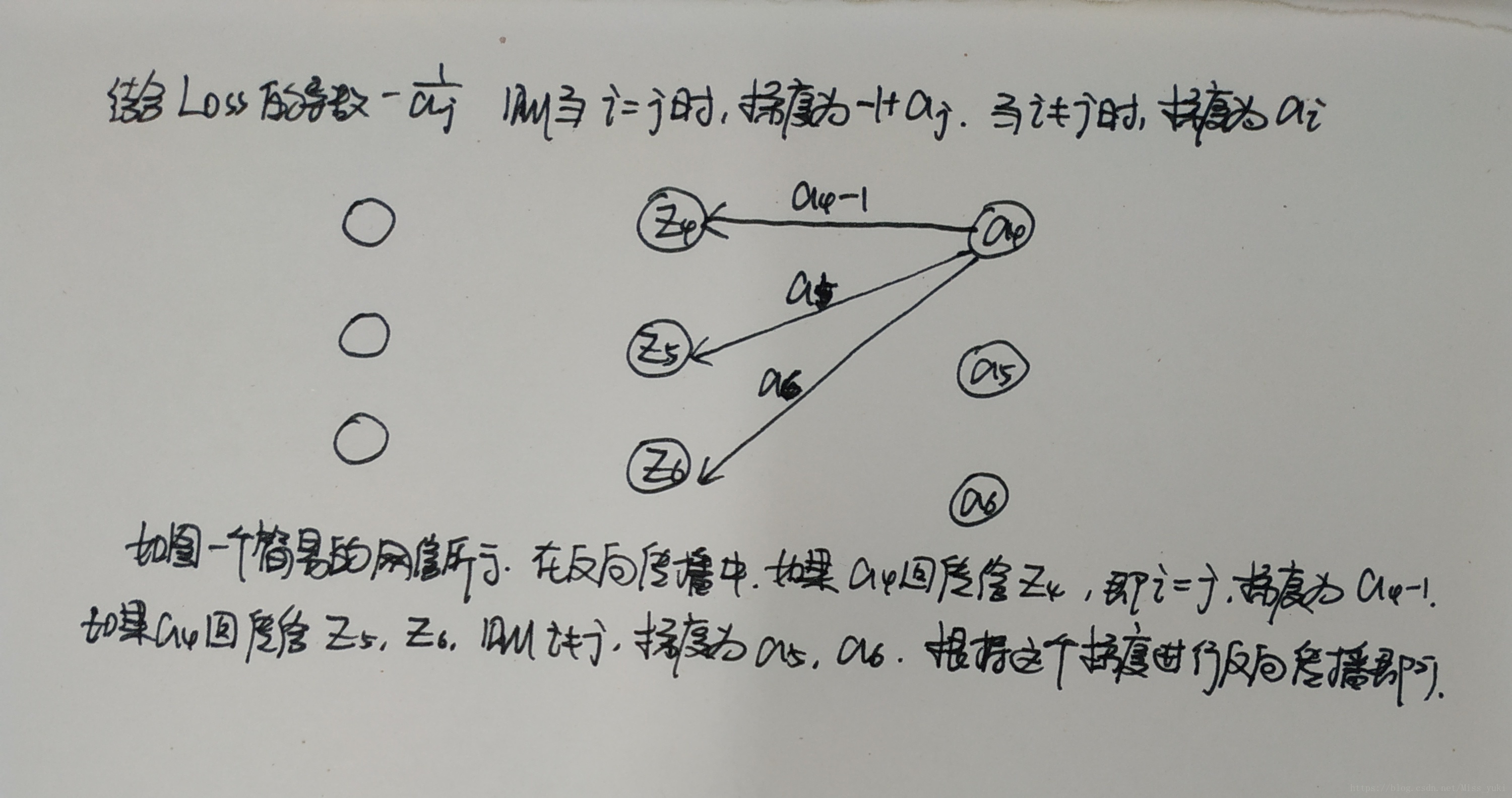

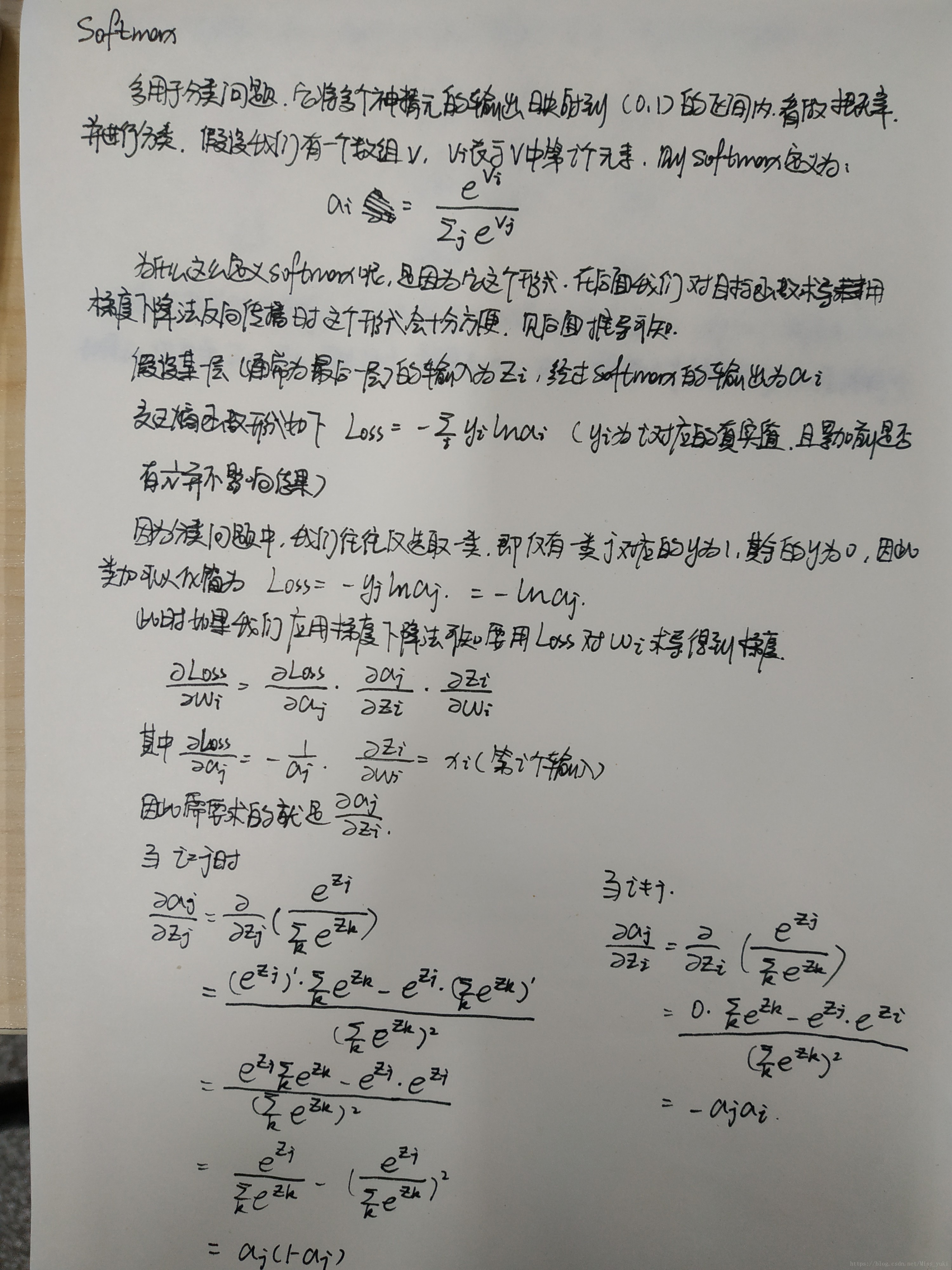

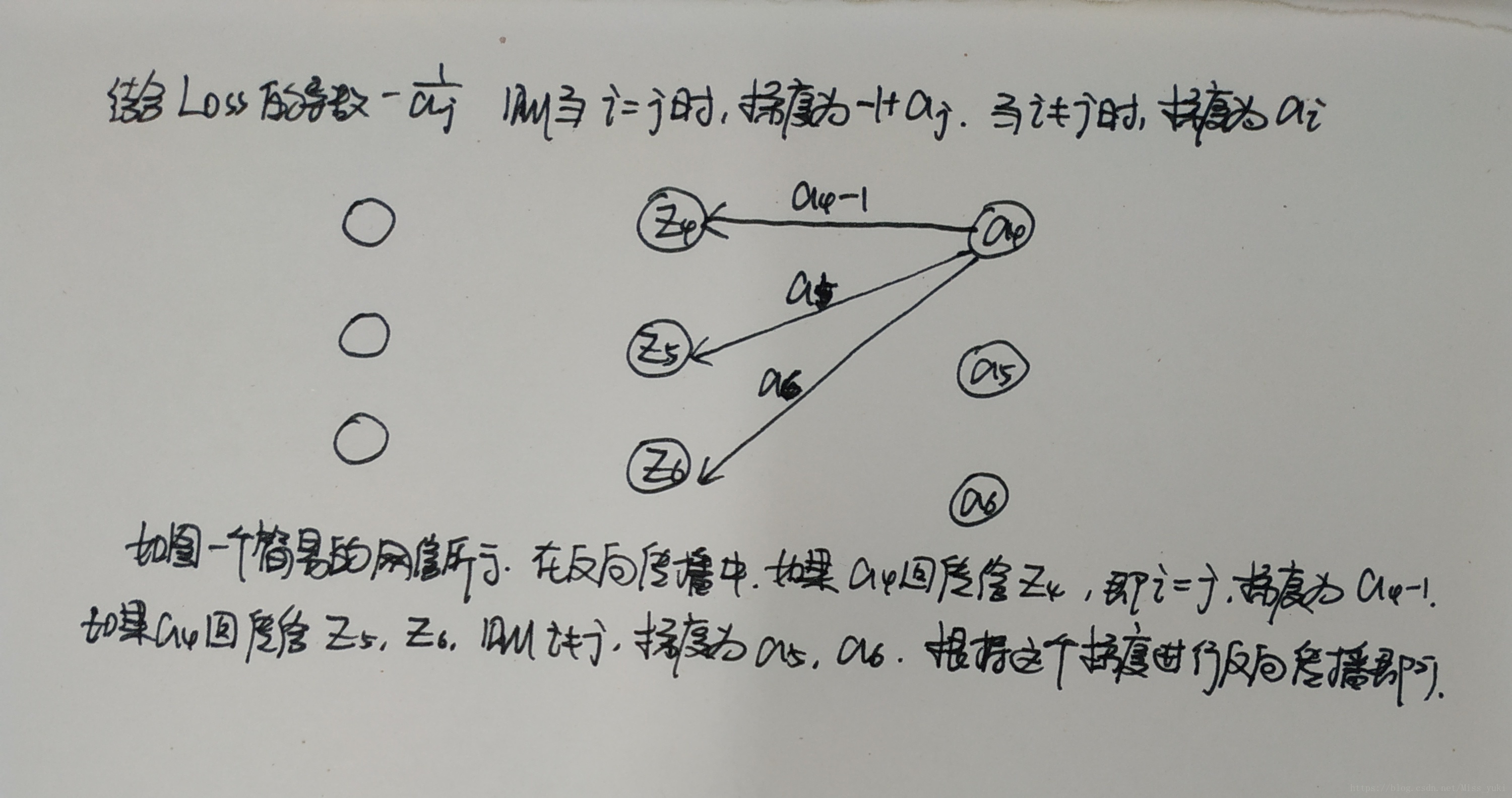

大家好,继续理论的学习,虽然前面的博客已经简略介绍了目标函数和Softmax,但最近又更深入学习了一些,因此再为Softmax单独开一篇博客,介绍Softmax是如何配合Loss函数求偏导,根据梯度下降法反向传播的。

学到很多,我们下期见!

大家好,继续理论的学习,虽然前面的博客已经简略介绍了目标函数和Softmax,但最近又更深入学习了一些,因此再为Softmax单独开一篇博客,介绍Softmax是如何配合Loss函数求偏导,根据梯度下降法反向传播的。

学到很多,我们下期见!

218

218

401

401

1153

1153

934

934

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?