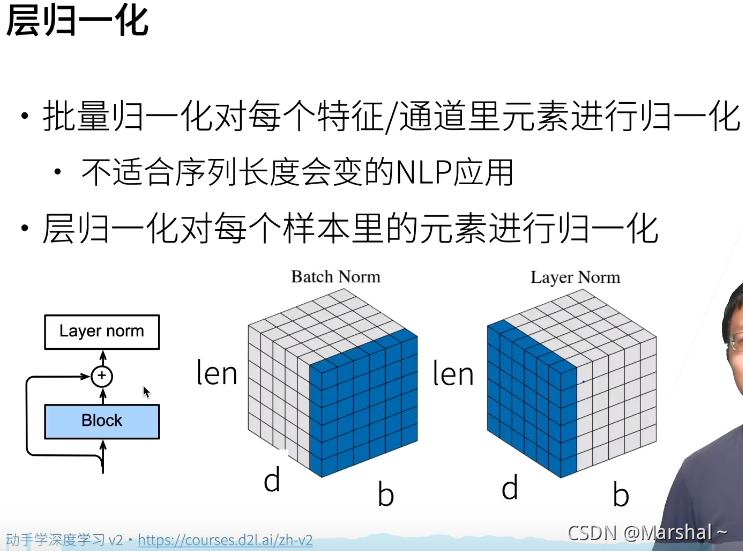

d:特征

b:batch_size将多少数据打包

len:长度

BN就是取出一个特征(所有样本的一个特征),对其进行归一化,直到取完全部特征。

LN就是取出所有的batch,取出每个batch中的一个样本进行归一化。

BN与LN归一化

最新推荐文章于 2024-06-03 20:42:51 发布

本文探讨了BN(批归一化)和LN(层归一化)在深度学习模型中的作用。BN通过对每个批次的数据进行归一化来加速训练和改善模型性能,而LN则对每个批次内的单个样本进行归一化,适用于循环神经网络。理解这两种技术的差异对于优化模型至关重要。

本文探讨了BN(批归一化)和LN(层归一化)在深度学习模型中的作用。BN通过对每个批次的数据进行归一化来加速训练和改善模型性能,而LN则对每个批次内的单个样本进行归一化,适用于循环神经网络。理解这两种技术的差异对于优化模型至关重要。

865

865

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?