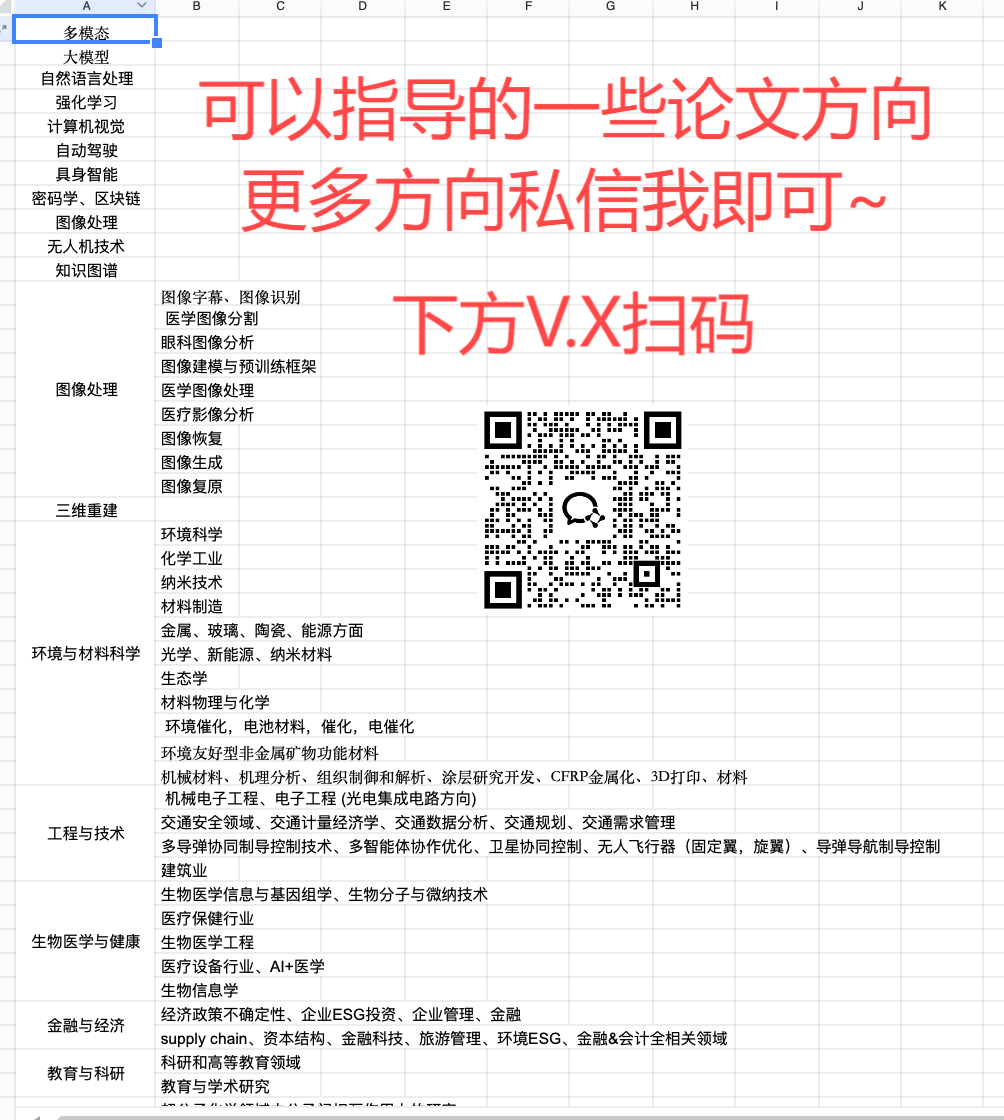

今天和大家聊聊多模态深度学习这个方向,它现在不仅学术价值高,在工业界的需求也非常明确,尤其是在医疗诊断这个关键领域。

比如Nature Communications上近期就有一篇相关应用,实现了正常认知、轻度认知障碍、阿尔茨海默病与非阿尔茨海默病痴呆的精准分类。推荐对这方向感兴趣的朋友研读。

目前,从论文发表情况来看,多模态深度学习仍然是比较好出成果的,不过简单的微调和应用拼接显然是不管用了,现在都往特定领域搞定制,或者高效率低门槛等方面努力。

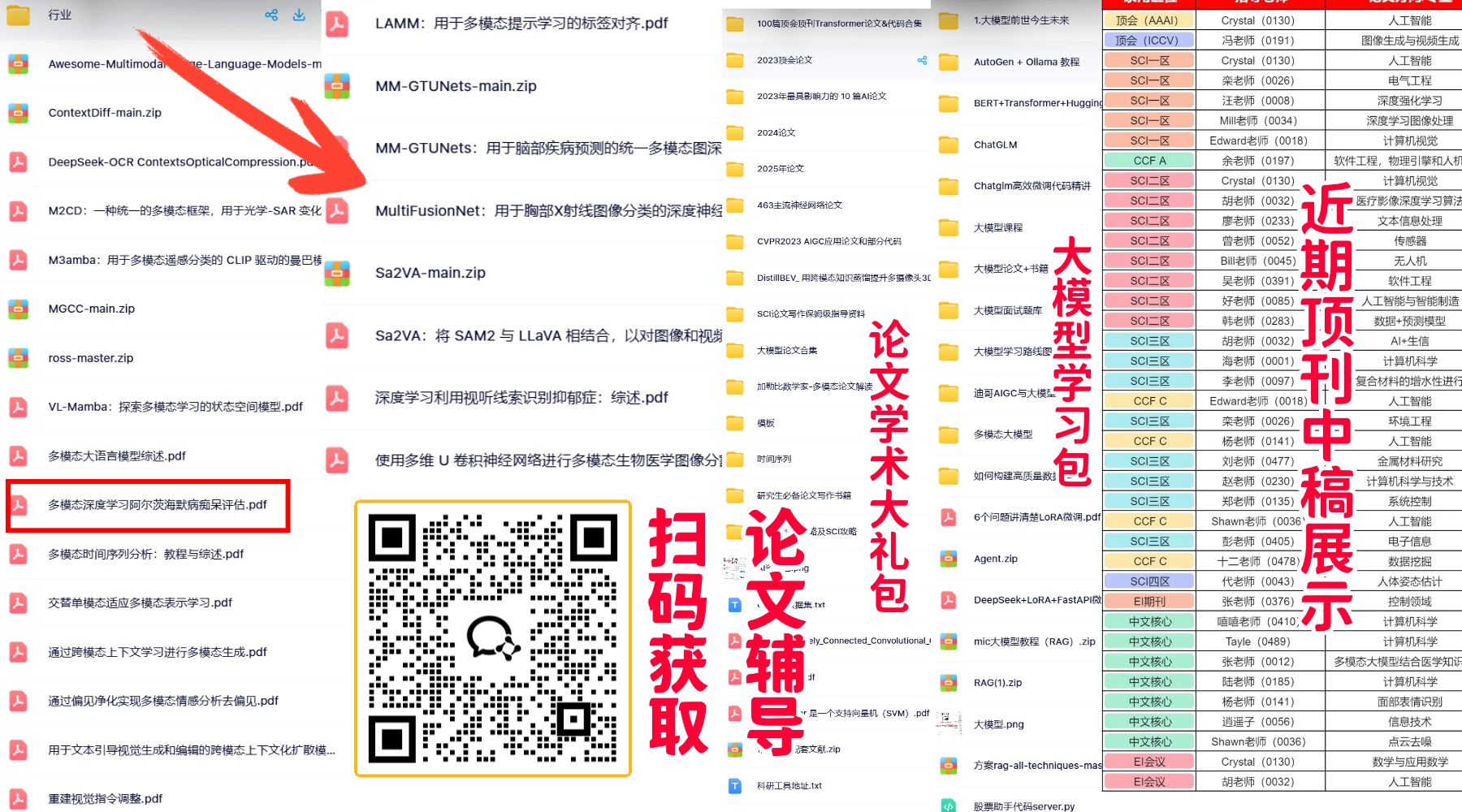

因此我建议各位先从现有的优秀工作入手,利用我已经整理好的多模态深度学习paper进行复现和baseline构建,节省更多精力以便快速搞定创新。

多模态深度学习目前是学术产出的高潜力领域,整体呈现 “入门有路径、创新有空间、成果易落地” 的特点,尤其适合追求快速出论文、冲击顶会顶刊的研究者。其核心优势在于 “跨模态融合的天然创新属性” 与 “产业需求驱动的学术热度”,但也存在一定门槛,能否高效出成果关键在于选对方向和方法。

一、为什么多模态深度学习 “好出成果”?

1. 学术热度高,接收渠道友好

多模态是当前 AI 领域的核心热点,顶会顶刊收录量逐年攀升 ——NeurIPS、ICML、AAAI 等顶会常年开设多模态专题,Nature 子刊等顶级期刊也频繁接收多模态数据融合相关成果(如临床重症预测、医疗影像分析等方向的突破性研究)。审稿人对该领域的创新容忍度更高,只要能解决 “单一模态局限” 的实际问题(如信息不全面、鲁棒性差),更容易获得认可。

2. 创新点密集,易落地且易出差异

多模态的核心是 “数据融合与跨模态交互”,每个环节都能衍生创新,且无需从零构建模型,基于现有框架即可快速迭代:

- 特征融合层创新:如在 U-Net、Transformer 中加入跨模态注意力模块,动态调整模态权重,解决特征尺度不匹配问题,已在医学影像分割中实现 Dice 系数提升 21% 的显著效果;

- 架构改进:将 Transformer 与图神经网络(GNN)、扩散模型结合,或引入联邦学习、元学习等思路,适配特定场景(如跨中心医疗数据隐私保护、罕见病少样本诊断);

- 任务拓展:在情感分析、自动驾驶、金融风控等赛道,将文本 + 图像、语音 + 视频等多模态数据结合,相比单模态模型准确率提升 13%-40%,成果说服力强;

- 工程化优化:针对轻量化部署、缺失模态自适应、训练效率提升等痛点,设计高效适配器或蒸馏方案,降低算力依赖,小团队也能完成。

3. 开源生态完善,入门门槛降低

当前多模态领域的数据集(如 BraTS 医疗影像、MSCOCO 图文、IEMOCAP 情感语音数据集)和基线模型(CLIP、ViT、BERT)均已开源,甚至有现成的训练框架和代码模板(如多模态 Transformer、GAN 增强型融合模型)。新手可直接基于现有模型微调,或替换数据集、优化某一模块(如注意力机制、损失函数),短期内即可产出有竞争力的结果,甚至实现 SOTA 突破(如 SimVG 模型在 NeurIPS 24 实现视觉定位任务效率与性能双提升)。

4. 应用价值突出,成果转化潜力大

多模态技术能解决单模态无法覆盖的复杂场景 —— 医疗领域的 CT+MRI 联合诊断、自动驾驶的视觉 + 雷达数据融合、金融风控的文本 + 图像欺诈识别等,均是产业刚需。这类 “学术 + 产业” 双驱动的研究,不仅容易通过审稿,还可能获得项目资助,形成 “论文 - 成果 - 落地” 的正向循环。

二、需要注意的挑战(避免走弯路)

- 跨学科门槛:需掌握至少两种模态的基础技术(如图像处理的 CNN、文本处理的 BERT、语音处理的 VGGish),以及融合逻辑(如模态对齐、特征映射),初期需要一定知识积累;

- 数据与算力成本:高质量多模态数据集标注难度大(如医疗影像 + 临床文本的配对数据),大规模预训练可能需要 GPU 支持,但轻量化框架(如 8B 参数边缘端多模态模型)和开源数据集已缓解这一问题;

- 创新同质化风险:简单的 “模态拼接”(如直接将图像特征与文本特征拼接输入模型)已成为红海,需聚焦 “真实痛点”(如缺失模态自适应、跨模态语义鸿沟),避免无意义的参数调优。

三、高效出成果的实操建议

- 选对细分赛道:优先选择 “数据易获取 + 痛点明确” 的方向,如医疗影像融合(BraTS、CheXpert 数据集开源)、情感分析(CMU-MOSI、MELD 数据集)、低资源场景(少样本、缺失模态);

- 小切口创新:不追求 “大而全”,聚焦单一环节突破 —— 如优化跨模态注意力机制、设计新型损失函数(如 InfoNCE 用于模态对齐)、数据增强(GAN 生成多模态样本),短期可出量化结果;

- 借力现有框架:基于 CLIP、ViT、U-Net 等成熟模型,通过 LoRA 微调、知识蒸馏等方式快速验证思路,减少重复开发;

- 突出量化指标:用具体数据说话(如准确率提升百分比、Dice 系数、推理效率提升),顶会顶刊对 “可量化的性能改进” 认可度极高。

总结

多模态深度学习是当前 **“性价比极高” 的论文产出领域 **:学术热度高、创新路径清晰、开源资源丰富,且成果兼具理论价值与应用潜力,无论是新手还是资深研究者,都能找到适合自己的切入点。只要避开 “简单拼接” 的同质化陷阱,聚焦具体场景的痛点问题,结合现有框架进行模块化创新,就能高效产出高质量论文,甚至冲击顶会顶刊。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?