B站视频链接,请多多关注本人B站:

📌 本博文的视频讲解

引言

随着嵌入式设备性能的提升和AI技术的进步,越来越多的开发者选择将复杂的AI模型部署在边缘设备上。本教程将引导你使用 Yocto项目构建嵌入式Linux系统,结合 TensorFlow Lite 和 SSD MobileNet量化模型,在树莓派上实现实时图像识别与抓取。

关联博文参考:

📌 基于Yocto项目与SSD MobileNet的树莓派AI视觉系统构建指南

📌 树莓派使用USB摄像头与TFLite实现目标检测的完整指南

一、硬件与软件环境

硬件要求

-

树莓派4B(推荐4GB内存版本)

-

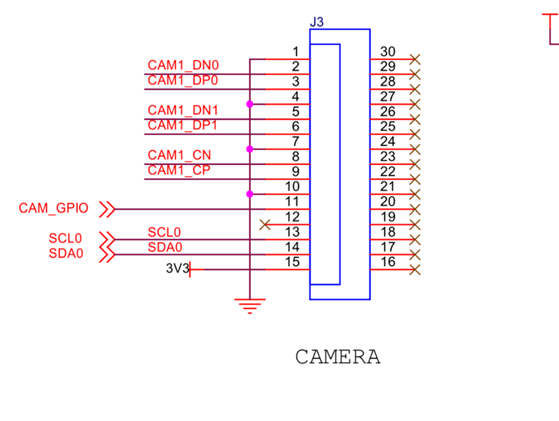

USB摄像头(支持UVC协议,如罗技C920)或 CSI摄像头模组

-

HDMI显示器(推荐1920x1080分辨率)

-

MicroSD卡(16GB以上,建议Class 10高速卡)

软件环境

- Yocto Project(Poky nanbield分支)

- TensorFlow Lite Runtime(集成XNNPACK加速库)

- V4L2驱动框架(摄像头控制)

- OpenCV 4.5+(图像处理与显示)

- SSD MobileNet量化模型(INT8版本)

二、Yocto项目环境搭建

关键步骤

- 克隆Yocto nanbield分支

git clone -b nanbield git://git.yoctoproject.org/poky - 添加必要的meta层

meta-raspberrypi(树莓派硬件支持)meta-tensorflow(TensorFlow Lite集成)meta-openembedded(OpenCV依赖)

- 配置镜像配方

在build/conf/local.conf中添加:IMAGE_INSTALL:append = " tensorflow-lite python3-opencv v4l-utils"

三、树莓派图像采集与处理

1. USB摄像头识别与V4L2框架

-

检查摄像头设备节点:

v4l2-ctl --list-devices

-

CSI摄像头驱动加载:

sudo modprobe bcm2835-unicam sudo i2cdetect -y 0

2. OpenCV捕获与分辨率适配

import cv2

cap = cv2.VideoCapture(0)

cap.set(cv2.CAP_PROP_FRAME_WIDTH, 1920)

cap.set(cv2.CAP_PROP_FRAME_HEIGHT, 1080)

while True:

ret, frame = cap.read()

if not ret:

break

cv2.imshow("Preview", frame)

if cv2.waitKey(1) == ord('q'):

break

cap.release()

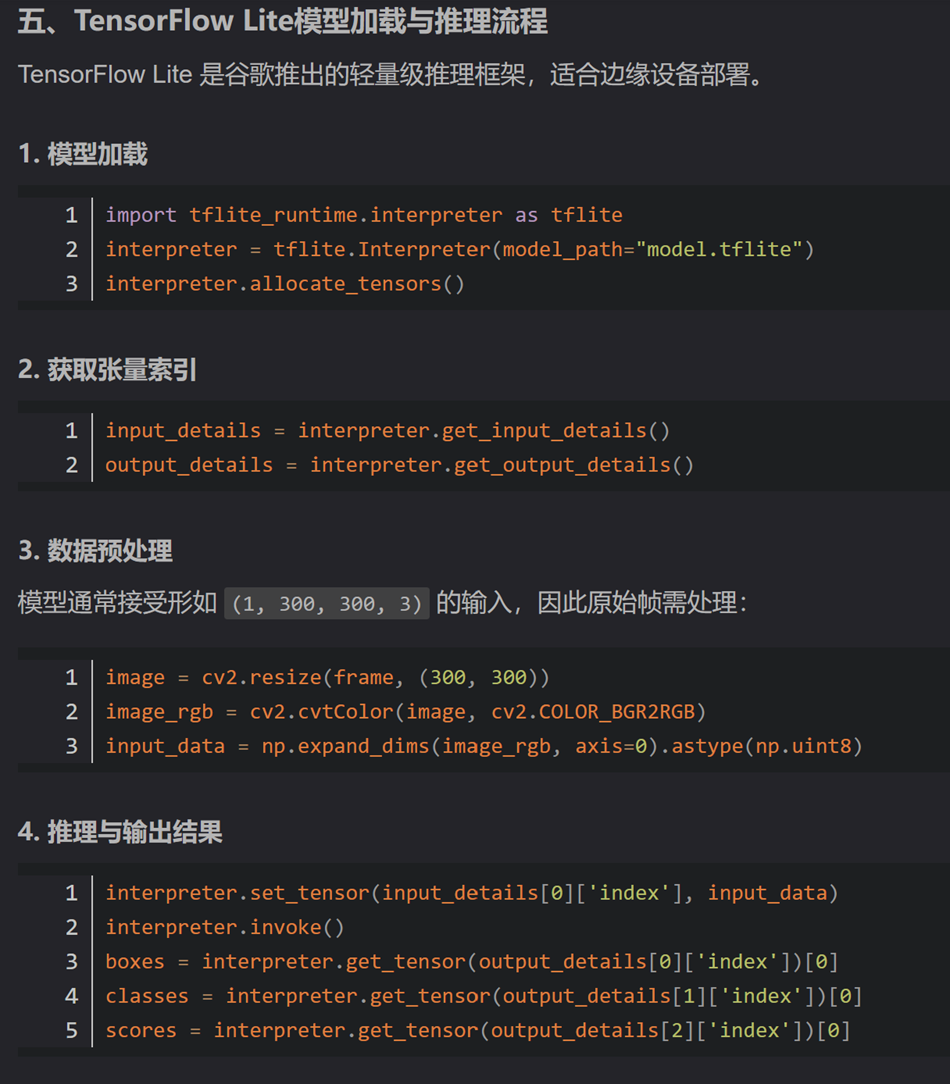

四、TensorFlow Lite模型加载与推理

1. 加载模型并启用加速

import tflite_runtime.interpreter as tflite

interpreter = tflite.Interpreter(

model_path="detect.tflite",

experimental_delegates=[tflite.load_delegate('libXNNPACK.so')]

)

interpreter.allocate_tensors()

2. 推理结果后处理

# 绘制检测框(置信度>0.5)

for detection in detections:

if detection['score'] > 0.5:

xmin, ymin, xmax, ymax = detection['bbox']

cv2.rectangle(frame, (xmin, ymin), (xmax, ymax), (0, 255, 0), 2)

五、SSD MobileNet量化模型解析

模型文件结构

tflite_models/

├── detect.tflite # 量化模型文件

├── coco_labels.txt # COCO数据集标签

└── tflite_camera.py # 推理脚本示例

六、实时目标检测效果展示

默认分辨率(720P)

1080P高清适配

frame_resized = cv2.resize(frame, (1920, 1080))

七、常见问题与排查方法

1. 摄像头无法识别

- 硬件检查:

- 确认USB供电充足(推荐使用5V/3A电源)

- CSI摄像头排线方向正确(金手指朝HDMI接口)

- 驱动加载:

sudo modprobe uvcvideo # USB摄像头 sudo modprobe bcm2835-unicam # CSI摄像头

2. 模型推理速度优化

- 启用Edge TPU加速:

delegates = [tflite.load_delegate('libedgetpu.so.1')] - 超频配置(需谨慎):

# /boot/config.txt over_voltage=2 arm_freq=1800

3. 分辨率适配冲突

- 动态分辨率适配:

actual_width = cap.get(cv2.CAP_PROP_FRAME_WIDTH) if actual_width < 1920: frame = cv2.resize(frame, (1920, 1080))

结语

通过本教程,你已掌握 Yocto定制系统构建 到 AI模型部署 的全流程。关键优化点包括:

- 使用XNNPACK和Edge TPU双加速

- 动态分辨率适配逻辑

- 摄像头驱动深度调试

扩展方向:

- 集成MQTT实现云端数据上报

- 多线程优化提升帧率稳定性

2995

2995

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?