一、卷积层

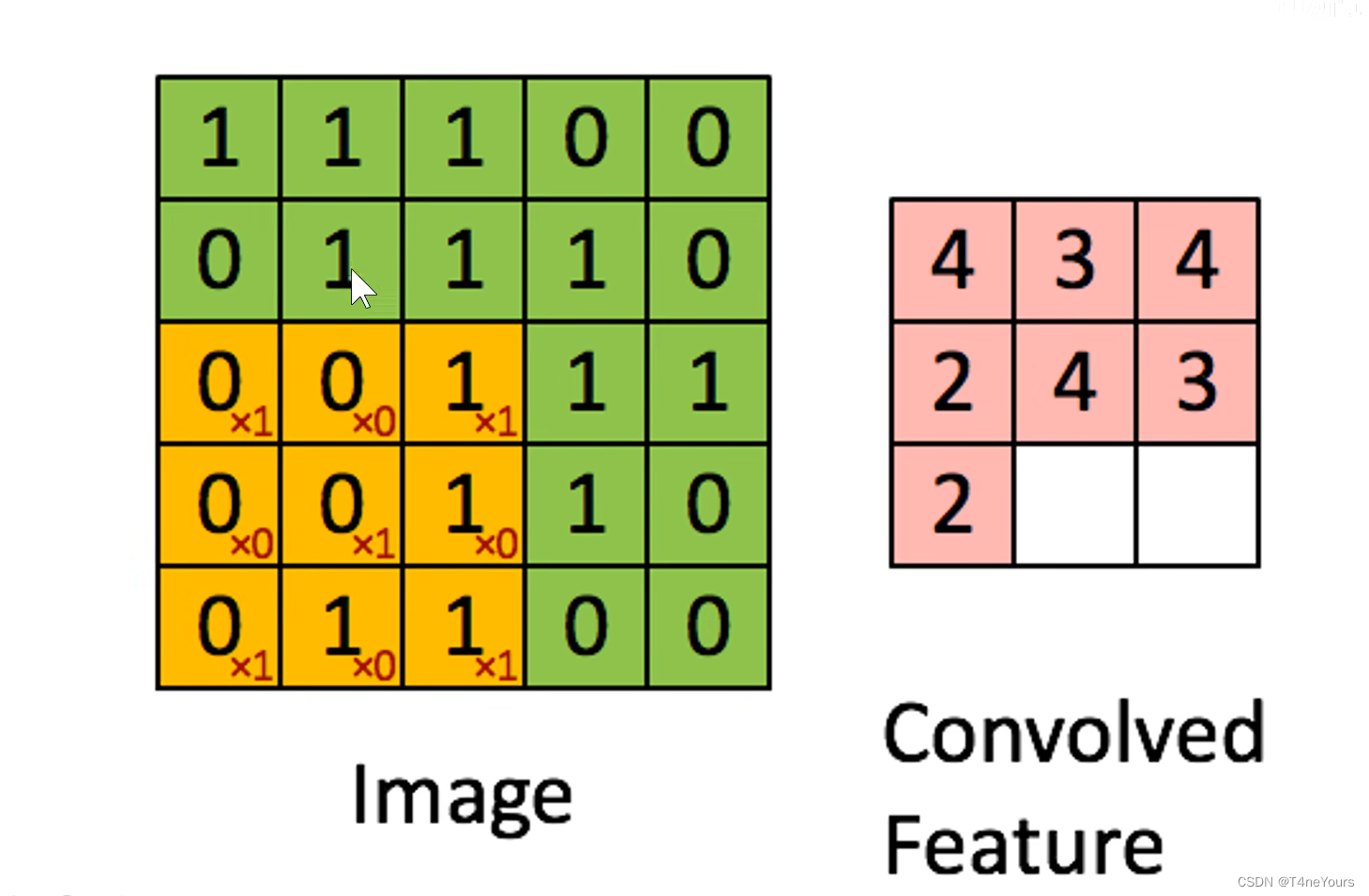

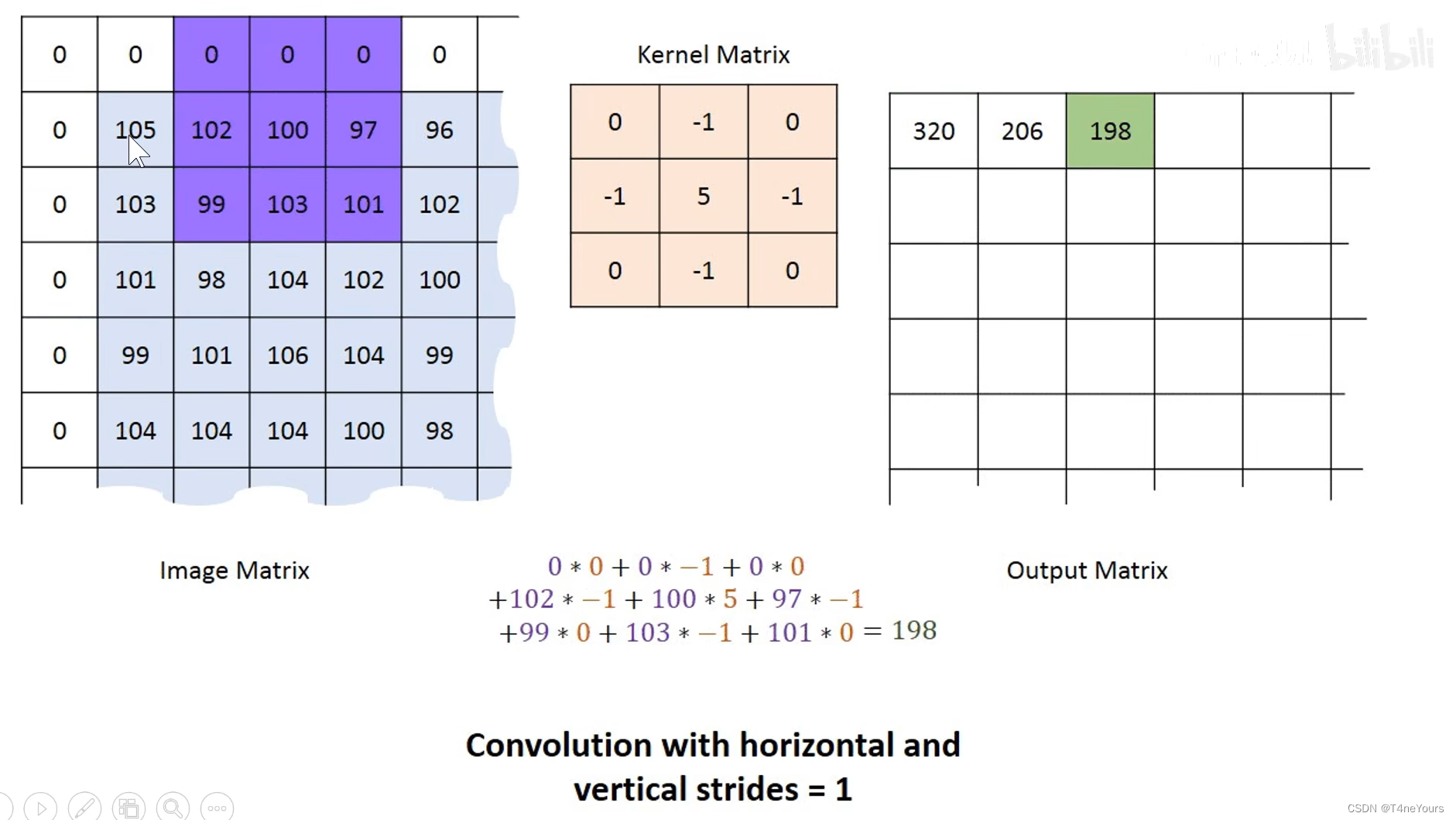

1.卷积操作

- 黄色部分:感受野

- 粉色部分: feature map ,其数量成为通道数( channel )

- 红色数字:卷积核(有多少卷积核就会生成多少 feature map)

- 横向、纵向步长:每次移动的格子数(一般横向、纵向步长相同)

- 由于上图中边缘的数参与了很少的计算,而中间的数参与了很多次的计算,这样是不公平的

- 所以我们引入了padding操作,在矩阵的周围补0(补0的圈数可以自己定),这样可以使得边缘值参与更多次的计算

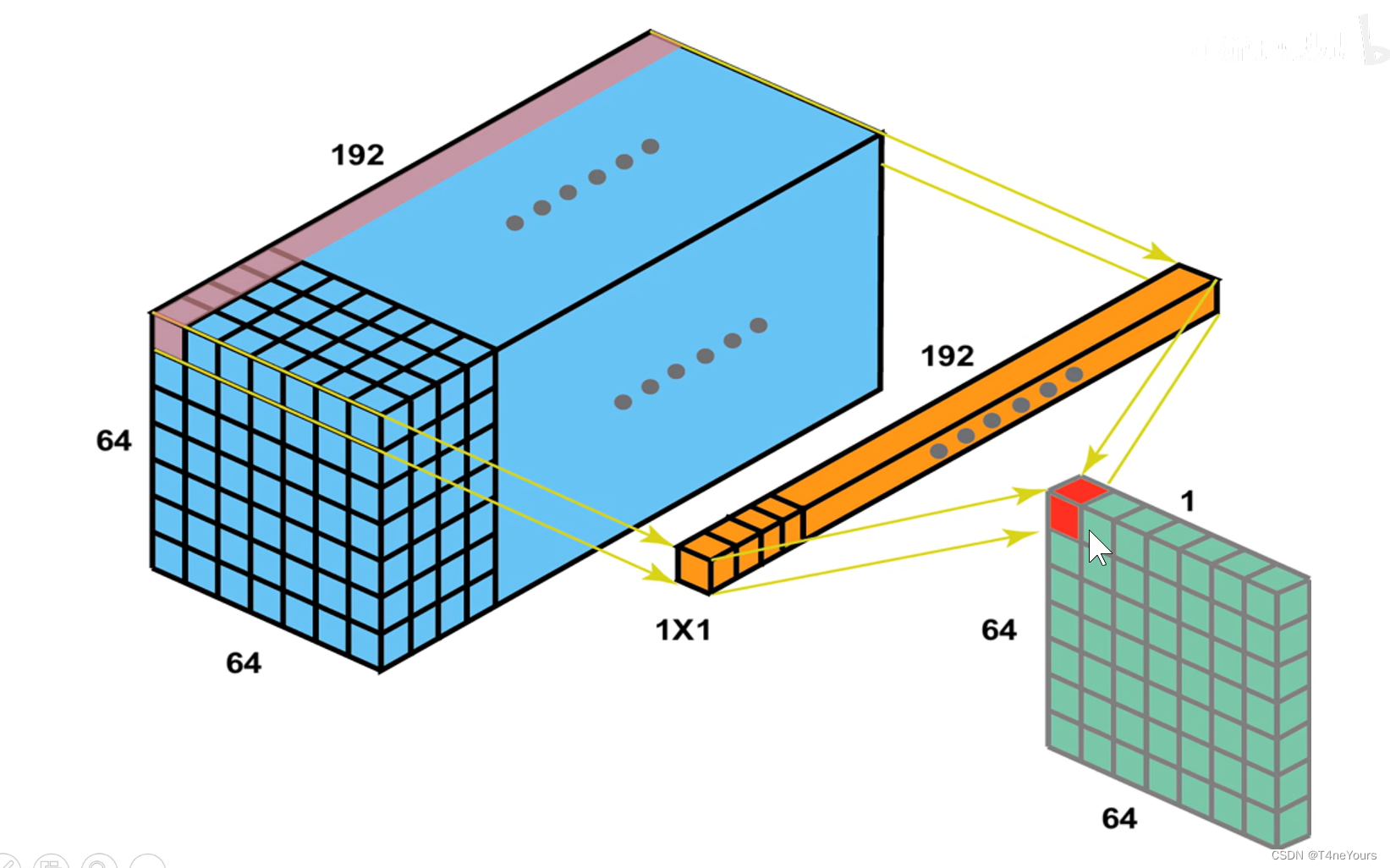

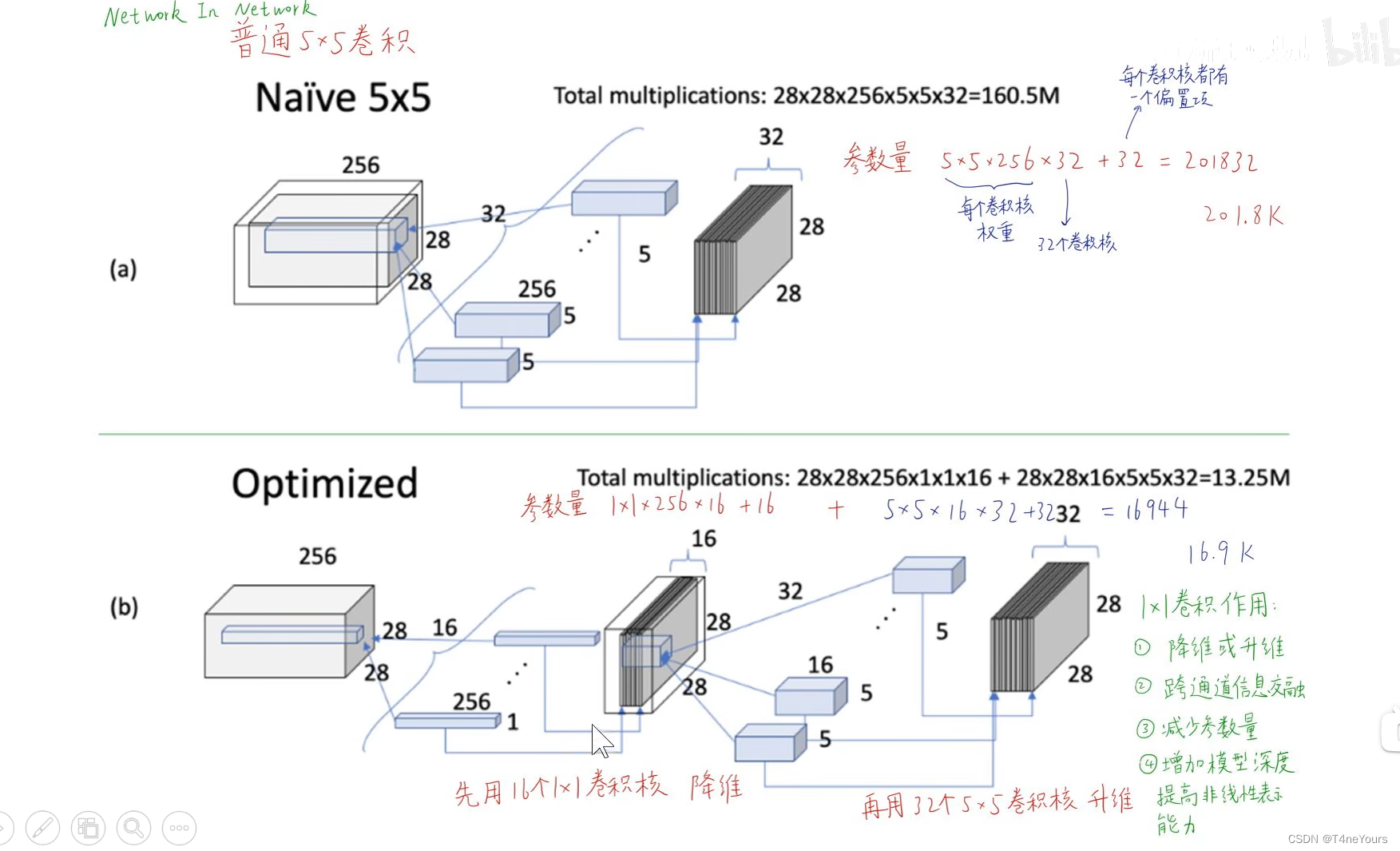

2. 1*1卷积核

- 工作原理

- 将所有通道同一位置的特征进行加权求和进行汇总

作用:

- 进行降维或者升维

- 跨通道的信息交融(把所有通道都放到了一个 channel 上)

- 减少参数量(对于边缘计算、移动设备,需要比较轻量化的计算)

- 增加模型深度,提高非线性表示能力

二、池化层

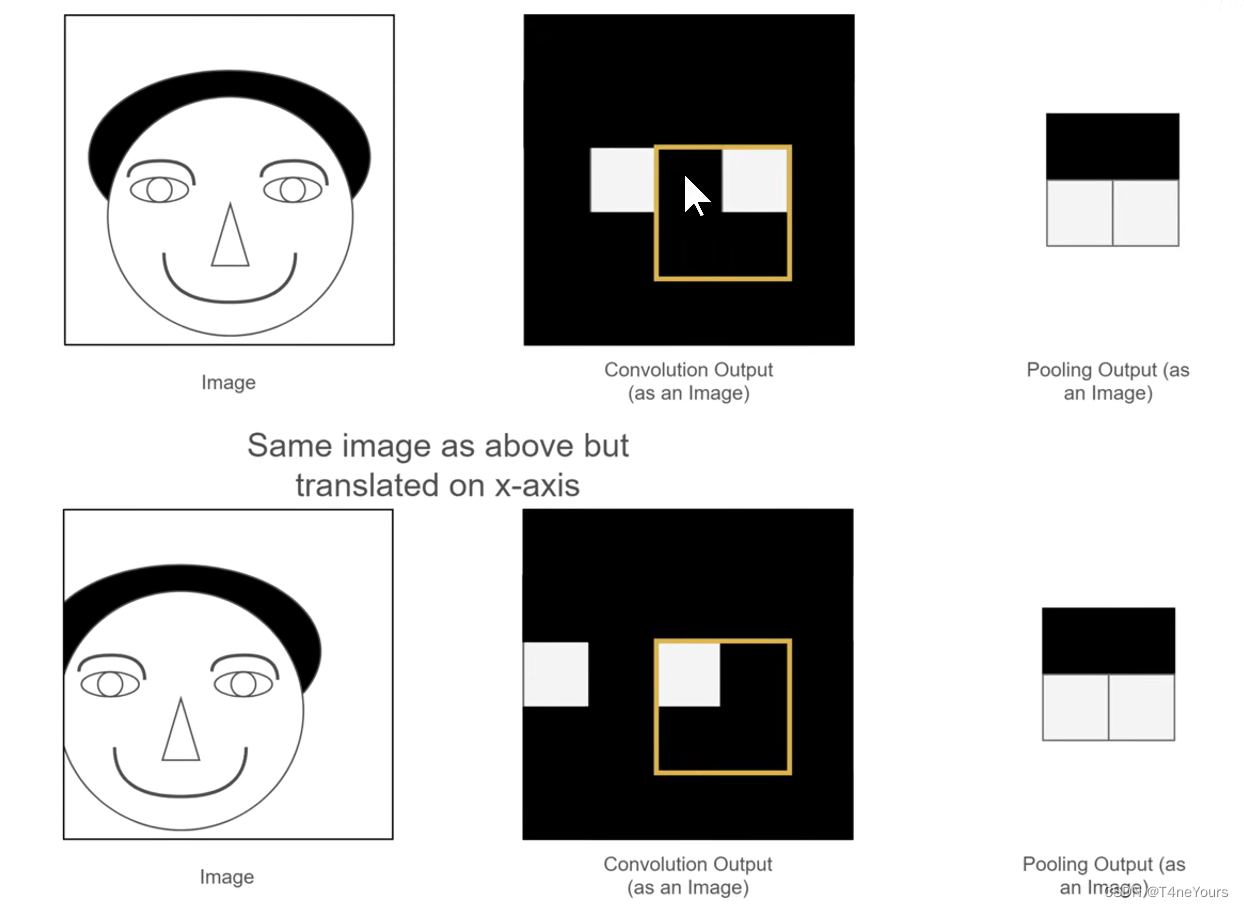

- 池化可以给卷积神经网络带来平移不变性(泛化)

- 缺点:丢失了空间信息

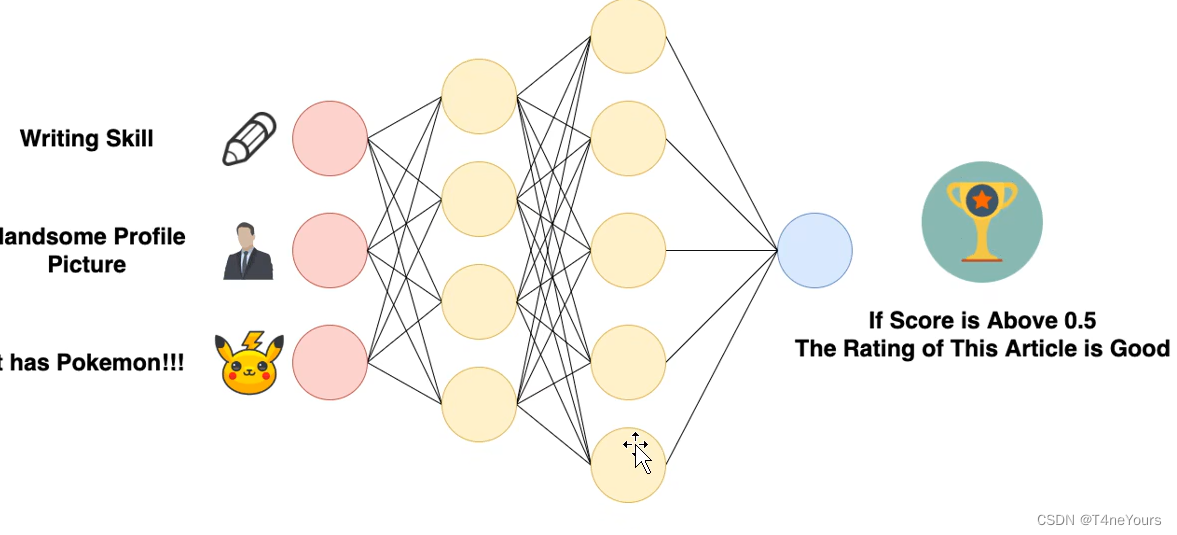

三、全连接层

- 把 feature map 拉长成一个长向量,用于模型的汇总

- 缺点:参数量非常大,且由于需要把 feature map 拉长成一个长向量,也丢失了空间信息

本文深入探讨了卷积神经网络的三个核心组成部分:卷积层、池化层和全连接层。卷积层通过卷积操作和padding实现特征提取;2.1*1卷积核用于降维、信息交融和减少参数量;池化层带来平移不变性但可能损失空间信息;全连接层则将特征映射展平,用于模型汇总,但也可能导致参数过多并丢失空间信息。

本文深入探讨了卷积神经网络的三个核心组成部分:卷积层、池化层和全连接层。卷积层通过卷积操作和padding实现特征提取;2.1*1卷积核用于降维、信息交融和减少参数量;池化层带来平移不变性但可能损失空间信息;全连接层则将特征映射展平,用于模型汇总,但也可能导致参数过多并丢失空间信息。

552

552

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?