导入单个表从RDBMS到HDFS。表中的每一行被视为HDFS的记录。所有记录都存储为文本文件的文本数据(或者Avro、sequence文件等二进制数据)

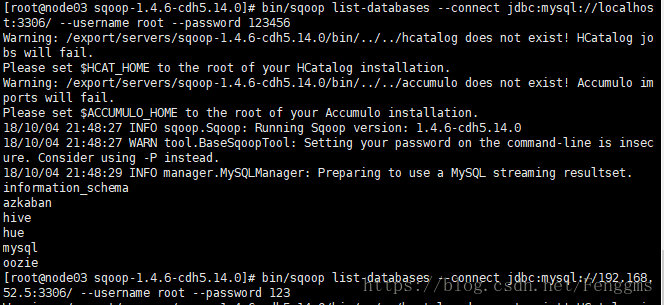

列举出所有的数据库

命令行查看帮助

bin/sqoop list-databases --help

列出本机(我这里直接安装在了node03,node03上有mysql数据库)主机所有的数据库

bin/sqoop list-databases --connect jdbc:mysql://172.16.43.67:3306/ --username root --password 123456

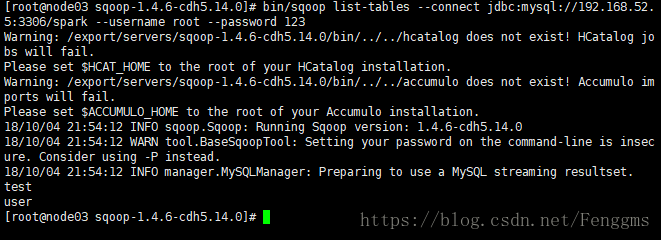

查看某一个数据库下面的所有数据表

bin/sqoop list-tables --connect jdbc:mysql://192.168.52.5:3306/spark --username root --password 123

导入数据库表数据到HDFS

下面的命令用于从MySQL数据库服务器中的emp表导入HDFS。

bin/sqoop import --connect jdbc:mysql://192.168.52.5:3306/userdb --password 123 --username root --table emp --m 1

验证在HDFS导入的数据,可以使用以下命令查看导入的数据

hdfs dfs -ls /user/root/emp

导入到HDFS指定目录

在导入表数据到HDFS使用Sqoop导入工具,我们可以指定目标目录。

使用参数 --target-dir来指定导出目的地,

使用参数—delete-target-dir来判断导出目录是否存在,如果存在就删掉

bin/sqoop import --connect jdbc:mysql://192.168.52.5:3306/userdb --username root --password 123 --delete-target-dir --table emp --target-dir /sqoop/emp --m 1

查看导入的数据(默认会用逗号(,)分隔emp_add表的数据和字段):

hdfs dfs -text /sqoop/emp/part-m-00000

导入到hdfs指定目录并指定字段之间的分隔符

bin/sqoop import --connect jdbc:mysql://192.168.33.48:3306/userdb --username root --password admin --delete-target-dir --table emp --target-dir /sqoop/emp2 --m 1 --fields-terminated-by '\t'

查看文件内容

hdfs dfs -text /sqoop/emp2/part-m-00000

导入关系表到HIVE

导包

需要将hive的一个叫做hive-exec-1.1.0-cdh5.14.0.jar的jar包拷贝到sqoop的lib目录下

cp /export/servers/hive-1.1.0-cdh5.14.0/lib/hive-exec-1.1.0-cdh5.14.0.jar /export/servers/sqoop-1.4.6-cdh5.14.0/lib/

准备hive数据库与表

将mysql当中的数据导入到hive表当中来,在hive中输入以下命令:

create database sqooptohive;

use sqooptohive;

create external table emp_hive(id int,name string,deg string,salary int ,dept string) row format delimited fields terminated by '\001';

开始导入

bin/sqoop import --connect jdbc:mysql://192.168.52.5:3306/userdb --username root --password 123 --table emp --fields-terminated-by '\001' --hive-import --hive-table sqooptohive.emp_hive --hive-overwrite --delete-target-dir --m 1

hive表数据查看

在hive客户端中执行以下命令:

select * from emp_hive;

导入关系表到hive并自动创建hive表

可以通过命令来将我们的mysql的表直接导入到hive表当中去

bin/sqoop import --connect jdbc:mysql://192.168.52.5:3306/userdb --username root --password 123 --table emp_conn --hive-import -m 1 --hive-database sqooptohive;

导入表数据子集

可以导入表的"where"子句的一个子集。它先执行数据库相应的查询,然后将结果导入存储在HDFS等目标目录。

bin/sqoop import \

--connect jdbc:mysql://192.168.52.5:3306/userdb \

--username root --password 123 --table emp_add \

--target-dir /sqoop/emp_add -m 1 --delete-target-dir \

--where "city = 'sec-bad'"

直接通过sql语句查找导入hdfs

可以通过 –query参数来指定我们的sql语句,通过sql语句来过滤我们的数据进行导入

bin/sqoop import \

--connect jdbc:mysql://192.168.33.48:3306/userdb --username root --password admin \

--delete-target-dir -m 1 \

--query 'select phno from emp_conn where 1=1 and $CONDITIONS' \

--target-dir /sqoop/emp_conn

增量导入

在工作中,数据的导入,很多时候都是只需要导入增量数据即可。

我们一般都是选用一些字段进行增量的导入,为了支持增量的导入,sqoop也给我们考虑到了这种情况并且支持增量的导入数据。

增量导入是仅导入新添加的表中的行。

它需要添加‘incremental’, ‘check-column’, 和 ‘last-value’选项来执行增量导入。

下面的语法用于Sqoop导入命令增量选项。

--incremental <mode>

--check-column <column name>

--last value <last check column value>

使用选项来实现增量导入

导入emp表当中id大于1200的所有数据

注意:增量导入的时候,一定不能加参数–delete-target-dir否则会报错

bin/sqoop import

–connect jdbc:mysql://192.168.52.5:3306/userdb

–username root

–password 123

–table emp

–incremental append

–check-column id

–last-value 1200

-m 1

–target-dir /sqoop/increment

通过–where条件来实现增量导入

使用–where来进行控制数据的选取会更加精准

bin/sqoop import \

--connect jdbc:mysql://192.168.52.5:3306/userdb \

--username root \

--password 123 \

--table emp \

--incremental append \

--where "create_time > '2018-09-20 00:00:00' and is_delete='1' and create_time < '2018-09-20 23:59:59'" \

--target-dir /sqoop/incement2 \

--check-column id \

--m 1

本文详细介绍如何使用Sqoop工具从RDBMS导入数据到HDFS及Hive,涵盖数据库列表查询、数据导入、增量导入等多种操作,适用于大数据场景下的数据迁移。

本文详细介绍如何使用Sqoop工具从RDBMS导入数据到HDFS及Hive,涵盖数据库列表查询、数据导入、增量导入等多种操作,适用于大数据场景下的数据迁移。

568

568

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?