一、背景说明

基于作者当前安全运维场景的瓶颈,需要借助AI能力来辅助安全运维工程师快速有效的判断故障问题及分析处置方案,因此,需要建立一套符合场景化的AI应用,用来满足当前运维需求。

二、使用组件

系统版本:centos7.5

Ollama:v0.5.11

开源的本地大语言模型运行框架,设计用于简化在本地运行大型语言模型的过程,降低使用门槛。

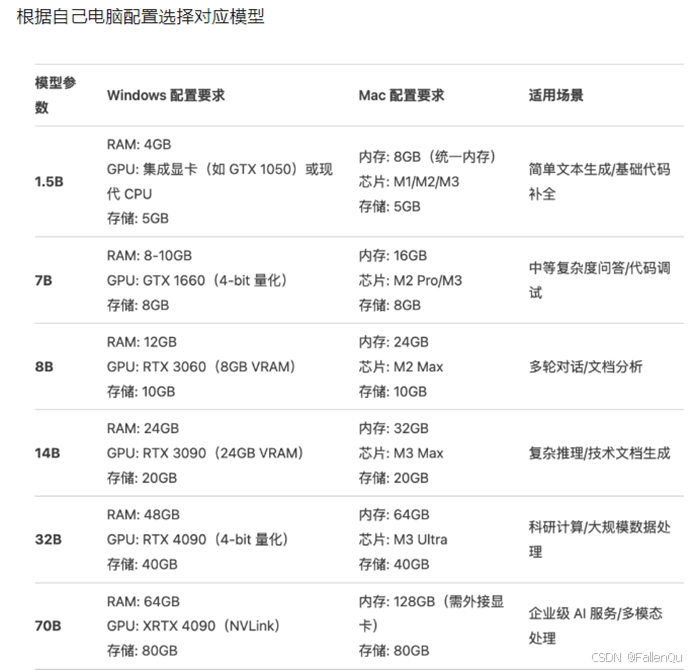

Deepseek:deepseek-R1:7b

一款由国内人工智能公司研发的大型语言模型

Cherrystudio:v0.9.24

聚合主流大语言模型服务的桌面工具,通过直观的可视化界面和远程API接口,实现了跨平台调用各类模型。

三、部署逻辑说明

在服务器中部署ollama、deepseekr1:7b,通过ollama部署工具,调用deepseek,达到运行大模型的目的;在此基础上通过cherrystudio调用deepseek的API接口,实现用户的接入。

四、Ollama+deepseek安装步骤

4.1、基础环境部署

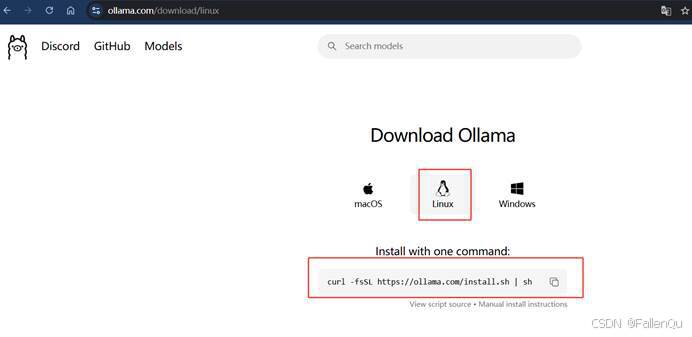

下载ollama客户端,因部署在服务器端,为稳定性考虑,建议下载Linux版本,直接复制一键命令

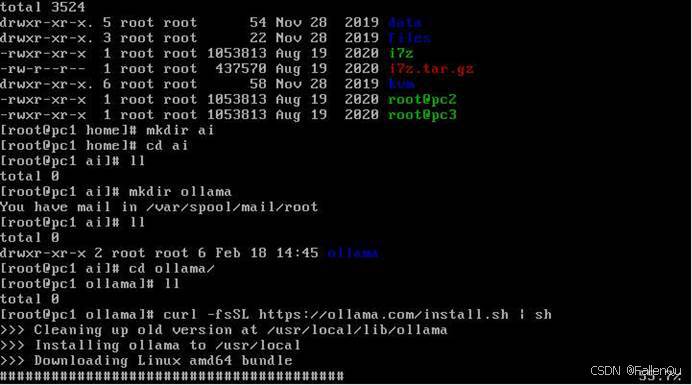

curl -fsSL https://ollama.com/install.sh | sh

在服务器本地执行一键安装命令,完成ollama的安装;

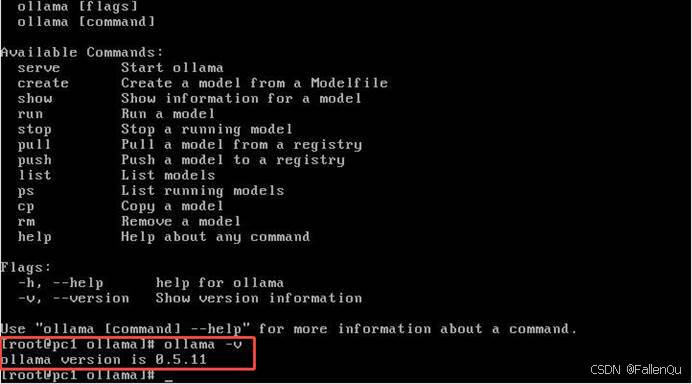

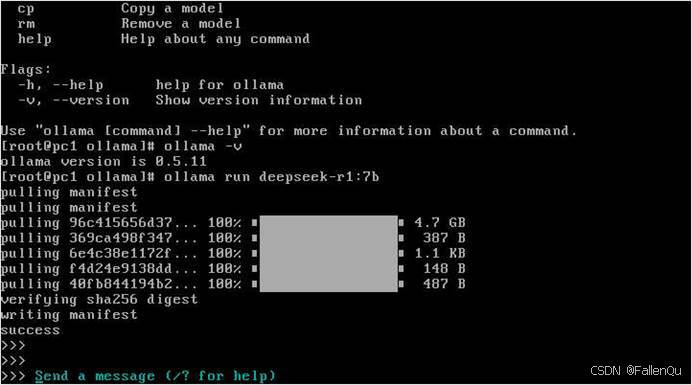

安装完成后执行命令ollama -v查看ollama版本,以确认是否正确安装

在ollama中执行命令安装deepseek本地化部署安装包,执行命令:

ollama run deepseek-r1:7b(此处会在下载到95%左右,速率下降至200K左右)

安装完成后,页面显示对话框;

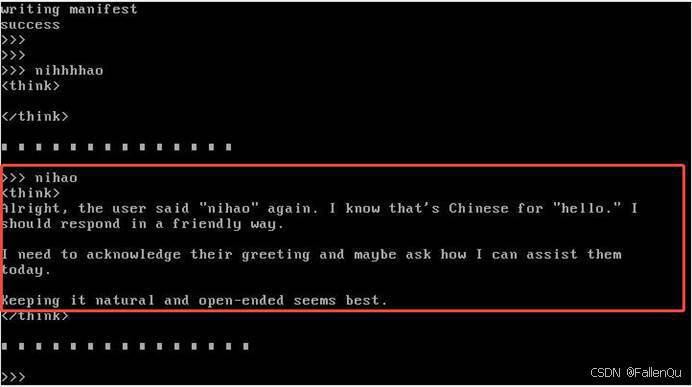

测试在对话框中输入问候语,确认DS是否有正常返回信息;

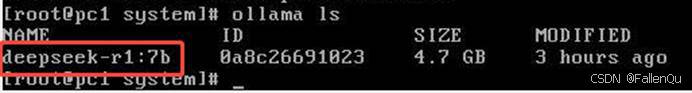

执行ollama ls查看已下载的模型,通过ollama run <NAME>运行对应模型,NAME字段后续再cherrystudio中需要用到。

到此,DS本地化部署完成,但仅限本地访问;

4.2、远程访问限制

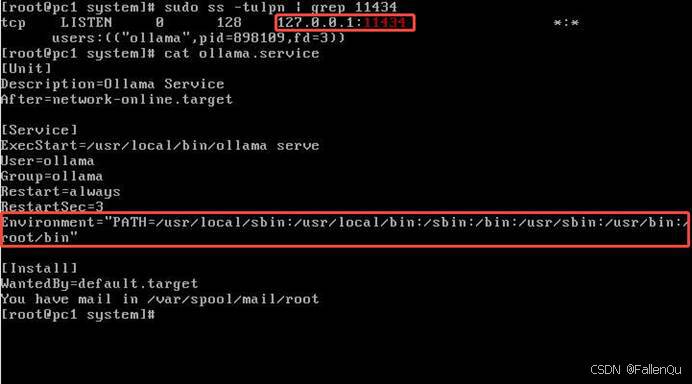

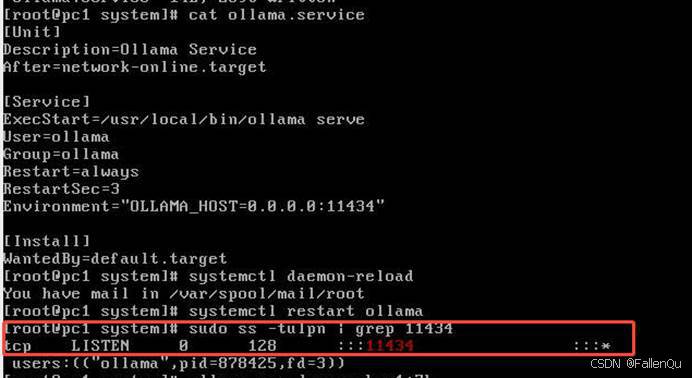

确认端口监听状态

sudo ss -tulpn | grep 11434

若显示 127.0.0.1:11434 则说明仅限本地访问

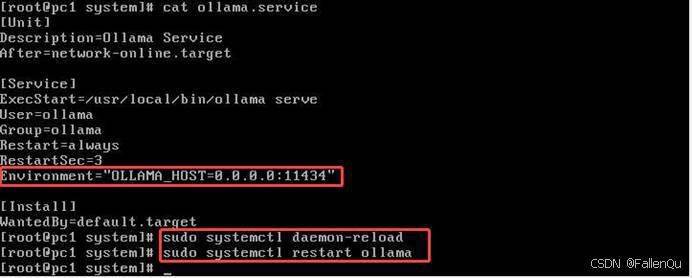

修改/etc/system/system/ollama.service文件,修改ollama监听地址为全部可以访问

修改完成后,执行

sudo syetemctl daemon-reload 重新加载ollama服务

sudo systemctl restart ollama 重新启动ollama

再次执行命令查看访问地址限制是否为全局

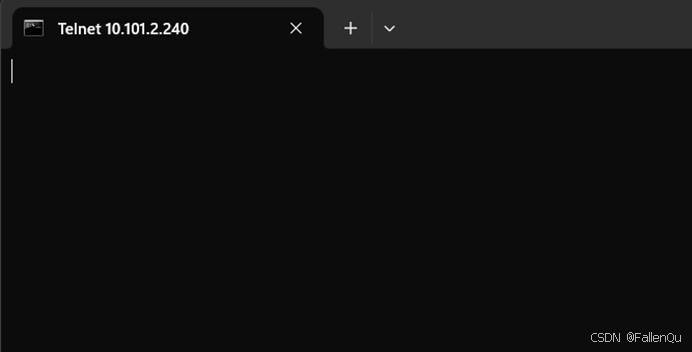

测试远程可通过telnet工具访问11434端口,至此ollama+deepseek已全部安装完成,可正常接入用户使用

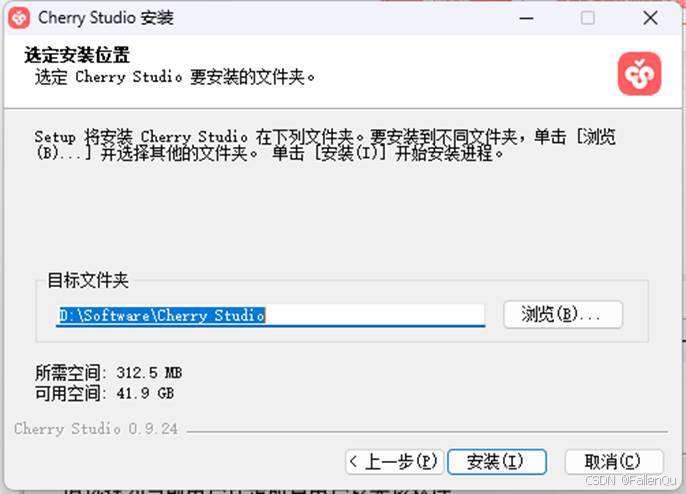

五、Cherrystudio安装步骤

下载cherrystudio工具:Cherry Studio - 全能的AI助手

一键安装即可

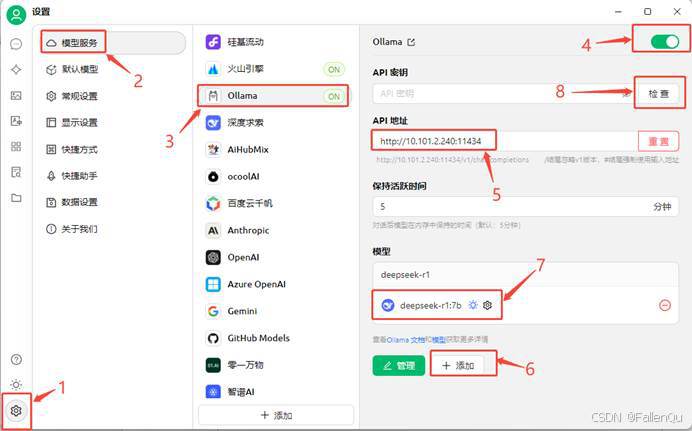

安装完成后,通过在设置-模型服务中,选择ollama模型,并进行相关配置;

步骤5:添加地址为服务器端的地址及DS使用端口

步骤7:模型ID为在ollama ls命令查看中显示的NAME字段内容

步骤8:配置完成后,通过检查工具,检查模型是否可用。

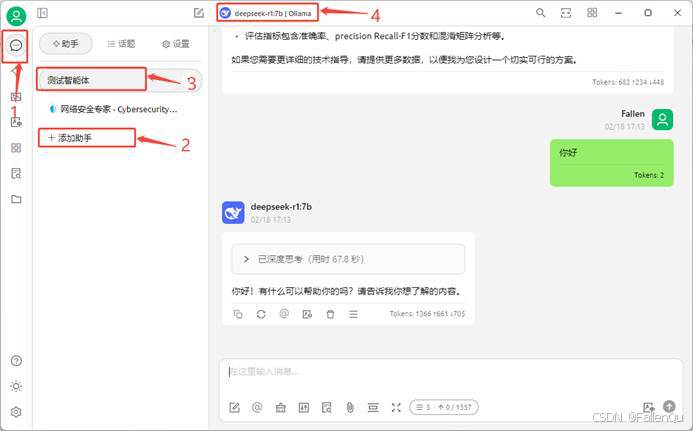

步骤4:添加模型时,需要选择对应模型名称,名称为在ollama ls命令查看中显示的NAME字段内容

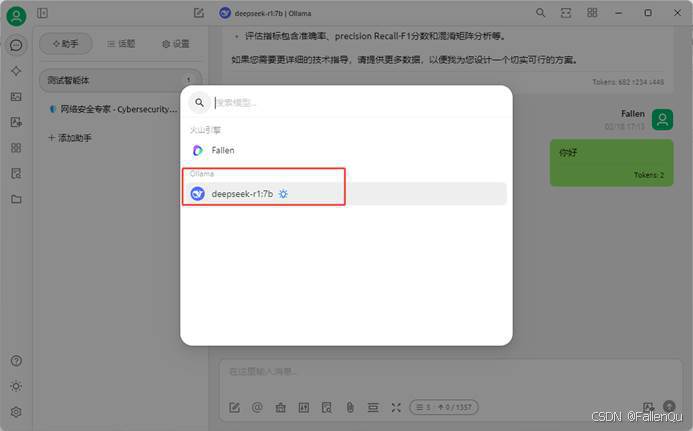

添加完成后,可正常与大模型进行对话。

1140

1140