这项工作由伊利诺伊大学香槟分校 (UIUC)、哈佛大学、哥伦比亚大学和麻省理工学院 (MIT) 的合作完成 。

- 论文标题:Multi-Modal Manipulation via Policy Consensus

- 论文链接:https://arxiv.org/pdf/2509.23468

- 主页链接:https://policyconsensus.github.io/

为什么特征拼接 (Feature Concatenation)会在机器人感知和决策中失效?

想象一下,你在黑漆漆的背包里找钥匙。你的眼睛此时毫无用处,全靠指尖的触觉,这对你来说轻而易举 ,但在机器人领域,这却是一个非常困难的问题。

残酷的真相: 目前的机器人学习主流的多传感器融合的算法(Feature Concatenation)在处理这种任务时彻底失败了。我们的实验数据显示,当你给机器人加上触觉数据试图让它更聪明时,它的抓取成功率竟然从 35% 暴跌至 5%!为什么? 因为传统的方法把偶尔出现的关键触觉信号当作了 “噪音” 直接过滤掉了。

当前方法的局限性

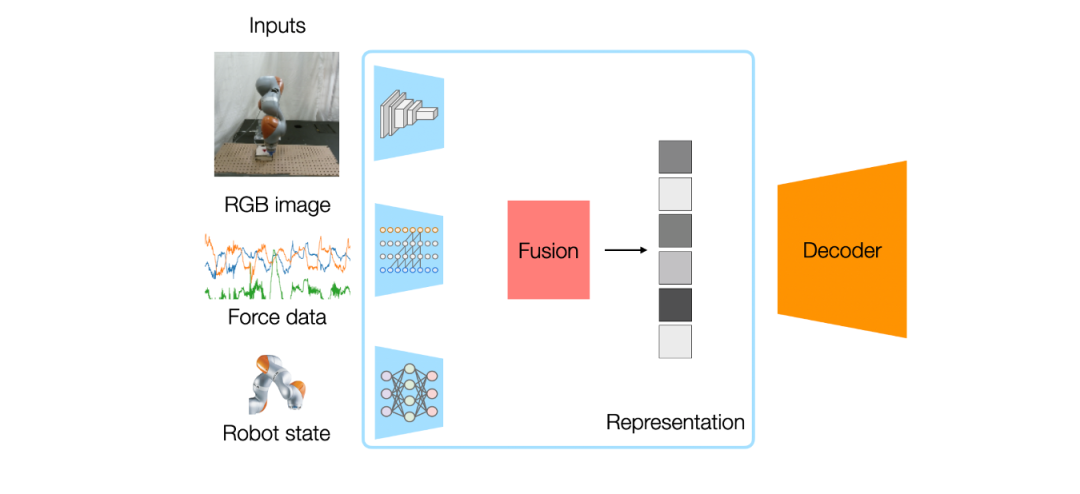

目前的多模态机器人学习方法通常使用特征拼接 (Feature Concatenation):提取所有传感器的嵌入 (embeddings),将其拼接成一个大向量,然后输入到一个单一的神经网络策略中 。

这种方法看似合理,但存在两个根本缺陷:

问题 1:稀疏模态被视为噪声

-

例如,一个机器人从不透明袋子中取记号笔的任务。90% 的过程中依靠视觉接近,但一旦进入袋子,视觉变得无用,触觉变得至关重要 。

-

特征拼接会将统计上罕见的信号(触觉)视为噪声。在训练中,网络会降低触觉信息的权重,专注于总是活跃的视觉特征 。

-

我们的实验结果:在遮挡抓取任务中,RGB + 触觉的拼接基线仅达到 5% 的成功率,而仅使用 RGB 却有 35%。增加触觉信息反而因其被视为干扰噪声而降低了性能!

问题 2:无法灵活添加或移除模态

- 特征拼接缺乏模块化。如果想添加新传感器或移除故障传感器,必须从头开始重新训练整个策略,因为所有模态在特征层面紧密耦合 。

- 这导致了昂贵的重训练成本,且系统在单个传感器故障时会发生灾难性故障 。

我们的解决方案:组合策略 (Compositional Policies)

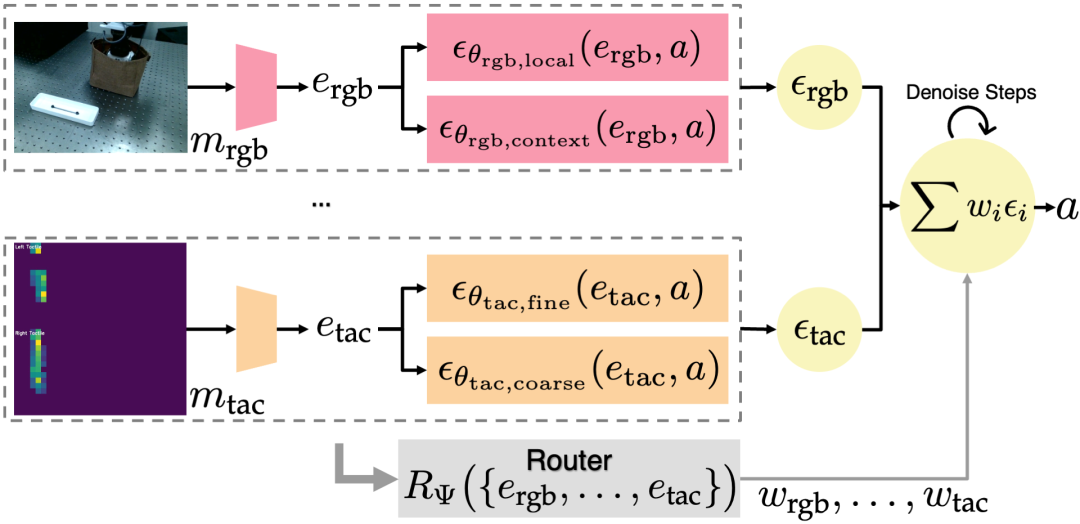

我们的解决方案是重新思考模态的结合方式。我们不将所有传感器强制输入单一网络,而是为每个模态训练单独的专家策略,并学习如何在策略层面组合它们的动作预测 。

工作原理

- 模态特定专家 (Modality-Specific Experts):为每个感官模态(RGB、触觉、点云等)训练作为扩散策略实例化的基于能量的策略表示 。每个专家专注于自己的感官流,互不干扰 。即使是 “稀疏” 模态(如触觉)也有自己的专用网络,使其能高度专注于接触动力学 。

- 模态内分解 (Intra-Modality Factorization):在模态内部进一步分解为互补的子策略。例如,视觉可分为粗略几何推理和细粒度细节;触觉可分为初始接触检测和持续力控制 。

- 学习共识权重 (Learn Consensus Weights):一个路由器网络 (Router) 学习预测共识权重,决定每个模态对最终动作的影响程度 。

组合式策略框架概述

为什么这能解决问题

解决稀疏性:每个专家学习自己的动作分布,互不干扰。触觉专家不再与视觉竞争表示模型的表征能力,从而在富含接触的操作中变得高度专业化。

模块化设计:专家是独立训练的。添加新传感器只需训练一个新的专家,并使用固定权重或快速微调将其与现有专家组合,无需重训练整个系统 。

简单的实现(implementation)方式:组合多个策略对应于概率分布相乘,在扩散模型(基于分数的能量模型)中,这等同于简单的分数函数相加 (summing score functions) 。

增量学习:即插即用的传感器

为了展示模块化,我们完全独立地训练了 RGB 和触觉策略,然后使用固定的相等权重将它们组合,没有进行任何联合训练。

- 尽管从未一起训练,组合后的策略成功完成了单独策略都无法处理的遮挡记号笔抓取任务 。这对于现实世界的部署(传感器逐步添加或更换)具有深远的意义 。

鲁棒性与自适应性

运行时扰动:在执行过程中突然抢走物体,机器人能适应并完成任务。

传感器损坏:遮挡一个摄像头模拟故障,路由器简单地将权重转移到剩余的功能传感器上,表现保持稳定。

物体重新定位:移动任务相关物体,策略能成功泛化。

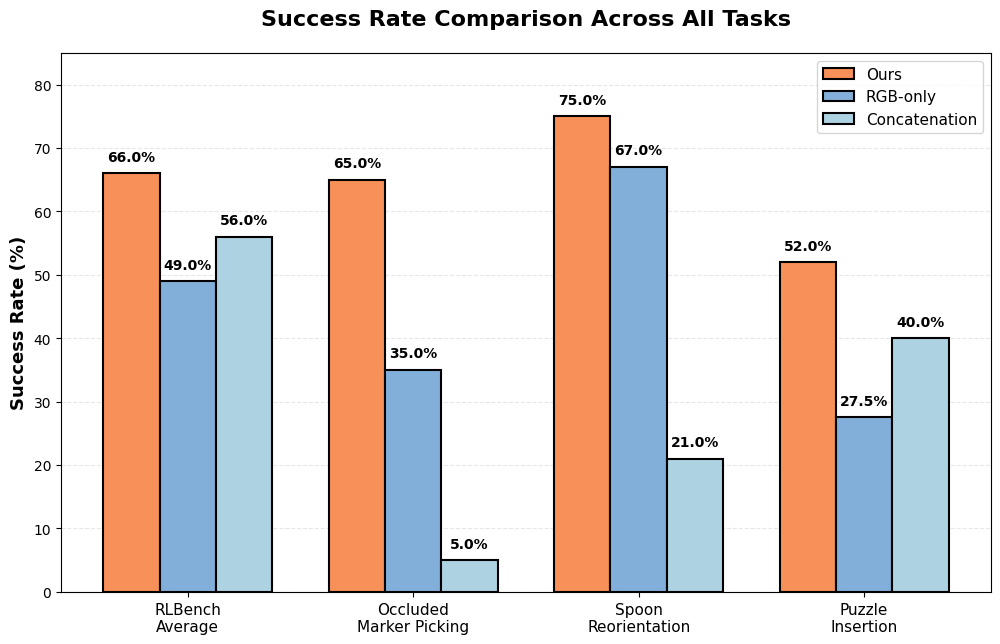

统计结果对比

我们使用了配备双 RealSense 摄像头和 FlexiTac 触觉传感器的 UR5e 机器人进行验证 。

RLBench 模拟任务:在四个操作任务上,我们的方法平均成功率为 66%,显著优于单模态策略 (49%) 和特征拼接 (56%) 。

真实世界:

- 遮挡记号笔抓取(occluded marker picking):我们的方法成功率为 65%,而 RGB-only 为 35%,拼接方法仅为 5%(拼接方法反而没法很好的利用触觉确定物体是否被抓住)。

- 勺子重定向 (Spoon Reorientation):一种灵巧的手内操作任务。我们的方法成功率为 75%,拼接方法仅为 21% 。

- 拼图插入 (Puzzle Insertion):需要毫米级精度。我们的方法任务成功率为 52%,拼接方法为 40% 。

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线科技企业深耕十二载,见证过太多因技术卡位而跃迁的案例。那些率先拥抱 AI 的同事,早已在效率与薪资上形成代际优势,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在大模型的学习中的很多困惑。我们整理出这套 AI 大模型突围资料包:

- ✅ 从零到一的 AI 学习路径图

- ✅ 大模型调优实战手册(附医疗/金融等大厂真实案例)

- ✅ 百度/阿里专家闭门录播课

- ✅ 大模型当下最新行业报告

- ✅ 真实大厂面试真题

- ✅ 2025 最新岗位需求图谱

所有资料 ⚡️ ,朋友们如果有需要 《AI大模型入门+进阶学习资源包》,下方扫码获取~

① 全套AI大模型应用开发视频教程

(包含提示工程、RAG、LangChain、Agent、模型微调与部署、DeepSeek等技术点)

② 大模型系统化学习路线

作为学习AI大模型技术的新手,方向至关重要。 正确的学习路线可以为你节省时间,少走弯路;方向不对,努力白费。这里我给大家准备了一份最科学最系统的学习成长路线图和学习规划,带你从零基础入门到精通!

③ 大模型学习书籍&文档

学习AI大模型离不开书籍文档,我精选了一系列大模型技术的书籍和学习文档(电子版),它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。

④ AI大模型最新行业报告

2025最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

⑤ 大模型项目实战&配套源码

学以致用,在项目实战中检验和巩固你所学到的知识,同时为你找工作就业和职业发展打下坚实的基础。

⑥ 大模型大厂面试真题

面试不仅是技术的较量,更需要充分的准备。在你已经掌握了大模型技术之后,就需要开始准备面试,我精心整理了一份大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

以上资料如何领取?

为什么大家都在学大模型?

最近科技巨头英特尔宣布裁员2万人,传统岗位不断缩减,但AI相关技术岗疯狂扩招,有3-5年经验,大厂薪资就能给到50K*20薪!

不出1年,“有AI项目经验”将成为投递简历的门槛。

风口之下,与其像“温水煮青蛙”一样坐等被行业淘汰,不如先人一步,掌握AI大模型原理+应用技术+项目实操经验,“顺风”翻盘!

这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

以上全套大模型资料如何领取?

RAG三问与多模态策略突破

RAG三问与多模态策略突破

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?