自己学习备忘,节选自(1条消息) 图文并茂的PCA教程_hustqb的博客-优快云博客_pca图

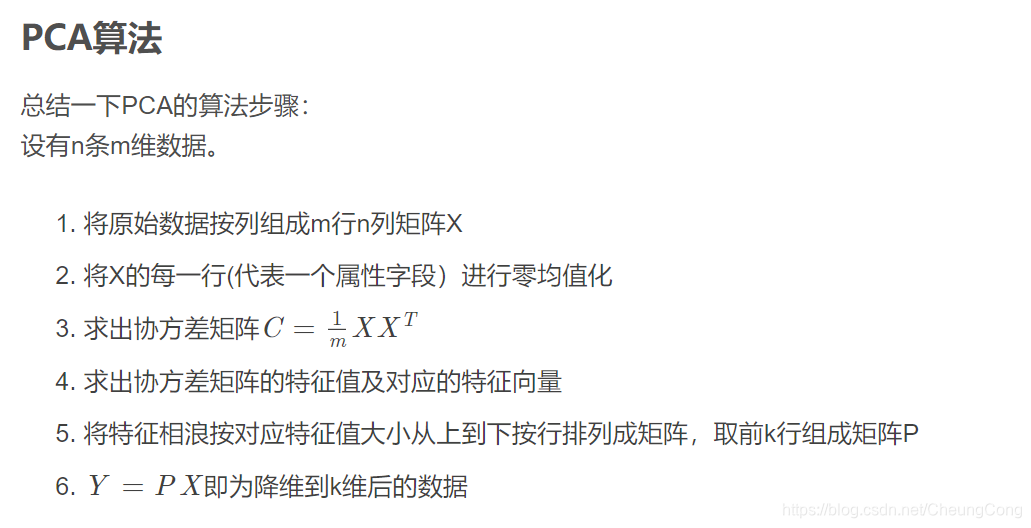

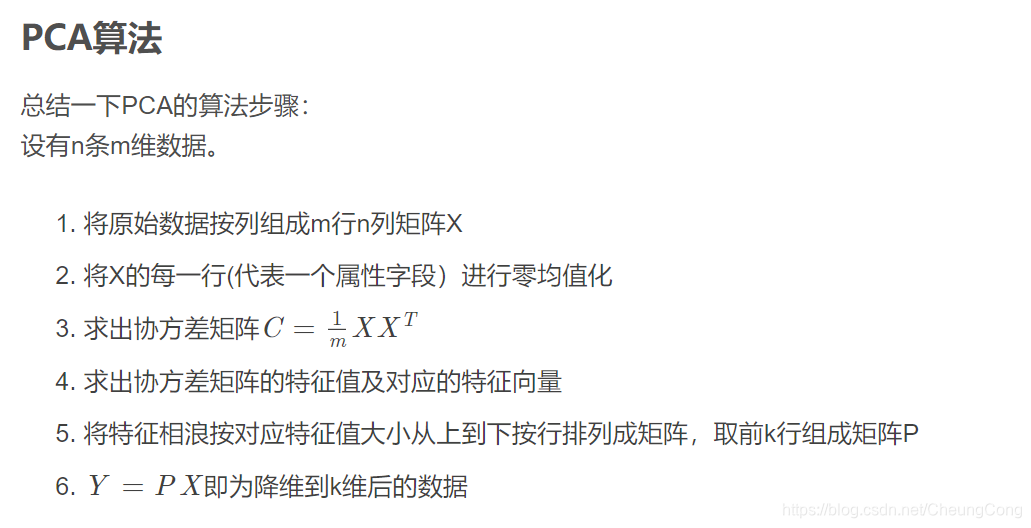

本文是PCA(主成分分析)的详细教程,通过图文并茂的方式深入浅出地介绍了PCA的基本原理和应用。从数据降维的角度出发,解释了PCA如何寻找数据的主要特征,并展示了PCA在实际数据分析中的实施步骤和效果。适合初学者和进阶者学习备忘。

本文是PCA(主成分分析)的详细教程,通过图文并茂的方式深入浅出地介绍了PCA的基本原理和应用。从数据降维的角度出发,解释了PCA如何寻找数据的主要特征,并展示了PCA在实际数据分析中的实施步骤和效果。适合初学者和进阶者学习备忘。

自己学习备忘,节选自(1条消息) 图文并茂的PCA教程_hustqb的博客-优快云博客_pca图

2308

2308

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?