点击下方卡片,关注“自动驾驶之心”公众号

>>自动驾驶前沿信息获取→自动驾驶之心知识星球

论文作者 | YuAn Wang等

编辑 | 自动驾驶之心

破解核心痛点:生成式重建中的几何一致性与创造性平衡

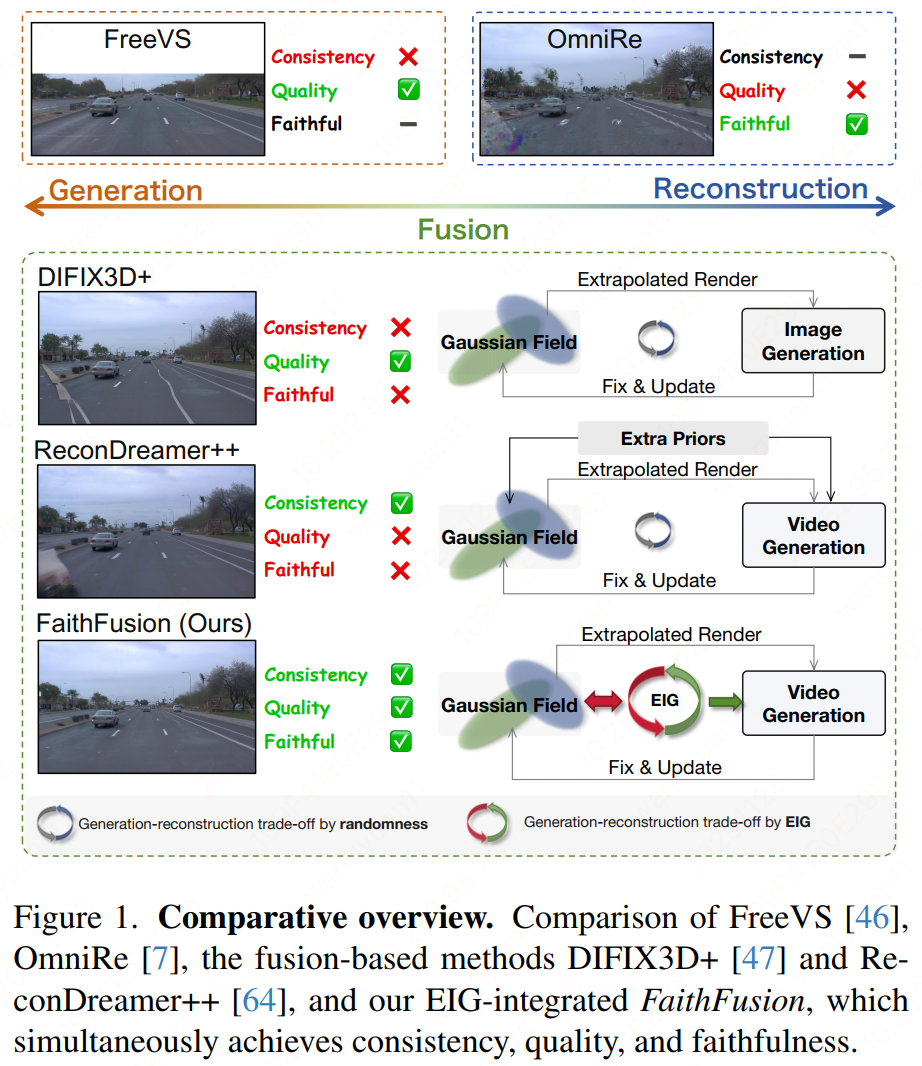

无论是物体级还是场景级三维任务,“重建” 与 “生成” 的融合始终面临核心矛盾:如何兼顾生成的创造性与多样性,同时保障几何重建对原始观测的保真度。在三维场景重建领域,3D 高斯泼溅(3DGS)的高保真几何能力与扩散模型(Diffusion)的外观生成能力结合,已是新视角合成的主流路径,但因缺乏像素级、3D 空间一致的编辑准则,常出现过修复(篡改可信区域)和几何漂移(未观测区域失真)问题。

为缓解这一矛盾,现有方法多采用 “外部约束” 范式:要么从生成侧引入 LiDAR、HDMap 等外部先验限制 Diffusion 自由度,要么改造 3DGS 重建侧强化保真。但这类方案依赖额外输入或定制化改造,既抬高落地成本,也限制了通用性。

FaithFusion 的核心突破的是跳出 “外部依赖”,从 3DGS 模型自身挖掘内在指导信号。其摒弃经验性启发式规则,引入像素级预期信息增益(EIG) 这一信息论指标作为融合策略 ——EIG 量化 “对 3DGS 像素进行 Diffusion 编辑后,能带来的几何 / 外观信息价值增量”,将人工经验决策转化为可计算的客观标准。

在框架中,EIG 扮演 “精准指挥家” 角色,通过双向加权闭环实现 “生成 / 保持” 精准决策:生成侧以 EIG 为空间先验,抑制低增益可信区域编辑、保留几何,同时引导 Diffusion 聚焦高增益缺陷区域进行创造性修复;重建侧将 EIG 作为像素级损失权重,降低低增益区域监督强度,让 3DGS 优先吸收高价值修复信息,避免被噪声干扰。这一策略不仅解决了 “保真 - 创造” 平衡问题,更让 FaithFusion 成为无需额外条件、即插即用的通用框架 —— 无需改造 3DGS 即可适配多维度任务,性能比肩甚至超越依赖外部先验的复杂方法,且在 Waymo 街景外扩任务中实现 SOTA 性能。

从更广视角看,FaithFusion 的思路可迁移至图像 / 视频修复、Text-to-3D/4D 等需 “保持观测稳定 + 引入生成能力” 的场景,尤其适用于三维目标不可见区域补全、场景迭代外扩等需求。目前其代码已完全开源,可直接适配各类三维任务。

论文名称: FaithFusion: Harmonizing Reconstruction and Generation via Pixel-wise Information Gain

论文地址: https://arxiv.org/abs/2511.21113

项目主页: https://shalfun.github.io/faithfusion

代码链接: https://github.com/wangyuanbiubiubiu/FaithFusion

FaithFusion的核心技术:EIG驱动的三阶段执行框架

FaithFusion 的关键突破在于将抽象的像素级预期信息增益(EIG)概念转化为可实际运行的技术架构——通过 EIGent 模块和渐进式训练循环,将信息论的理论指导转化为“精准修复、保真重建”的实际效果。

预期信息增益 (EIG):从理论到应用的三层递进推导

EIG 是整个框架的核心指导机制,其核心作用是精准评估每个像素的 3DGS 渲染可信度与修复必要性——本质上是量化“Diffusion 修复结果能为 3DGS 模型参数减少多少不确定性”,为“应该生成新内容还是保留原有信息”提供理论依据。整个推导过程严格遵循补充材料 A.3 的逻辑体系,通过三个关键步骤完成从理论到实际应用的闭环:

核心挑战:传统 EIG 依赖 GT 导致无法实际应用

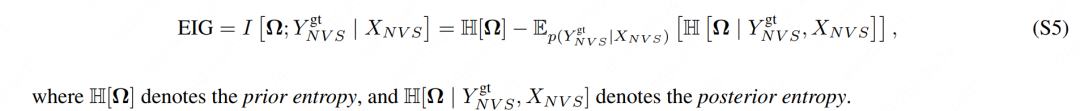

EIG 的本质是 3DGS 模型参数 Ω 与新观测数据(真实 GT 像素 )之间的互信息:

在原始定义中,EIG 的计算必须依赖真实观测数据(GT) 来衡量“新观测带来的不确定性降低程度”——但在新视角合成场景中,GT 数据是完全不可获取的(我们的目标正是生成这些未观测的视角)。这是我们需要解决的首要技术障碍。

第一步推导:GT 替代方案的构建

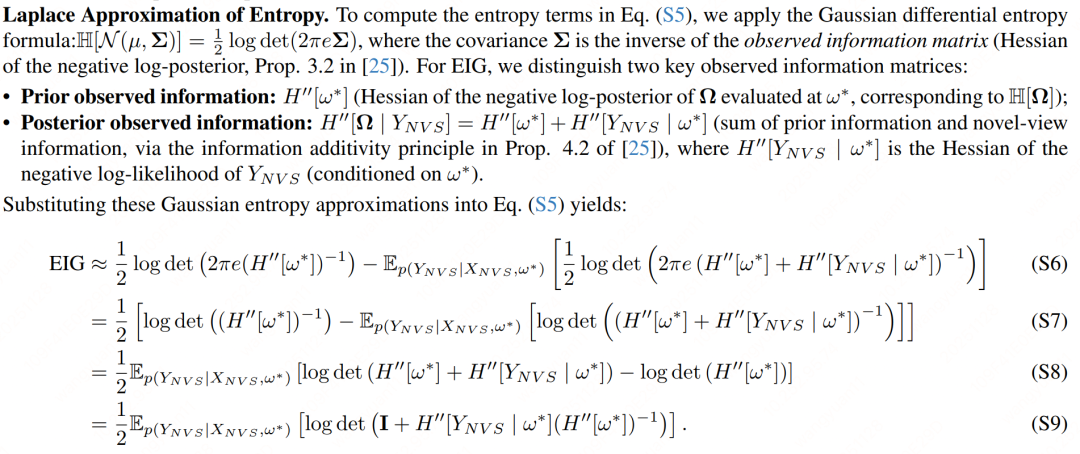

这是 FaithFusion 能够落地应用的核心前提!我们通过拉普拉斯近似方法,实现了从“依赖 GT”到“依赖 3DGS 渲染结果”的关键转变——首先将 3DGS 参数的后验分布建模为高斯分布 ,此时 3DGS 的渲染结果 成为参数的确定性函数;由于渲染结果与 GT 共享相同的参数依赖关系,其对应的 Fisher 信息可以等价地反映参数的不确定性,因此可以直接作为“真实观测 GT 的替代”;最终,EIG 的计算完全摆脱了对 GT 的依赖,仅通过 3DGS 自身的渲染结果和参数 Hessian 矩阵就能完成!

第二步推导:熵值的工程化近似

解决了 GT 依赖问题后,下一步是让计算变得可行!我们基于高斯后验分布的假设,代入高斯分布的微分熵公式 ,将抽象的熵值概念转化为可计算的矩阵行列式形式;同时清晰地区分了“先验观测信息”(对应参数的初始不确定性)和“后验观测信息”(融合修复后获得的新信息),最终得到简化后的 EIG 表达式,使复杂的不确定性计算变得在工程上可实现!

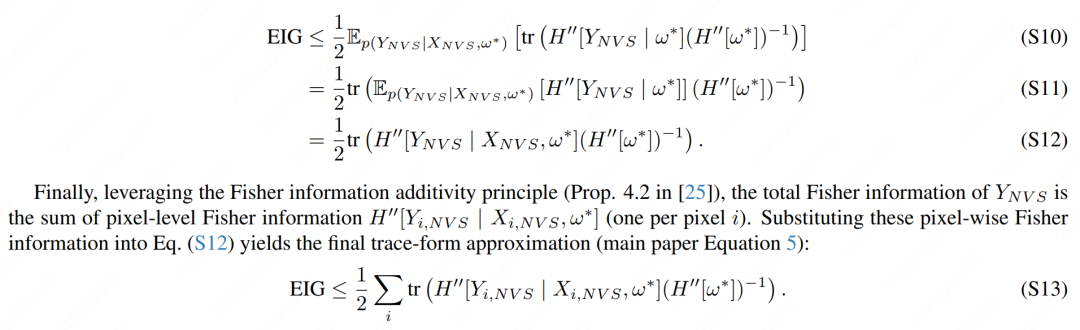

第三步推导:像素级计算的实现

这一步直接实现了“精准到像素”的指导机制!我们首先利用 log-det 不等式,将 EIG 近似为“参数协方差矩阵与观测 Fisher 信息矩阵乘积的迹”,大幅降低了计算复杂度;然后借助 Fisher 信息的可加性原理,将全局 EIG 分解为每个像素的局部贡献——沿着每条渲染光线累积 3D 高斯基元的 Fisher 信息,使每个像素的 EIG 值都能精准对应其在 3D 几何层面的不确定性,最终得到像素级的计算公式:

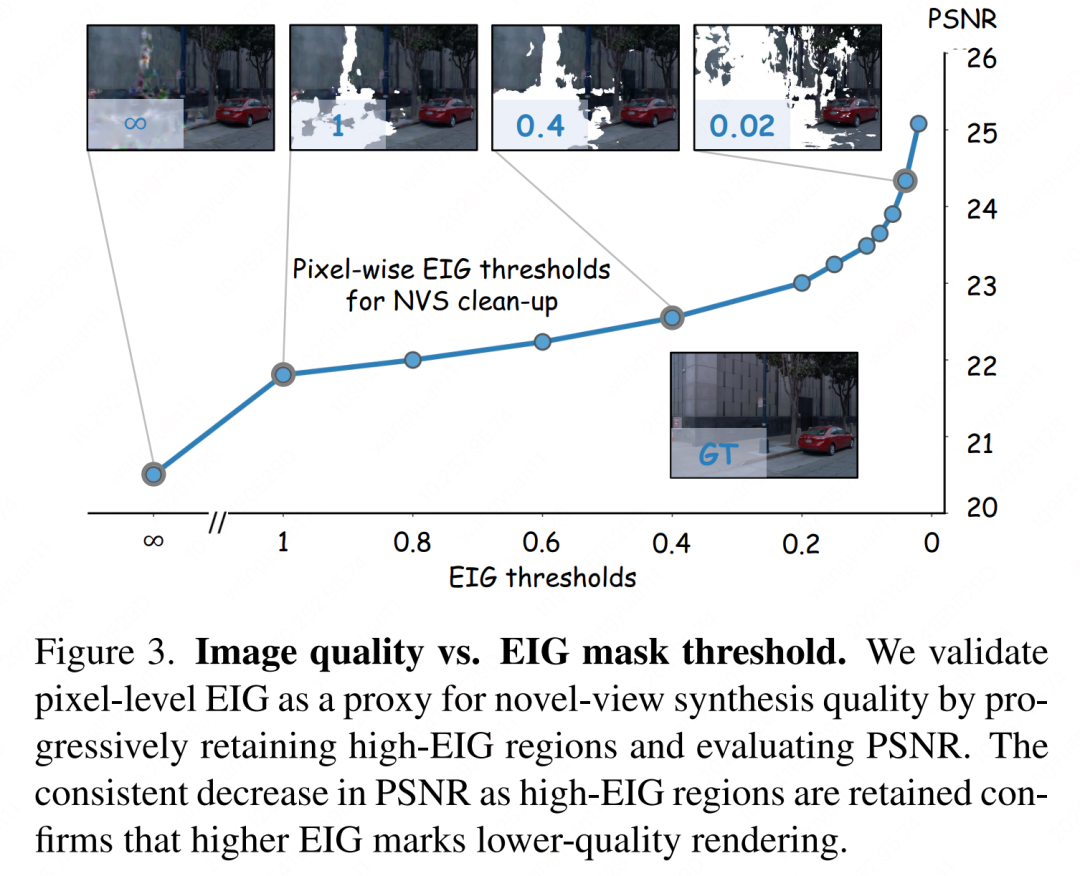

实验验证:EIG 替代方案与重建质量高度相关

理论分析再完善,实验验证才是最有力的证明!下图清晰地展示了:EIG 与新视角合成质量(PSNR)之间存在高度相关性,高 EIG 值对应着伪影、未观测区域等低质量区域,而低 EIG 值则对应着高置信度的清晰区域;当我们掩盖掉高 EIG 区域的像素后,图像质量得到了显著提升!这双重验证结果表明,我们提出的 EIG 替代方案完全有效,无需 GT 数据也能精准捕捉 3DGS 重建中的缺陷,成为“哪些区域需要修复、哪些区域应该保留”的智能决策依据!

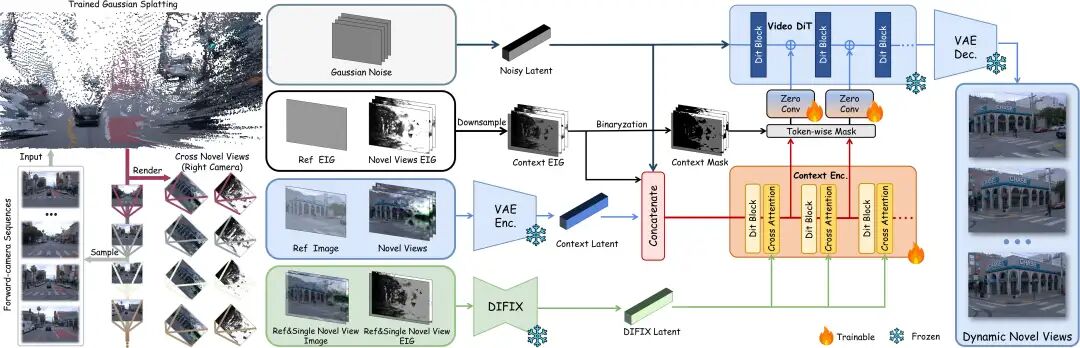

EIGent 模块:双分支智能修复引擎

EIGent 是实现 EIG 策略的“技术载体”,是一个专门为像素级引导设计的双分支神经网络架构。它不只是一个简单的修复工具,而是一个受 EIG 信号直接调控的“智能修复系统”,旨在充分利用 Video DiT 强大生成能力的同时,通过 EIG 信号精确界定生成边界,避免无意义的“凭空捏造”。

核心工作原理:输入 3DGS 渲染图像和对应的 EIG 图,动态生成编辑掩码 M——高 EIG 区域被标记为可编辑区域,低 EIG 区域则被标记为保护区域,从根本上杜绝了过修复问题;

EIGent 内部配备了一个轻量级的上下文编码器(Context Encoder)用于提取稳定的背景特征。EIG 图在此处被转化为二值掩码 M,用于隔离高不确定性区域,防止其影响稳定的背景上下文。这一设计确保模型仅在“真正需要修复”的区域发挥创造力,而在“信息可靠”的区域严格保持原有内容。

双分支结构设计:

为了弥补 Video DiT 在精细纹理生成上的不足,EIGent 引入了 DIFIX3D+ 提供的潜在特征作为辅助修复线索。这相当于为生成模型配备了一个“细节增强器”,确保生成的车道线、路面纹理等细微结构具有高度的真实感。

该分支采用预训练的 Video DiT 作为主干网络,负责处理高层语义信息和时空连贯性。它通过交叉注意力机制接收来自 Context 分支的特征输入,确保生成的内容在时间维度上平滑过渡,有效解决了传统单帧修复方法容易导致的画面闪烁问题。

粗粒度修复分支(Video DiT):确保连续帧之间的时空一致性,避免修复结果出现跳变;

细粒度增强分支(DIFIX3D+):提升单帧图像的感知质量,细化纹理细节;

技术优势:无需任何额外的先验信息,仅凭 EIG 替代信号就能实现精准的“修复/保留”决策。

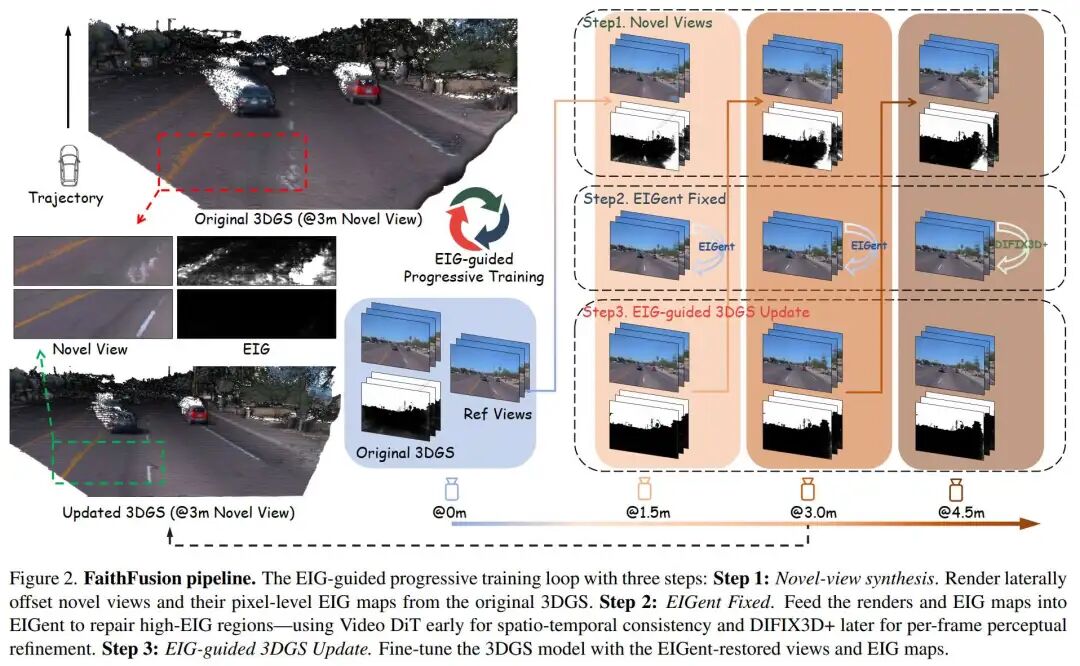

三阶段渐进式训练循环:安全的知识融合机制

如何将 EIGent 修复后的优质图像信息有效整合到 3DGS 模型中,同时确保不破坏已有的精确几何结构?FaithFusion 设计了一套创新的渐进式知识融合循环(Progressive Knowledge Integration),通过迭代优化过程,将 Diffusion 模型的修复能力“无几何漂移”地迁移到 3DGS 中。

新视角渲染与问题定位:从当前的 3DGS 模型中渲染出目标偏移视角(例如向左/向右偏移 3m/6m 的车道场景)的图像,并同步计算每个像素的 EIG 值。这一过程相当于对 3DGS 模型进行一次全面的“诊断扫描”,生成的 EIG 图就像一张“问题定位地图”,精确标记出哪些区域是“信息盲区”(高不确定性区域),哪些区域是“信息可靠区”(低不确定性区域)。

EIG引导的精准修复:将上一步得到的“渲染图像 + EIG 图”输入到 EIGent 模块中,EIGent 仅对高 EIG 区域进行针对性修复,输出与原始几何结构高度一致的修复图像(伪GT)。生成的修复图像既包含了 Diffusion 模型生成的合理细节,又严格保持了 3DGS 原有的几何投影关系,实现了修复内容与原始结构的精准对齐。

基于EIG的智能模型更新

这是防止几何漂移的关键环节。我们不采用直接用修复图监督 3DGS 的简单方式,而是引入了基于 EIG 的自适应加权损失函数:

(归一化 EIG 权重):这是智能更新的核心控制因子。

高 EIG 区域:分配较高的损失权重,促使 3DGS 模型优先学习 EIGent 生成的高质量修复信息,有效填补未观测区域的知识空白。

低 EIG 区域:分配极低的损失权重,防止 3DGS 模型“遗忘”已有的准确几何知识,同时避免 Diffusion 模型的微小噪声对可靠区域造成干扰。

为了进一步增强几何结构的稳定性,我们还引入了稀疏深度监督机制,最终的总损失函数为:

通过这种“渲染诊断 -> 精准修复 -> 智能更新”的闭环机制,FaithFusion 实现了生成能力向重建模型的无缝迁移,在每一次迭代中持续提升模型的几何稳定性和外观保真度。

SOTA 性能验证

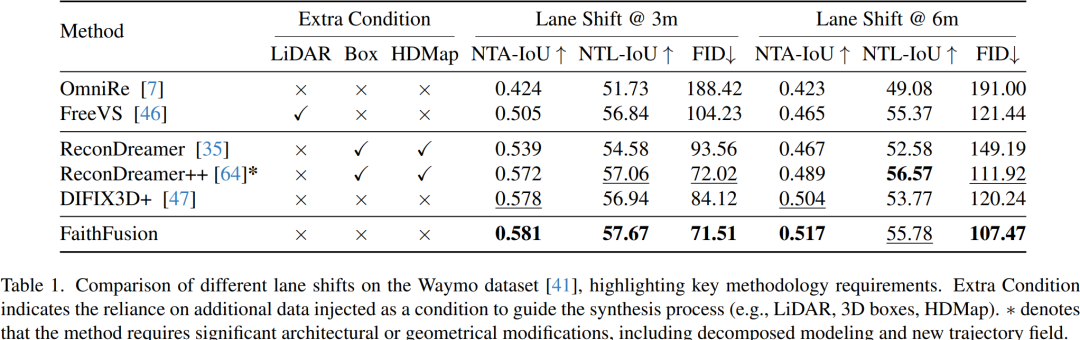

为了验证 FaithFusion 的硬实力,作者在 Waymo Open Dataset 上进行了严苛的测试,特别是在极具挑战性的 6米大偏移变道(Lane Shift @ 6m) 任务上进行了全面对比。

定量指标:实验对比了包括 OmniRe、FreeVS 以及最新的融合方法 ReconDreamer++、DIFIX3D+。如Table 1所示:

FID (图像质量):在 6m 偏移下,FaithFusion 的 FID 降至 107.47 ,比次优的 DIFIX3D+ (111.92) 和 ReconDreamer++ (115+) 都有显著下降。这说明生成的图像更逼真、伪影更少。

NTA-IoU (动态物体一致性) & NTL-IoU (车道线几何一致性):这两项指标分别达到了 0.517 和 55.78 ,均达到 SOTA 水平。这证明 FaithFusion 不仅“画得好看”,而且“位置画得准”,没有发生车辆漂移或车道线扭曲。

定性对比:在 6m 变道这种极端视角下,现有方法往往会出现严重的几何崩坏。从可视化结果可以看出:

ReconDreamer++ 等方法:出现了明显的地面弯曲(Ground Bending)、建筑物歪斜以及语义不一致(如路面莫名出现白色伪影)。

FaithFusion:引入 EIG 引导后,低质量的过修复被显著抑制;最终版本实现了全局的几何稳定性和纹理保真,能够生成清晰的车道线和正确的路沿结构,彻底解决了“由于生成而导致的几何漂移”问题 。

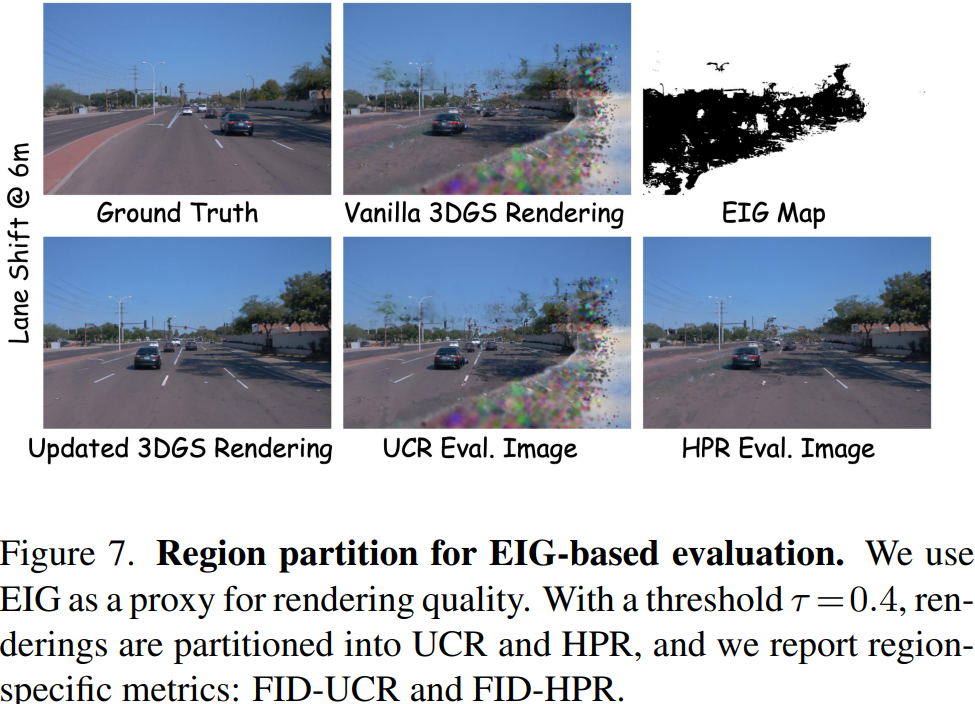

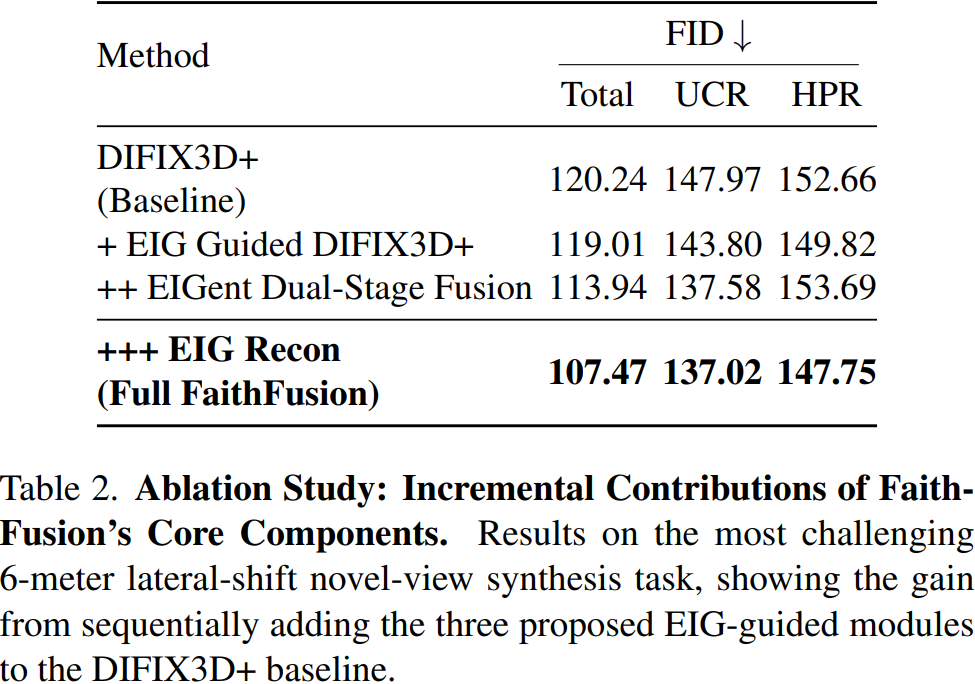

消融实验-EIG的'魔力':为了更精准地量化各组件的贡献,作者并未止步于全局指标,而是利用 EIG 将图像划分为 欠约束区域 (UCR) 和 高置信度区域 (HPR),引入了细粒度的 FID-UCR 和 FID-HPR 指标。

基于该评估标准,实验进一步证明,仅引入 EIG 引导(+EIG w/ DIFIX3D+)就能使 FID 下降约 1.23;而引入完整的 EIGent 双分支后,FID 进一步大幅下降 。这充分证明了 EIG 作为“信息论指挥棒”在平衡重建与生成中的核心作用。

可视化表现

口说无凭,直接看图。以下 GIF 展示了 FaithFusion 在 Waymo 场景下进行 3米 和 6米 虚拟变道的效果。注意观察画面边缘的未观测区域,FaithFusion 能够生成极其稳定的几何结构。

sample 005 Lane Shift @ 3m

sample 005 Lane Shift @ 6m

sample 018 Lane Shift @ 3m

sample 018 Lane Shift @ 6m

sample 027 Lane Shift @ 3m

sample 027 Lane Shift @ 6m

不同方法在 Lane Shift @ 6m结果对比

结论与展望

FaithFusion 提出了一种全新的视角——用信息论指标(EIG)来统一重建与生成。它证明了我们不需要堆砌昂贵的外部先验(LiDAR/HDMap),仅挖掘模型内部的不确定性,就能实现高质量的可控生成。

延伸思考:FaithFusion 的 EIG 打通了与主动建图的技术关联——二者核心都是 “基于信息增益的智能决策”!主动建图靠量化视角信息增益选最优观测,EIG 则聚焦像素级修复价值,同源同宗的逻辑让提效策略完全可迁移:比如借鉴 “视角选择” 做修复区域优先级排序,用 “信息增益阈值” 实现迭代智能终止,靠 “多视角协同” 提升全局一致性。这波跨领域联动,有望让渐进式修复从 “盲目迭代” 升级为 “精准高效”,进一步释放 EIG 的价值!

自动驾驶之心

自动驾驶之心星友面对面!

787

787

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?