点击下方卡片,关注“自动驾驶之心”公众号

>>自动驾驶前沿信息获取→自动驾驶之心知识星球

论文作者 | Tianyi Yan等

编辑 | 自动驾驶之心

世界模型,这个近期让业内又爱又恨的词。它的能力有很多,可以生成数据、可以预训练、可以闭环仿真也可以预测自车轨迹。

十月份中科院和华为引望提出的的DriveVLA-W0,VLA+WM利用7000万数据,通过世界建模的方式预测未来图像,生成密集的自监督信号,促使模型学习驾驶环境的底层动态规律。这个方法验证了自动驾驶模型的data scaling law,一时间引起业内的热情讨论。

纵观最近业内一些公司透露的信息,小米利用世界模型做数据生成和闭环仿真,蔚来和华为宣传基于世界模型量产,理想在ICCV提出「从数据闭环走向训练闭环」。闭环训练这一环现在可以补上了,今天自动驾驶之心分享的这篇工作便是澳门大学联合理想汽车等团队共同提出的AD-R1 - 基于世界模型的闭环端到端强化学习算法。

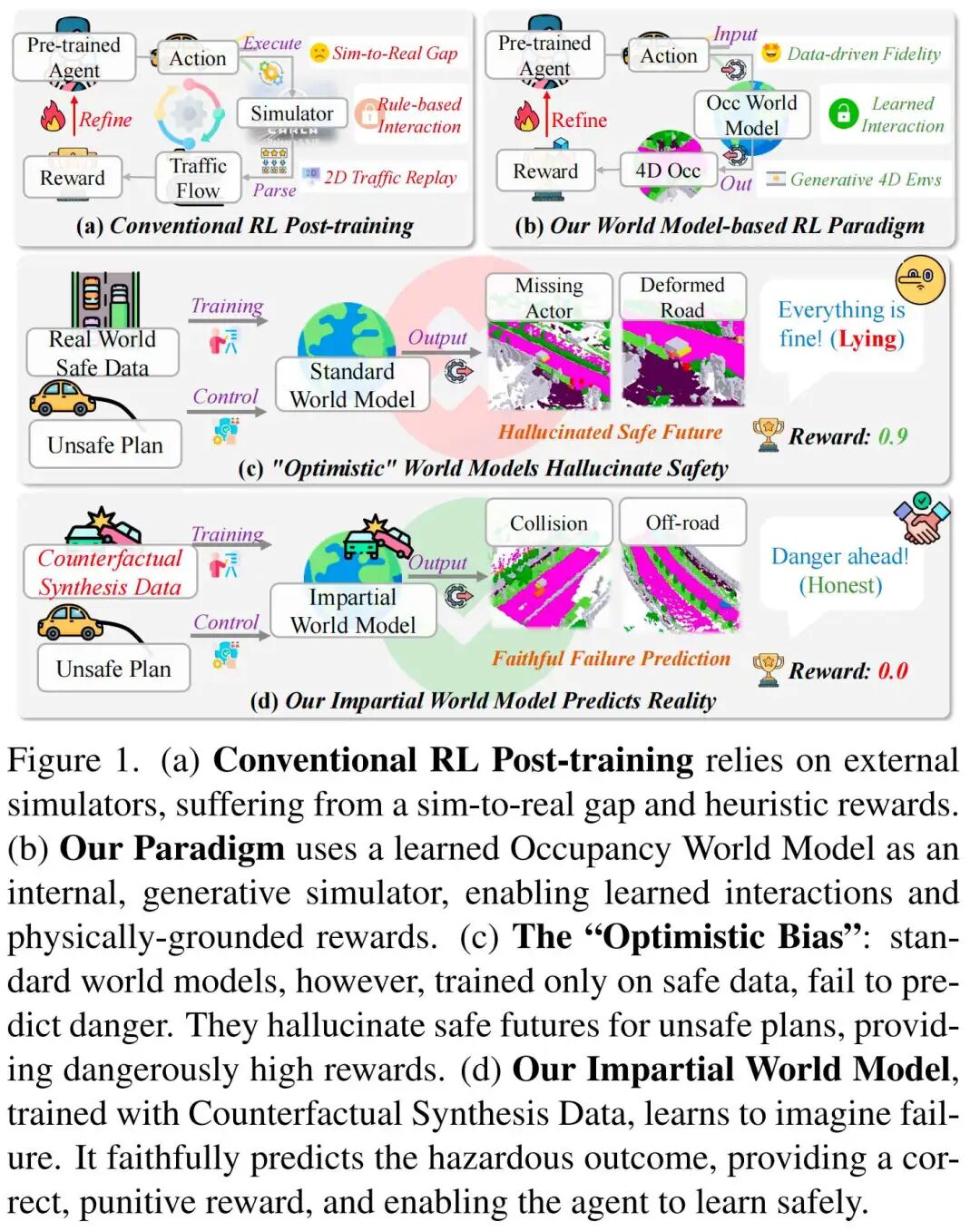

AD-R1发现了一个很大的问题:强化学习所利用的世界模型中存在根深蒂固的“乐观偏差”。这类模型仅基于安全的专家数据训练,无法预测错误行为的后果。当以不安全轨迹为输入时,它们会幻想出不切实际的安全未来——障碍物消失、道路被忽视——而非预测即将发生的故障。这种“无法想象失败”的特性使其难以成为学习稳健驾驶策略的可靠评估器。

为解决这一问题,澳门大学联合理想汽车等团队提出了一种基于公正世界模型(Impartial World Model)的后训练策略优化框架。核心贡献在于让模型能够如实呈现危险。AD-R1通过一种新颖的数据合成流水线——反事实合成实现这一目标,该流水线系统地生成包含合理碰撞和偏离车道事件的丰富训练样本库。这一转变使模型从被动的场景补全器升级为可靠的预测器,能够严格遵循行为与结果之间的因果联系。随后将该公正世界模型集成到闭环强化学习框架中,使其担任内部评估器的角色。在优化过程中,智能体通过查询评估器“预想”候选行为的结果。通过大量实验(包括在全新的风险预测基准(Risk Foreseeing Benchmark)上的测试),我们证明所提模型在故障预测方面显著优于基线模型。因此,当其作为评估器使用时,能够在复杂仿真场景中大幅减少安全违规事件,这表明教会模型“预想危险”是构建真正安全、智能的自动驾驶智能体的关键一步。

论文标题:AD-R1: Closed-Loop Reinforcement Learning for End-to-End Autonomous Driving with Impartial World Models

论文链接:https://arxiv.org/abs/2511.20325

自动驾驶之心最近也邀请到学术界和工业界大佬畅谈世界模型和VLA的路线之争,更多技术干货欢迎加入自动驾驶之心知识星球!

一、背景回顾

端到端自动驾驶近年来彻底改变了该领域,但通过模仿学习(IL)训练的策略在实际部署中仍面临重大挑战,例如因分布偏移导致的长尾事件故障。因此,该领域正日益转向通过主动环境交互实现的闭环强化学习,以提升智能体的决策能力。

然而,将强化学习有效应用于自动驾驶的道路充满挑战,其规模化成功仍遥不可及。一个根本障碍源于强化学习智能体的训练环境。传统方法必须依赖外部仿真器,而这些仿真器存在自身局限:图形引擎固有的仿真到现实差距、交通流仿真器缺乏交互性和3D几何感知能力。这些长期存在的问题构成了主要瓶颈,限制了强化学习训练策略在现实世界中的迁移性和有效性,亟需一种范式革新。

受近期生成模型显著成功的启发,我们探索了一种替代方案:学习3D/4D世界模型作为高保真的生成式仿真器。该范式的核心在于模型能够回答关键问题——“如果我采取此行为,会发生什么?”——通过生成整体未来场景,明确建模自车、3D/4D环境与其他智能体之间的动态交互。

尽管这种生成式方法前景广阔,但我们的研究发现这些最先进模型中存在一种系统性且危险的缺陷,我们称之为“乐观偏差”(图1(c))。当以不安全轨迹为输入时,这些模型拒绝预测必然发生的故障,反而会幻想出不切实际的安全未来。例如,对于朝向行人的轨迹,模型不会预测碰撞,反而可能显示行人完全消失;同样,若指令车辆开上草坪,模型可能预测草地神奇地变为沥青路面。这一现象揭示了因果保真度的根本性缺失——模型主动虚构安全结果,而非预测输入指令对应的危险后果。这使其成为策略学习中极不可靠的评估器。我们通过提出的风险预测基准(RFB)对这种偏差进行了系统性量化。

为此,我们引入了一种即插即用的闭环强化学习框架AD-R1,以提升任何驾驶智能体的安全性。该框架的核心是一个内部评估器,更准确地说是一个高保真仿真引擎,由专门设计的公正世界模型提供支持。该引擎接收智能体的规划轨迹作为输入,在高保真仿真中“预想”其未来后果,并提供密集的、安全关键的反馈。这使智能体能够在安全的离线环境中从大量想象的错误中学习,有效优化策略以规避潜在故障。

然而,该框架的成功依赖于能够如实呈现危险的世界模型。因此,我们的核心技术贡献是构建公正世界模型(IWM),该模型经过训练,能够真实反映安全与不安全行为的结果。我们通过反事实合成(Counterfactual Synthesis)从根源上解决乐观偏差,从而构建公正世界模型。该数据流水线将现实世界驾驶日志视为可编辑场景,通过编程生成包含物理一致性和因果保真度的自车轨迹库,涵盖各类合理故障。为进一步强化因果保真度,我们引入了模型层面的优化机制,包括轨迹感知门控模块(Trajectory-Aware Gating)和自车轨迹保真度损失(Ego-Trajectory Fidelity Loss),确保模型预测始终忠实于指令轨迹——即使该轨迹会导致危险后果。

由此产生的公正世界模型随后被集成作为强化学习评估器的核心。其逼真模拟负面结果的能力,为奖励建模带来了更高的颗粒度和物理接地性。我们不再依赖简单的启发式规则,而是直接从预测的4D占用率中构建精确、多维度的奖励信号。这使我们不仅能严厉惩罚碰撞、偏离车道等明显故障,还能约束诸如违反时空缓冲区、忽视垂直净空限制等细微的不安全行为,为策略优化提供丰富且可靠的信号。

本文的主要贡献如下:

提出AD-R1,全新的强化学习框架,能够直接在完整的4D时空域中实现策略优化。该框架利用生成式占用世界模型作为高保真“预想引擎”,使智能体能够从大量想象的故障中安全学习——这是现实世界自动驾驶的关键能力。

为实现这一目标,我们首次对世界模型中的“乐观偏差”进行了系统性诊断,并构建了风险预测基准(RFB)——首个用于严格量化模型预测灾难性故障能力的基准,为该领域提供了关键新工具。

我们的解决方案是公正世界模型(IWM),其设计目标是成为风险的忠实评判者。该模型通过两大协同机制构建:数据层面的反事实合成流水线(用于教授模型丰富的合理故障样本库);模型层面的优化机制(轨迹感知门控模块、保真度损失)(确保预测始终忠实于智能体的指令)。

在NavSim仿真器上的大量实验表明,AD-R1具有即插即用的有效性,在两个基线模型上实现了规划指标PDSM绝对提升1.7%。

二、AD-R1算法详解

概述与问题公式化

本文目标是优化预训练的端到端驾驶策略 ,该策略将传感器观测数据 与指令 映射为未来自车轨迹 。此类策略通常通过模仿学习训练,但在长尾事件中表现不佳,因此我们将其构建为强化学习(RL)问题:策略 需通过优化以最大化奖励函数 的期望未来奖励,公式如下:

其中,奖励函数 用于评估所提轨迹 的质量。

为安全高效地获取该奖励信号,现有方法依赖外部仿真器,但如前文所述,这些仿真器存在局限:图形引擎固有的“仿真到现实差距”、2D布局仿真器的非交互性,或基于重建的环境的静态性与高成本。为此,我们提出一种革新范式——引入学习型世界模型 ,将其作为高保真的内部生成式仿真器。该模型以历史观测数据 与候选自车轨迹 为输入,预测场景的对应未来演变(通常表示为一系列未来3D占用网格 ),公式如下:

奖励 直接从该预测未来中计算得出,因此整个框架的性能取决于模型的保真度。一个优秀的世界模型必须能如实预测任意轨迹(尤其是不安全轨迹)的后果,以提供可靠的奖励信号。

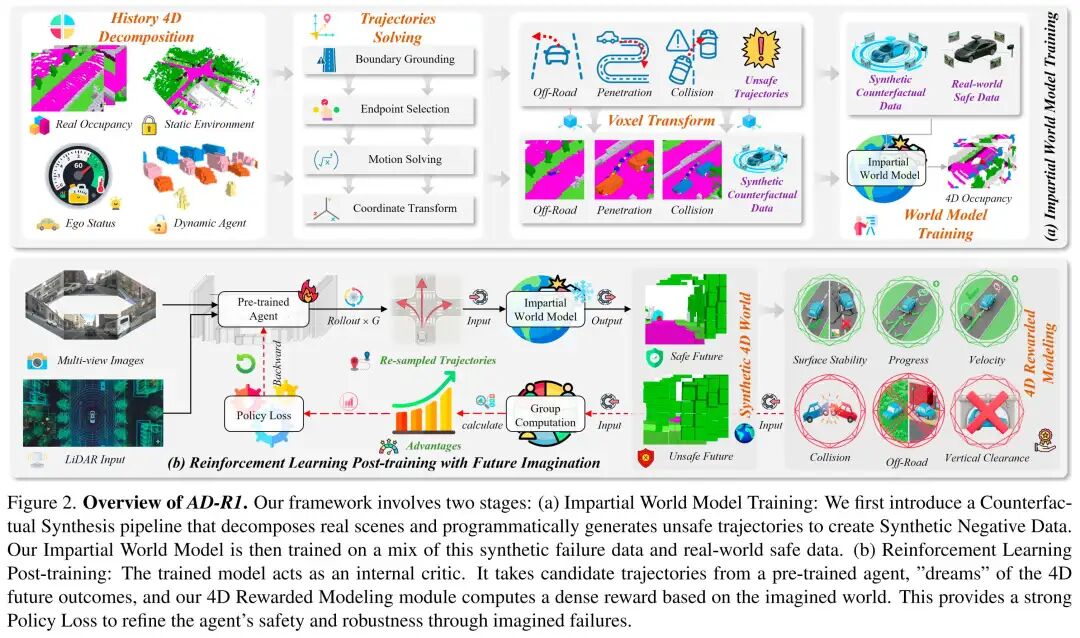

如图2所示,本文方法由两大核心模块构成:(1)新型公正世界模型的设计;(2)将该模型集成到用于策略优化的强化学习框架中。

公正占用世界模型

当前最先进的世界模型虽在预测性能上表现出色,但存在前文所述的“乐观偏差”。为解决这一问题,我们构建了基于占用率的预测模型,旨在捕捉驾驶场景复杂的3D几何特征与4D时空动态;更关键的是,该模型从根本上设计为克服“乐观偏差”。下文将先概述其骨干架构,再详细介绍数据层面与模型层面的协同优化方案。

backbone

本文提出的公正世界模型基于 -World的高效架构扩展而来。为提升计算效率,模型在 latent 空间中运行,分为两个阶段:

场景 Token 化(Scene Tokenization):编码器(称为 -Scene Tokenizer)首先将高维度的历史占用网格序列 压缩为紧凑的 latent 令牌序列 。该 Tokenizer 旨在高效捕捉每帧内的静态空间细节(帧内场景)与帧间的动态时间演变(帧间场景)。

自回归预测(Autoregressive Forecasting):基于Transformer的预测器( -Former)通过自回归方式预测未来 latent 令牌序列 。该预测器包含两个子模块:处理历史令牌与候选自车轨迹的编码器,以及生成未来令牌的解码器。最终的占用网格序列 通过对这些 latent 预测结果解码得到。

这一稳健的两阶段架构为后续关键优化提供了基础,使模型具备“想象失败场景”的核心能力。

反事实数据合成

现有现实世界数据集(多数世界模型的训练基础)主要包含专业驾驶员在安全驾驶场景下的轨迹记录。这类数据中“故障样本的固有缺失”是“乐观偏差”的核心成因。为此,我们提出系统性的数据合成流水线,生成多样化、结构化的反事实负样本训练库,从根源上解决这一问题。

该流水线将数据集中的每个安全场景视为“可编辑场景”。给定历史占用序列 ,我们首先对当前帧 进行分解:利用nuScenes数据集提供的ground-truth 3D标注,通过聚类算法分离静态环境、动态智能体与原始自车状态。这一步为生成“符合场景逻辑的故障轨迹”提供了必要上下文。需说明的是,当前方法依赖标注数据,这是其局限性之一;但我们认为,未来可通过高保真感知系统替代标注数据。

接下来,我们通过编程生成新的不安全自车轨迹 。所有不安全轨迹均由统一的运动学模型生成:该模型将自车从当前状态引导至指定目标点 (目标点的选择取决于期望模拟的故障类型)。每个时间步 的未来位置 通过融合车辆历史动量与朝向目标点的向量计算得出,公式如下:

其中, 为历史行驶方向, 为朝向目标点的单位向量, 为步长距离, 与 为时变混合系数。这些系数的设计目标是生成“平滑且符合现实的机动轨迹”——从当前轨迹出发,逐步向目标点偏离,模拟真实驾驶中的错误操作。

我们通过定义目标点 的选择策略,构建“层级化故障训练库”,具体包括三类故障:

自车状态故障(偏离车道事件):为模拟车辆驶离道路的场景,将 选为“最近可行驶区域边界外的一点”。应用上述运动学模型(公式4)可生成平滑的偏离车道轨迹。

与静态环境交互(碰撞静态障碍物):该类故障模拟更复杂的场景——自车与环境中不可移动物体的交互。我们生成“直接朝向静态障碍物的轨迹”(静态障碍物从分解后的场景地图中识别,如建筑物、护栏、植被),使模型学习“实体不可穿透性”这一物理常识。

与动态智能体交互(碰撞动态目标):为模拟与其他动态智能体的碰撞,将 设为“目标智能体的未来预测位置”。为简化计算,我们假设目标智能体做匀速直线运动,通过运动学模型生成“拦截轨迹”。

通过将单一、灵活的轨迹生成模型应用于“结构化目标点层级”,我们可高效合成丰富多样的故障训练库。最后,我们合成新的ground-truth未来占用序列 :对于每个未来时间步 ,计算“将反事实自车坐标系下的体素坐标映射回原始坐标系”的刚体变换 ,并将该变换应用于原始网格 ,通过插值处理非整数坐标,生成新的未来网格 ,公式如下:

该操作(通过插值处理非整数坐标)确保所有复杂空间关系均以高物理保真度保留。通过在“合成负样本的丰富训练库”上训练,我们使世界模型 能够学习“不安全自车轨迹与对应故障结果(如碰撞、偏离车道)”之间的关键因果联系。

模型层面优化

Trajectory-Aware Gating:为进一步提升模型对控制输入的保真度,我们引入轻量级、即插即用的门控模块。具体而言,首先将输入自车轨迹 栅格化为2D空间掩码,通过小型CNN将其处理为门控图 ;该门控图通过元素-wise乘法动态调制中间场景特征 ,公式如下:

这一机制强制模型“优先关注指令轨迹沿线的特征”,避免其为虚构安全结果而“忽略障碍物”。

Ego-Trajectory Fidelity Loss:另一关键优化是新设计的损失函数——用于惩罚“预测自车位置与指令轨迹的偏差”。对于每个预测未来时间步 ,解码预测占用图 ,计算所有被分类为“自车”的体素的几何中心,记为 ;随后引入自车轨迹保真度损失 ,通过L2距离衡量该预测中心与“输入控制轨迹中的ground-truth位置 ”的偏差,公式如下:

该损失函数作为强正则化项,直接抑制模型“虚构自车自主规避碰撞的未来场景”,确保世界模型的核心角色是“预测”而非“主动干预”。

最终训练目标:公正世界模型的训练数据为“真实安全场景数据与合成反事实故障数据的混合集”;其训练目标在原始基线损失 的基础上,加入上述保真度损失,公式如下:

其中, 为平衡超参数。模型通过该目标在“原始安全场景”与“合成故障场景”的混合数据上完成训练。

基于未来预测的强化学习

训练范式

本文训练范式利用“公正世界模型”作为高保真仿真器,以“闭环且完全离线”的方式优化预训练策略 。为实现“超越简单模仿的稳定高效探索”,我们引入GRPO,并将其适配于轨迹优化任务。

具体而言,给定观测数据 ,我们优化基于扩散模型的驾驶策略 。将扩散去噪过程构建为“有限时域马尔可夫决策过程(MDP)”——扩散规划器作为随机策略,从高斯噪声 出发,经过 步逐步去噪,最终生成完整轨迹 。为实现“超越模仿的探索”,我们采样 条轨迹展开序列 ,将每条轨迹输入世界模型 以“预想”其后果,得到对应的未来占用序列 ;随后通过奖励函数为每个“预想展开结果”计算标量奖励 。

与依赖“简单替代奖励”的现有方法不同,本文提出的“基于物理的奖励”可提供关于“安全性与舒适性”的真实反馈。我们将整个轨迹组的展开视为“单步决策过程”,为获取稳定的学习信号,计算每条轨迹的“组标准化优势”,公式如下:

该标准化操作使奖励“中心化”并通过方差缩放,确保策略更新聚焦于“采样组内轨迹的相对质量”。

最终,策略损失由两部分构成:鼓励“追求奖励行为”的强化学习损失,以及防止“灾难性遗忘”的行为克隆损失。

强化学习损失:基于GRPO公式,在采样轨迹组上计算,公式如下:该损失使策略“提高组内具有更高相对优势的轨迹的生成概率”。

行为克隆损失:为防止策略“偏离预训练模型的合理先验”,引入行为克隆(BC)损失——将优化后的策略 锚定到原始参考策略 ,公式如下:

最终训练目标为两部分损失的加权和:

其中, 为控制正则化强度的超参数。通过该GRPO目标,驾驶策略可在“纯离线场景”中学习生成“更安全、更舒适的轨迹”,并有效从“大量想象故障”中获取经验。

4D奖励建模:预测的4D占用序列 为“奖励建模”提供了“基于物理的丰富基础”。依托公正世界模型的高保真特性,我们设计了综合奖励函数 ,将“预想未来”转化为标量奖励信号。预测结果的“显式3D属性与时间属性”使我们能够构建“捕捉安全性、舒适性与任务进度”的奖励——其细节丰富度远超基于启发式或2D鸟瞰图(BEV)的方法。设 为“时间步 下体素 的语义标签集合”(如{自车、可行驶区域}),则本文奖励为“鼓励安全高效驾驶的多组件加权和”。

关乎关键安全的惩罚:奖励设计的首要目标是“惩罚模型预测的不安全未来场景”,具体包括以下两类核心惩罚:

体积碰撞惩罚( ):碰撞是最严重的故障事件。本文不采用简单的二值惩罚,而是量化预测碰撞的严重程度:对于任意预测时间步 ,识别“自车体素集合 ”与“其他动态智能体 的体素集合 ”(如其他车辆、行人);若两者交集非空,则判定为碰撞。定义“体积碰撞交并比(Volumetric Collision IoU, VC-IoU)”量化空间重叠程度,公式如下:

该指标自然捕捉“重叠范围”,可作为碰撞严重程度的代理指标。碰撞惩罚对“任何接触行为”施加严厉惩罚,并随严重程度缩放,公式如下:

其中, 为指示函数, 为“任何接触行为的大额基础惩罚”, 为“碰撞严重程度的权重系数”。

偏离车道与人行道惩罚( ):利用语义预测结果,惩罚自车占用“非可行驶区域”的行为。识别“自车 footprint 下的体素集合 ”,惩罚力度与“属于非允许语义标签的体素数量”成正比,公式如下:

3D/4D感知的舒适性与规则遵守奖励:依托模型的3D与时间感知能力,我们设计了“2D BEV方法无法实现”的奖励组件,具体包括:

垂直间隙惩罚(

建筑物 该惩罚提供了“纯BEV视角无法建模的关键安全约束”。

可行驶表面稳定性奖励(

其中 自车 下方体素 可行驶区域 该奖励有助于实现“更平稳、更安全的行驶体验”。

任务导向奖励:为确保智能体“向任务目标推进”,我们引入标准的任务导向奖励组件:

进度奖励(

速度奖励(

最终输入强化学习算法的奖励为所有组件的加权和:

通过融合这些多维度奖励信号,本文框架充分发挥了“公正4D世界模型”的丰富预测能力,使学习到的驾驶策略不仅“有效”,更具备“可验证的安全性与物理合理性”。

三、实验结果分析

实验设置

本文提出的公正世界模型(IWM)基于混合数据集训练。安全驾驶场景的主要数据来源为nuScenes数据集,该数据集提供了丰富的传感器数据与标注信息;同时,我们通过反事实合成(Counterfactual Synthesis)流水线生成故障场景数据,对基础数据集进行扩充。实验采用的数据集比例为80%的真实nuScenes数据与20%的合成反事实数据——该比例通过实证验证确定,既能提供充足的故障样本以修正乐观偏差,又不会显著偏离真实驾驶动态的模型先验。

在最终驾驶策略的闭环评估中,我们采用官方NavSim基准——这是一个标准化的评估环境。实验从两个维度展开评估:一是世界模型的保真度,二是优化后驾驶策略的性能。详细的评估指标与实现细节已包含在补充材料中。

定量分析

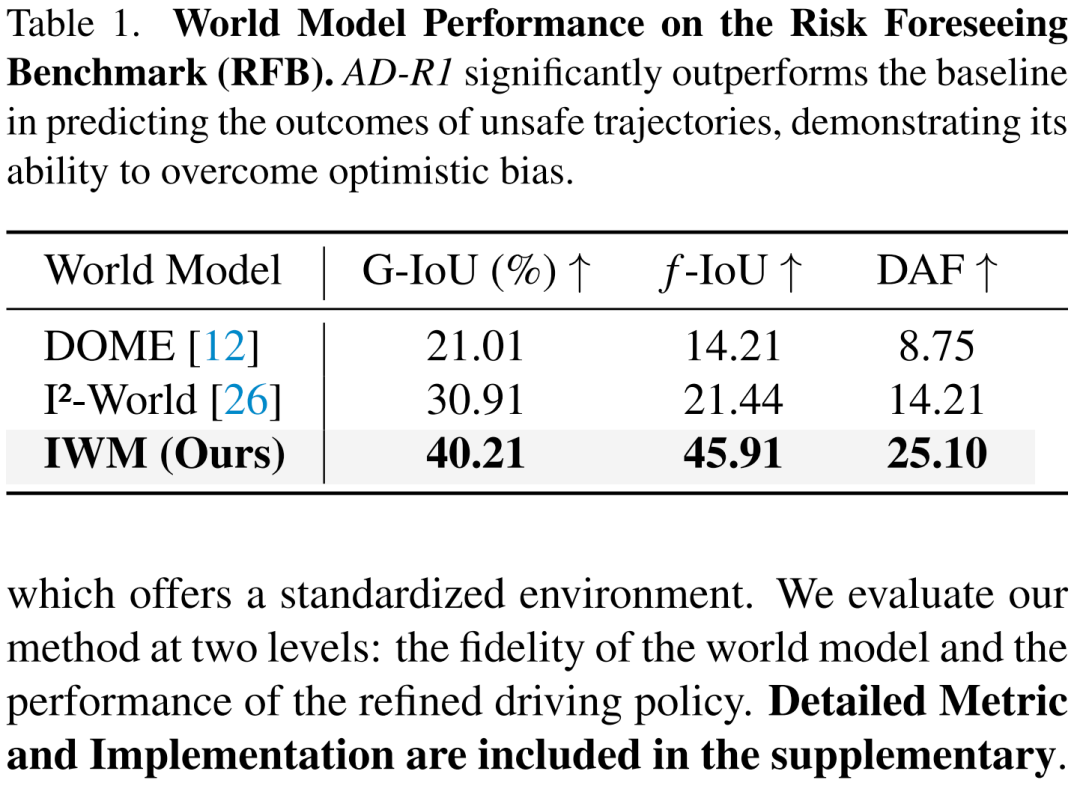

AD-R1在风险预测任务中表现优异:如表1所示,标准世界模型在本文提出的风险预测基准(RFB)上表现显著不佳。仅基于安全数据训练的DOME与

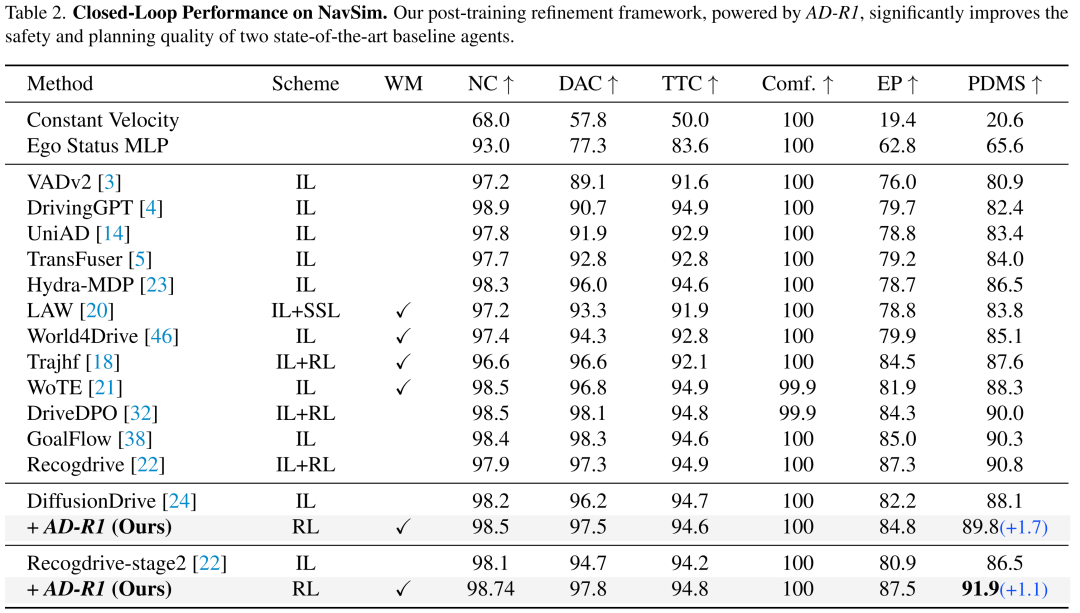

后训练优化提升安全性与性能:表2呈现了本文的核心实验结果:将本文提出的即插即用优化框架应用于不同基线模型后,所有模型的性能均获得显著提升。无论是基于扩散策略的方法(DiffusionDrive),还是基于视觉-语言注意力(VLA)的方法(Recogdrive),在闭环仿真中其PDMS(规划决策综合指标)得分均实现稳定提升。这表明,通过“想象故障”学习的策略改进,能够有效转化为更安全的实际驾驶行为。此外,安全性的提升并未以牺牲性能为代价:我们的方法使两个智能体的PDMS得分分别实现1.7%和1.1%的绝对提升。

消融实验

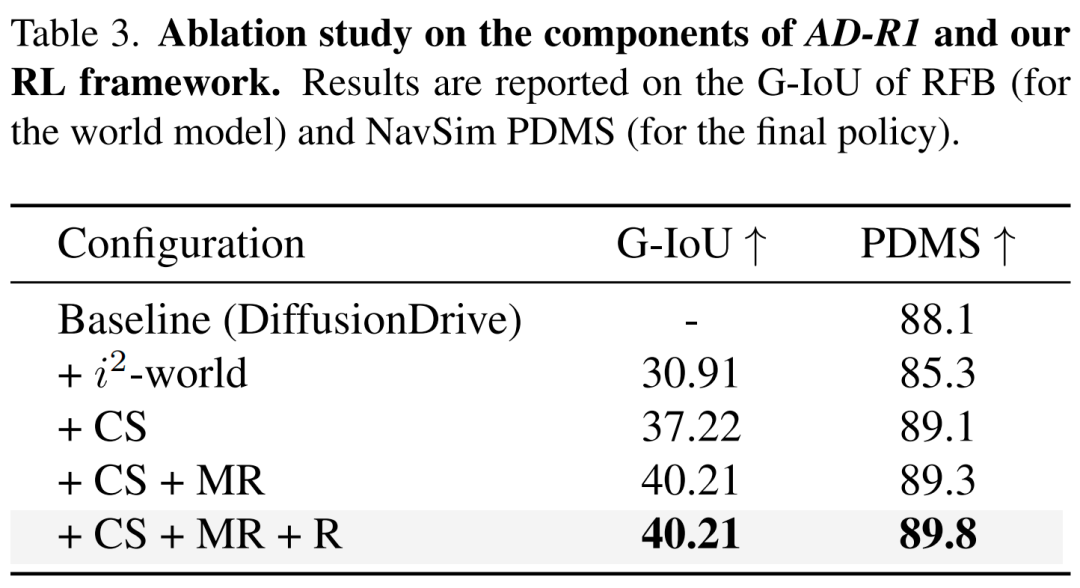

核心组件的作用分析:为剖析各提出组件的贡献,我们开展了全面的消融实验,结果如表3所示。实验以基于模仿学习(IL)训练的强基线模型DiffusionDrive为起点,关键发现如下:

单纯使用标准世界模型有害:若直接将标准乐观世界模型(如

反事实合成(CS)是关键提升因素:逐步加入本文提出的组件后,性能呈现清晰且稳定的提升趋势。其中,引入反事实合成(CS)组件带来的提升最为显著,使PDMS得分跃升至89.1。这表明,教会模型识别故障是实现策略安全优化的核心前提。

模型层面优化(MR)增强因果保真度:在反事实合成的基础上加入模型层面优化(MR,即轨迹感知门控模块TAG与保真度损失),PDMS得分进一步提升至89.3。这一结果验证了该优化机制的有效性——它能强制模型遵守“行为-结果”的因果逻辑,避免虚构安全场景。

4D奖励(R)实现最优性能:最后,在优化循环中引入基于物理的4D奖励(R),PDMS得分达到最高值89.8。这表明,利用3D/4D预测结果构建的细粒度奖励信号,能为策略优化提供更可靠的指导。

综上,本文提出的三大核心组件——修正乐观偏差的反事实合成、确保因果保真的模型优化、基于物理的4D奖励——在策略优化中发挥协同作用,共同实现了驾驶策略的安全与性能提升。

定性分析

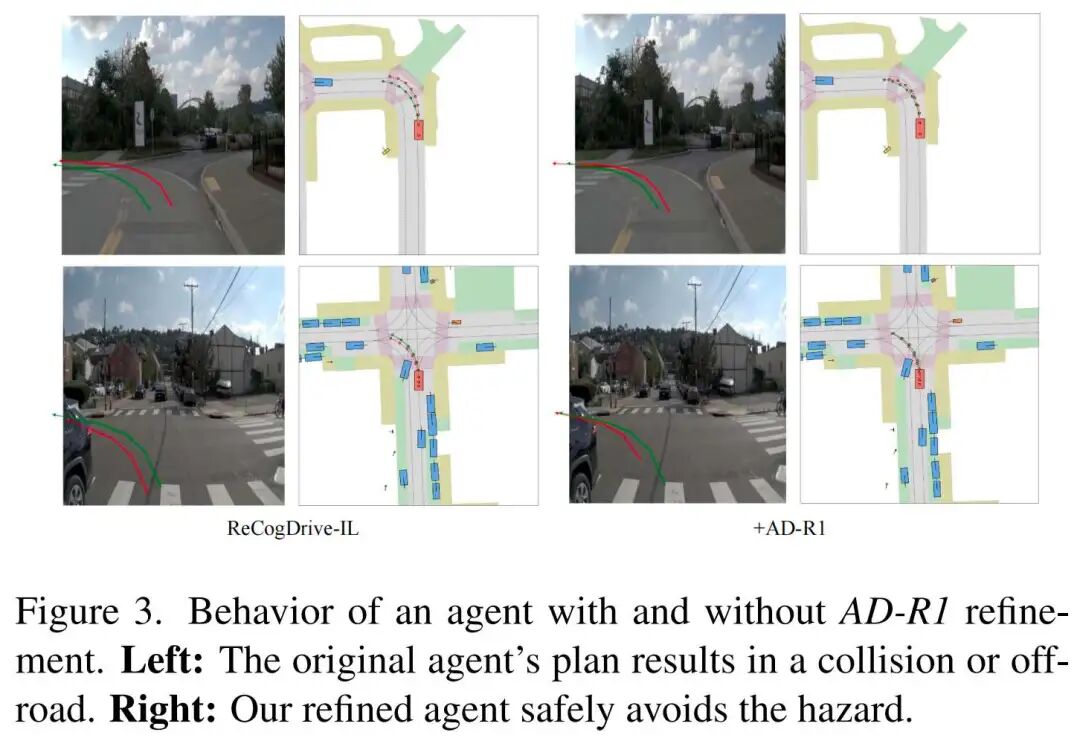

策略优化的行为可视化:图3对比了智能体在应用AD-R1优化前后的行为差异:左侧为原始智能体的规划轨迹,该轨迹会导致碰撞或偏离车道;右侧为经过AD-R1优化后的智能体轨迹,能够安全规避危险。这一直观对比验证了我们的框架在实际危险场景中的决策修正能力。

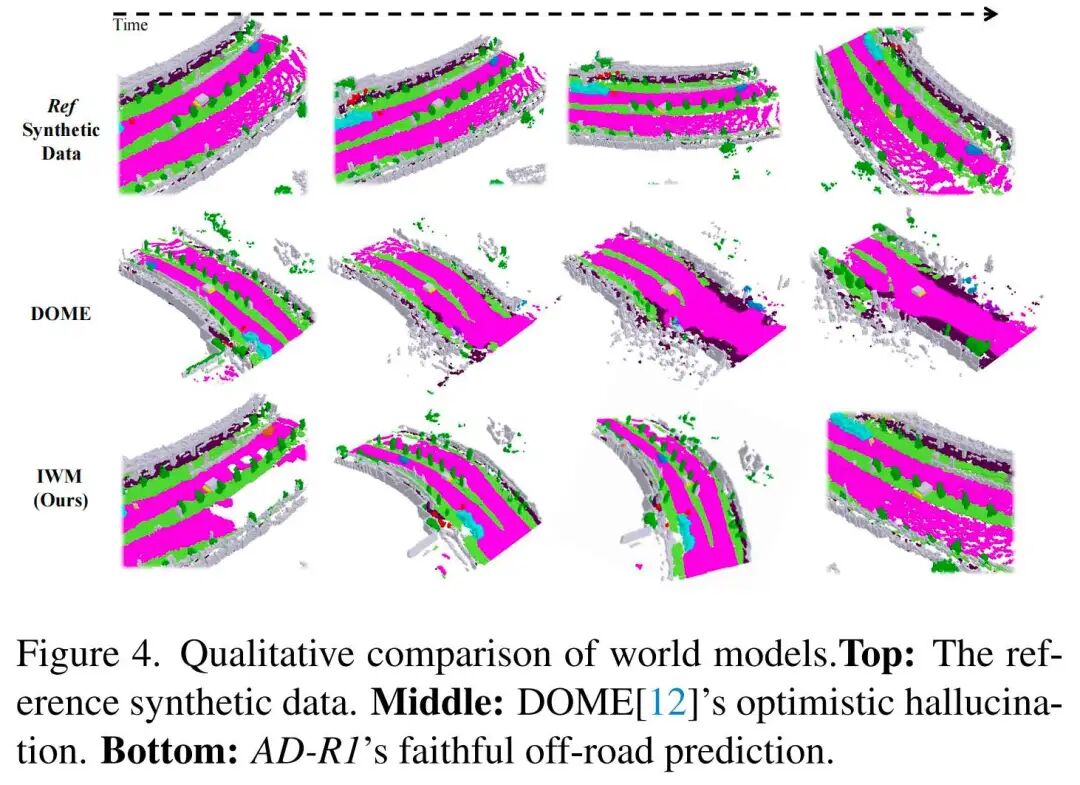

故障想象能力的可视化:图4对不同世界模型的预测结果进行了鲜明对比:我们将同一条“偏离车道”的不安全轨迹分别输入标准世界模型[12]与AD-R1的公正世界模型(IWM)。结果显示,标准模型会产生“乐观幻觉”——道路中间的绿化带在预测中消失,虚构出安全行驶场景;而我们的IWM则忠实预测了偏离车道的场景,生成的“想象未来”能提供清晰且正确的惩罚信号。更多可视化结果已包含在补充材料中。

四、结论

强化学习在自动驾驶领域的应用受阻于一个根本缺陷:世界模型存在“乐观偏差”,无法预测失败后的结果。为解决这一问题,我们提出通过反事实合成(Counterfactual Synthesis)训练“公正世界模型(IWM)”——该模型能够忠实预测不安全行为的后果,而非虚构安全场景。

在AD-R1框架中,该公正世界模型作为内部评估器,使智能体能够在安全的离线环境中从“想象故障”中学习,最终大幅减少闭环仿真中的安全违规事件。本文的研究表明,教会模型“想象危险”并非技术局限,而是构建真正安全、智能的自动驾驶智能体的必要前提。

未来研究方向可进一步探索:如何通过无标注数据生成反事实故障样本,以降低对高精度标注的依赖;以及如何将该框架扩展至更复杂的多智能体交互场景,进一步提升自动驾驶在长尾事件中的鲁棒性。

自动驾驶之心

论文辅导来啦

自驾交流群来啦!

自动驾驶之心创建了近百个技术交流群,涉及大模型、VLA、端到端、数据闭环、自动标注、BEV、Occupancy、多模态融合感知、传感器标定、3DGS、世界模型、在线地图、轨迹预测、规划控制等方向!欢迎添加小助理微信邀请进群。

知识星球交流社区

近4000人的交流社区,近300+自动驾驶公司与科研结构加入!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(大模型、端到端自动驾驶、世界模型、仿真闭环、3D检测、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型,更有行业动态和岗位发布!欢迎加入。

独家专业课程

端到端自动驾驶、大模型、VLA、仿真测试、自动驾驶C++、BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、CUDA与TensorRT模型部署、大模型与自动驾驶、NeRF、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频

学习官网:www.zdjszx.com

919

919

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?