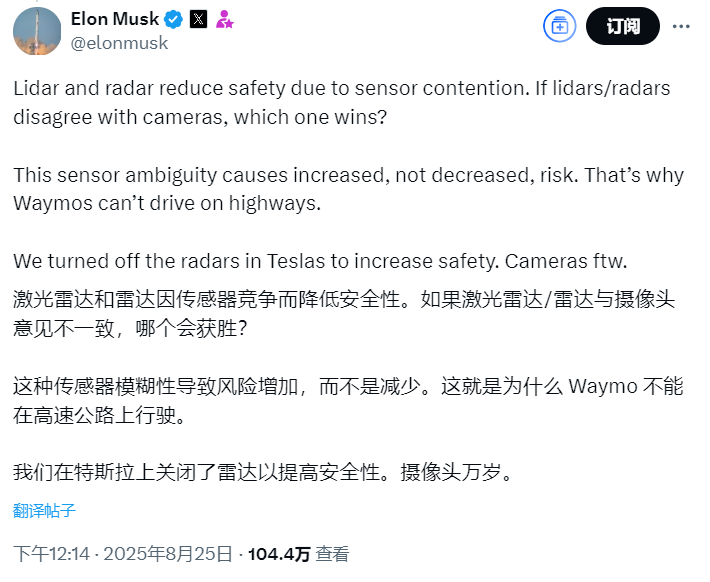

最近车圈又上演 “大佬互怼” 名场面!Uber CEO和老马干起来了。啥原因呐,最近全球最大网约车平台Uber的CEO达拉·科斯罗萨西(Dara Khosrowshahi)在接受一个采访中表示:“自动驾驶一定是未来,但现在自动驾驶行业仍存在的路线之争,激光雷达还是纯视觉?从他个人角度来说更支持激光雷达,成本低、安全系数高”。他还表示Uber所有的合作伙伴都有采用多传感融合方案。尽管达拉发布了“免责声明”,表示自己可能会被证明是错的。但对坚持纯视觉路线的埃隆.马斯克来说,肯定是不赞同了。马斯克本人很快在社交媒体上抨击,表示“激光雷达和雷达因传感器竞争而降低安全性!”

社交网络上,马斯克也顺带cue了下waymo,“传感器模糊导致风险增加,而不是减少,这就是waymo不能在高速公路上行驶的原因”。然而,下面的网友也开始反驳,如果传感器模糊、相互竞争,同一类传感器能避免这个问题吗?比如前视和侧视相机?

马斯克是一个极度坚持去冗余设计产品的工程师,但多传感器方案真的冗余没有用处甚至起反作用吗?其实不仅仅是国外。早期国内许多自驾公司也出现过类似的争论,一派坚持低成本、少冗余的纯视觉自驾方案;一派坚持激光雷达所代表的L4级别方案。

国内也有一家重要自动驾驶玩家,对激光雷达方案和纯视觉方案有着独特的见解。从Apollo到萝卜快跑,百度一直坚持激光雷达更能保证行车安全。Robin也发表过类似的观点,指出激光雷达目前已跑通且具有成本优势,纯视觉技术尚处早期,但未来有发展空间。

作为一个深耕自驾的技术自媒体,自动驾驶之心对此有着自己的看法。但三家之言,你更认同哪个?

从全球三家头部自驾公司看方案优缺点

全球范围内早期入场自驾的三个玩家:waymo、特斯拉和百度在技术路线上存在一定分歧。Waymo和百度坚持基于激光雷达的多传感器融合方案,而特斯拉坚持纯视觉方案。所谓“既存在,即合理”,我们不直接下结论。不妨从技术逻辑、商业考量、市场前景、真实测试来分析下每种方案的优劣。

1)特斯拉

2015年前,Telsa和大多车型一样,仍然采用激光雷达测试。但由于使用的Velodyne激光雷达相当贵(接近8w美元),后期就抛弃了相关方案。这里再和大家盘一下特斯拉的方案。2019年4月特斯拉搭载自研FSD芯片,使用8V1R12S的技术方案。2021年7月推出FSD Beta V9.0方案,取消毫米波雷达,转向纯视觉方案。2022年11月推出纯视觉Occupancy方案,传感器未变动。而如今,视觉传感器的配置延续至今,模型转向纯视觉的端到端方案。

马斯克认为,人类仅靠双眼和大脑就能驾驶,因此经过充分训练的AI系统同样可以通过摄像头实现甚至超越人类的驾驶能力。当然,这要求海量的数据作为支撑。特斯拉拥有规模庞大的车队,这些车辆每天能收集到海量的真实世界视觉数据。这些数据用于持续训练和优化其神经网络模型,形成一个数据闭环,使得系统能不断学习和改进,应对各种长尾场景(Corner Cases)。

特斯拉摒弃昂贵的激光雷达,原因之一还有控本。采用成本相对较低的摄像头,有助于降低整车成本,更利于方案大规模普及。

然而,纯视觉方案仍然存在一定的场景难优化问题。虽然马斯克反复强调,自动驾驶本质是机器学习与AI的问题,不是传感器问题;竞争力体现在算法与数据规模上,而非传感器堆砌。但事故的发生,依然和汽车获取的“数据不足”有关!

2019年佛罗里达州,Model S开启Autopilot状态下撞上停靠的SUV,致1死1伤。Autopilot未能识别前方停靠车辆和障碍物。2023年宾夕法尼亚州,特斯拉在Autopilot状态下撞上停止的卡车(长尾效应没有解决)。2025年特斯拉Robotaxi试运营中低速擦碰停放车辆,纯视觉系统在复杂场景(如昏暗小巷、光线不足)下可能出现感知缺陷或误判。

特斯拉的数据规模非常大,但即使在数据量堆积的情况下,依然有几类问题是特斯拉方案头疼的,比如恶劣天气与光照条件、准确的距离和空间感知、太重算法和数据等。这类问题同时存在于早期的分层感知规划模块和现在的端到端方案。

视觉在3D环境感知中,存在天生的不足,结合激光雷达,可以有效在视觉失控的情况下做一个补充。

2)Waymo

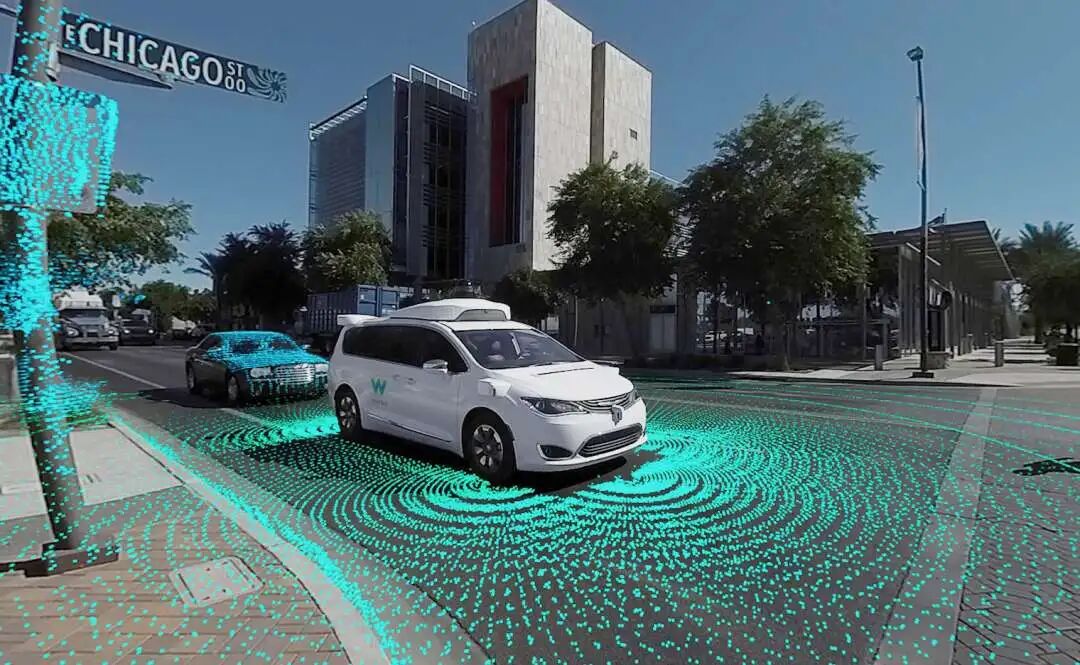

Waymo 是 Google 旗下的自动驾驶技术公司,服务于网约车业务。和特斯拉方案不同,Waymo 采用典型的 “多模态” 方案(视觉+雷达+激光雷达),硬件传感器的方案设计使其拥有“最安全的自动驾驶出租车解决方案”。早在 2020 年,Waymo 就在此启动了商业化的无人驾驶出租车服务;在2024 年,Waymo 将业务扩展到了旧金山湾区和洛杉矶;2025年初,扩展到了南部德州的奥斯汀。

目前约1500辆无人出租正在运营。从划分等级上来看,Waymo是L4级别。这一点国内许多自驾公司连L3都还没完全做到,他们是怎么做到的?

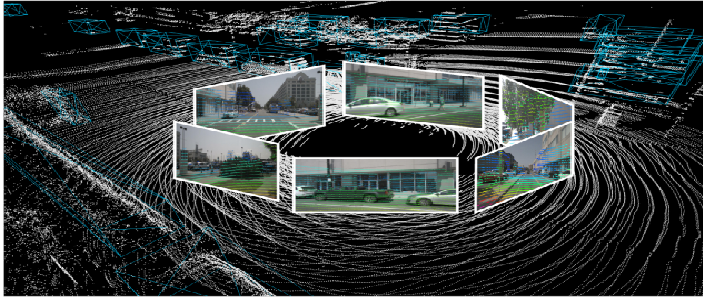

Waymo第六代自动驾驶系统采用13V + 4L + 6R的多传感器融合方案,通过三种互补的传感模式实现 360 度无死角感知,最远可识别 500 米外的路况。和特斯拉一样,Waymo也关注数据和算法两个层面。数据上Waymo采用逼真的仿真器生成各类case,算法上中多传感器融合,这两点和特斯拉都有较大差异。从近几年Waymo产出的论文或开源的数据集可以看出,无论是模块化还是端到端模型,这家公司一直在多模态感知中突破。

值得注意的是,Waymo出租车不仅仅只行驶在路况好,人员稀少的区域。在洛杉矶最繁荣的圣莫尼卡、好莱坞、下城,状况比较复杂的情况下也保持良好性能。今年以来,Waymo每周提供的付费服务量从 2 月份的 20 万次增长到 4 月底的超过 25万次,平均每辆车每天约 24 次。足够的安全,用户才能买单。这也是Waymo为什么受到青睐的原因。

相比于特斯拉,Waymo出现重大事故的概率较小,更多的是人为引诱破坏。比如2025年,许多抗议者通过App引诱车辆至现场后进行打砸烧。

3)百度

百度自2013年开始布局自动驾驶领域,2017年推出全球首个自动驾驶开放平台Apollo(阿波罗),2021年推出自动驾驶出行服务平台萝卜快跑。经过十余年压强式、马拉松式地研发与投入,萝卜快跑已成为全球最大的无人驾驶出行服务商。作为百度Apollo(阿波罗)生态的重要组成部分,萝卜快跑承载了百度在自动驾驶领域的技术积累、创新实践和落地应用。

萝卜快跑的自动驾驶车辆则采用多传感器融合方案,结合激光雷达、摄像头、毫米波雷达和超声波雷达,以实现L4级自动驾驶能力。典型车型(如Apollo RT6)的传感器由4L12V5R-12S组成,存在一定的安全冗余,多传感器融合方案对复杂和突发的场景也能应对自如。

2024年5月,百度Apollo发布了全球首个支持L4级自动驾驶的大模型Apollo ADFM以及第六代无人车。其中,Apollo ADFM基于大模型技术重构自动驾驶,可以兼顾技术的安全性和泛化性,做到安全性高于人类驾驶员10倍以上,实现城市级全域复杂场景覆盖。萝卜快跑第六代无人车则全面应用“Apollo ADFM大模型+硬件产品+安全架构”的方案,通过10重安全冗余方案、6重MRC安全策略确保车辆稳定可靠。

目前萝卜快跑已在全球15个城市落地,全无人自动驾驶车队已驶入北京、深圳、武汉、重庆等多个城市。截止目前,萝卜快跑总服务订单量超过1100万次,总行驶里程超过1.7亿公里,未发生过重大安全事故。过去两年的数据显示,萝卜快跑实际车辆出险率仅为人类驾驶员的1/14。“无人车,打萝卜”正在成为更多用户出行的新选择。

萝卜快跑还积极拓展海外市场,力求将竞争优势扩展到中国大陆以外的地区。2024年11月29日,萝卜快跑获批香港首个自动驾驶车辆先导牌照,这也是萝卜快跑获得的首个右舵左行地区自动驾驶测试牌照,萝卜快跑开启面向全球的业务拓展。2025年3月28日,萝卜快跑宣布与迪拜道路交通局(RTA)签署战略合作协议,在迪拜市区开展无人驾驶规模化测试和服务,双方计划,将在迪拜部署超过1000台全无人驾驶汽车。这也是萝卜快跑首次在中国以外的地区开展无人驾驶规模化测试和服务。当天,萝卜快跑宣布与阿联酋自动驾驶出行公司Autogo达成战略合作,双方将充分发挥各自优势,共同为阿联酋的另外一座城市阿布扎比提供无人驾驶出行服务。未来,双方将致力于持续扩大车队规模,打造阿布扎比地区规模最大的无人车队。

今年5月,萝卜快跑在迪拜开始了开放道路验证测试,目前正在探索更多海外城市。

7月15日,萝卜快跑与全球最大的移动出行服务平台Uber建立战略合作伙伴关系,将数千辆无人驾驶汽车,接入Uber全球出行网络,为世界各地的用户提供人人可用且稳定可靠的无人驾驶出行服务。年底前,双方将率先在亚洲和中东市场部署萝卜快跑第六代无人驾驶汽车。服务上线后,乘客可通过Uber App,呼叫到由萝卜快跑提供服务的无人驾驶车辆。

从Uber和萝卜快跑的合作来看,多传感融合方案虽然存在一定安全冗余,但相比于生命安全,市场“更容易接受”!毕竟多一个传感器,就是多一个数据源和保障。

激光雷达多传感融合 vs 纯视觉方案

作为一个技术自媒体,更愿意从技术角度来剖析纯视觉和激光雷达方案的优缺点(关于价格对比,后面会有章节铺开)。这里我们不妨从数据、算法、性能和成本几个模块展开。

数据上层面上,基于激光雷达的多传感器融合方案需要前视雷达+周视雷达,相机、毫米波雷达等;而纯视觉方案则只需要相机和一些超声波雷达。3D毫米波雷达主要作为辅助雷达用于测速,点云相对稀疏,噪声多。但最近兴起的4D毫米波雷达已经弥补这类缺陷,在成像上更胜一筹。而激光雷达的优势在于空间感知能力非常强、测距长,能准确locate目标的位置,这一点是上述其它传感器做不到的。目前车载主激光雷达,大多采用前向固态雷达,结合视觉等其它传感器,一起完成感知规划任务。

算法层面上,基于点云视觉融合的模型上线要高于纯视觉模型方案,特别是一些极端天气、光照、截断等场景下的感知规划任务。即使视觉不工作,激光雷达也可以弥补这个缺陷。近3年,我们也和多家自驾公司的技术负责人沟通过相关方案,兜底大多依赖毫米波雷达(比如传统3D毫米波或新兴的4D毫米波雷达)、激光雷达等传感器。长尾问题的解决,需要大量的数据支持,这一旦国内很多公司无法保证。数据不够,传感器来做弥补,才能保证安全。其实这一点可以显而易见的考虑到,如果视觉漏掉了一个截断或非常规形态/颜色的目标,激光打在目标上形成点云,也是一大坨unknown。无论如何,某个传感器发现了目标,兜底的逻辑上也不会让它硬撞。

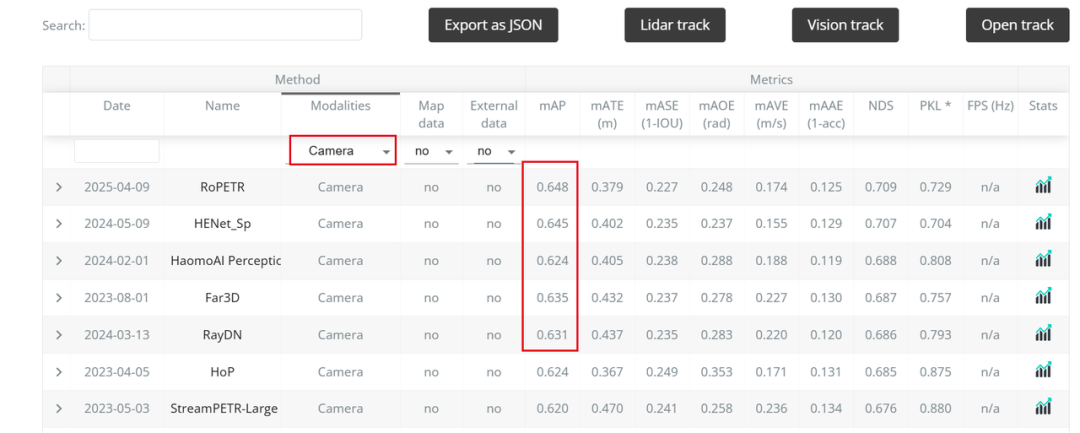

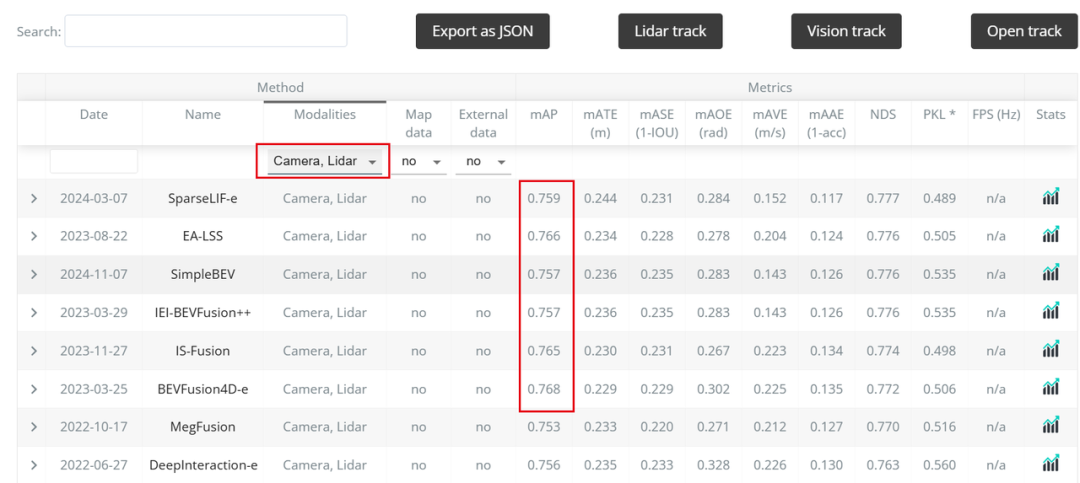

性能上,在nuScenes、Waymo等数据集上的BEV感知(比如3D检测)、Occupancy、端到端任务上,加持激光雷达数据的方案,多模态融合方案要高于纯视觉5个点甚至10个点不止。奇装异服的person、截断的目标(比如car、truck)、非通用几何障碍物(比如树木的占用检测等)、强光场景、弱光场景、夜晚场景等。多模态感知方案,几乎可以不受影响地工作。

下图是nuScenes中3D检测任务性能对比,上面为纯视觉性能,下方为Lidar+Camera。

成本上,面向OEM的Lidar目前基本可以做到千元或几千元级别,在中高端车型上装配的较多。比如理想的L7-L9,华为M7-M9还有小米汽车的一些车型。十年前Velodyne一颗64线激光雷达卖8万美元,今天萝卜快跑第六代无人车4颗远距激光雷达成本只要3.5万元人民币。

在技术不断突破和供应链越来越强大的条件下,价格最终不会是壁垒,安全的驾驶才是市场真正关注的。即使纯视觉成本较低,但是安全面前,增加的成本实在不算什么。

为什么激光雷达work?有哪些自驾产品采用?

1)智能驾驶为什么需要激光雷达呢?

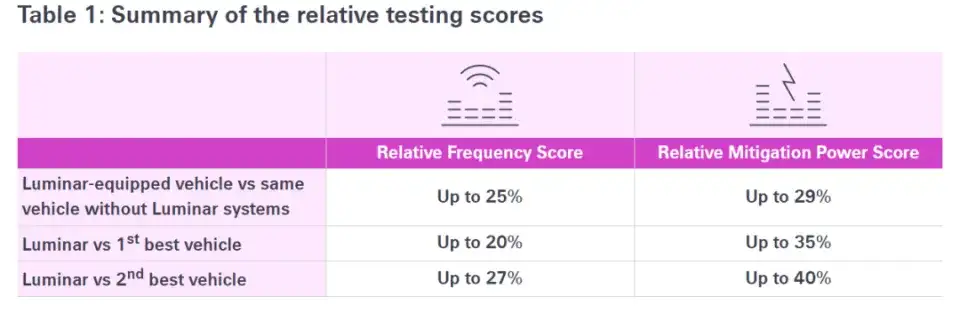

国际保险巨头瑞士再保险(Swiss Re)的测试显示,配备激光雷达的同款车型相较于未配备版本,可避免25%的碰撞事故,事故影响缓解能力提升29% [1]。所以,激光雷达切实地在保证智能驾驶的行车安全。

早期一个上万美元的纯机械式激光雷达,确实谈不上性价比,但现在千元级别的激光雷达已经可以规模化生产。激光雷达的降本速度着实太快,十年期间,成本从Waymo使用的全机械式激光雷达一个大几万美元,到现在的半固态200美元左右,成本降低了几百倍。

那么激光雷达到底如何智能驾驶的行车安全?这要从激光雷达的原理说起,作为主动传感器,激光雷达通过激光器发射激光,接受反射信息,计算光往返的时间,进而判断障碍物的距离。而摄像头是被动的,接受外部光线成像。这种原理上的特性,也让激光雷达成为车辆安全上必要的冗余。

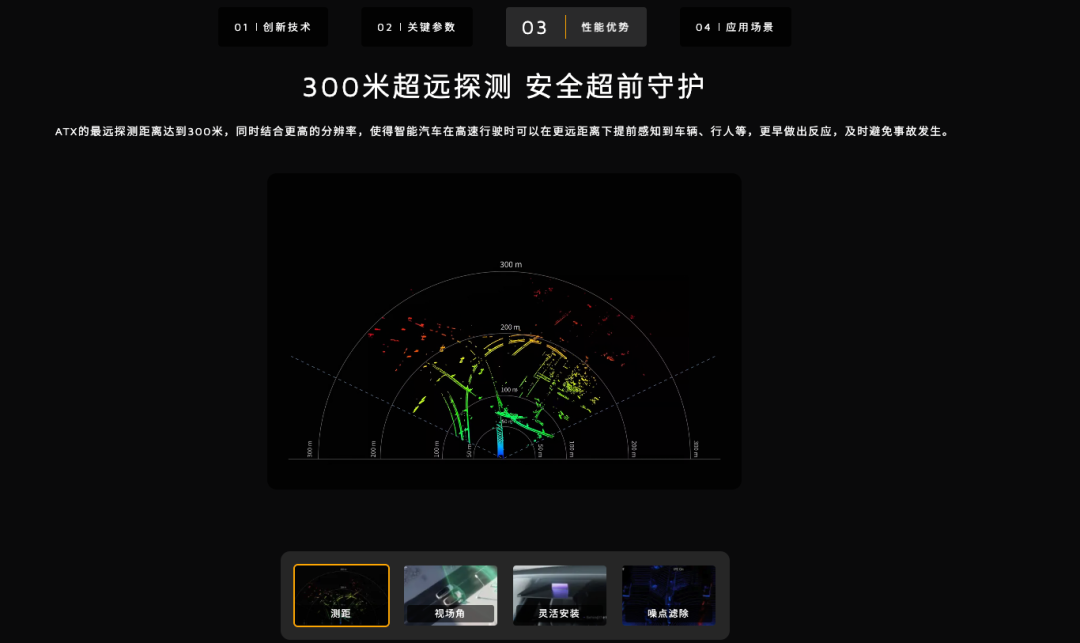

超长感知距离:为高速场景预留安全冗余

车辆在高速行驶时(如高速路 120km/h),需要足够的 “预判距离” 来应对突发情况 —发现前方障碍物时,一般需要 1.5 秒反应时间 + 2 秒刹车时间,车辆至少需覆盖 120 米的感知范围。激光雷达的硬件设计恰恰满足这一需求:当前主流车规级激光雷达(如速腾聚创 M1、禾赛 AT128)的最远感知距离普遍达到150-200 米,禾赛最新的ATX甚至可探测 300 米外的目标。超长感知能力的背后,是激光发射器的 “高功率激光二极管” 与接收器的 “高灵敏度雪崩光电二极管(APD)” 共同作用的结果:高功率激光能穿透更远的空气介质,而 APD 可将微弱的反射光信号放大数千倍,即使 150 米外的小目标(如路边护栏的金属连接件)反射的激光,也能被精准捕捉。

对比来看,摄像头的最远有效感知距离受光照和物体对比度影响极大 — 晴天时识别远处车辆的距离约 80-100 米,雨天或夜间则骤降至 50 米以内;毫米波雷达虽能探测 200 米以上,但仅能识别 “有反射的物体”,无法区分是车辆还是路牌。而激光雷达的远距离探测能力,能在高速场景中为车辆预留更多决策时间,比如当 150 米外出现异常情况时,激光雷达可提前 3 秒完成识别,让自动驾驶系统有充足时间调整车速或避让,避免因感知距离不足导致的追尾事故。

传感器帧率:实时感知为安全保驾护航

自动驾驶车辆处于持续的运动过程中,而如今智能驾驶车规芯片的算力也越来越大,复杂的驾驶场景对智能驾驶的实时性要求也越来越高,而感知算法的上限也受限于传感器的帧率上限。主流车规级激光雷达的帧率普遍达到10-20Hz(即每秒生成 10-20 帧三维点云),部分针对城市复杂路况的产品甚至提升至 30Hz,可以和摄像头的帧率保持一致。

早期的机械旋转式激光雷达帧率受电机转速限制(通常 10Hz);如今的半固态激光雷达(如 MEMS 微振镜式)通过 “微机电系统控制镜片高频摆动”,扫描速度大幅提升,可轻松实现 20Hz 帧率。激光雷达的越来越高帧率硬件特性,让其在动态场景中始终保持 “实时感知”,避免因信息滞后引发事故。

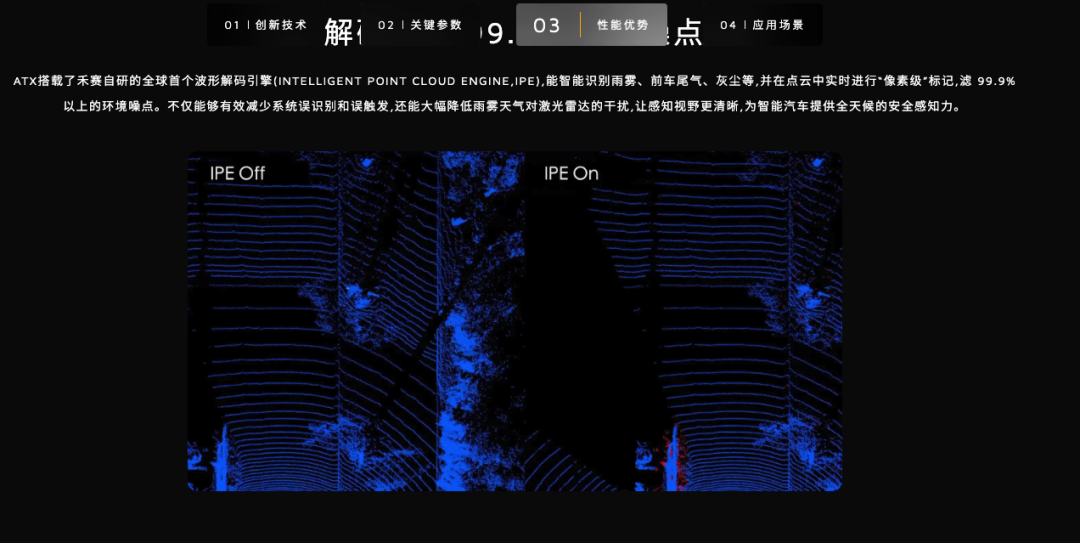

恶劣环境适应性:硬件级抗干扰设计突破场景局限

智能驾驶无法规避暴雨、大雾、强光、隧道明暗交替等 “极端场景”,而激光雷达的硬件设计从源头解决了这些环境难题。其核心在于激光波长选择与光学系统防护两大硬件特性:

波长选择:当前主流激光雷达采用 905nm 或 1550nm 的近红外激光波长 ——905nm 波长的激光对雨雾的散射率仅为可见光(如摄像头依赖的 400-700nm 波段)的 1/5,即使暴雨天气,激光也能穿透雨帘实现有效探测;1550nm 波长的激光则具有更强的抗干扰性,不仅能穿透浓雾,还能避开阳光中的红外干扰(阳光中 1550nm 波段的能量仅为 905nm 的 1/10),在强光暴晒的正午,也不会出现 “信号饱和”。

光学防护:激光雷达的发射 / 接收窗口采用 “疏水性镀膜玻璃”,雨水落在表面会形成水珠快速滑落,不会像摄像头镜头那样形成 “水膜” 遮挡视线;部分产品还内置 “加热除雾模块”,在低温大雾天气,可通过加热玻璃表面,防止雾气凝结,确保激光信号正常传输。

实际测试数据显示:在降雨量 20mm/h 的暴雨环境中,激光雷达的测距精度仅下降 8%-12%,仍能准确识别 50 米内的行人;在能见度 50 米的大雾中,其有效探测距离保持在 80 米以上,而摄像头此时已基本无法识别前方物体,毫米波雷达也因雾气中的水汽反射出现 “虚假目标”。这种硬件级的抗干扰能力,让激光雷达在恶劣环境中成为安全的最重要保障。

空间感知:3D建模构建 “全局认知”

智能驾驶天然的需要对现实世界的空间理解,不仅要知道目标 “有多远”,还要知道目标 “有多高”“有多大”,而激光雷达的硬件设计天生具备三维的感知能力。

比如在城市路口,激光雷达可通过三维点云判断:前方 5 米处有一个高 1.2 米的物体(儿童),正以 1.5m/s 的速度横穿马路;右侧 3 米处有一个高 1.8 米的物体(成人),站立不动;远处 10 米处有一个高 2.5 米、宽 1.8 米的物体(SUV),正以 30km/h 的速度直行。基于这些三维信息,决策系统能快速判断:需紧急刹车避让儿童,同时无需担心右侧成人与远处 SUV,避免了 “误判避让” 导致的交通混乱。这种三维空间感知能力,是视觉感知(2D推理3D信息,易出现误差)和毫米波雷达(仅能提供距离与速度,无高度信息)无法替代的,也是自动驾驶实现 “精准决策” 的核心基础。

从超长感知距离的 “安全冗余”,到帧率不断提升带来的的 “实时感知”,再到恶劣环境适应性的 “抗干扰保障”,再到空间感知能力的 “三维认知”,激光雷达的核心硬件参数都精准命中了自动驾驶的感知痛点。这些硬件特性并非孤立存在,而是相互协同:高帧率确保动态捕捉的实时性,高稠密点云提供细节支撑,三维感知构建全局认知,再结合恶劣环境下的稳定表现,共同形成了激光雷达的 “可靠工作能力”。

随着硬件技术的持续迭代 — 比如通过 “硅光芯片” 进一步降低成本、通过 “全固态设计” 提升可靠性、通过 “多波长融合” 增强抗干扰性,激光雷达将在自动驾驶中发挥更核心的作用。未来,当激光雷达的最远感知距离突破 300 米、帧率提升至 50Hz、点云密度达到 2000 点 / 平方米时,自动驾驶车辆将具备更强大的 “环境感知能力”,为安全出行提供更坚实的保障。而这一切的起点,正是激光雷达硬件与自动驾驶场景需求的深度契合 — 这也是它之所以能稳定 “work” 的根本原因。

2)有哪些车型搭载激光雷达?

今年某纯视觉方案车型在高速 NOA 状态下因感知延迟导致 3 人死亡的重大事故,也暴露出 L2 级辅助驾驶的致命缺陷:系统仅提前 2 秒预警,远低于人类 1.5 秒的应激反应时间。而搭载激光雷达的蔚来 ET9 在类似场景下,AEB 触发速度上限提升 50%(夜间 80km/h→120km/h),这正是 L3 + 自动驾驶必须具备的物理级安全冗余。

因此业内高配版的新能源车型基本都搭载了激光雷达,只有低配的车型才选择纯视觉方案。国内头部的激光雷达厂商禾赛和速腾聚创已经量产了多款车型。

2025年比亚迪旗下十余款车型将搭载禾赛激光雷达陆续上市。比亚迪在智能化战略发布会上宣布,将全系搭载 “天神之眼” 高阶智驾系统。其中天神之眼 A(DiPilot 600)为高阶智驾三激光雷达版,传感器组合包括3颗激光雷达 + 5颗毫米波雷达 + 11颗摄像头(包括双目前视、4环视、4侧视、1后视摄像头) + 12颗超声波雷达。天神之眼 B(DiPilot 300)即高阶智驾激光版,传感器组合包括1颗激光雷达 + 5颗毫米波雷达 + 12颗摄像头 + 12颗超声波雷达,像已上市的 2025 款汉 DM-i 和汉 EV 就搭载了 DiPilot300,该方案采用单激光雷达或双激光雷达方案,算力平台为单 Orin-X 芯片,功能上支持高速和城市 NOA 。

今年3月,奇瑞汽车旗下新能源品牌 iCAR 量产车也宣布采用禾赛 ATX 激光雷达。零跑汽车的全新 B 系列车型 — 零跑 B10,也成为行业内首个将带激光雷达硬件的高阶智驾产品下探到 12 万级的车型,其搭载了禾赛的远距离探测激光雷达。理想汽车于 7 月 29 日上市的理想 i8,搭载下一代辅助驾驶架构 Mind VLA,换装全新的禾赛 ATX 激光雷达,配备英伟达 Drive AGX Thor-U 智驾芯片,提升了车辆的辅助驾驶能力 。此外禾赛科技的 AT 系列激光雷达此前已成功搭载于长城魏牌蓝山、高山等车型。在今年5月,长城旗下的品牌欧拉汽车搭载禾赛激光雷达的相关车型预计于今年内量产并逐步交付 。

速腾聚创同样在车载激光雷达市场表现出色,以 519,800 台的年销量,登顶 2024 年全球乘用车激光雷达市场销量冠军,截至 2025 年 3 月底,比亚迪、极氪、上汽智己等全球 30 家整车厂及 Tier1 达成合作,定点车型数量超百款 。其中比亚迪的 2025 款海豹及 2025 款汉,广汽埃安推出的第二代 AION V 及 AION RT,吉利银河、极氪等均搭载了速腾聚创激光雷达 。在 今年2月发布的全新极氪 001,全系 4 款车型均升级标配 RoboSense 速腾聚创 M 平台激光雷达,该激光雷达基于自研芯片技术驱动,具有体积小、稳定可靠、高性能等优势,拥有 120°×25° 的宽广视场,能帮助车辆看清 200 米内的真实三维世界,为全新极氪 001 实现覆盖泊车、高速和城市的全场景智驾提供了强力保障 。早在 2021 年 7 月,广汽集团高端智能电动车独立品牌埃安全球发布应用速腾聚创第二代智能可变焦激光雷达,后续如 2022 年 1 月上市的埃安 AION LX Plus 搭载 3 颗速腾聚创第二代智能固态激光雷达,今年 4 月预售的埃安昊铂 Hyper GT 以速腾聚创 M 系列激光雷达为核心,打造基于多传感器融合感知的全域高阶智能驾驶系统 。

激光雷达能解决哪些视觉难处理的问题?

上面已经说了激光雷达方案的优势,这里我们详细铺开下激光雷达多传感器融合相比于纯视觉方案的优势和技术参数。

1)激光雷达

高精度的3D环境感知:

激光雷达通过发射激光束并测量反射时间,直接获取周围环境的3D点云,能准确还原物体的形状、距离和空间位置。

精度可达厘米级,尤其在测距和深度感知上远超摄像头。

不受光照条件影响:

激光雷达是主动传感器,不依赖环境光照,在夜间、强光、逆光、隧道出入口等视觉容易失效的情况依然稳定工作。

不会出现摄像头常见的过曝、欠曝、眩光等问题。

测距准确,深度信息可靠:

可以直接获取深度信息(距离),无需像视觉方案那样依赖立体视觉或深度学习网络预测深度。

避免了纯视觉方案中因误判距离导致的“幽灵刹车”或“漏检障碍物”问题。

对静态和动态物体识别更鲁棒:

点云数据能清晰区分地面、障碍物、行人、车辆等,尤其在复杂城市道路中对静止障碍物(如锥桶、故障车)识别更可靠。

纯视觉在缺乏运动线索时难以判断静止物体是否构成威胁。

多传感器融合的基石:

激光雷达常与摄像头、毫米波雷达融合,提供互补信息,提升系统整体鲁棒性。

在L3及以上高阶自动驾驶中,激光雷达被视为关键冗余传感器。

2)纯视觉

对于纯视觉方案来说,在3D感知、深度估计和光照异常、天气异常下存在固有短板:

深度感知依赖算法推测

摄像头是被动传感器,获取的是2D图像,深度信息需通过双目立体视觉或深度学习模型估计,误差较大。

在远距离或纹理缺失场景中,深度估计容易失效。

受光照和天气影响严重

强光、逆光、夜间、雨雾等条件下,摄像头容易出现过曝、反光、低对比度和模糊等问题,纯视觉模型在极端光照场景下无法有效感知。特斯拉在强光下曾多次出现“将白色卡车误认为天空”的事故。

对静止障碍物识别能力弱

纯视觉系统通常依赖物体的运动来判断其存在和距离,对静止物体(如路边故障车、施工锥)容易漏检。

这是导致部分自动驾驶系统“幽灵刹车”或追尾的常见原因。

泛化能力依赖海量数据

纯视觉方案高度依赖深度学习模型,需在各种极端场景下进行大量标注和训练。

面对corner case时,模型可能无法正确响应。

缺乏物理冗余,安全性存疑

纯视觉系统一旦摄像头失效(如被污损、遮挡),整个感知系统可能崩溃。

缺乏独立的测距手段,难以满足功能安全要求。

维度 | 激光雷达优势 | 纯视觉劣势 |

|---|---|---|

测距精度 | 高,直接测量 | 低,依赖推测 |

环境适应性 | 强,全天候 | 弱,怕光怕雾 |

静止物体识别 | 可靠 | 易漏检 |

安全冗余 | 有,多传感器融合 | 单点故障风险高 |

成本 | 成本可控,下降中 | 低 |

技术成熟度 | 已在Robotaxi验证 | 仍在迭代优化 |

激光雷达一直被诟病的雨雾天气性能不佳的问题,也正在被一点点解决。随着激光雷达的成本不断降低,边界场景的逐渐扩展,未来激光雷达的作用将会越来越大!

从政策和安全角度上激光雷达更适合当下

在自动驾驶技术持续演进的当下,激光雷达凭借其独特优势,在政策导向与安全需求的双重驱动下,成为适配当前自动驾驶发展的关键技术。

政策推动激光雷达广泛应用

政策层面为激光雷达的发展与应用开辟了广阔空间。工信部等四部门联合开展的智能网联汽车准入和上路通行试点工作,明确了 L3、L4 级别智能驾驶汽车的商业化路径。这其中,以激光雷达为主导的数据感知系统成为智能驾驶的重要支撑 。激光雷达作为汽车深度感知的关键设备,随着 L3、L4 级智能驾驶政策落地,市场需求迎来进一步增长。

从全球范围的法规来看,激光雷达的重要性愈发凸显。美国交通部国家公路交通安全管理局(NHTSA)规定,到 2029 年 9 月,所有乘用车和轻型卡车都要标配含行人 AEB 的 AEB 系统,要求车辆在特定高速下能有效刹停,这一标准仅靠传统摄像头难以满足,激光雷达的高精度探测能力成为满足该要求的关键,或将被强制标配于 AEB 系统中 。欧洲、日本也有类似法规,要求不同程度地强制安装 AEBS 系统。

国内相关政策同样在推动激光雷达的应用。2025 年 2 月起草、4 月公开征求意见的《轻型汽车自动紧急制动系统技术要求及试验方法》,将代替现行国标,从 “推荐性国标” 升级为 “强制性国标”。新国标在覆盖范围、激活速度和误检 & 漏检等方面全面升级,对传感器精度、探测距离提出更高要求,激光雷达在复杂场景下的感知优势得以彰显 。此外,联合国《自动驾驶法规 R157》要求 L3 级系统提供 10 秒接管缓冲期,这高度依赖激光雷达的超视距感知能力[2]。而国内《智能网联汽车准入试点》规定,L3 + 车型须通过包含雨雾、夜间等极端场景的多传感器融合测试,激光雷达在极端场景下稳定工作的特性,使其成为满足法规要求的核心传感器。政策的引导下,车企为符合标准,在研发与生产中必然更加重视激光雷达的应用,推动其在各类车型中的普及。

安全保障凸显激光雷达价值

安全是自动驾驶的核心诉求,激光雷达在提升驾驶安全性方面发挥着不可替代的作用。辅助驾驶常用的超声波雷达、毫米波雷达和激光雷达中,激光雷达探测距离远,可达 200 - 300 米,且探测精度最高,能够清晰识别障碍物的立体轮廓 。在实际驾驶场景中,这一优势极为关键。例如,夜晚高速行驶时光线不佳,摄像头很难及时察觉危险,而激光雷达能够凭借其主动发光及精确测距能力,及时探测到轮胎这一黑色障碍物,为车辆制动或避让争取宝贵时间 。

诸多实际案例与数据有力地证明了激光雷达对提升安全性的贡献。今年某纯视觉方案车型在高速 NOA 状态下因感知延迟导致严重事故,暴露出纯视觉方案预警时间不足的致命缺陷 。与之形成鲜明对比的是,搭载激光雷达的蔚来 ET9 在类似场景下,AEB 触发速度上限大幅提升 50% 。瑞士再保险的评估显示,配备激光雷达系统的车辆比未配备的同一车型,预计能多避免高达 25% 的碰撞事故,缓解事故影响的能力提升高达 29% 。在逆光场景下,摄像头误判率达 15%,对静止障碍物漏检率是激光雷达的 3.2 倍 。禾赛 AT512 激光雷达测距远,点云密度提升,夜间施工桩桶识别率提高 80% 。这些数据充分表明,激光雷达能够有效弥补摄像头等其他传感器的不足,极大地提升自动驾驶系统的安全性与可靠性。

随着 L3 级有条件自动驾驶法规逐步落地,安全责任主体可能从驾驶员向整车厂转移。面对潜在的高额事故赔偿风险,整车厂为构建超高冗余感知系统,必然会更加倚重激光雷达。在复杂多变的交通环境中,激光雷达提供的安全冗余,能够在关键时刻保障车辆和乘客的安全,成为当下自动驾驶发展中不可或缺的安全保障技术。

谁是最优解?

国内对自驾安全的把控非常严格,这一点从拿到上路测试拍照的公司可以看出。上汽、滴滴、萝卜快跑、新石器、小鹏等几乎无一例外都是基于激光雷达的多模态融合感知方案。

相比于美国,中国的道路场景更加复杂,Robin的观点貌似更适合当下。纯视觉依然有发展空间,但多传感器融合方案更适合目前对安全的要求。

至于特斯拉的Robotaxi是否能够经得起考验,还需要做进一步市场的验证,而这个过程对纯视觉方案,注定会没那么简单。如果没有安全冗余,即使在海量数据的支撑下,遇到极端天气和弱光、强光场景,依然会是非常大的挑战。

参考

[1]https://www.zhihu.com/question/15350351811/answer/130445267305

[2] https://zhuanlan.zhihu.com/p/1918244982894073682

[3] https://mp.weixin.qq.com/s/sFzccqsiJHqwsLEJhFRydQ

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?