作者 | Lijun Zhou等 编辑 | 自动驾驶之心

点击下方卡片,关注“自动驾驶之心”公众号

戳我-> 领取自动驾驶近15个方向学习路线

本文只做学术分享,如有侵权,联系删文

文章:UA-Track: Uncertainty-Aware End-to-End 3D Multi-Object Tracking

链接:https://arxiv.org/pdf/2406.02147

主页:https://liautoad.github.io/ua-track-website/

问题引出

3D 多目标跟踪 (MOT) 是自动驾驶系统感知的重要组成部分。在动态环境中准确而稳健地跟踪目标的能力对于确保平稳安全的导航和合理的决策至关重要。传统的 3D MOT 方法依赖于检测器结果,设计数据关联和轨迹过滤等后处理模块,从而导致流程复杂。为了避免基于检测的跟踪器中人为的启发式设计,端到端基于query查询的最新方法已显示出通过同时检测和跟踪目标来解决 3D MOT 任务的巨大潜力,这些方法在跟踪性能和效率方面表现出色。然而,它们假设周围信息已充分获得,并忽略了 3D MOT 中经常遇到的不确定性问题。如图 1 所示,之前最先进的端到端跟踪器 PF-Track [1]缺乏不确定性建模,无法在具有不确定性问题的复杂场景中跟踪目标。

尽管不确定性问题(指神经网络无法提供确定性估计或信心不足)已在某些领域得到应用,例如动作识别和伪装目标检测等领域,但在 3D MOT 领域尚未得到探索。由于驾驶场景的复杂环境和跟踪任务的独特特点,3D MOT 中的不确定性问题尤其具有挑战性,以前针对其他特定领域的解决方案不能直接应用于此。在驾驶场景中,环境可能非常复杂,通常在城市驾驶时,车辆和行人等众多目标在场景中交织,并且它们的运动模式存在很大变化。此外,被跟踪的目标通常覆盖很大的空间跟踪范围和很长的时间跟踪序列。因此,经常会出现遮挡情况和目标物体的尺寸太小情况,这通常会导致一些目标未被检测或被遮挡的跟踪丢失。这些不确定因素对实现准确和鲁棒的 3D MOT 提出了重大挑战。

框架介绍

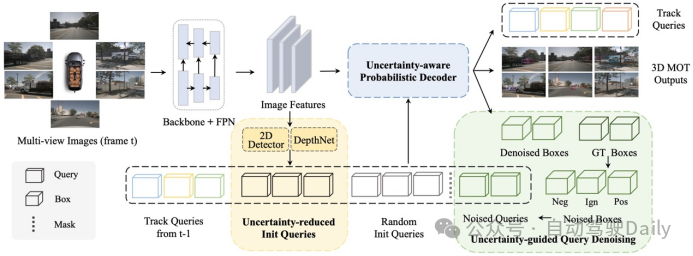

所以,在这个工作中,我们提出了一个不确定性感知的 3D MOT 框架 UA-Track,如图2,从多个方面解决不确定性问题。首先,我们引入了一个不确定性感知的概率解码器来捕获和建模对象预测过程中的不确定性(UPD-蓝色模块)。具体来说,如图3,我们将注意力得分建模为高斯分布而不是确定性的输出,以量化预测不确定性。其次,我们提出了一种不确定性引导的查询去噪策略来进一步改进训练过程(UQD-绿色模块)。在训练阶段,我们向真实边界框添加噪声以形成噪声查询,并根据其不确定性水平有选择地对查询进行去噪,从而增强了训练过程的鲁棒性和对不确定性的收敛性。此外,我们提出了减少不确定性的query初始化模块(UQI-黄色模块),该模块利用预测的 2D目标位置和深度信息,减少query初始化的不确定性,即通过结合学习到的先验知识,提高初始query的准确性,从而获得更可靠的跟踪结果。

关键组件介绍

UPD(Uncertainty-aware Probabilistic Decoder)组件

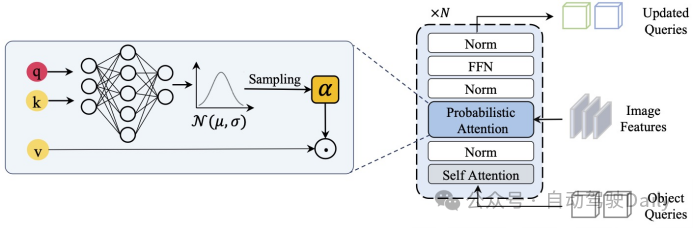

该组件旨在解决3D多目标跟踪(MOT)中的不确定性问题。UPD通过引入概率注意力机制来捕获和建模目标预测过程中的不确定性。具体来说,UPD将传统的确定性注意力分数替换为高斯分布,从而量化预测的不确定性。

在传统的变换器中,注意力分数是通过确定性计算得到的,这限制了模型有效量化预测不确定性的能力。为了解决这个问题,UPD采用多层感知机(MLP)来拟合查询(q)和键(k)的均值(µ)和标准差(σ),从而构建高斯分布。通过重参数化技巧,从构建的高斯分布中采样得到注意力值α。

UPD的主要贡献包括:

通过概率注意力机制,将注意力分数表示为高斯分布,增强了模型在处理3D MOT中的变异和噪声时的鲁棒性。

引入了均值(µ)和标准差(σ)这两个不确定性参数,允许在训练过程中适应不确定性。

使用缩放点积注意力来约束概率注意力,并采用负对数似然损失来监督解码器。

通过这种方式,UPD能够有效地捕捉目标在复杂驾驶场景中的轨迹变化,特别是在目标尺寸和可见性变化较大时,如大型卡车和小孩等不同大小的目标,以及在遮挡情况下的目标。这使得UA-Track框架能够在存在不确定性因素的情况下,如遮挡和小目标尺寸,实现更准确和鲁棒的3D多目标跟踪。

UQD (Uncertainty-guided Query Denoising)组件

UQD旨在增强模型在训练过程中对不确定性的鲁棒性和收敛性。UQD通过查询去噪策略来应对3D多目标跟踪(MOT)中的复杂情况,如遮挡和小目标尺寸,这些情况可能会显著阻碍基于查询的方法的学习过程和快速收敛。

UQD组件的主要特点和贡献包括:

噪声查询生成:通过扰动真实标注框(ground truth boxes)来生成带有噪声的查询(noised queries),模拟训练过程中可能遇到的不确定性。

不确定性阈值:定义了不确定性的上下界阈值(βlower 和 βupper),根据这些阈值将噪声查询分类为三类:低不确定性的正样本(Pos)、高不确定性的负样本(Neg)以及不确定性水平居中的样本(Ign)。正样本是那些与真实标注框的3D交并比(IoU)超过βupper阈值的查询,而负样本是IoU低于βlower阈值的查询。忽略(Ign)那些不确定性水平不明确的查询,以避免干扰正常的查询学习过程。

选择性去噪:基于不确定性水平,选择性地对查询进行去噪处理。这一策略有助于模型专注于那些最需要改进的查询,从而提高训练的稳定性和效率。

损失函数设计:为正样本和负样本计算损失,以形成优化目标。这包括用于分类和边界框损失的焦点损失(focal loss)和L1损失,以及用于区分背景的负样本分类的焦点损失。

注意力掩码:应用注意力掩码来分离匹配部分和去噪部分,防止信息泄露,确保模型在去噪过程中能够正确地学习和更新。

通过UQD组件,UA-Track框架能够在训练时更加鲁棒地处理不确定性,提高模型对遮挡和小目标尺寸等复杂情况的处理能力,从而在3D MOT任务中取得更好的跟踪性能。

UQI (Uncertainty-reduced Query Initialization)组件

UQI专注于改善查询初始化阶段的不确定性,从而提高目标跟踪的精度和快速收敛。在多目标跟踪中,尤其是在存在遮挡和小目标尺寸等复杂情况下,高质量的初始查询对于实现精确的跟踪至关重要。

UQI模块的主要特点和贡献包括:

辅助任务:引入额外的辅助任务,包括2D检测和深度预测,以利用从网络训练中学到的先验知识。

特征提取:使用共享图像主干和特征金字塔网络(FPN)层从每个摄像头提取图像特征。

深度网络:结合多个残差块构建深度网络,并使用投影的激光雷达点进行监督,以预测深度信息。

坐标转换:通过坐标转换估计3D位置,将2D边界框和深度信息转换为相机坐标系到激光雷达坐标系的转换矩阵和相机的内在参数。

查询初始化:利用预测的2D对象位置和深度信息初始化对象查询,减少查询初始化阶段的不确定性。

随机初始化保留:除了基于学习的初始化外,还保留随机初始化以探索可能遗漏的对象。

优化目标:为两个辅助任务定义了优化目标,包括2D检测损失和深度损失。

通过UQI模块,UA-Track能够在查询初始化阶段就减少不确定性,提高初始对象定位的准确性,从而在整个跟踪过程中实现更可靠的跟踪结果。这种初始化策略有助于提高模型对于遮挡和小目标尺寸等复杂情况的鲁棒性,进而在3D多目标跟踪任务中取得更好的性能。

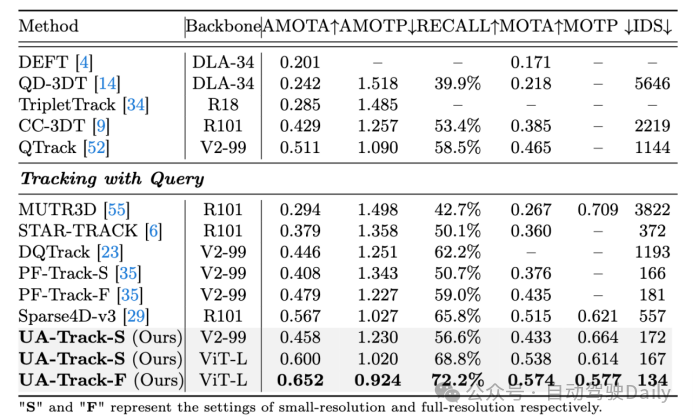

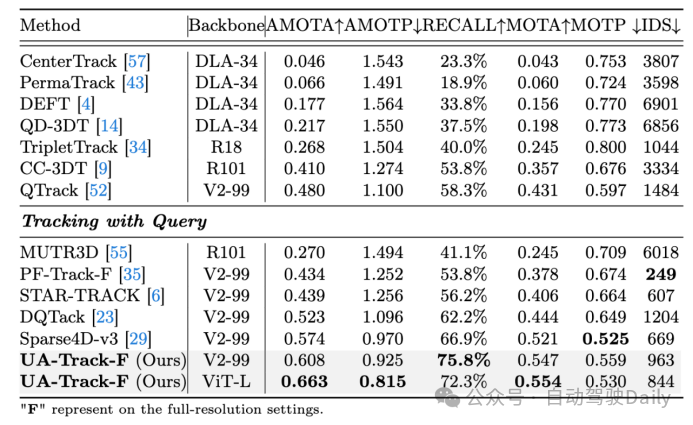

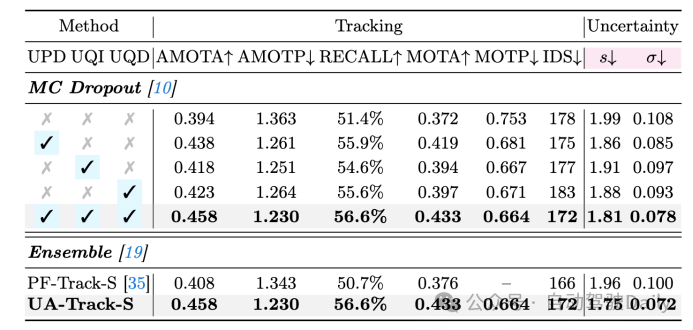

nuScenes数据量化指标

我们在nuScenes 上的实验结果证明了我们的 UA-Track 框架的有效性。它在测试集中以令人印象深刻的 66.3% AMOTA 实现了最先进的性能,远远超过了之前最好的端到端解决方案 8.9% AMOTA。这些结果强调了解决 3D MOT 中不确定性问题的重要性,并展示了我们的不确定性感知框架在推动自动驾驶感知领域发展的潜力。

总结

在本文中,我们提出了一个名为UA-Track的不确定性感知的3D多目标跟踪框架,它从多个方面有效解决了3D MOT中的不确定性问题。我们的框架突出了解决3D MOT中不确定性问题的重要性,尤其是目标对象的遮挡和小尺寸问题,并展示了其在推进自动驾驶感知方面的潜力。尽管我们的方法在三个方面有效地模拟了不确定性,但我们鼓励未来的研究可以开发更强大的框架,以进一步量化和解决更多的不确定性问题。我们希望我们的工作能够启发未来关于不确定性问题的研究。

此外,我们还提供了一些额外的细节和结果,包括深度网络的细节、不确定性分析的细节、检测结果、推理延迟和附加可视化效果。这些额外的信息进一步证明了我们方法的有效性和实用性。

引用:

【1】Pang, Z., Li, J., Tokmakov, P., Chen, D., Zagoruyko, S., Wang, Y.X.: Standing between past and future: Spatio-temporal modeling for multi-camera 3d multi- object tracking. In: Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. pp. 17928–17938 (2023)

投稿作者为『自动驾驶之心知识星球』特邀嘉宾,欢迎加入交流!

① 全网独家视频课程

BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、大模型与自动驾驶、Nerf、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

② 国内首个自动驾驶学习社区

国内最大最专业,近3000人的交流社区,已得到大多数自动驾驶公司的认可!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(2D/3D检测、语义分割、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型、端到端等,更有行业动态和岗位发布!欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦感知、定位、融合、规控、标定、端到端、仿真、产品经理、自动驾驶开发、自动标注与数据闭环多个方向,目前近60+技术交流群,欢迎加入!扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】全平台矩阵

335

335

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?