作者 | 汽车人 编辑 | 自动驾驶Daily

点击下方卡片,关注“自动驾驶之心”公众号

ADAS巨卷干货,即可获取

点击进入→自动驾驶之心【占用网络】技术交流群

本文只做学术分享,如有侵权,联系删文

原标题: UniOcc: Unifying Vision-Centric 3D Occupancy Prediction with Geometric and Semantic Rendering

论文链接:https://arxiv.org/pdf/2306.09117.pdf

作者单位:小米汽车 北京大学

论文思路:

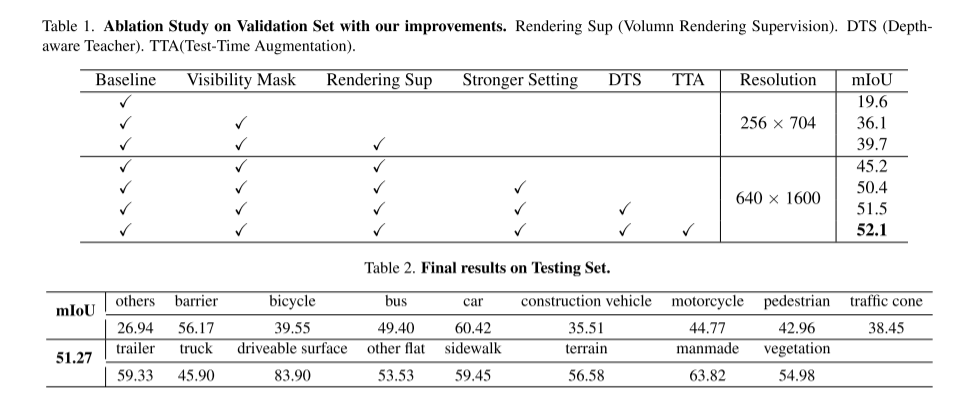

在这份技术报告中,本文提出了本文的解决方案,命名为UniOCC,用于在CVPR 2023 nuScenes Open Dataset Challenge中以视觉为中心的3D占用预测轨道。现有的占用预测方法主要侧重于使用三维占用标签优化三维volume空间的投影特征。然而,这些标签的生成过程非常复杂和昂贵(依赖于3D语义标注),并且受体素分辨率的限制,它们不能提供细粒度的空间语义。为了解决这一限制,本文提出了一种新的统一占用(UniOcc)预测方法,明确施加空间几何约束,并通过体射线渲染(volume ray rendering)补充细粒度语义监督。本文的方法显著提高了模型的性能,并在降低人工标注成本方面展示了良好的潜力。考虑到标注3D占用的费力性,本文进一步提出了深度感知的Teacher Student(DTS)框架,以提高使用无标记数据的预测精度。本文的解决方案在官方单模型排行榜上获得51.27% mIoU,在本次挑战赛中排名第三。

网络设计:

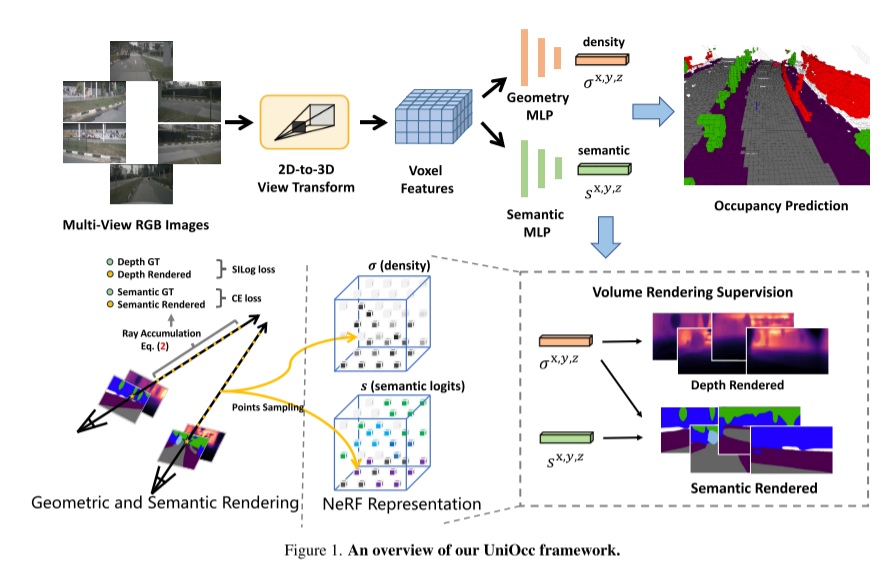

在这一挑战中,本文提出了UniOcc,这是一种利用体渲染(volume rendering)来统一二维和三维表示监督的通用解决方案,改进了多摄像机占用预测模型。本文没有设计新的模型架构,而是将重点放在以通用和即插即用的方式增强现有模型[3,18,20]上。

本文将占用表示提升到NeRF-style表示[1,15,21],允许使用体渲染(volume rendering)生成2D语义和深度地图。这使本文能够在2D像素级别上执行细粒度的监督。通过对通过三维体素的射线进行采样,得到所渲染的二维像素语义和深度信息。这种几何遮挡关系和语义一致性约束的显式集成为模型提供了显式的指导,并确保遵守这些约束。

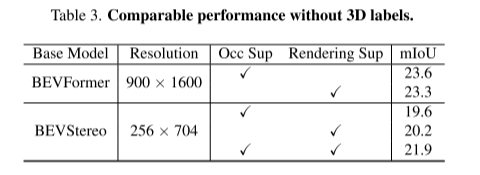

值得一提的是,UniOcc有潜力减少对昂贵的3D语义标注的依赖。在没有3D占用标签的情况下,仅使用本文的体渲染(volume rendering)监督进行训练的模型,甚至比使用3D标签监督进行训练的模型表现更好。这突出了减少对昂贵的3D语义标注的依赖的令人兴奋的潜力,因为场景表示可以直接从负担得起的2D分割标签学习。此外,利用SAM[6]和[14,19]等先进技术,还可以进一步降低二维分割标注的成本。

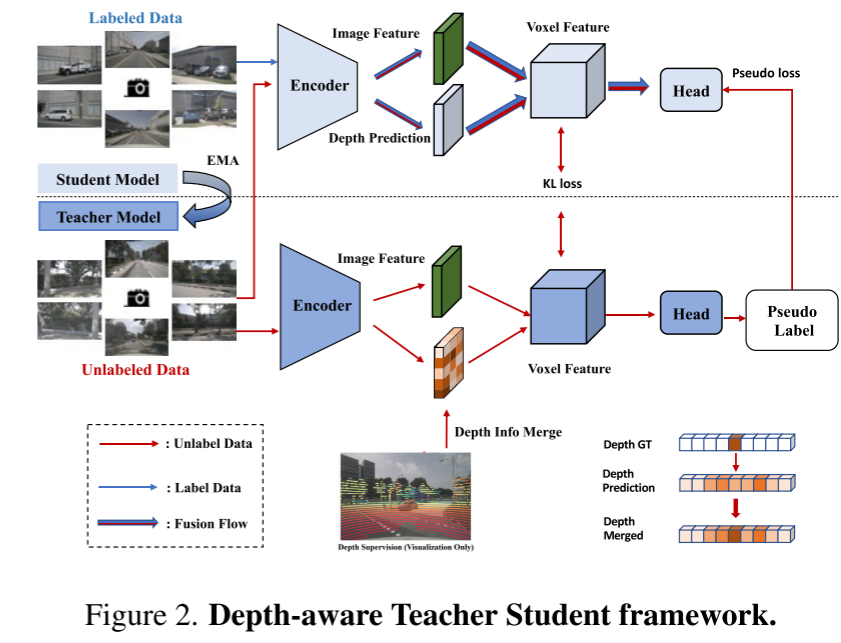

本文还介绍了深度感知Teacher Student(DTS)框架,这是一种自监督的训练方法。与经典的Mean Teacher[16]不同,DTS增强了教师模型的深度预测,在利用无标记数据的同时实现稳定和有效的训练。此外,本文应用了一些简单而有效的技术来提高模型的性能。这包括在训练中使用visible masks,使用更强的预先训练的骨干,增加体素分辨率,以及实现Test-Time Augmentation(TTA)。

图1。本文的UniOcc框架的概述。

图2。深度感知的Teacher-Student框架。

实验结果:

引用:

Pan, M., Liu, L., Liu, J., Huang, P., Wang, L., Zhang, S., Xu, S., Lai, Z., & Yang, K. (2023). UniOcc: Unifying Vision-Centric 3D Occupancy Prediction with Geometric and Semantic Rendering. ArXiv. /abs/2306.09117

① 全网独家视频课程

BEV感知、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、协同感知、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

视频官网:www.zdjszx.com

视频官网:www.zdjszx.com

② 国内首个自动驾驶学习社区

近2000人的交流社区,涉及30+自动驾驶技术栈学习路线,想要了解更多自动驾驶感知(2D检测、分割、2D/3D车道线、BEV感知、3D目标检测、Occupancy、多传感器融合、多传感器标定、目标跟踪、光流估计)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、AI模型部署落地实战、行业动态、岗位发布,欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频,期待交流!

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦目标检测、语义分割、全景分割、实例分割、关键点检测、车道线、目标跟踪、3D目标检测、BEV感知、多模态感知、Occupancy、多传感器融合、transformer、大模型、点云处理、端到端自动驾驶、SLAM、光流估计、深度估计、轨迹预测、高精地图、NeRF、规划控制、模型部署落地、自动驾驶仿真测试、产品经理、硬件配置、AI求职交流等方向。扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】平台矩阵,欢迎联系我们!

16万+

16万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?