>>> import torch

>>> import torch.nn.functional as F

>>> from math import *

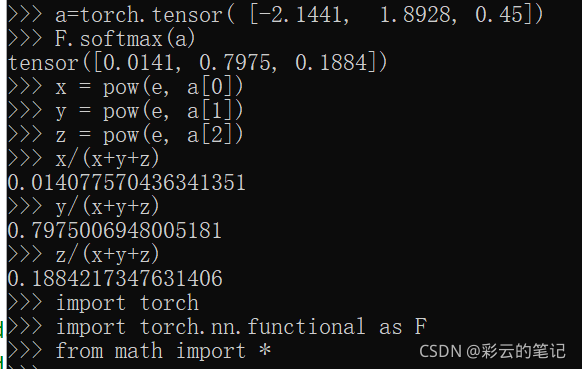

>>> a=torch.tensor( [-2.1441, 1.8928, 0.45])

>>> F.softmax(a)

tensor([0.0141, 0.7975, 0.1884])

>>> x = pow(e, a[0])

>>> y = pow(e, a[1])

>>> z = pow(e, a[2])

>>> x/(x+y+z)

0.014077570436341351

>>> y/(x+y+z)

0.7975006948005181

>>> z/(x+y+z)

0.1884217347631406

这篇博客介绍了如何在PyTorch中使用softmax函数和指数运算,并展示了计算softmax概率和比例的方法。通过实例演示了如何将softmax应用于实际场景,以及与手动指数运算结果的对比。

这篇博客介绍了如何在PyTorch中使用softmax函数和指数运算,并展示了计算softmax概率和比例的方法。通过实例演示了如何将softmax应用于实际场景,以及与手动指数运算结果的对比。

1355

1355

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?