Softmax简介

Softmax 是一个用于多类别分类问题的激活函数,它通常用于神经网络的输出层。

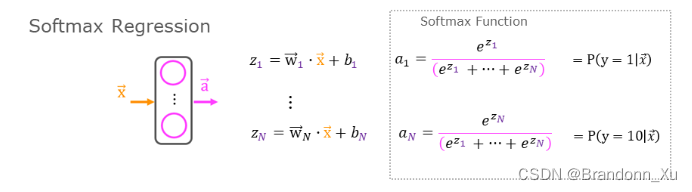

Softmax 函数将一个实数向量转换为概率分布,其中每个元素表示一个类别的概率。

简单来说,Softmax的输出代表了一个样本属于某一类别的概率。

输出是概率分布:Softmax 将输入转换成一个概率分布,其中每个元素表示相应类别的概率。这意味着所有输出元素的总和将等于 1。

分类任务:Softmax 常用于多类别分类问题,其中有多个互斥的类别需要被分配概率。

图中,an代表了该y=n的概率预测。

注意:实际操作中,并不推荐使用y=10这样的形式,因为会使得成本函数计算时产生偏见,即10本身会让成本函数变大。推荐使用下文中的one-hot独热编码对标签进行重构。

One-hot独热编码

独热编码(One-Hot Encoding)是一种用于将分类数据转换成机器学习算法可以更好理解的形式的技术。它常用于处理分类特征,将每个分类

本文介绍了用于多类别分类问题的激活函数Softmax,它将实数向量转换为概率分布。还提到了One-hot独热编码技术,用于处理分类特征。阐述了softmax的成本函数——多分类交叉熵,最后给出了Tensorflow代码实现及优化思路,以减少精度丢失。

本文介绍了用于多类别分类问题的激活函数Softmax,它将实数向量转换为概率分布。还提到了One-hot独热编码技术,用于处理分类特征。阐述了softmax的成本函数——多分类交叉熵,最后给出了Tensorflow代码实现及优化思路,以减少精度丢失。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

942

942