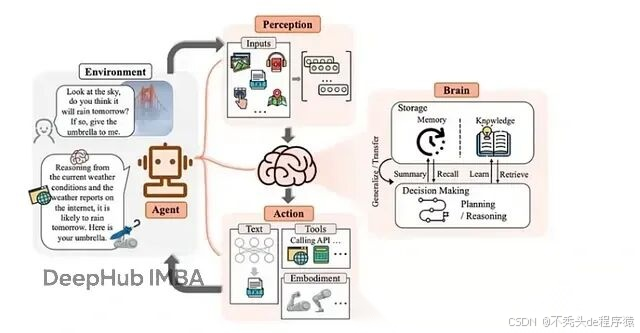

AutoGen 是微软研究院开源的多智能体 AI 系统框架。这个框架的设计思路很简单——让多个 AI 智能体(加上人类参与)在对话中完成复杂任务的协作和推理。

你甚至可以把它理解成一个团队聊天室,智能体们在里面讨论、争论、协作,最终得出解决方案。

AutoGen 通过创建多个专门化智能体,为每个智能体设定自己的角色、目标,来达到上面说的聊天能力,并且还能通过配置工具来获得代码执行能力。智能体之间通过消息机制通信,互相配合完成任务。

AutoGen 为什么值得关注

AutoGen 真正好玩的地方在于它实现了 AI 之间的协作。智能体可以相互辩论、推理、纠错、共同创造,整个过程不需要人工逐步编写脚本,设置可以不需要人工的参与。

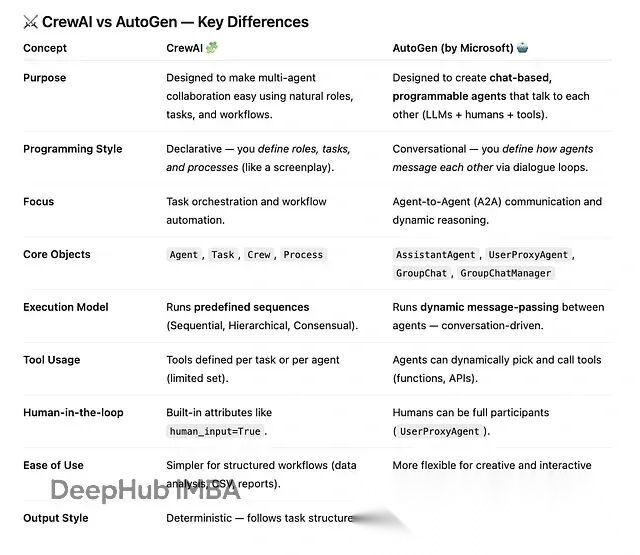

相比于CrewAI,AutoGen 则把重点放在讨论、推理和演化上,而CrewAI 更关注执行层面。

你可以理解为CrewAI更像是我们现在用的工作助手,而AutoGen 更像是圆桌会议。

AutoGen 框架处理了很多底层问题,这样我们可以只专著于如何编排角色和任务。

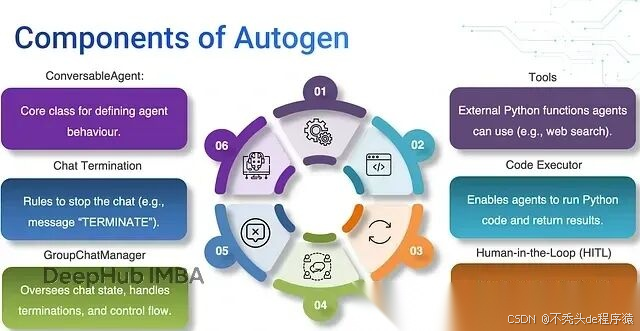

AutoGen 定义了三类核心智能体:

- Conversable Agent:负责管理结构化对话和预定义的交互模式

- Assistant Agent:执行具体任务,调用工具或 LLM

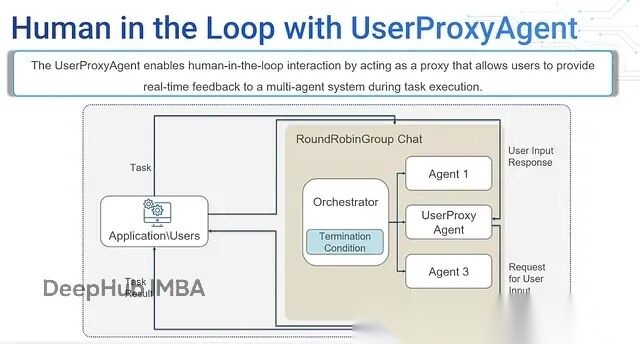

- UserProxy Agent:充当人机接口层,转发消息和响应

简单的群聊演示

from autogen import ConversableAgent, AssistantAgent, UserProxyAgent, GroupChat, GroupChatManager

# Define AssistantAgent (AI assistant)

assistant = AssistantAgent(

name="AssistantAgent",

system_message="You are a helpful AI assistant. Suggest Python code when relevant.",

human_input_mode="NEVER" # No human input required, runs automatically

)

# Define UserProxyAgent (represents human)

user_proxy = UserProxyAgent(

name="UserProxyAgent",

human_input_mode="ALWAYS" # Requires human input

)

# Define group chat

chat = GroupChat(

agents=[assistant, user_proxy],

messages=[]

)

# Manage group chat with GroupChatManager

manager = GroupChatManager(

groupchat=chat,

llm_config={"model": "gpt-5-mini"}

)

# Start the chat

user_proxy.initiate_chat(

manager,

message="Write a short Python function to calculate factorial."

)

AutoGen 核心概念详解

1、Human-in-the-Loop(人工参与)

这个功能让人类可以在智能体执行过程中进行干预。

# Human-in-the-Loop example

from autogen import AssistantAgent, UserProxyAgent

# Step 1: Create assistant agent

assistant = AssistantAgent(

name="code_writer",

system_message="You are a helpful coding assistant."

)

# Step 2: Create user proxy with human-in-the-loop enabled

user = UserProxyAgent(

name="human_user",

human_input_mode="ALWAYS" # 👈 Enable human confirmation

)

# Step 3: Start conversation

user.initiate_chat(

assistant,

message="Write a Python function to calculate factorial."

)

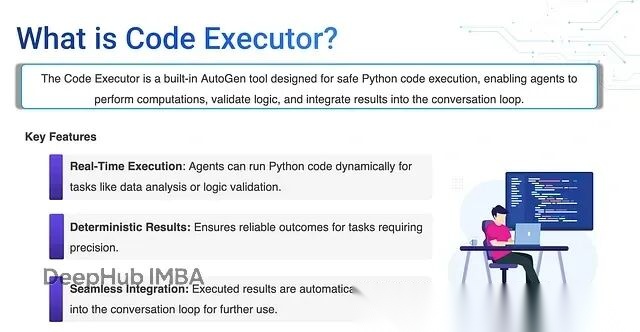

2、Code Executor 的工作机制

Code Executor 负责安全执行智能体生成的代码。

# Behind the scenes

# AssistantAgent generates code:

sum([x for x in range(1, 21) if x % 2 == 0])

# PythonCodeExecutor automatically:

# - Executes safely in sandbox

# - Captures output

# - Returns result to agent

# UserProxyAgent displays result:

✅ Result: 110

# Optional: Add human approval

user = UserProxyAgent(

name="human_user",

code_execution_config={"executor": executor},

human_input_mode="ALWAYS"

)

3、工具集成方式

工具通过初始化时的 tools 参数传入智能体。

from autogen import AssistantAgent, UserProxyAgent, Tool

# Define tool function

def multiply_numbers(a: int, b: int) -> int:

"""Returns the product of two numbers."""

return a * b

# Wrap as Tool object

multiply_tool = Tool(

func=multiply_numbers,

name="multiply_tool",

description="Multiplies two numbers and returns the product."

)

# Create agent and integrate tool

assistant = AssistantAgent(

name="math_agent",

system_message="You are a math assistant. Use multiply_tool when needed.",

tools=[multiply_tool]

)

user = UserProxyAgent(name="human_user")

user.initiate_chat(

assistant,

message="Can you multiply 8 and 7?"

)

4、多智能体协作模式

AutoGen 对话系统的核心特征是支持多智能体协作对话模式。

# Example: Multi-agent conversational pattern

from autogen import AssistantAgent, ReviewerAgent, UserProxyAgent, PythonCodeExecutor

executor = PythonCodeExecutor()

# Coder agent

coder = AssistantAgent(

name="coder_agent",

system_message="You are a code-writing assistant."

)

# Reviewer agent

reviewer = ReviewerAgent(

name="reviewer_agent",

system_message="You are a code reviewer. Check logic and security."

)

# User proxy

user = UserProxyAgent(

name="human_user",

human_input_mode="TERMINATE",

code_execution_config={"executor": executor}

)

def run_multi_agent_workflow(prompt: str):

coder_response = coder.chat_with(user, message=prompt)

print("Coder ->", coder_response["content"])

reviewer_response = reviewer.review(code={"code": coder_response["content"]})

print("Reviewer ->", reviewer_response["content"])

if "SUGGEST_CHANGES" in reviewer_response["content"]:

revision = coder.chat_with(reviewer, message=reviewer_response["content"])

final_code = revision["content"]

else:

final_code = coder_response["content"]

print("Waiting for human approval...")

if not user.get_human_approval(final_code):

print("Human rejected execution.")

return

exec_result = executor.execute(final_code)

print("Execution result ->", exec_result["output"])

if __name__ == "__main__":

run_multi_agent_workflow("Write a Python function prime_factors(n).")

这个例子展示了多智能体协作的几个关键点:Coder、Reviewer、User 各司其职完成协作,然后通过Reviewer 把关代码的安全性和质量,HITL 模式给人类最终审批权,最后可以通过Code Executor 在沙箱环境安全执行代码

5、会话终止机制

会话会在满足终止条件时结束,这样一个整个的”会议“就结束了

from autogen import AssistantAgent, UserProxyAgent

def is_termination_msg(message):

"""Returns True when message contains TERMINATE keyword."""

return "TERMINATE" in message["content"].upper()

assistant = AssistantAgent(

name="helper_agent",

system_message="Stop when receiving 'TERMINATE'."

)

user = UserProxyAgent(

name="human_user",

is_termination_msg=is_termination_msg

)

user.initiate_chat(assistant, message="Hello, explain recursion in simple terms.")

assistant.send({"role": "user", "content": "Thanks, that's clear. TERMINATE"})

总结

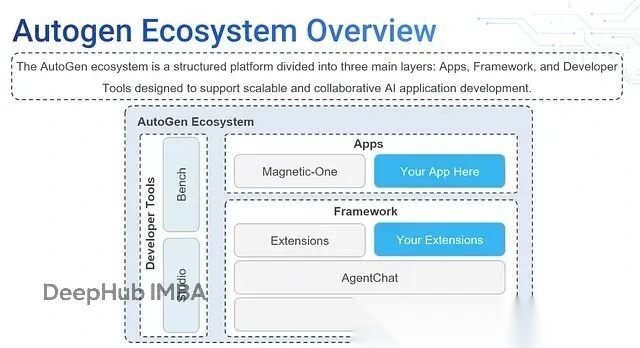

AutoGen 提供了构建复杂 AI 协作系统的完整支持,覆盖了角色结构、通信机制、人工参与、工具集成、代码执行和多智能体协作设计等各个方面。框架把底层复杂度封装得很好,开发者可以专注在业务逻辑和智能体设计上。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

174

174

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?