生成式人工智能(GenAI)近年来发展迅速,大语言模型成为这一浪潮的核心力量。无论是商业还是开源模型,它们都具备强大的语言理解与生成能力,正广泛应用于内容创作、聊天机器人等场景,让企业更容易落地智能应用。

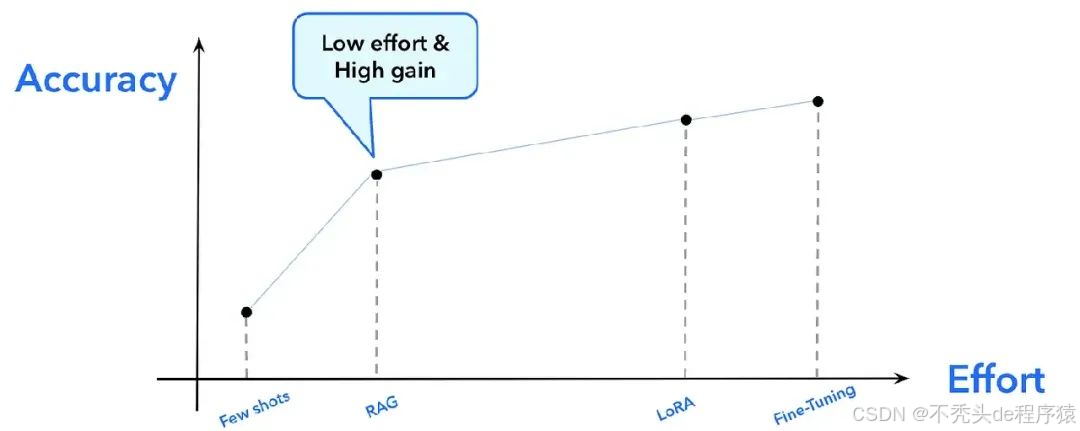

但一个关键挑战是如何让这些通用的 LLM 更懂特定领域,同时保持知识的时效性。目前常用的方法各有优劣:比如少样本学习简单易用,但能处理的信息有限;LoRA 和监督微调效果更精准,但需要专业知识和大量计算资源,对普通人或小公司来说门槛较高。

1. RAG 是准确性和成本的一种权衡

检索增强生成(RAG)是一种相对简单、成本较低且效果不错的方法,正在被越来越多的企业采用。它通过引入外部知识库,帮助大模型(LLM)回答更专业或更新的问题。具体来说,RAG 会先把知识资料分成小块,并把这些内容转化为向量形式存储在数据库中。当用户提出问题时,系统会先找出与问题最匹配的知识向量,再结合这些信息生成更准确的回答。

根据在 2024 年的一份调查报告,RAG 的使用率增长非常显著:2024 年有 63.6% 的受访者表示正在使用 RAG,远高于 2023 年的 20%。尤其是员工人数超过 5000 的大公司,约有三分之一已经开始利用 RAG 或向量数据库来优化自己的 AI 模型。这说明向量数据库在提升 LLM 能力方面正变得越来越重要。

但随着 RAG 技术的广泛应用,我们也必须关注它带来的安全风险。例如,外部知识库可能包含敏感信息,或者检索过程可能被恶意操控。因此,在享受 RAG 带来的便利的同时,也需要采取相应的措施来防范潜在的安全问题。

2. RAG 的安全威胁

基于 RAG 的系统面临三大主要威胁:

2.1. 数据污染

当系统使用不可信的外部数据(比如未经审核的公开资料或用户上传的内容)时,恶意信息可能混入数据库。这些有毒数据会被 RAG 机制检索到,并影响最终输出结果。例如,攻击者可能通过这种方式植入广告、钓鱼链接,甚至破坏系统正常功能。更严重的是,这类污染会影响大量用户,造成连锁反应。

2.2. 信息泄露

RAG 系统存储的知识库可能包含敏感信息。如果防护不足,攻击者可以通过精心设计的提问,让系统"倒带"出机密数据。即便数据本身经过分类处理,黑客仍可能通过分析检索结果推断出原始内容。值得注意的是,即使 AI 只做分类任务(不生成新内容),嵌入向量中仍可能残留敏感信息,这些向量本身也可能是敏感数据。

2.3. 系统瘫痪风险(DDoS)

RAG 对大规模知识库的检索需要大量计算资源。如果系统设计存在漏洞,攻击者可能通过发送海量请求耗尽服务器资源,导致服务变慢甚至完全停摆。这种攻击就像让快递员同时处理数万件包裹,最终谁都送不了。

这三个问题提醒我们:在享受 RAG 技术便利的同时,必须建立严格的数据审核机制、设置访问权限控制,并做好系统抗压测试,才能真正发挥这项技术的潜力。

3. RAG中的风险因素

要判断 RAG 系统的安全风险,需要关注以下这些会影响攻击可能性和危害程度的因素:

数据来源:如果知识库里的数据来自不可靠的渠道(比如用户随便上传的内容或未经审核的公开资料),就更容易被恶意信息污染。最安全的数据是公司内部人员亲自整理或审核过的资料。

使用对象:只供员工使用的系统风险最低,因为员工不太可能故意破坏数据。对注册用户开放的系统风险次之,但通过监控用户行为可以降低威胁。完全向公众开放的系统最容易被攻击。

数据重要性:如果知识库里有敏感信息(比如客户隐私或商业机密),一旦泄露后果会非常严重。相比之下,公开数据即使被泄露影响也较小。

系统配置:如果多个用户共享同一个 RAG 系统(比如不同客户共用一个知识库),但配置不当,可能会导致数据泄露。例如,一个客户的资料被错误地展示给另一个客户。

数据规模:数据越多,泄露后造成的损失越大。同时,庞大的数据量会让系统运行变慢,攻击者可能利用这一点发起“系统瘫痪”攻击。

AI 任务类型:如果 AI 需要生成完整文字(比如写文章或回复邮件),攻击者更容易通过输出窃取信息。但如果 AI 只做分类判断(比如判断真假),信息泄露的可能性会小一些。

数据更新机制:如果系统自动更新知识库但缺乏审核,攻击者可能趁机植入恶意数据。此外,如果系统没有清理过时内容,数据库会变得混乱,影响性能。

系统扩展能力:如果系统在处理大量数据或请求时容易卡顿,攻击者可能通过发送大量请求让它崩溃。

输入长度限制:如果允许用户输入超长文本,攻击者可能借此操控 AI,让它执行危险操作。

权限管理:如果登录系统的人可以随意修改知识库内容,攻击者可能篡改数据或植入恶意信息。

检索范围:每次查询返回的数据越多,意外泄露信息的可能性就越大。需要明确每次最多能返回多少条结果。

嵌入模型选择:如果使用的是公开的通用模型,攻击者更容易研究它的弱点。而定制开发的模型虽然更安全,但成本也更高。

对AI Agent的影响:如果 RAG 系统为其他 AI 提供决策依据,攻击者可能通过篡改数据误导 AI 执行危险操作,比如调用错误的工具。

这些因素相互关联,共同决定了 RAG 系统的安全水平。合理设计系统、严格审核数据来源、控制用户权限,并定期检查系统漏洞,是降低风险的关键。

4. 面向RAG安全性的缓解措施

为确保基于 RAG 的应用程序安全,我们需要结合多种缓解策略,针对不同威胁场景构建防御体系。虽然并非所有方法都适用于每种情况,但掌握这些工具并灵活运用是提升系统安全性的关键。

在数据交互层面,可通过“提示词修补”技术降低有毒数据的影响。具体方法是在检索到的上下文中添加明确标记,明确区分指令与内容,避免模型误将恶意数据当作可执行命令。同时,设置相似性阈值也是重要手段:通过量化输入查询与数据库向量的匹配度,过滤掉低相关性或潜在风险的检索结果。当无法找到足够匹配项时,系统应主动拒绝处理并提示“无法协助此类请求”,既避免错误输出,也减少幻觉风险。

针对数据污染问题,分布外检测机制能有效识别异常数据。当数据源来自不可信渠道或更新频率过高时,系统应自动分析数据分布特征,剔除偏离正常范围的样本,从而切断数据中毒的传播路径。此外,实施速率限制策略可防止恶意用户通过高频请求耗尽系统资源,例如设置单位时间内单用户查询次数上限,这能显著降低 DDoS 攻击的成功率。

在数据管理层面,需建立双重防护体系:一是通过在线和离线扫描工具,在数据入库和实时更新阶段检测威胁性内容(如“忽略先前指示”等危险指令),二是采用基于角色的访问控制(RBAC)机制,严格限定数据写入权限,确保只有授权用户能修改 RAG 知识库。对于敏感数据,还应应用去识别技术,自动屏蔽姓名、电话号码等隐私信息,从源头降低数据泄露的可能性。

人为干预同样不可或缺。即使有自动化防护,定期人工审核可疑数据仍是重要防线。通过抽样检查数据集,可及时发现自动化系统遗漏的风险点。同时,渗透测试是验证防御效果的有效方式:利用 Llama Guard 等工具模拟攻击场景,主动探测提示注入和数据泄露漏洞,持续优化系统鲁棒性。

在技术实现层面,扇出机制能提升动态 RAG 的稳定性。通过优先处理高频检索项或最新输入数据,系统可避免过时信息干扰当前任务。此外,执行模式绑定技术值得借鉴:当模型需生成特定格式输出(如布尔值判断)时,强制约束输出格式,使检索结果无法直接泄露原始数据。这种设计既能满足业务需求,又能通过结构化输出降低信息外泄风险。

这些措施共同构建起多层防御体系,从数据源头控制到系统运行监控,形成闭环保护。通过技术手段与人工策略的有机结合,我们才能在享受 RAG 技术便利的同时,有效应对潜在安全威胁。

5. RAG安全性的风险评估清单

在评估基于RAG的应用程序的风险时,提出正确的问题至关重要。每个组织都有其独特的关注点,但以下内容为开始提供了坚实的基础:

| 风险项 | 自检问题 |

|---|---|

| 数据源 | 1. RAG使用了什么数据源?(用户数据/第三方/内部) 2.新数据的更新频率?(无更新/年/月/日) 3.什么触发了更新?(用户请求/内部请求/定时) 4. 采用了什么消毒技术?(文本过滤/嵌入校正) |

| 信息敏感 | 5.RAG存储了哪些信息类型?(共有/私有/敏感/PII) 6.如何保护敏感信息的非授权访问? 7.是否执行了渗透测试? 8.是否执行了去标识化?(无/过滤/掩码) |

| 应用 | 9.什么类型的LLM任务(分类/文本生成/…) 10.系统的目标用户是谁?(内部员工/登录用户/大众用户) 11.RAG的结果是否影响Agent的动作? 12.是否有输入的最大长度限制? |

| RAG | 13.一次query的响应中, RAG返回的条目数量是多少?(1/10/100) 14. RAG中存储的最小记录长度? 15. 存储在RAG中的数据容量? 16. RAG中使用的嵌入模型?(公开|定制) |

| 安全保护 | 17.如果RAG没有返回数据,是否有提示? 18. 如何处理可伸缩性和性能? 19. RAG中的人工干预点有哪些? 20. 有没有额外的安全防护?(阈值/输出过滤/schema增强) |

6.小结

RAG架构通过整合外部知识库中的上下文信息,显著提升了大语言模型的响应准确性和任务执行效率。然而,这一架构也引入了新的安全风险:数据污染(恶意信息注入)、敏感信息泄露(知识库内容外泄)以及分布式拒绝服务攻击(系统资源耗尽)。开发人员需深入理解这些威胁的风险因素,并采取多层次的安全防护措施——包括严格的数据源审核、访问权限控制、动态检索优化等——才能在充分利用RAG技术优势的同时保障系统的稳定性与安全性。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

如果你真的想学习大模型,请不要去网上找那些零零碎碎的教程,真的很难学懂!你可以根据我这个学习路线和系统资料,制定一套学习计划,只要你肯花时间沉下心去学习,它们一定能帮到你!

大模型全套学习资料领取

这里我整理了一份AI大模型入门到进阶全套学习包,包含学习路线+实战案例+视频+书籍PDF+面试题+DeepSeek部署包和技巧,需要的小伙伴文在下方免费领取哦,真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

部分资料展示

一、 AI大模型学习路线图

整个学习分为7个阶段

二、AI大模型实战案例

涵盖AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,皆可用。

三、视频和书籍PDF合集

从入门到进阶这里都有,跟着老师学习事半功倍。

四、LLM面试题

五、AI产品经理面试题

六、deepseek部署包+技巧大全

😝朋友们如果有需要的话,可以V扫描下方二维码联系领取~

1035

1035

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?