前言

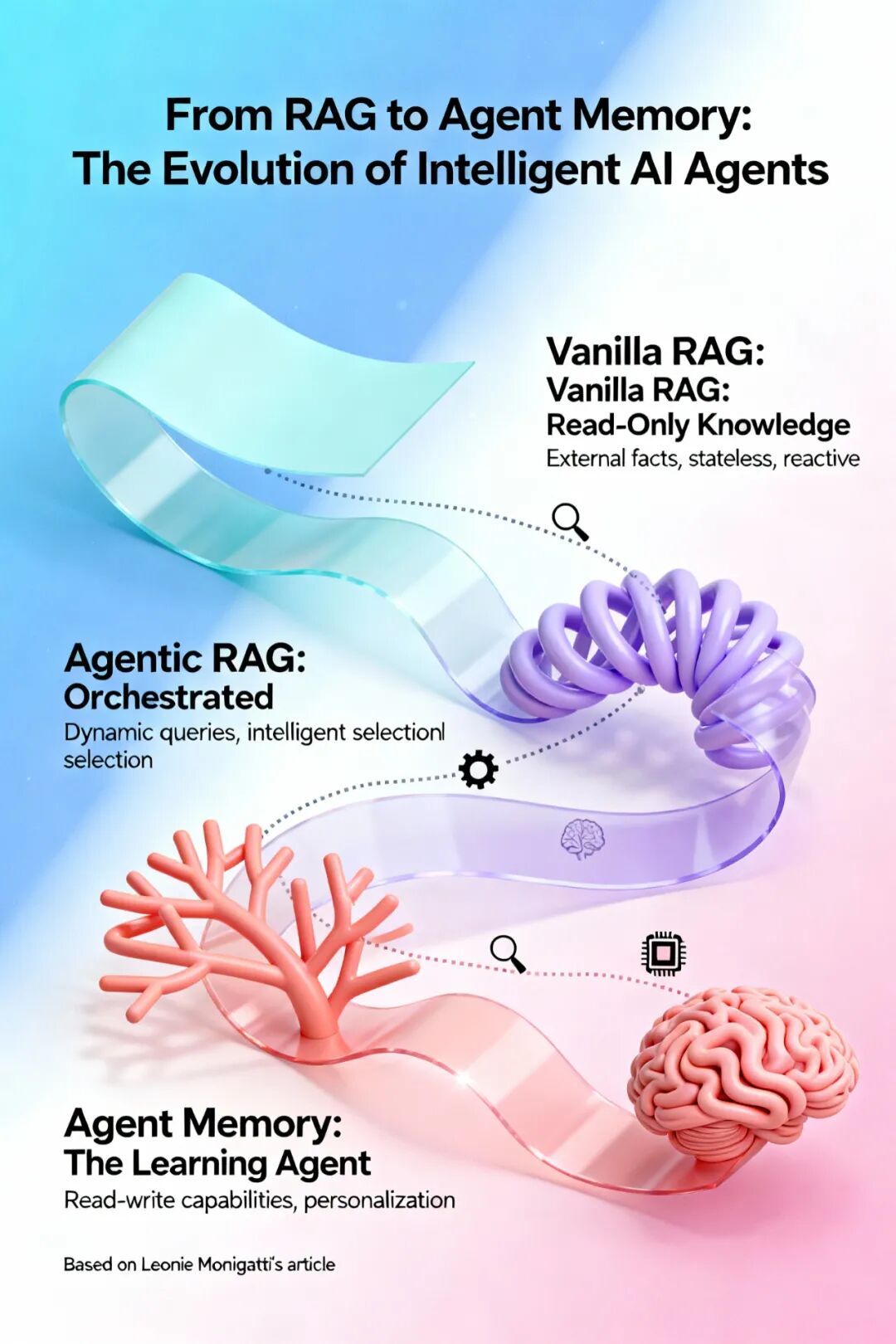

这篇文章将带你走过一条清晰的演进路径:从传统的 RAG,到更强的 Agentic RAG,再到具备持久“记忆”的智能体(Agent Memory)。你将理解为什么我们需要从纯检索走向可规划、可反思的代理式检索,并最终引入可写可读的长期记忆来沉淀知识、偏好与技能。

一、RAG 是什么?

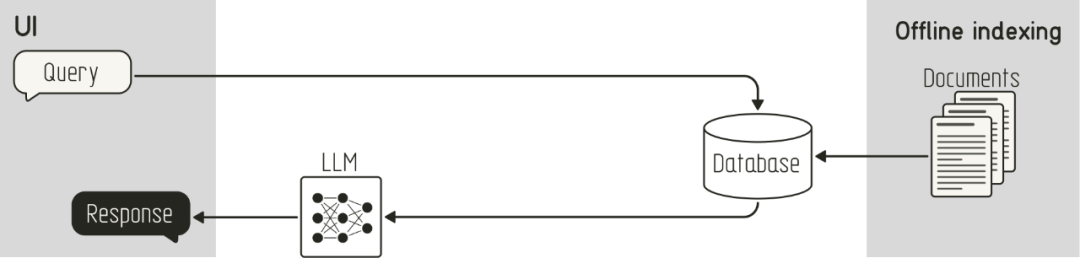

RAG(Retrieval-Augmented Generation),即检索增强生成,是一种用外部检索来补充大模型上下文的技术。

其典型流程是:

- 查询 (Query):用户提出问题。

- 向量检索 (Vector Retrieval):将查询向量化,在知识库中搜索相似内容。

- 选取 (Select):选取相似度最高的 top-k 个文档片段。

- 拼接 (Concatenate):将这些片段拼接进提示词 (Prompt)。

- 生成 (Generate):大模型基于增强后的上下文生成答案。

核心优势:RAG 能有效降低模型幻觉、注入时效性信息和领域专有知识。

核心短板:它对“查询质量、检索质量、拼接上下文长度”高度敏感,且是一次性、静态地检索,缺乏迭代推理与反思能力。

二、RAG 的局限性

传统 RAG 就像一个“一锤子买卖”的学生,查一次资料就直接交卷,这导致了几个明显问题:

- 检索一次定输赢复杂问题需要分步提问和多轮取证,但 RAG 往往只检索一轮、固定返回 top-k 个结果,无法深入探究。

- 上下文拥挤与信息稀释长文档被切块后,语义可能断裂。如果 top-k 结果中混入了噪声(不相关的片段),反而会污染上下文,影响最终的生成质量。

- **不会“学以致用”**RAG 不会将新获得的信息“记住”。在后续的任务中,它无法复用之前已经获得的知识或用户的偏好,每次都从零开始。

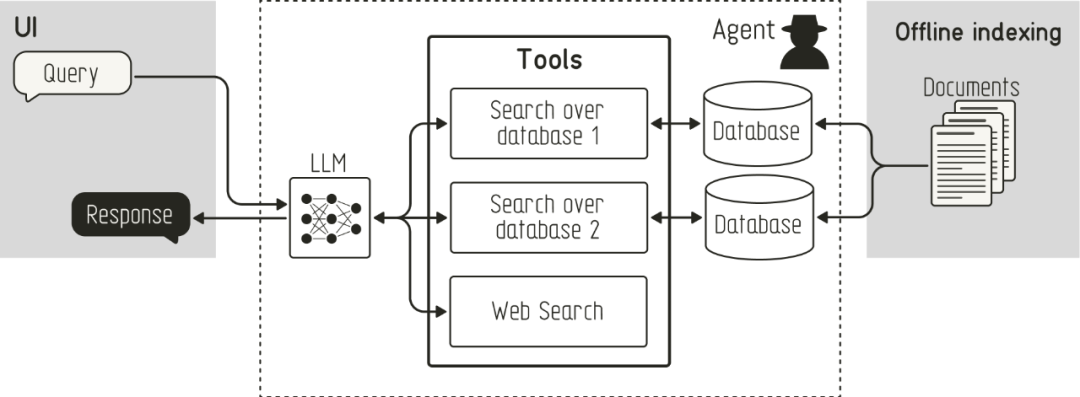

三、什么是 Agentic RAG?

为了克服 RAG 的局限,Agentic RAG 诞生了。它让模型“像一个智能代理(Agent)一样”行动:

面向一个总目标,它会先规划,然后按需拆解子问题、生成检索意图、迭代取证、调用工具,甚至会质疑与自我反思,直到达到停止条件。

常见的 Agentic RAG 能力模块包括:

- 计划 (Plan):制定实现目标的步骤。

- 行动 (Act/Tool Use):执行计划,包括多轮检索、调用 API 等。

- 反思 (Reflect/Verify):评估上一步行动的结果,检查证据是否充分、一致。

- 回溯 (Revise):如果发现问题,就修改计划或重新检索。

这个过程常结合链式思维 (CoT)、ReAct、思维树 (Tree-of-Thought)、Self-Ask 等策略。

四、Agentic RAG 的价值

- 多跳问题更强它能先思考“要回答X,我需要先知道A、B、C”,然后分别检索与验证 A、B、C,最后再综合得出结论。

- **更鲁棒(Robust)**它可动态地重写检索查询、替换数据源、降低噪声片段的权重,通过迭代逐步收敛到可信的答案。

- 可解释性更强它保留了完整的“思维轨迹 + 证据链”,这对于后续的审计与调试非常有价值。

五、Agentic RAG 的挑战

- 代价与延迟多轮的“计划-检索-反思”循环会显著增加 API 调用次数与时间延迟,这需要在预算与用户体验之间做出权衡。

- 复杂性它需要设计良好的控制流、清晰的停止条件、异常处理与失败重试策略。否则,Agent 很容易陷入无限循环或过度检索。

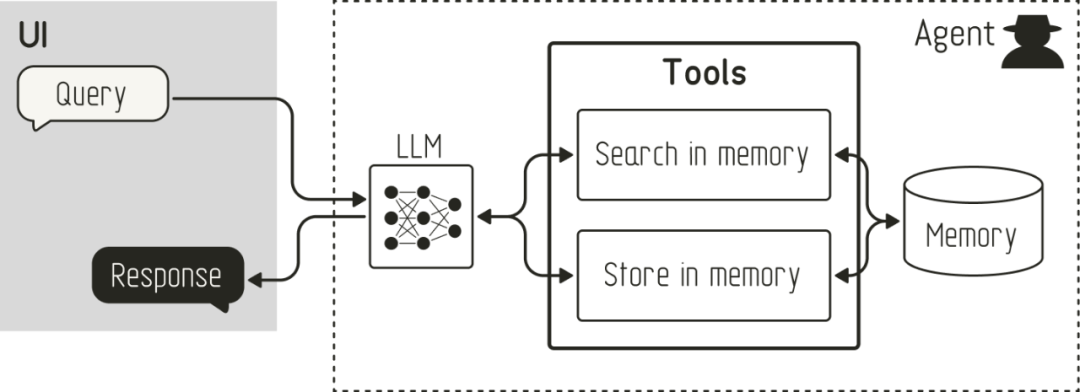

六、什么是 Agent Memory(智能体记忆)?

Agentic RAG 解决了“会查”和“会反思”的问题,但它依然“健忘”。Agent Memory(智能体记忆)则更进一步,它指的是智能体具备“可持久写入/读取/更新/遗忘”的记忆系统。

这个系统用来跨任务、跨会话地沉淀信息,包括:

- 用户画像与偏好

- 事实知识

- 过程技能(如何完成某个任务的步骤)

- 对话语境

它让智能体不只是“会查”,也“会记与用”,能逐步积累领域知识、个性化习惯与工作流“套路”。

记忆的类型(常见分层)

- **短期/工作记忆 (Working/Short-term)**指当前会话的对话摘要、最近步骤的中间结论。用于保持本轮推理的连贯性。

- **长期记忆 (Long-term)**指跨会话持久化的事实、规则、偏好与技能。随时间累积与巩固。

- 语义记忆 vs 事件(情节)记忆

- 语义记忆:是抽象的知识,如概念、知识图谱、摘要。

- 事件记忆:是具体的经历,如某次任务的轨迹(带有时间与上下文)。

七、记忆的生命周期

记忆系统不是一个只进不出的黑盒,它必须具备完整的生命周期 (Write-Read-Update-Forget)。

- 写入 (Write) 从对话或工具结果中抽取“可记忆”的片段,进行质量判定与重要度评分,然后再持久化(存入向量库、图数据库或键值存储)。

- 读取 (Read) 根据当前任务意图、查询嵌入、时间/重要度/频率等信号来检索记忆。可以做重排与多源融合(例如:向量检索 + 符号检索 + 规则过滤)。

- 更新与巩固 (Update & Consolidate) 对记忆进行去重、合并、抽象与蒸馏(例如,把多条零散的记忆总结成一条更稳定的表述),并对冲突的条目做一致性修复。

- 遗忘/衰减 (Forget & Decay) 基于时间、使用频率与重要度,对记忆做衰减或压缩处理。这能控制记忆库的规模,防止过时或噪声信息主导检索结果。

八、记忆实现要点(设计蓝图)

要构建一个强大的记忆系统,需要考虑以下关键点:

- 存储选择:向量数据库(便于语义检索)、知识图谱(显式关系与约束)、文档库/KV(用于原始证据回溯)。

- 评分与策略:需要评估记忆的重要度(是否改变行为/结论)、新颖度(信息增益)、可靠度(来源/一致性)和新鲜度(时间权重)。

- 写入守门与安全:这是重中之重。必须避免把用户的敏感信息(PII)或模型的幻觉写入长期记忆。需要引入“写前验证”、PII 过滤与来源签名机制。

- 召回与重排:采用混合检索(如 BM25 + Embedding + 知识图谱约束)、基于任务角色的提示重写、多臂老虎机式的记忆探测等策略。

- 汇总与蒸馏:定期把零散的“事件记忆”汇总成“语义记忆”,形成更稳定、可迁移的“知识与风格”。

九、典型架构演进

从 RAG 到 Agent Memory 的架构演进如下:

- RAG查询 → 检索(向量/关键词)→ 拼接 → 生成。

- Agentic RAG目标设定 → 计划 → 多轮检索/工具 → 证据链 → 反思/自检 → 最终答案。

- Agent Memory在 Agentic RAG 的循环中,插入“读/写记忆”节点。

- 任务开始时:先读取记忆,用于定制化计划。

- 任务结束时:把高价值的新知识写回长期记忆。

十、评估与度量

如何衡量一个具备记忆的 Agent 的好坏?

- 任务成功率与证据一致性:答案是否被检索到的证据支持?过程是否可复现?

- 迭代效率:为达成正确答案,需要多少检索轮次、工具调用次数与多长的时延?

- 记忆质量:

- 命中率:召回的记忆对当前任务有用的比例?

- 污染率:错误/敏感信息被写入记忆的比例?

- 稳定性:多轮交互后,记忆是否仍保持一致?

十一、常见陷阱与对策

- 幻觉写入长期记忆

- 对策:增加来源校验、交叉验证与“写前”的人类/规则审查。必要时,只写入“带来源的候选记忆”。

- 记忆膨胀和漂移

- 对策:设置重要度门控、定期蒸馏与衰减。为多人物/多场景分区存储记忆,防止互相污染。

- 过拟合个体偏好

- 对策:对个性化权重设定上限,并保留“一键清空/冻结某类记忆”的功能。

十二、场景对比:何时用什么?

| 场景/能力 | RAG | Agentic RAG | Agent Memory |

|---|---|---|---|

| 任务复杂度 | 低到中: 单跳问答、定位文档片段 | 中到高: 多跳推理、需主动取证与验证 | 中到高: 需跨会话积累知识/偏好/技能 |

| 成本/时延 | 低 | 中-高(多轮调用) | 中(读写记忆带来额外开销) |

| 可解释性 | 中(引用片段) | 高(计划与证据链) | 高(还能追溯记忆来源与演化) |

| 个性化与持续学习 | 弱 | 中(策略可调) | 强(长期沉淀与自我改进) |

| 首选场景 | 有结构的检索型问答 | 复杂事实核查、工具编排 | 需长期陪伴与成长的助手/顾问 |

十三、实操清单(落地建议)

- 从小做起:先别急着上 Agent。先把 RAG 做稳(抓好数据清洗、切块策略、检索重排),再引入最小可行的“计划-检索-反思”循环。

- 加入“只读记忆”试点:先让 Agent 读取个人档案或团队知识库,提升上下文的定制化,再逐步开放“写入白名单”。

- 严控写入:为写入长期记忆设定严格的门槛:“重要度阈值 + 来源校验 + 敏感信息过滤 + 冷却期复核”。

- 评估驱动:为每一步(检索、重排、反思、记忆读/写)定义可观测的指标与回归测试集,避免盲目地把系统复杂化。

核心结论

- 传统 RAG 解决了“能查”的问题。

- Agentic RAG 解决了“会查”且“会用证据驱动反思”的问题。

- Agent Memory 进一步解决了“会记、会用、会成长”的问题。

在复杂的任务与长期的交互中,把“计划‑检索‑反思”与“可控的记忆读写”相结合,能够显著提升智能体的准确性、个性化与可解释性——但这一切,都必须以严格的质量与安全治理为前提。

最后

为什么要学AI大模型

当下,⼈⼯智能市场迎来了爆发期,并逐渐进⼊以⼈⼯通⽤智能(AGI)为主导的新时代。企业纷纷官宣“ AI+ ”战略,为新兴技术⼈才创造丰富的就业机会,⼈才缺⼝将达 400 万!

DeepSeek问世以来,生成式AI和大模型技术爆发式增长,让很多岗位重新成了炙手可热的新星,岗位薪资远超很多后端岗位,在程序员中稳居前列。

与此同时AI与各行各业深度融合,飞速发展,成为炙手可热的新风口,企业非常需要了解AI、懂AI、会用AI的员工,纷纷开出高薪招聘AI大模型相关岗位。

最近很多程序员朋友都已经学习或者准备学习 AI 大模型,后台也经常会有小伙伴咨询学习路线和学习资料,我特别拜托北京清华大学学士和美国加州理工学院博士学位的鲁为民老师给大家这里给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料,这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

749

749

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?