目 录

1 GoogLeNet网络

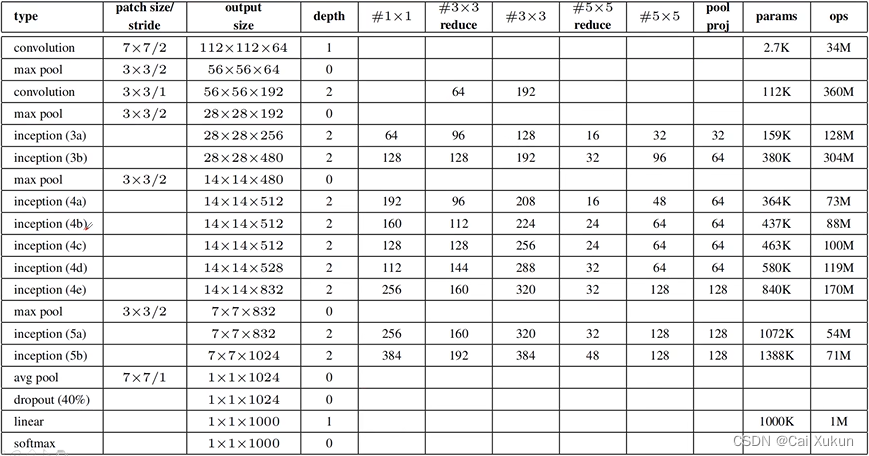

1.1 网络结构及参数

整个网络的结构参数如下:

后面几列与网络的对应关系如下:

该网络的亮点在于:

①引入了Inception结构(融合不同尺度的特征信息);

②使用1x1的卷积核进行降维以及映射处理;

③添加两个辅助分类器帮助训练,在之前的AlexNet和VGG都只有一个输出层,但是在GoogLeNet有三个输出层(其中有两个是辅助分类层);

④丢弃全连接层,使用平均池化层,能够大大减少模型参数。

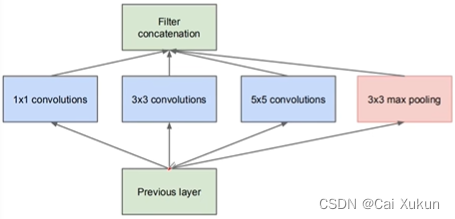

1.2 Inception结构

将上一层得到的输出矩阵同时输入到四个分支当中进行处理,处理之后再将得到的四个特征矩阵按照深度进行拼接,得到一个输出特征矩阵。四个分支分别为:1×1的卷积核、3×3的卷积核、5×5的卷积核、3×3的池化核,每个分支得到的特征矩阵高和宽必须相同,否则无法按深度进行拼接。

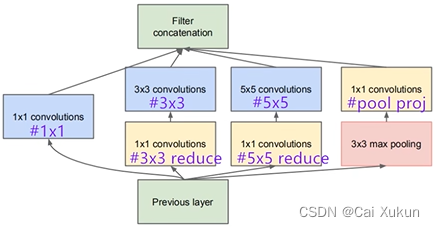

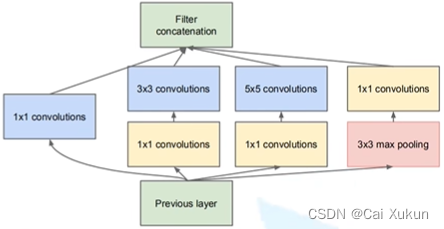

1.3 带降维功能的Inception结构

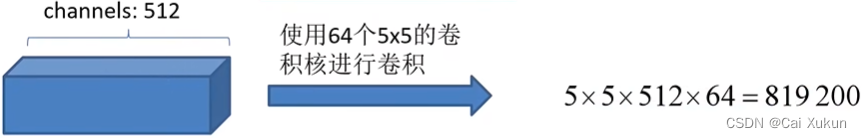

在后三个分支分别多了1×1的卷积核,起到了降维的作用。如果不使用1×1的卷积核,如下图所示:

一共需要819200个参数,但若先使用1×1的卷积核进行降维,会大大减少参数个数:

第一个卷积层需要12288个参数,再经过一次卷积需要38400个参数,一共只需要50688个参数,大大减少了计算量。

1.4 辅助分类器

①第一层是平均池化下采样操作,池化核大小为5×5,步长为3,网络中一共有两个辅助分类器,输入分别是Inception(4a)和Inception(4d)的输出分别为14×14×512和14×14×528,两个辅助分类器对应的输出值分别为4×4×512和4×4×528;

②然后使用128个大小为1×1的卷积核组成的卷积层进行处理,降低维度,并使用ReLU激活函数;

③采用节点个数为1024的全连接层,并使用ReLU激活函数;

④在全连接层之间使用Drouput函数,随机失活70%的神经元;

⑤输出层神经元个数根据类别调整,再通过softmax激活函数

本文介绍了GoogLeNet网络,其亮点包括引入Inception结构、用1x1卷积核降维、添加辅助分类器和使用平均池化层。详细阐述了Inception结构、带降维功能的Inception结构及辅助分类器。还说明了利用Pytorch实现GoogLeNet网络的模型定义、训练和预测过程。

本文介绍了GoogLeNet网络,其亮点包括引入Inception结构、用1x1卷积核降维、添加辅助分类器和使用平均池化层。详细阐述了Inception结构、带降维功能的Inception结构及辅助分类器。还说明了利用Pytorch实现GoogLeNet网络的模型定义、训练和预测过程。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1613

1613

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?