DeepSeek最新模型DeepSeek-V3-0526疑似泄露:

这次消息来自:

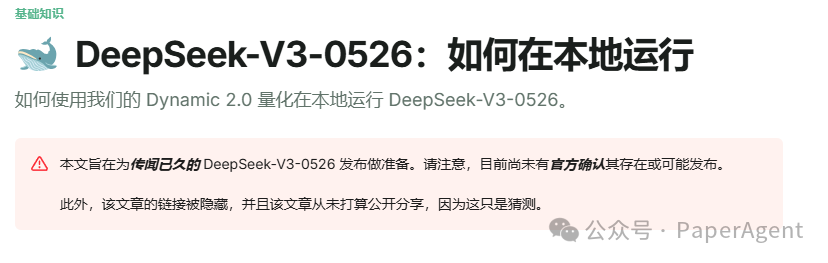

https://docs.unsloth.ai/basics/deepseek-v3-0526-how-to-run-locally

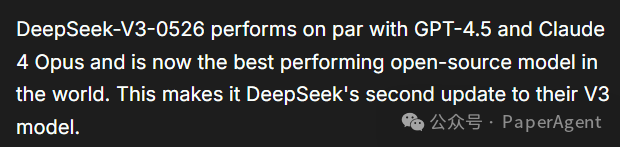

DeepSeek-V3-0526模型性能媲美 GPT-4.5 / Claude Opus 或将成为最强开源模型。

如果信息属实DeepSeek-V3-0526应该很快就会发布,毕竟马上又要端午节了,犹记得五一前国内大模型厂商那一波组团发布,那么问题又来了,万众期待的DeepSeek R2还有多远?

来源 | PaperAgent

1666

1666

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?