话不多说先上链接:

链接:https://pan.baidu.com/s/1LmJnknU4rmSEaDYXR7LBXQ

提取码:9pya

复制这段内容后打开百度网盘手机App,操作更方便哦

相信都看过我的在window上安装deeseek的教程了,现在在我研究了一下,找了两下包后总结出来这套在linux上部署deeseek的教程,以上提供的包是amd版本的包,arm的包没有下载,需要的话得自己去github上下载了,贼慢就是了。

机子:cpu:64c Intel Xeon Processor (Skylake)

系统:centos7.9

内存:64G

显卡:无(环境艰苦,只能用cpu跑个7B的来出教程,哭了!)

步骤:

一、安装alloma

相信大家都尝试过使用ollama_install.sh来部署ollama了吧,要么贼慢,要麽直接timeout。所以我这边直接下载了ollama的包,放在了我网盘了(这里传不了超过1G的文件,免费,免费,免费,无套路!!!)只下了amd的版本,arm版本的需要自己去下(amd的包我下了两小时,太慢了,哭了!)。

![]()

tar -xzvf ./ollama-linux-amd64.tgz 解压tgz包,

![]()

得到bin和lib目录,到bin目录下

先运行ollama

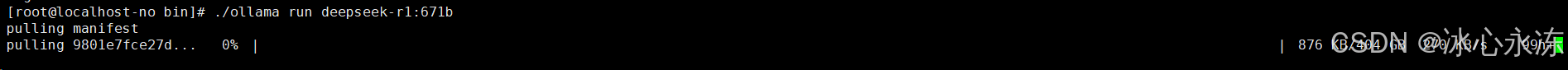

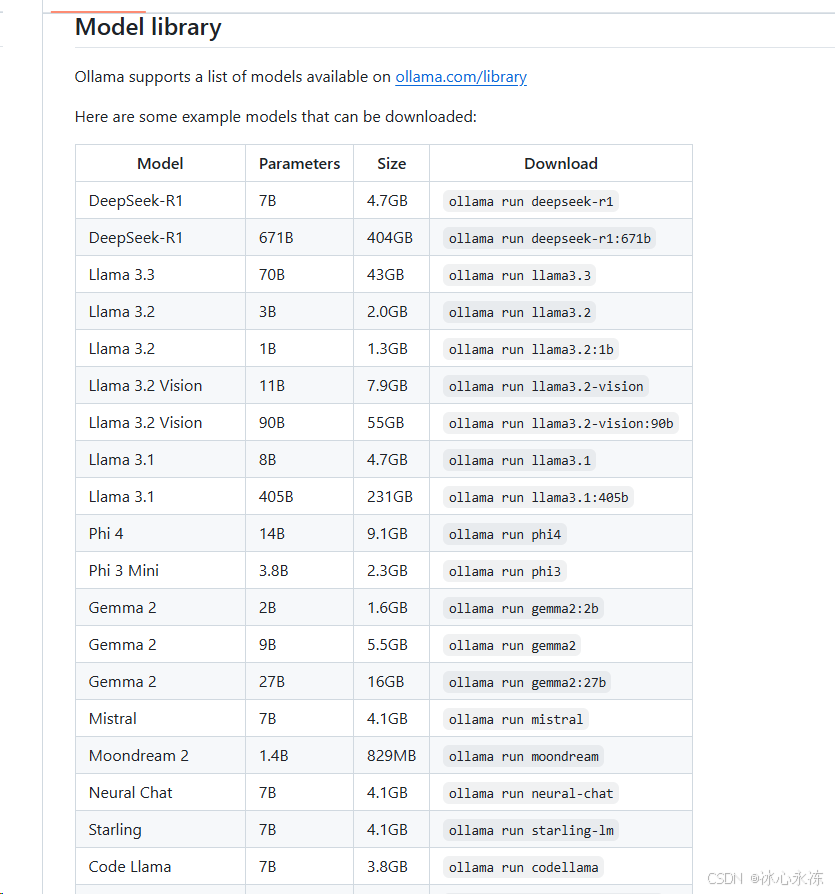

./ollama serve前台运行一个ollama,再开一个窗口,根据自己需要下载大模型 (很慢,做好心理准备,宽带大的可能快点,我这边7B的下了三个小时,哎,哭了~)

./ollama run 需要的大模型

#比如:

./ollama run deepseek-r1

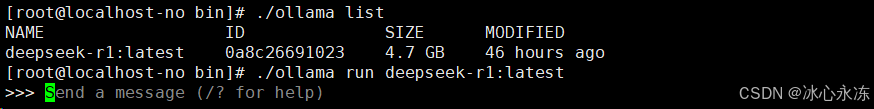

下载完后可以查看你下载的大模型,选择运行哪个,如果有多个的话

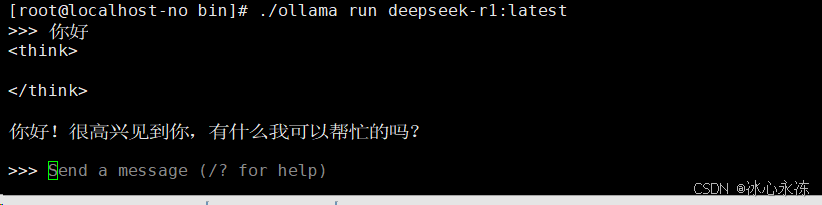

然后尽情使用吧!

然后尽情使用吧!

7941

7941

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?