什么是 RAG

RAG 是retrieval-augmented-generation的缩写,翻译为中文的意思就检索增强,以基于最新,最准确的数据建立LLM 的语料知识库。

LLM 现存的痛点

我们知道 LLM 的知识库是通过现有的网络公开的数据作为数据源来训练的,现在公开的很多模型他们基于的训练数据会比我们现在网络上公开的数据早很多,那自然就会产生一种问题,网络上最新的数据和知识 LLM 是不知道。还有一种情况就是很多企业他们对自己的数据的安全做的很好,也就是私有化数据(这些数据是有价值的,也是企业的立足之本)。这些数据网络上肯定是不存在,那自然 LLM 也是不知道的。

我们在提问LLM 对于一些不知道的知识时候,LLM 很多时候是不知道如何回答问题的。甚至会对我们的问题进行胡诌随机回答,也就是瞎说。

如何解决

那如何让 LLM 知道这些最新/私有的数据的知识呢❓

那就是 RAG。通过将模型建立在外部知识来源的基础上来补充回答。从而提高 LLM 生成回答的质量。

在基于 LLM实现的问答系统中使用 RAG 有三方面的好处:

- 确保

LLM可以回答最新,最准确的内容。并且用户可以访问模型内容的来源,确保可以检查其声明的准确性并最终可信。 - 通过将

LLM建立在一组外部的、可验证的事实数据之上,该模型将信息提取到其参数中的机会更少。这减少了LLM泄露敏感数据或“幻觉”不正确或误导性信息的机会。 RAG还减少了用户根据新数据不断训练模型并随着数据的变化更新训练参数的需要。通过这种方式企业可以减低相关财务成本。

现在支撑所有基础模型的是一种称为 transformer 的 AI 架构。它将大量原始数据转换为其基本结构的压缩表示形式。从这种原始表示开始,基础模型可以适应各种任务,并对标记的、特定于领域的知识进行一些额外的微调。

但是,仅靠微调很少能为模型提供在不断变化的环境中回答高度具体问题所需的全部知识,并且微调的时间周期还比较长。所以当时的 Facebook提出了 RAG,让 LLM 能够访问训练数据之外的信息。RAG 允许 LLM 建立在专门的知识体系之上,以更准确的方式回答问题。

简单介绍

LangChain 是一个用于开发由语言模型驱动的应用程序的框架。它使应用程序能够:

- 具有上下文感知 能力:将语言模型与上下文源(提示说明、少量镜头示例、基于其响应的内容等)联系起来。

- 原因:依靠语言模型进行推理(关于如何根据提供的上下文回答,采取什么行动等)

更多的介绍可以去官网:Introduction | 🦜️🔗 Langchain

安装 langchain 相关依赖包

- pip install langchain

- pip install langchain-community

- pip install langchain-core

- pip install langchain-experimental

- pip install langchain-experimental

- pip install “langserve[all]”

- pip install langchain-cli

- pip install langsmith

实现知识库

OpenAI 相关配置

如果你是不使用的 OpenAI 那么,你需要参考官网的关于 model I/O的部分去实例化你对应的 LLM model

本文中的LLM 使用的是 AZURE_OPENAI 的服务。

py复制代码 import os

os.environ["AZURE_OPENAI_ENDPOINT"] = ""

os.environ["AZURE_OPENAI_API_KEY"] = ""

embedding model 账户配置

根据自己的实际 LLM情况去配置相关的参数

py复制代码 import os

os.environ["AZURE_OPENAI_ENDPOINT"] = ""

os.environ["AZURE_OPENAI_API_KEY"] = ""

os.environ["OPENAI_API_VERSION"] = "2023-05-15"

os.environ["OPENAI_API_TYPE"] = "azure"

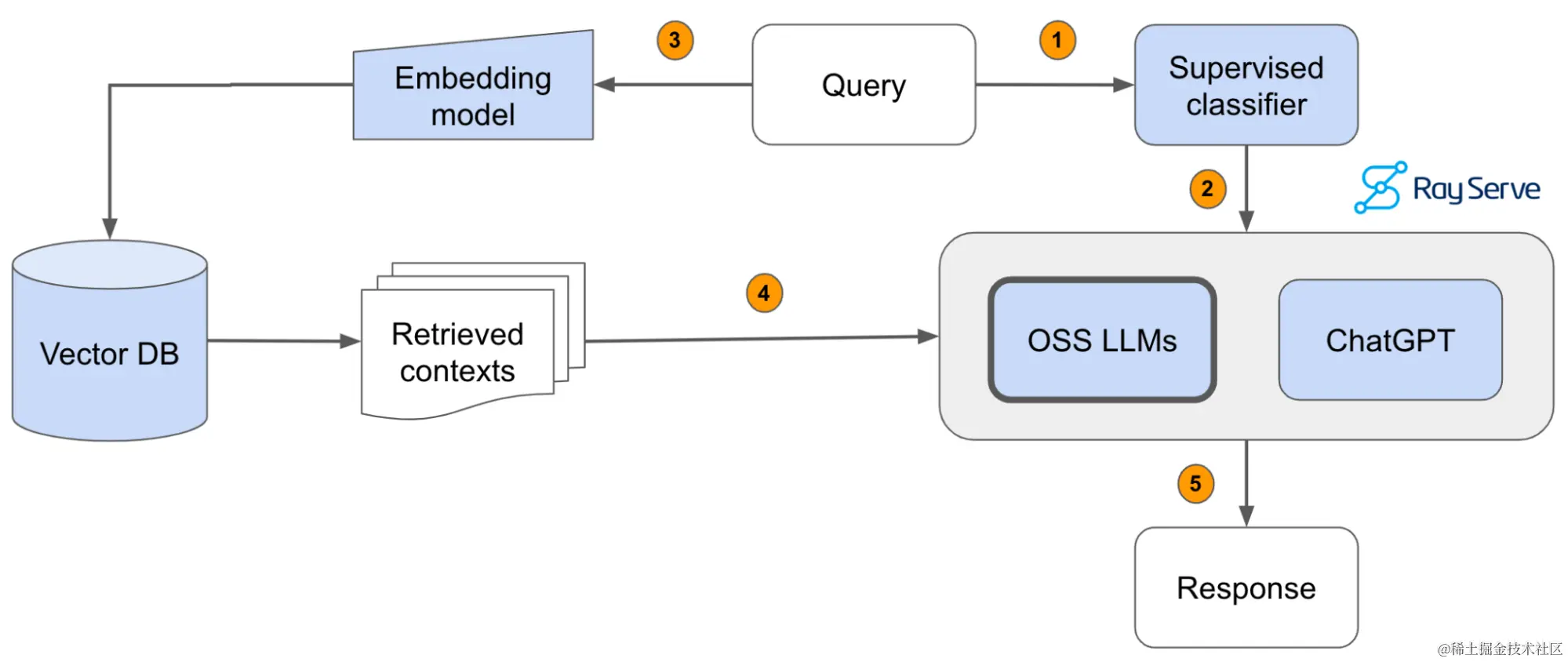

RAG 增强检索的流程图

代码执行流程

- 加载 langchain 相关包

- 加载 url 网页的文档并生成

langchain Documentraw_documents - 将

raw_documents拆分为适合embedding

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2675

2675

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?