零基础想要入门大模型,langchain、transformer、bert这些是要学的,但是你上来就从这里开始学习,那你就大错特错了!

作为一名有一定编程经验的程序员,我们真的没必要一上来就把时间精力全部投入到复杂的理论、纠结选择什么编程语言和各种晦涩的数学公式上,这样不仅容易让你精神内耗,最终演变成入门到放弃。

所以我们们认识复杂新事物时,最无痛的途径应当是:感性认识现象->理解本质和原理->将所学知识用于解释新现象并指导实践。

所以我给出的这条路径是:先学会如何使用大模型,然后了解其背后的原理,最后探索如何将其应用于实际问题。

Prompt工程: 作为一个普通人,把大模型用起来

是我们对大模型提出的问题。举一个最简单的例子,很多同学在第一次使用AI时,都会问AI"你是谁","你是谁"这个问题便是prompt。

一个清晰有效的prompt包含角色、任务目标、上下文、输出要求、限定条件、理想示例等一系列内容,只有把prompt设计好了,大模型才有可能发挥出理想的效果。

AI编程: 作为一个程序员,把大模型用起来

学会使用Copilot、通义灵码之类的AI编程工具来提升编码效率。现阶段AI辅助编程在代码补全以及注释生成方面表现还不错,因此需要你来把架子搭好、把模块分好。这样无形中还能提高你的架构能力。

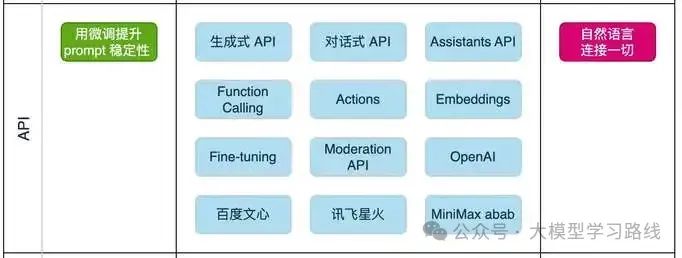

API调用: 作为一个大模型套壳程序员,玩一下

掌握如何调用市面上常见的大模型API,结合自己的想法实现具体的小任务,这对初学者来说是一个实际操作的好机会。

这时候你就获得了实践经验和对AI的直观认识。接下来就可以进入更深一层的大模型应用技术了。

大模型应用开发:作为一个大模型应用开发程序员,把大模型用起来

在工具方面,需要学习如LangChain这样的开发库,以及如LlamaIndex这样的数据索引和检索工具。

方向方面:

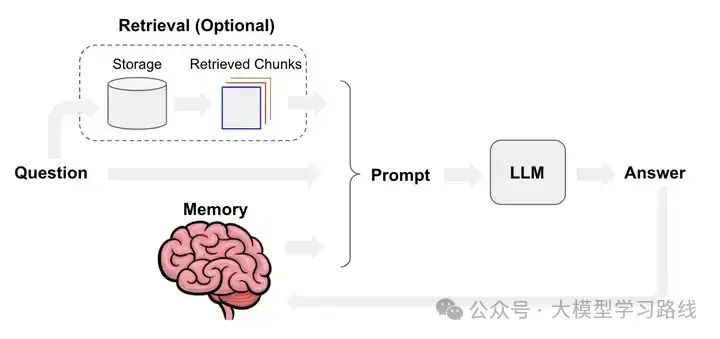

RAG(Retrieval-Augmented Generation检索增强生成**):**

RAG,全称检索增强生成(Retrieval-Augmented Generation),就像一个超级智能助手加了个百科全书。想象一下你和一位朋友聊天,他不仅会自己思考回答问题,还能瞬间查阅海量资料来确保答案准确无误。

逻辑流程:数据提取->embedding(向量化)->索引创建->检索->排序->LLM生成。

这部分内容技术细节很多,也非常有趣,很有搞头。

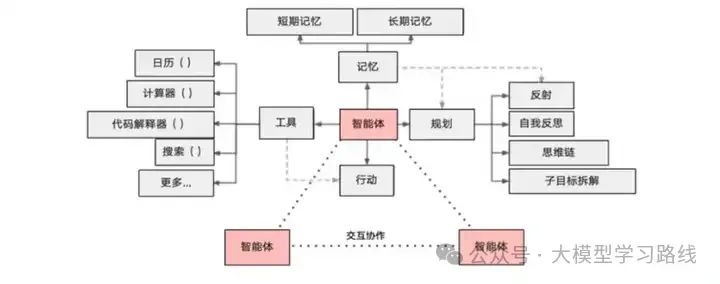

Agent

AI Agent,它被设计为具有独立思考和行动能力的AI程序。你只需要提供一个目标,比如写一个游戏、开发一个网页,他就会根据环境的反应和独白的形式生成一个任务序列开始工作。

就好像是人工智能可以自我提示反馈,不断发展和适应,以尽可能最好的方式来实现你给出的目标。

典型的AI agent分为Memory(记忆)、Tools(外部工具) 、Planning(计划) 和Action(行动) 四个模块。

Agent相关的开源项目以及产品非常多,可以边研究边学边做。

至此,应用方面的板块内容就介绍完了。注意**这个路径虽然更适合0基础入门,但是并不代表轻松简单。**出来混,总要还的,因为我们前期跳过了很多基础知识,所以意味着越往后学,越需要回填大量前置内容,比如:

- 掌握 Python 语言

- 掌握向量数据库

- 熟悉常用的库和工具,如 NumPy、Pandas、TensorFlow、PyTorch 等

- 具备 NLP 相关的基础知识,包括文本预处理、分词、词性标注、命名实体识别、词向量表示等

- Transformer 模型的结构和原理、基于注意力机制的自然语言处理技术等

- BERT、BART、T5等经典的模型

- 数学基础知识

说真的,补理论知识、搭项目环境,这个过程自己摸索和踩坑的话还是非常痛苦的。很有可能学着学着就放弃了。

深水区:模型训练和微调

在这一阶段,重点学习各种常见的预训练模型、模型结构及其主要的预训练任务。

大型模型的全面微调(Fine-tuning)涉及调整所有层和参数,以适配特定任务。此过程通常采用较小的学习率和特定任务的数据,可以充分利用预训练模型的通用特征,但可能需要更多计算资源。

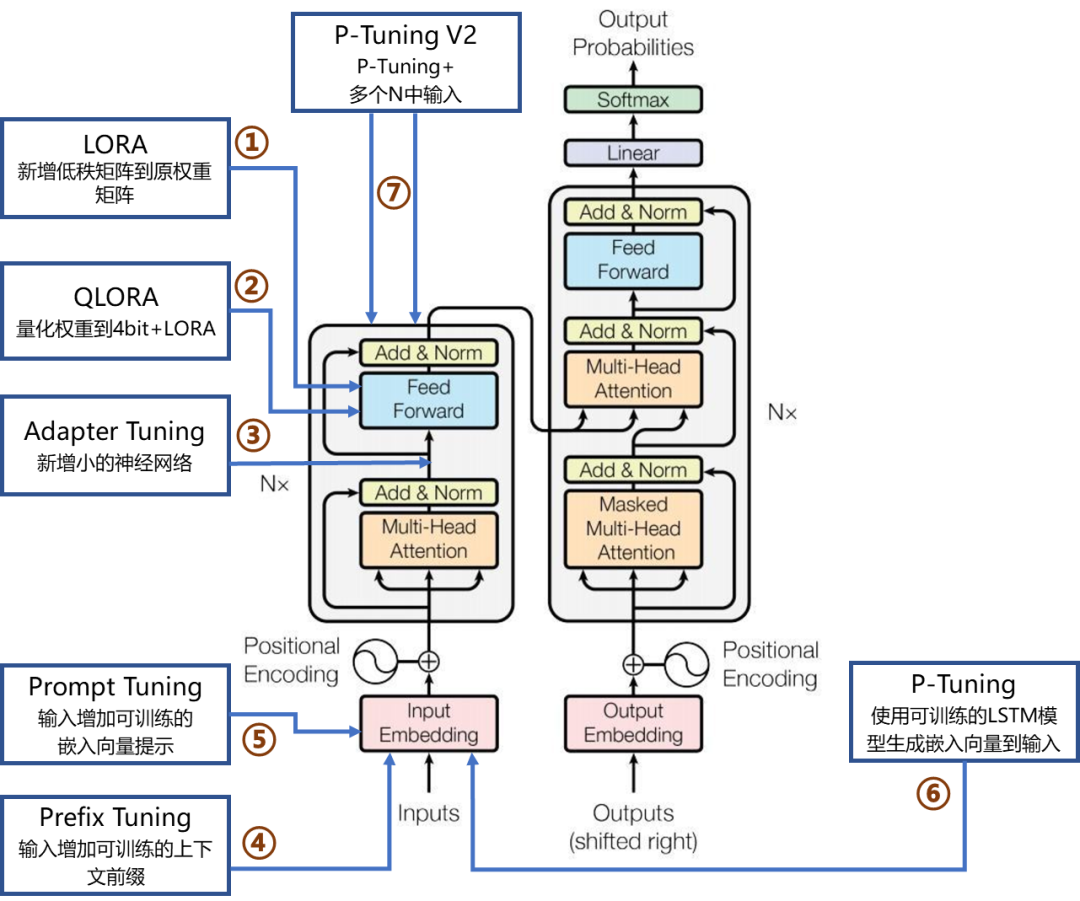

参数高效微调(Parameter-Efficient Fine-Tuning,PEFT)旨在通过最小化微调参数数量和计算复杂度,提升预训练模型在新任务上的表现,从而减轻大型预训练模型的训练负担。

即使在计算资源受限的情况下,PEFT技术也能够利用预训练模型的知识快速适应新任务,实现有效的迁移学习。因此,PEFT不仅能提升模型效果,还能显著缩短训练时间和计算成本,使更多研究者能够参与到深度学习的研究中。

PEFT包括LoRA、QLoRA、适配器调整(Adapter Tuning)、前缀调整(Prefix Tuning)、提示调整(Prompt Tuning)、P-Tuning及P-Tuning v2等多种方法。

以下图表示了7种主流微调方法在Transformer网络架构中的作用位置及其简要说明,接下来将详细介绍每一种方法。

产品和交付

大模型时代的产品,无论从用户需求、产品逻辑还是产品形态、商业模式等方面,大家都还处于摸索状态,因此在学习大模型领域知识时一定要一直看到产品和商业化这一层。

看清楚了哪个赛道拥挤、哪个领域是风口,就能够更好地把握职业机会,更有效地将大模型技术转化为求职市场的竞争力。

我们把这个路径捋一下,就得到了这张AI大模型全栈知识地图:

从下往上看,就是我所说的**“从实践到理论再到实践”**的学习路径了。这样看起来是不是更加轻松愉悦了?

大模型目前在人工智能领域可以说正处于一种“炙手可热”的状态,吸引了很多人的关注和兴趣,也有很多新人小白想要学习入门大模型,却苦于没有大模型入门学习资料?

AI大模型学习路线

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

93

93

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?