提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

文章目录

前言

通过导出系统镜像,将云服务器上的系统状态完整备份,可以在其他云服务器上快速部署相同配置的系统,节省了部署和配置的时间。当出现系统故障或灾难性事件时,可以迅速恢复到备份的系统状态。同时,可以通过导入本地系统镜像在本地环境快速复制系统配置,本文将介绍如何从阿里云服务器中导出服务器中系统的镜像文件,废话不多说,直接上教程!

一、系统镜像导出的前期的准备

1.准备的内容

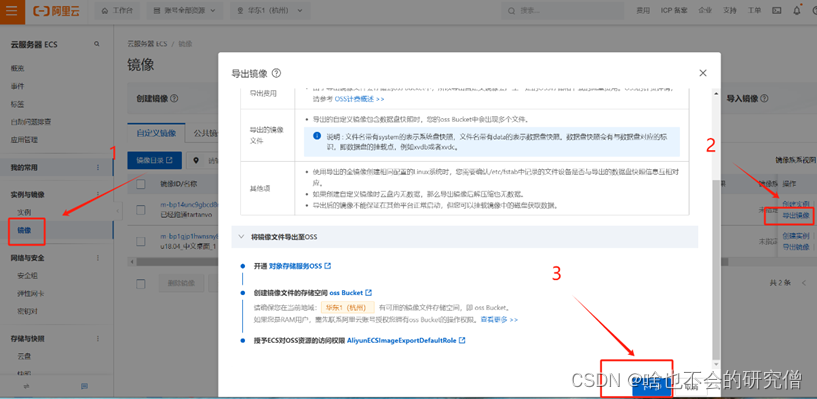

将镜像文件导出至OSS,如下图所示,前期准备主要分为三个步:

(1)开通 对象存储服务OSS

(2)创建镜像文件的存储空间 OSS Bucket

(3)授予ECS对OSS资源的访问权限

2.开通OSS并创建存储空间 OSS Bucket

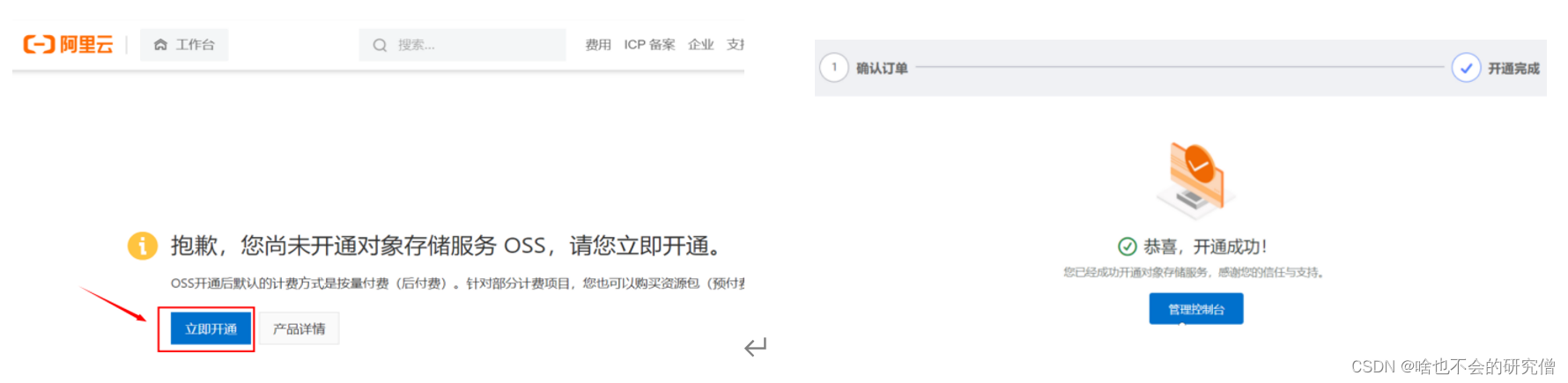

(1)开通OSS

在阿里云页面搜索OSS,进入对象存储服务OSS控制台:点击立即开通

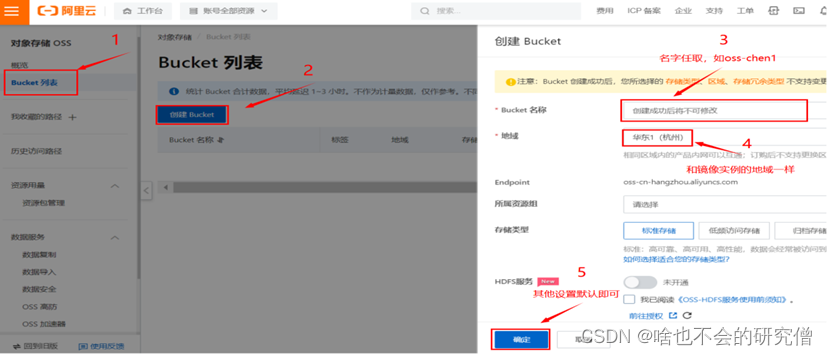

(2)创建OSS Bucket

开通成功后,出现如下页面:然后进行创建Bucket:

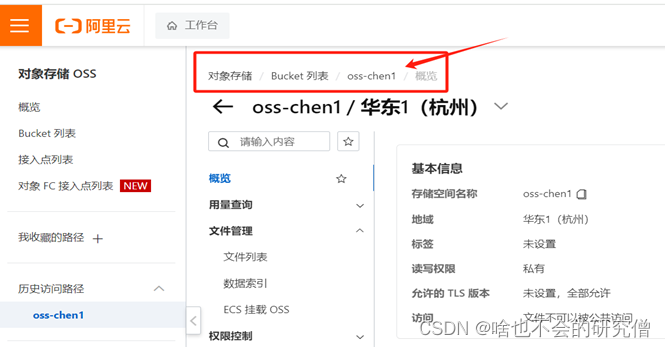

创建成功后的,在Bucket列表中,可看到相应的信息:

3.授权ECS服务器访问OSS资源

授权的步骤如下:点击镜像——导入镜像——授权ECS服务器访问OSS资源

点击蓝色的跳转链接,即可进入授权的界面,如下所示:

按上步骤,点击同授权,即可授权成功。

二、导出镜像

1.创建系统镜像

创建镜像:

进入云服务器ECS首页——镜像——创建镜像——自定义镜像——选择要镜像的实例,填写镜像名称——确认。

镜像创建完成之后,在镜像目录即可看到:

2.导出系统镜像

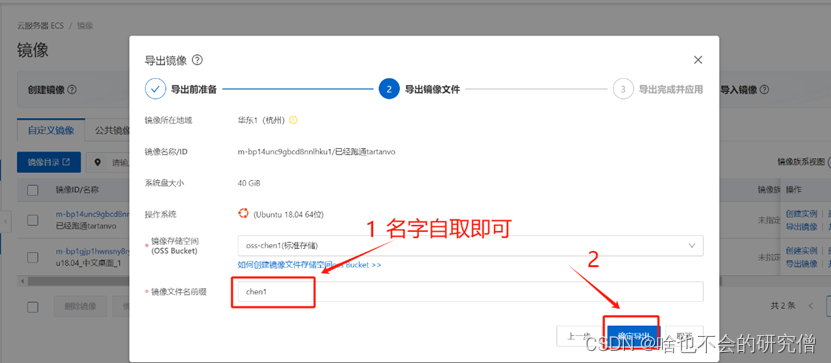

进入ECS控制台——点击镜像——点击导出镜像——点击下一步:

下一步之后,选存储空间 OSS Bucket —— 填写镜像文件名(自取即可):

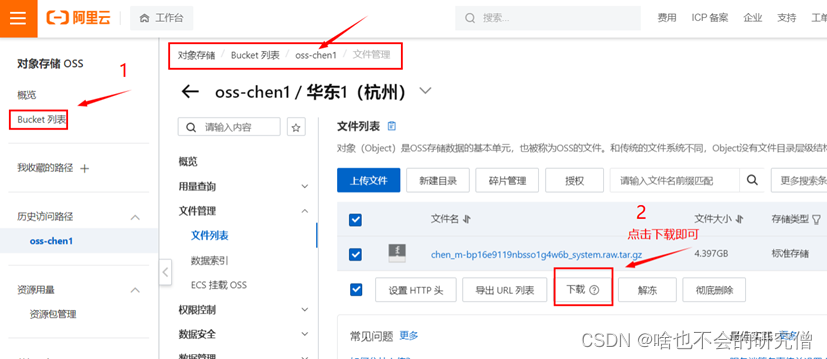

十来分钟之后,进入对象存储OSS——Bucket列表——oss_chen1(自己对应的Bucket)

下载至本地即可:

总结

以上就是今天分享的全部内容,本文介绍了如何导出阿里云的系统镜像,对系统的配置进行备份,以便下次快速部署系统,避免重复配置环境的麻烦,下期讲解如何将本地的系统镜像导入阿里云服务器,快速部署到云服务器中。

本文指导用户如何在阿里云ECS上导出系统镜像至OSS,包括开通OSS服务、创建存储空间、授权ECS访问权限以及实际操作步骤,以实现系统配置备份和快速部署。

本文指导用户如何在阿里云ECS上导出系统镜像至OSS,包括开通OSS服务、创建存储空间、授权ECS访问权限以及实际操作步骤,以实现系统配置备份和快速部署。

6958

6958

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?