以下素材全部整理于:博主BVL10101111 。话不多说,直接上图。

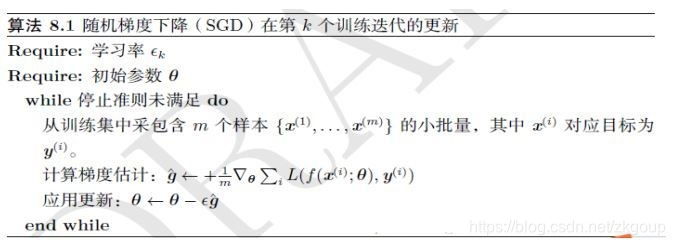

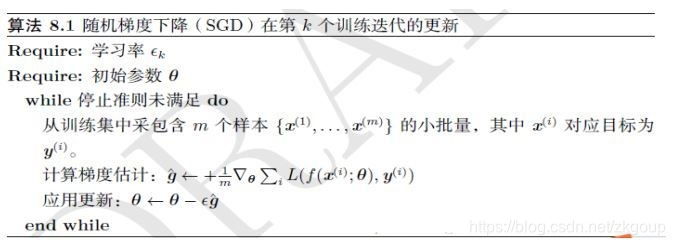

1、 最优化方法之SGD

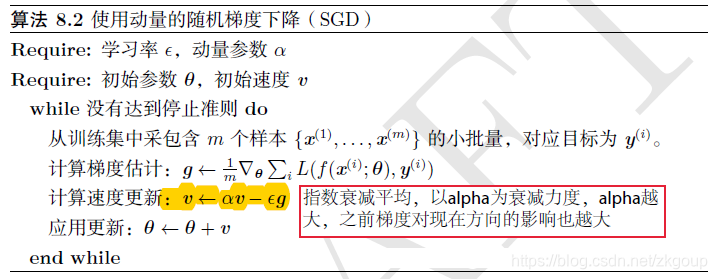

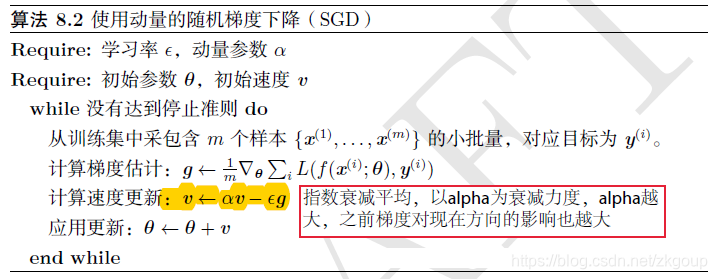

2、 最优化方法之Momentum(动量)

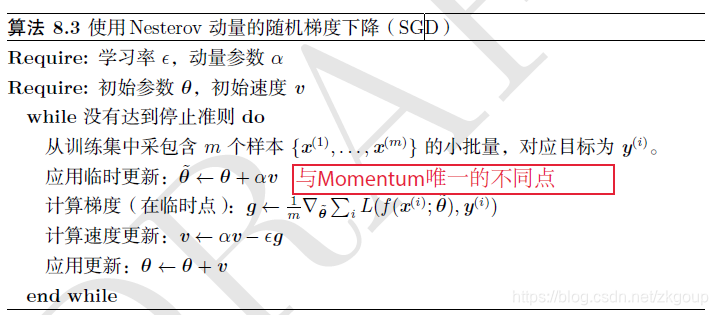

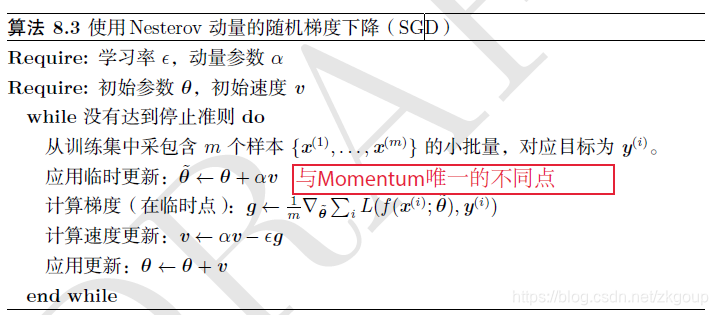

3、最优化方法之Nesterov(牛顿动量)

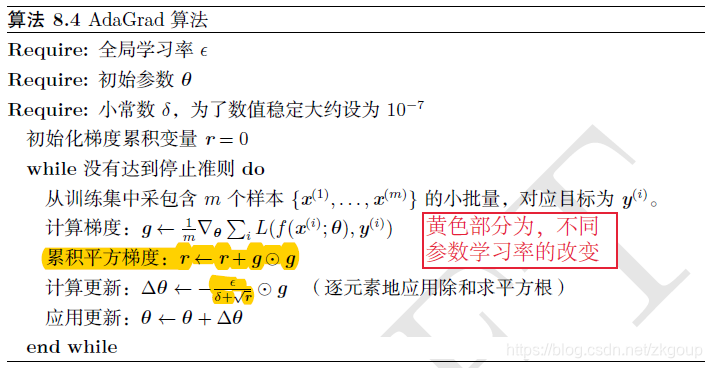

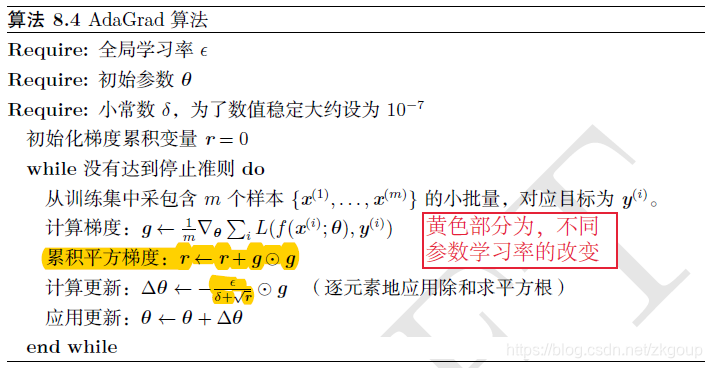

4、 最优化方法之AdaGrad

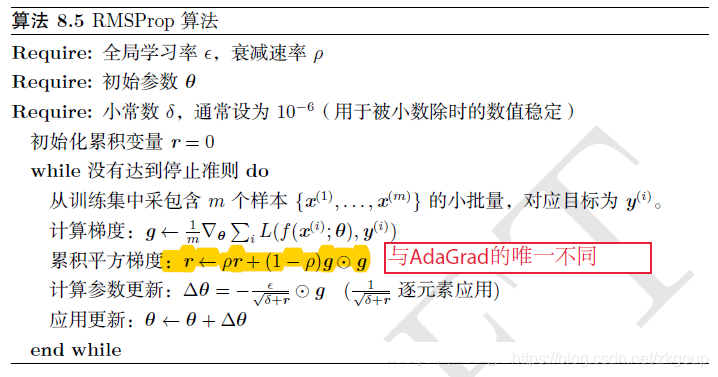

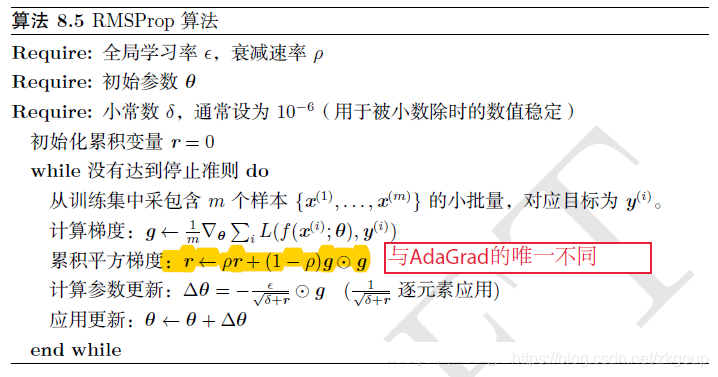

5、最优化方法之RMSProp

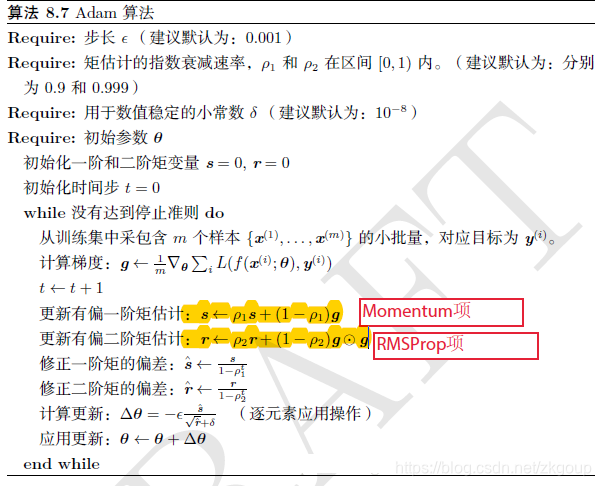

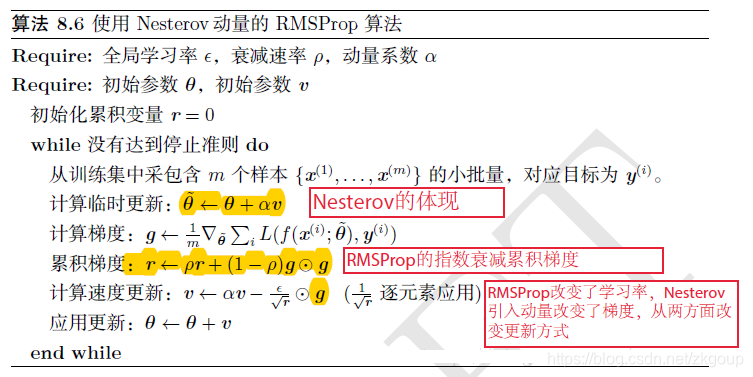

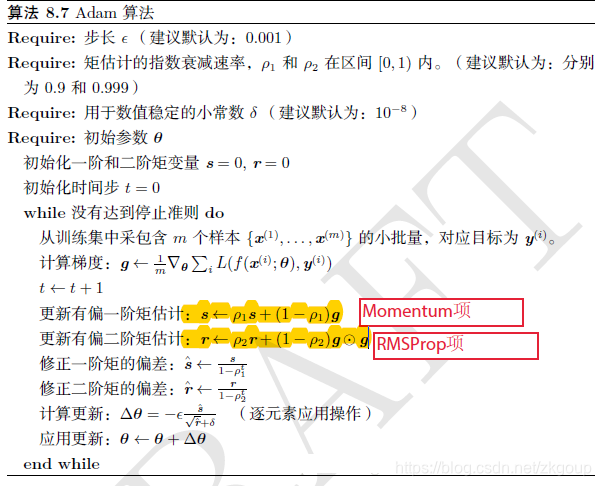

6、 最优化方法之Adam

————————————————

原文链接:https://blog.youkuaiyun.com/bvl10101111/article/details/72615436

以下素材全部整理于:博主BVL10101111 。话不多说,直接上图。

————————————————

原文链接:https://blog.youkuaiyun.com/bvl10101111/article/details/72615436

856

856

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?