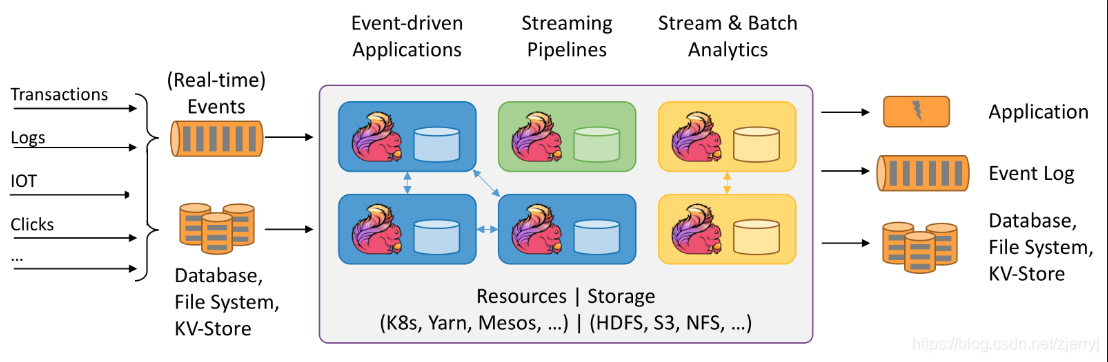

Apache Flink 是大数据领域又一新兴框架。它与 Spark 的不同之处在于,它是使用流式处理来模拟批量处理的,因此能够提供亚秒级的、符合 Exactly-once 语义的实时处理能力。Flink 的使用场景之一是构建实时的数据通道,在不同的存储之间搬运和转换数据。本文将介绍如何使用 Flink 开发实时 ETL 程序,并介绍 Flink 是如何保证其 Exactly-once 语义的。

示例程序

让我们来编写一个从 Kafka 抽取数据到 HDFS 的程序。数据源是一组事件日志,其中包含了事件发生的时间,以时间戳的方式存储。我们需要将这些日志按事件时间分别存放到不同的目录中,即按日分桶。时间日志示例如下:

{"timestamp":1545184226.432,"event":"page_view","uuid":"ac0e50bf-944c-4e2f-bbf5-a34b22718e0c"}

{"timestamp":1545184602.640,"event":"adv_click","uuid":"9b220808-2193-44d1-a0e9-09b9743dec55"}

{"timestamp":1545184608.969,"event":"thumbs_up","uuid":"b44c3137-4c91-4f36-96fb-80f56561c914"}

产生的目录结构为:

/user/flink/event_log/dt=20181219/part-0-1

/user/flink/event_log/dt=20181220/part-1-9

创建项目

Flink 应用程序需要使用 Java 8 编写,我们可以使用 Maven 模板创建项目:

mvn archetype:generate \

-DarchetypeGroupId=org.apache.flink \

-DarchetypeArtifactId=flink-quickstart-java \

-DarchetypeVersion=1.7.0

将生成好的代码导入到 IDE 中,可以看到名为 StreamingJob 的文件,我们由此开始编写程序。

Kafka 数据源

Flink 对 Kafka 数据源提供了 原生支持,我们需要选择正确的 Kafka 依赖版本,将其添加到 POM 文件中:

<dependency>

<groupId>org.apache.flink</groupId>

<artifactId>flink-connector-kafka-0.10_${scala.binary.version}</artifactId>

<version>${flink.version}</version>

</dependency>

测试过程中,我们需要一个能够运行的 Kafka 服务,读者可以参照 官方文档 搭建本地服务。在 Flink 中初始化 Kafka 数据源时,传入服务器名和主题名就可以了:

Properties props = new Properties();

props.setProperty("bootstrap.servers", "localhost:9092");

FlinkKafkaConsumer010<String> consumer = new FlinkKafkaConsumer010<>(

"flink_test", new SimpleStringSchema(), props);

DataStream<String> stream = env.addSource(consumer)

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1345

1345

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?