DeepSeek | 速度求索 👍

一、安装Ollama

可以参考我之前的文章

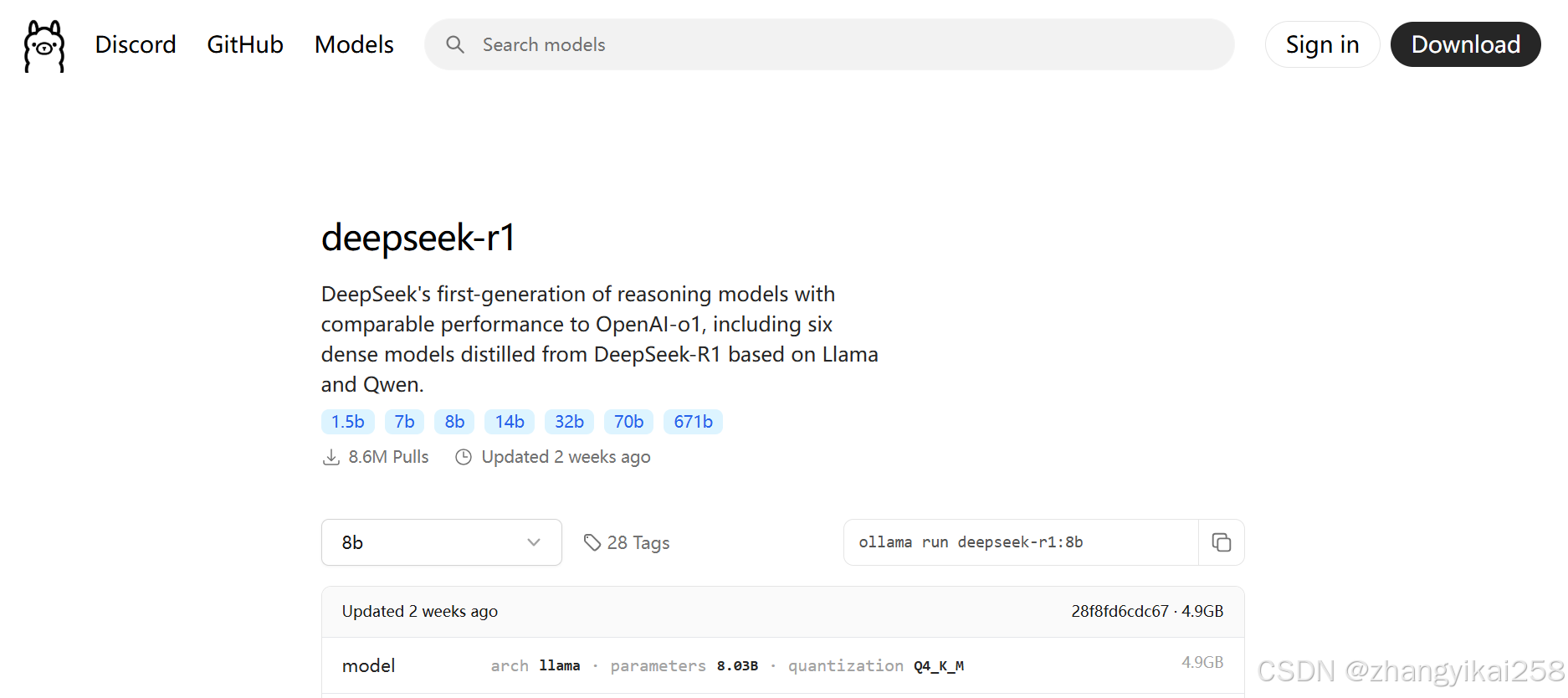

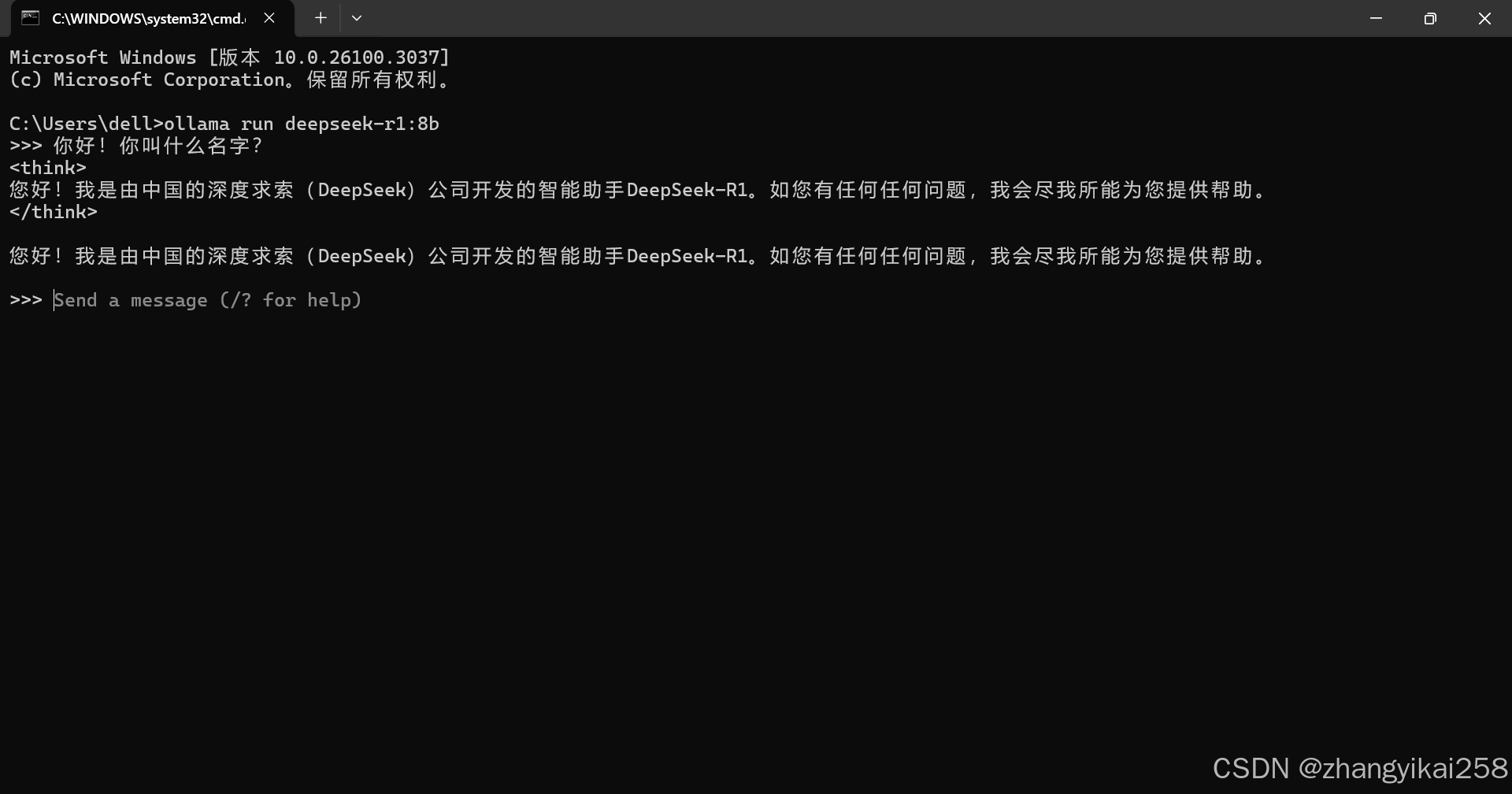

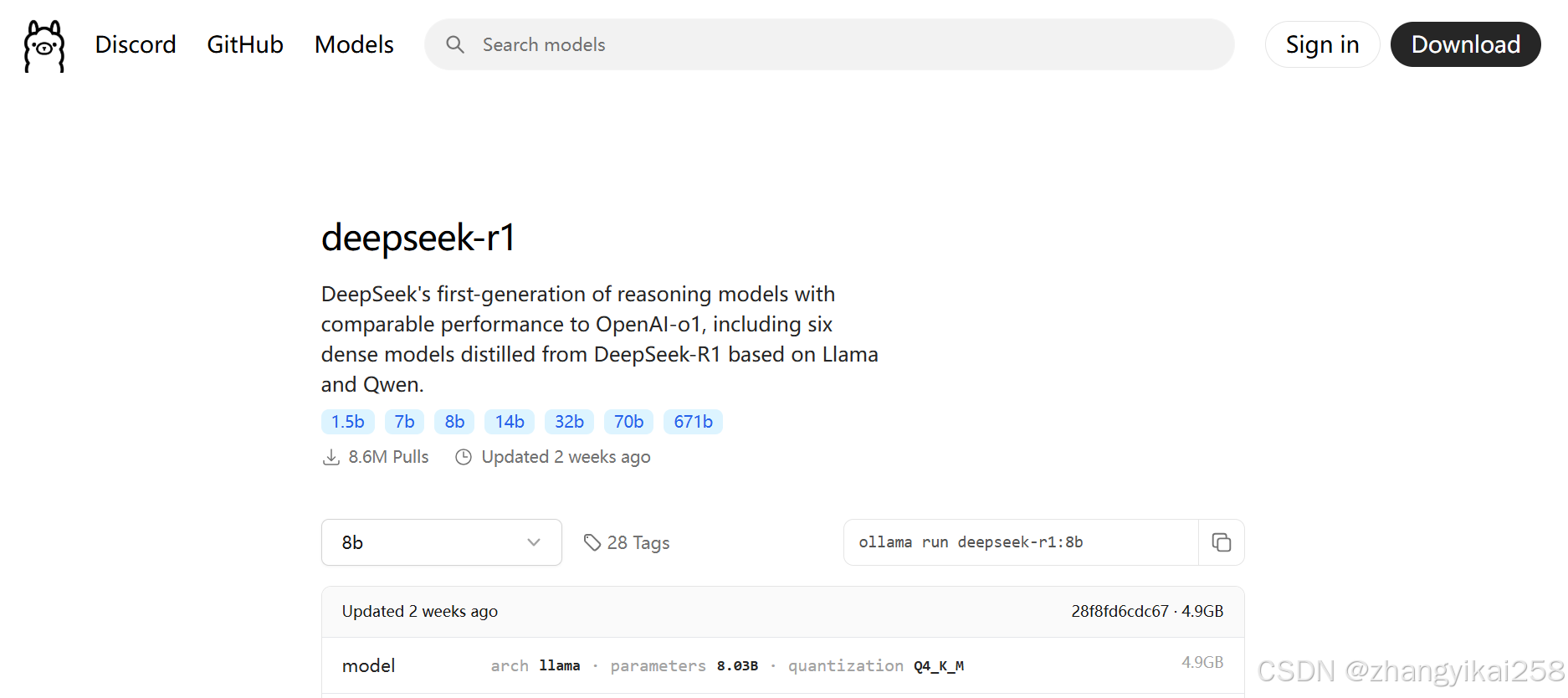

二、部署DeepSeek-R1自然语言大模型

##打开CMD

>> ollama run deepseek-r1:模型参数

![]()

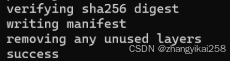

等待一些时间,看到四个100%进度条以及 ↓ 的提示

表示你成功的在你的电脑或者服务器上面部署了大模型

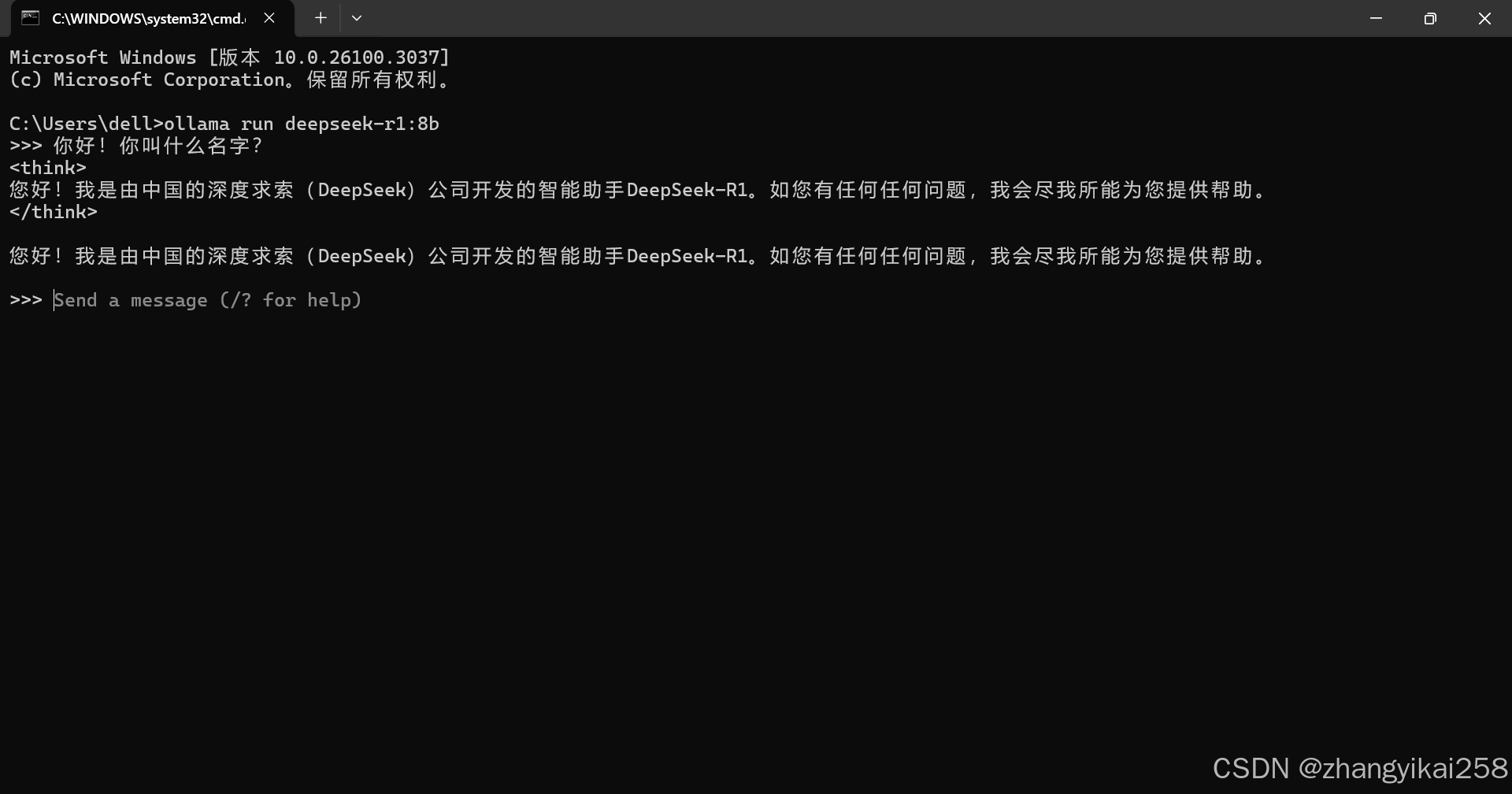

接下来你就可以使用大模型了!

DeepSeek | 速度求索 👍

可以参考我之前的文章

##打开CMD

>> ollama run deepseek-r1:模型参数

![]()

等待一些时间,看到四个100%进度条以及 ↓ 的提示

表示你成功的在你的电脑或者服务器上面部署了大模型

接下来你就可以使用大模型了!

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?