一、相同点

第一,LR和SVM都是分类算法(SVM也可以用与回归)

第二,如果不考虑核函数,LR和SVM都是线性分类算法,也就是说他们的分类决策面都是线性的。

这里要先说明一点,那就是LR也是可以用核函数的。总之,原始的LR和SVM都是线性分类器,这也是为什么通常没人问你决策树和LR什么区别,你说一个非线性分类器和一个线性分类器有什么区别?

第三,LR和SVM都是监督学习算法。

第四,LR和SVM都是判别模型。

这里简单讲解一下判别模型和生成模型的差别:

判别式模型(Discriminative Model)是直接对条件概率p(y|x;θ)建模。常见的判别式模型有线性回归模型、线性判别分析、支持向量机SVM、神经网络、boosting、条件随机场等。

举例:要确定一个羊是山羊还是绵羊,用判别模型的方法是从历史数据中学习到模型,然后通过提取这只羊的特征来预测出这只羊是山羊的概率,是绵羊的概率。

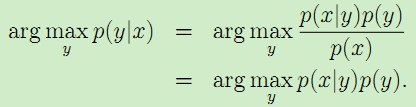

生成式模型(Generative Model)则会对x和y的联合分布p(x,y)建模,然后通过贝叶斯公式来求得p(yi|x),然后选取使得p(yi|x)最大的yi,即:

常见的生成式模型有 隐马尔可夫模型HMM、朴素贝叶斯模型、高斯混合模型GMM、LDA、高斯、混合多项式、专家的混合物、马尔可夫的随机场

举例:

本文对比了逻辑回归(LR)和支持向量机(SVM)的相同点和不同点。两者都是监督学习的线性分类算法,但SVM通过最大化几何间隔和使用核函数在非线性问题上更灵活。此外,SVM的损失函数自带正则化,而LR需要额外添加。在处理不平衡数据集时,LR可能受到所有数据点影响,而SVM仅关注支持向量。

本文对比了逻辑回归(LR)和支持向量机(SVM)的相同点和不同点。两者都是监督学习的线性分类算法,但SVM通过最大化几何间隔和使用核函数在非线性问题上更灵活。此外,SVM的损失函数自带正则化,而LR需要额外添加。在处理不平衡数据集时,LR可能受到所有数据点影响,而SVM仅关注支持向量。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2415

2415

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?