现在很多开发者已经将大模型作为一个日常工具使用。一方面我们在感叹它带来的便捷,一方面我们又要处处提防。它就像是一个死要面子的百事通,遇到它不通的,也要说的好像自己知道一样。

场景一,基于错误的问题会得到错误的回答。

咱们分析一下AI一本正经胡说八道的经典场景:林黛玉倒拔垂杨柳。大体是说问chatgpt林黛玉倒拔垂杨柳是什么故事,它会给出几个版本的故事听着好像那么回事是的。实际上在四大名著中,倒拔垂杨柳的不是林黛玉,我都拔不动,她咋能拔动的。这是因为chatgpt在猜测意图的时候认为你的意图就是以这些素材编造一段故事,这也是chatgpt目前被非常广泛使用的AIGC场景。想得到更准确的结果,不如问百度,谷歌。因为他们只会给出别人写过的东西,不会GC(生成内容),结果会更准确。

有的朋友在学习过程中,有不会的内容问chatgpt和网上搜索的结果不一样就会很纠结。其实chatgpt胡说八道是常有的事情。甚至你认为不该出现的,比如下面的情况。

场景二,基于错误的公式得到错误的结果。

我问过chatgpt一个cron表达式代表执行频次,得到了错误的答案。然后我从网上找到正确的计算方法,灌输给它才得到正确的答案。拿它当工具需要谨慎检查正确性。

场景三,用于程序开发得到的结果不稳定。

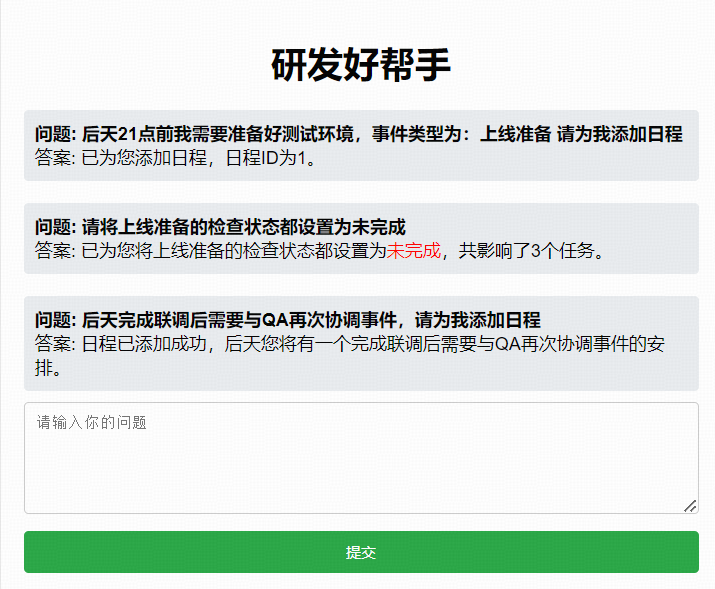

我用AI开发了一个小程序,大体做的事情是帮我记录日程安排,如果日程安排中有检查事项,也帮我做检查。用AI开开发确实节省了我很多开发时间,本来一大堆判断,我只将表结构灌输到系统提示词里,写一段通用SQL更新的代码,告诉AI我要做什么。

但当我要求它将结果以HTML表格形式输出,它的结果就不符合预期,一会儿返回markdown形式,一会儿返回它自己用各种符号拼成的表格。最终我发现它有技术短板,它会sql,但实践中html用的不好。我只好给它用普通文本的形式给它举例,先让结果稳定,然后我自己用程序做了一些处理。

131

131

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?