记录书生大模型任务L0G2000-2 远程服务器进行python debug

目的:

熟悉远程服务器对代码文件进行运行调试步骤

要求:

运行以下代码会产生报错,请debug出错误问题缘由,并进行解决

from openai import OpenAI

import json

def internlm_gen(prompt,client):

'''

LLM生成函数

Param prompt: prompt string

Param client: OpenAI client

'''

response = client.chat.completions.create(

model="internlm2.5-latest",

messages=[

{"role": "user", "content": prompt},

],

stream=False

)

return response.choices[0].message.content

api_key = 'xxxxxxxxxxxxxxxxxx'

client = OpenAI(base_url="https://internlm-chat.intern-ai.org.cn/puyu/api/v1/",api_key=api_key)

content = """

书生浦语InternLM2.5是上海人工智能实验室于2024年7月推出的新一代大语言模型,提供1.8B、7B和20B三种参数版本,以适应不同需求。

该模型在复杂场景下的推理能力得到全面增强,支持1M超长上下文,能自主进行互联网搜索并整合信息。

"""

prompt = f"""

请帮我从以下``内的这段模型介绍文字中提取关于该模型的信息,要求包含模型名字、开发机构、提供参数版本、上下文长度四个内容,以json格式返回。

`{content}`

"""

res = internlm_gen(prompt,client)

res_json = json.loads(res)

print(res_json)

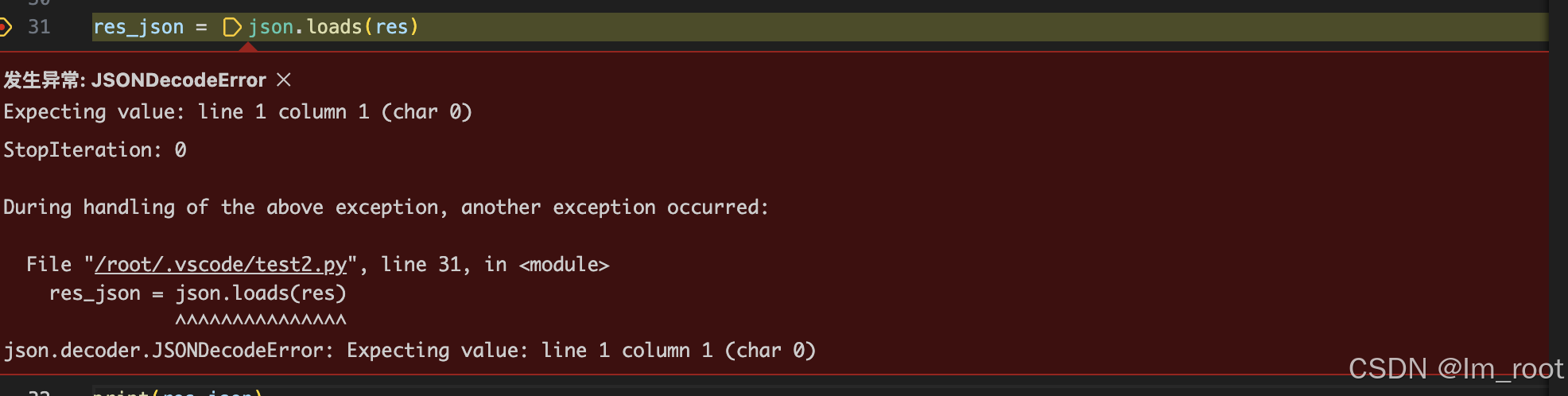

在res_json = json.loads(res) 处运行报错,无法进行json格式化,于是在此进行添加断点

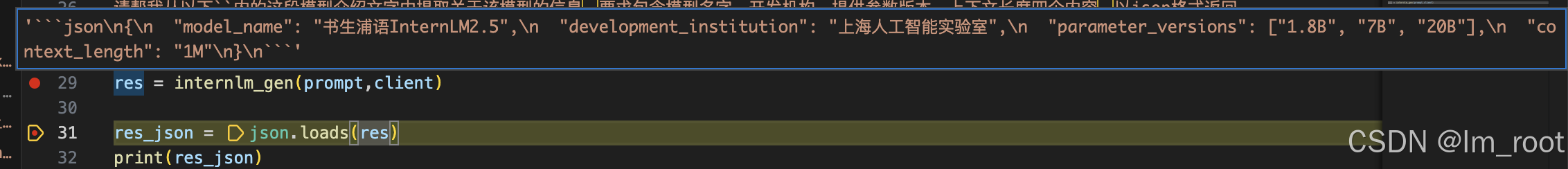

得到结果,发现在返回结果的前面是markdown格式,找到了问题的缘由

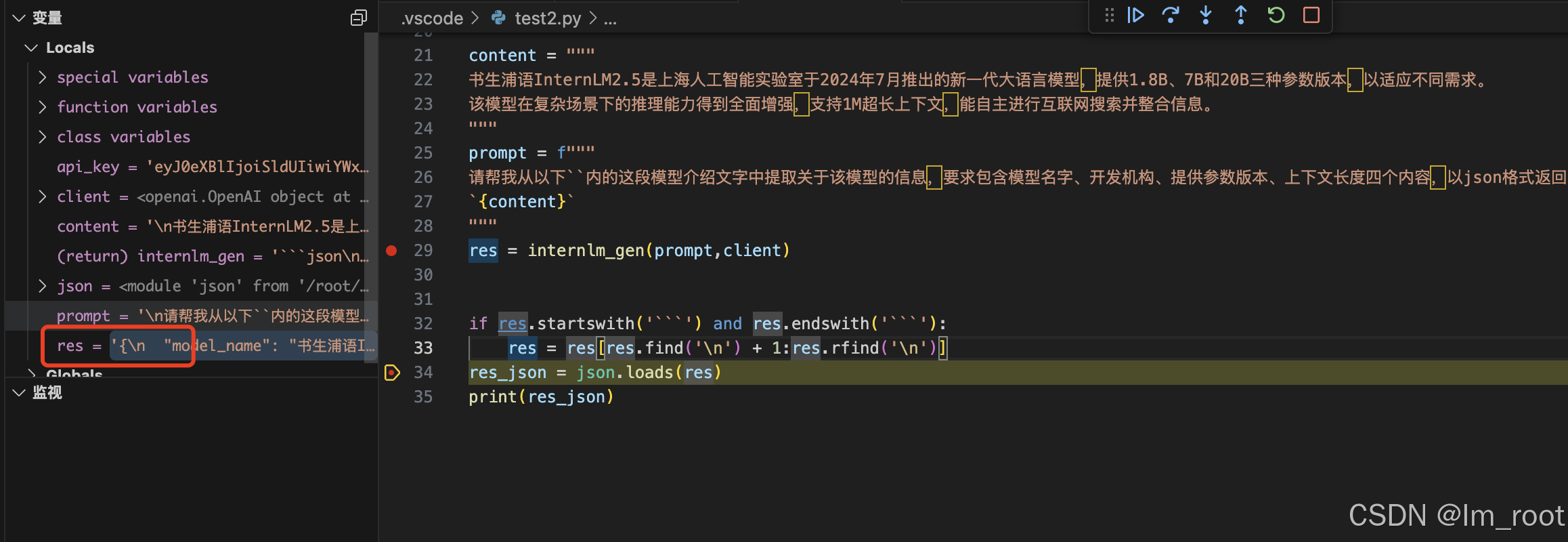

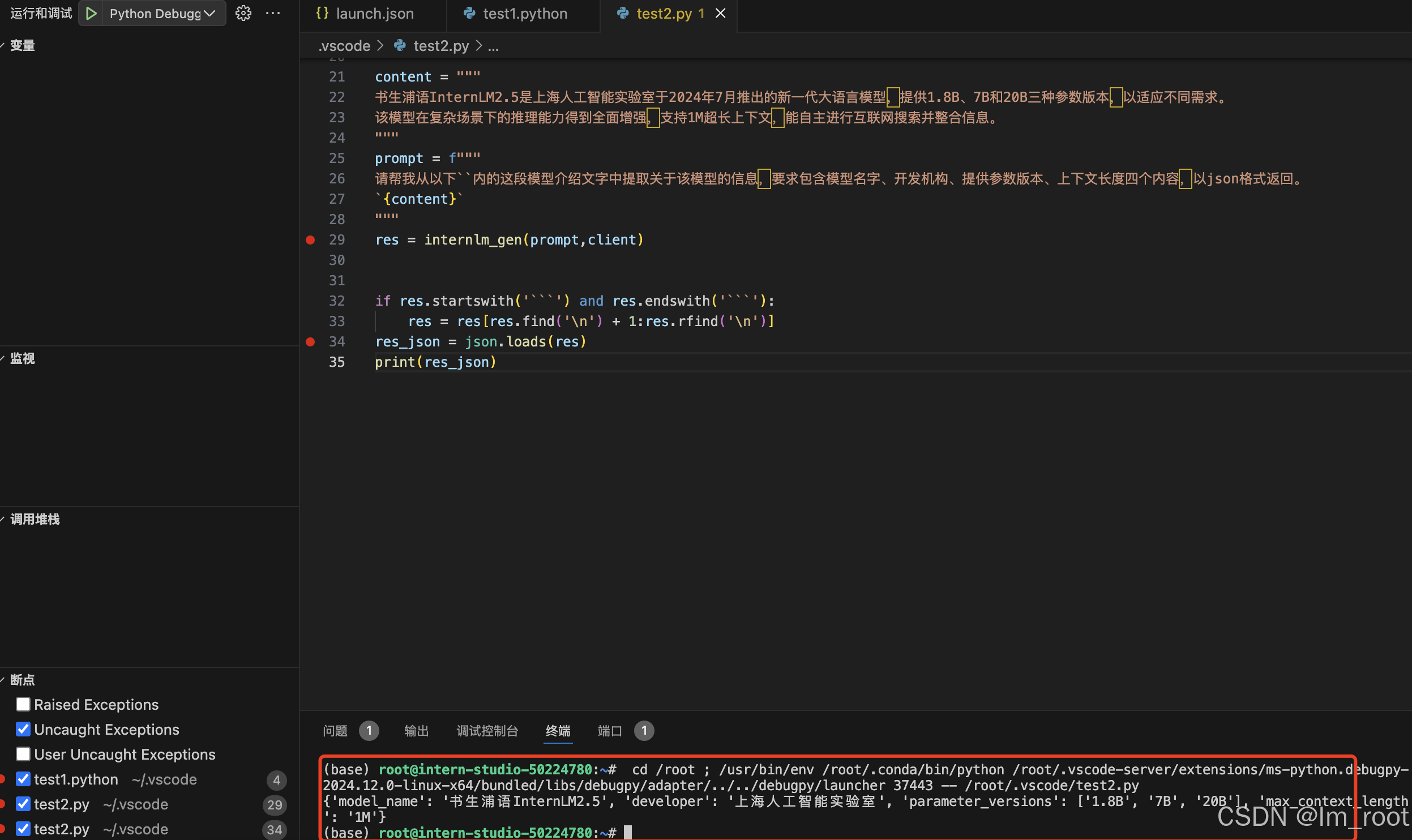

于是对返回结果进行处理,得到结果:

返回结果前面的markdown格式没有了,在进行json格式化就可以正常运行了

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?