在这篇文章中,我将介绍如何使用DBSCAN(Density-Based Spatial Clustering of Applications with Noise)算法对文本数据进行聚类分析。DBSCAN是一种基于密度的聚类算法,它能够识别任意形状的聚类,并能在聚类过程中发现并处理噪声数据。

概念

DBSCAN(Density-Based Spatial Clustering of Applications with Noise)是一种基于密度的聚类算法,它能够识别任意形状的聚类,并且能够将噪声点单独识别出来。DBSCAN算法由Martin Ester和Otkar Kiel在1996年提出,适用于发现数据中的聚类,特别是当聚类形状不规则或大小不一时。

主要思想

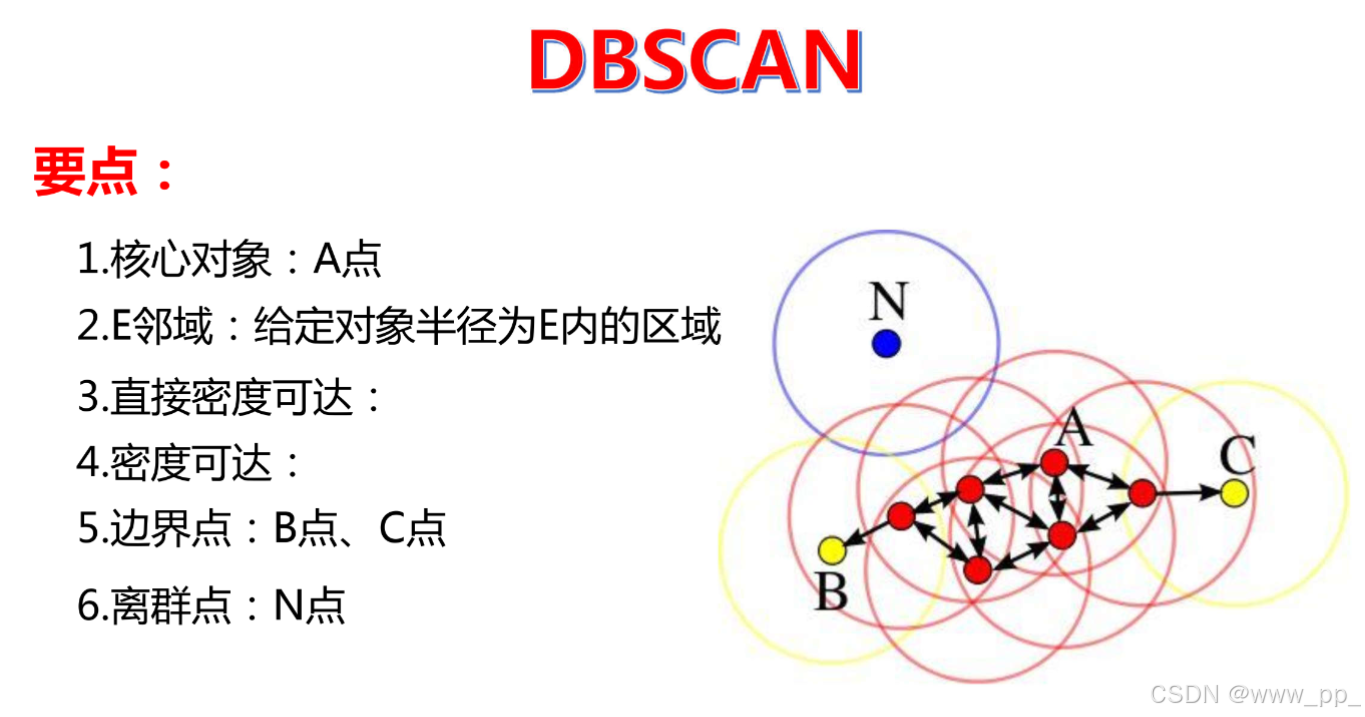

DBSCAN算法的主要思想是将数据点分为三类:

-

核心点(Core Point):在半径

eps内至少有min_samples个点的点。 -

边界点(Border Point):在半径

eps内少于min_samples个点,但落在核心点的邻域内的点。 -

噪声点(Noise Point):既不是核心点也不是边界点的点。

算法步骤

-

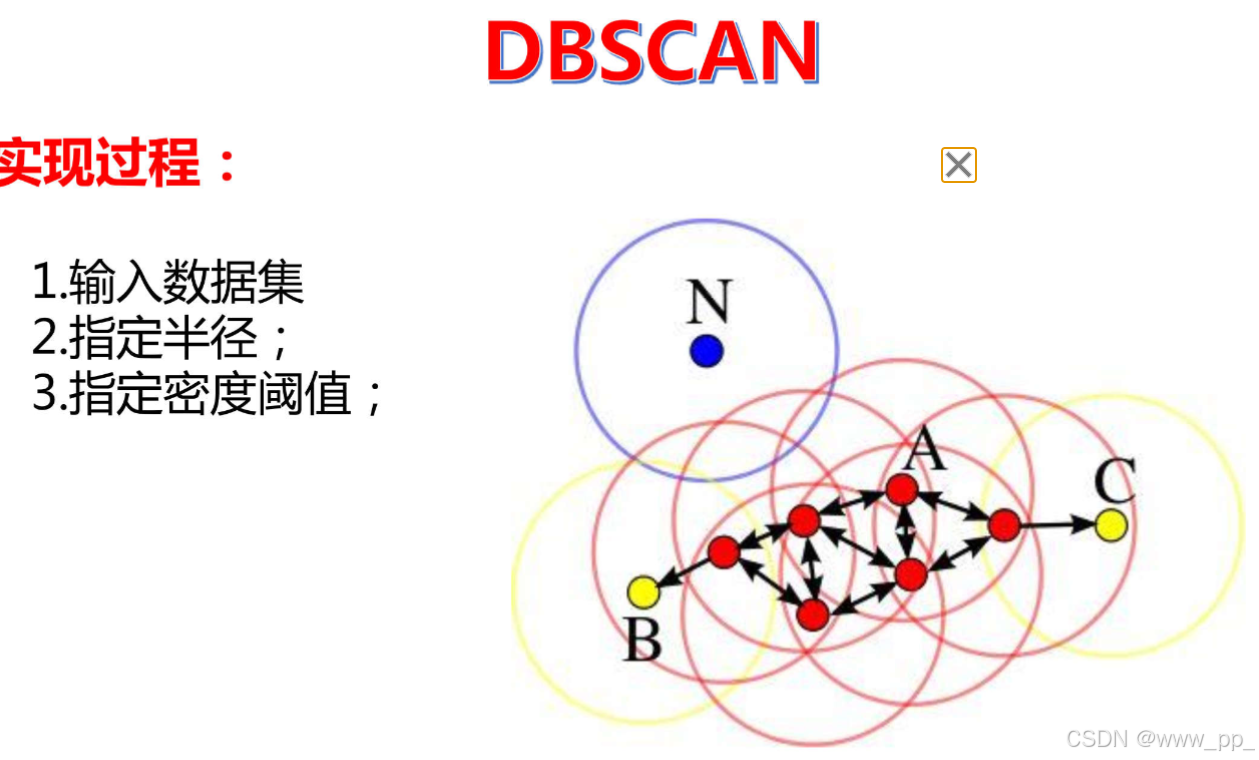

参数选择:选择两个参数,

eps(邻域的最大半径)和min_samples(形成核心点所需的最小样本数)。 -

核心点识别:对于每个点,检查其

eps邻域内是否至少有min_samples个点。如果是,则该点是核心点。 -

聚类形成:从任意核心点开始,递归地将邻域内的所有核心点和边界点加入到同一个聚类中。

-

噪声识别:那些既不是核心点也不是任何聚类中边界点的点被标记为噪声。

-

迭代处理:重复步骤3和4,直到所有点都被访问过。

优缺点

优点:

-

能够识别任意形状的聚类。

-

能够识别并处理噪声点。

-

不需要预先指定聚类的数量。

缺点:

-

对参数

eps和min_samples敏感,需要根据具体数据集进行调整。 -

计算成本较高,尤其是在大数据集上。

-

聚类的大小可能受到

eps和min_samples的共同影响。‘

应用场景

DBSCAN适用于多种数据聚类场景,包括但不限于:

-

空间数据聚类(如地理信息系统中的点聚类)。

-

文本聚类(如文档或文章的聚类)。

-

网络分析(如社交网络中的社区检测)

示例代码

数据读取

我们将从一个名为data.txt的文件中读取数据。这个文件应该包含以空格分隔的文本数据。我们将使用pandas库来读取数据。

import pandas as pd

# 读取文件

beer = pd.read_table("data.txt", sep=' ', encoding='utf8', engine='python')数据预处理

在进行聚类分析之前,我们需要对数据进行预处理,删除不包含聚类信息的列。

# 传入变量

X = beer.drop(columns=beer.columns[0])DBSCAN聚类分析

接下来,我们将使用scikit-learn库中的DBSCAN类来进行聚类分析。我们将设置eps(邻域的半径)和min_samples(一个点成为核心点所需的邻域点数)两个参数。

from sklearn.cluster import DBSCAN

# DBSCAN聚类分析

db = DBSCAN(eps=20, min_samples=2).fit(X)

labels = db.labels_结果评估

为了评估聚类效果,我们将计算轮廓系数(Silhouette Score)。轮廓系数是一个介于-1和1之间的值,值越大表示聚类效果越好。

from sklearn import metrics

# 添加结果至原数据

beer['cluster'] = labels

# 计算轮廓系数

score = metrics.silhouette_score(X, beer['cluster'])

print(score)运行结果

总结

通过这篇文章,我们介绍了如何使用DBSCAN算法对文本数据进行聚类分析。DBSCAN算法能够很好地处理任意形状的聚类,并且能够识别并处理噪声数据。在实际应用中,我们可以根据数据的特性调整eps和min_samples参数,以获得更好的聚类效果。

完整代码

import pandas as pd

from sklearn.cluster import DBSCAN

from sklearn import metrics

# 读取文件

beer = pd.read_table("data.txt",sep=' ',encoding='utf8',engine='python')

#传入变量

X=beer.drop(columns=beer.columns[0])

#DBSCAN聚类分析

db = DBSCAN(eps=20, min_samples=2).fit(X)#归一化

labels = db.labels_

# 添加结果至原数据

beer['cluster'] = labels

score = metrics.silhouette_score(X, beer.cluster)

print(score)

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?