一、线性回归原理详解

线性回归是一种基本的统计方法,用于预测因变量(目标变量)与一个或多个自变量(特征变量)之间的线性关系。线性回归模型通过拟合一条直线(在多变量情况下是一条超平面)来最小化预测值与真实值之间的误差。

1. 线性回归模型

对于单变量线性回归,模型的表达式为:

其中:

- y是目标变量。

- x是特征变量。

- β0是截距项(偏置)。

- β1是特征变量的系数。

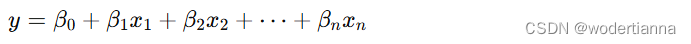

对于多变量线性回归,模型的表达式为:

其中:

- y是目标变量。

- x1,x2,…,xn是多个特征变量。

- β0是截距项(偏置)。

- β1,β2,…,βn是各特征变量的系数。

2. 最小二乘法(Ordinary Least Squares, OLS)

线性回归通过最小二乘法来估计模型参数,即最小化所有预测误差的平方和。对于给定的训练数据集 (xi,yi),目标是找到使得误差平方和最小

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

996

996

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?