基于ME‐ELM的焊接模型稳定性提升

1 引言

焊接方法有很多种类,例如电阻焊、钎焊、熔化极气体保护电弧焊(GMAW)、钨极惰性气体保护焊(TIG)、药芯焊丝电弧焊(FCAW)、埋弧焊(SAW)等,作为一种热加工过程,焊接广泛应用于海洋工程、铁路和电厂等的建造中,据报道,超过2/3的钢在使用前需要进行焊接 [1]。

焊接后的机械性能不仅取决于金属的成分,还取决于焊缝接头形状 [2, 3],理想的焊缝形状依赖于许多因素,例如焊接速度、送丝速度、焊接电流、焊接气体流量,因此很难在焊缝形状与如此多的焊接参数之间建立模型。

迄今为止,至少有四种建模方法:多元非线性回归(MNR)、响应面法 (RSM)、田口方法和人工神经网络非线性映射[4–7]。石等人[8]采用 MNR预测湿式药芯焊丝电弧焊中的焊道几何形状,并进行了敏感性分析,该方法也已用于埋弧焊以预测管件焊道形状并实现在线控制[3];帕拉尼和摩根[9]采用RSM建立了药芯焊丝电弧焊中焊缝接头形状的预测模型;田口方法应用广泛且形式多样,Tarng等人[10]和Biswas等人[11]分别应用了灰色田口法和主成分分析‐田口法来预测埋弧焊中的焊道形状。然而,由于焊缝形状涉及众多因素,上述所有方法均难以高效且有效地工作。目前,人工神经网络及其他类似的智能计算方法被广泛应用[12–15],但从数学角度来看,人工神经网络及其变体仍面临耗时、过拟合或局部最小值等问题,因此探索新的方法来构建焊接模型具有重要意义。

在极限学习机的基础上,本研究提出了一些混合方法。将模拟退火、网格搜索和遗传算法与普通ELM结合,以寻找更优的网络结构;同时提出了 ME‐ELM,以降低训练数据噪声,从而提高模型稳定性与精度。

本文其余部分安排如下。第2节介绍基本极限学习机的原理,指出与精度和稳定性相关的若干问题;第3节重点提升模型稳定性,详细介绍了 ME‐ELM,并通过在特定复杂函数上的测试表明该算法具有抑制噪声不利影响的能力;第4节建立实际钨极惰性气体保护焊的焊接模型,除本文提出的方法外,还采用BP神经网络和MNR建立焊接模型,并与已有文献中报道的线性回归(LR)结果进行残差对比;最后,第5节给出结论。

2 基本极限学习机的介绍

2.1 极限学习机原理

极限学习机是一种前馈神经网络,具有两种结构类型,分别为多层结构和单层结构。单层结构即为单隐层前馈神经网络,它包含一个输入层、一个输出层和唯一的一个隐藏层,每个隐藏层神经元都有一个激活函数,这些函数可以相同也可以不同,如下图所示。

[x1, x2,…, xN]表示输入数据,[y1, y2,…, yN]表示输出数据,W =[W1, W2,…, WN]和b =[b1,b2,…, bN]分别为输入矩阵和输出矩阵。隐藏层通过输入矩阵W将数据从输入空间映射到特征空间,再通过输出矩阵 b将其转换到结果空间,显然它们在模型性能中起着重要作用。

工作过程如下:给定训练样本 (xi, ti),输入向量和输出向量分别为 xi=(xi1, xi2,…, xin) ∈ Rn 和 yi=(yi1,yi2, …,yim) ∈ Rm,若隐层神经元数量为 L 且激活函数为 g(xi),则可得:

$$

y_j = \sum_{i=1}^{L} b_i g(w_i x_j + b_i); \quad j = 1,…,N \quad (1)

$$

其中,wi=(wi1, wi2, …, win) 表示从输入层到第 i 个隐藏层神经元的权重,bi=[bi1, bi2, …, bim] 表示从第 i 个隐藏层到输出层的权值。

公式(1)可以总结为:

$$

Y = Hb \quad (2)

$$

b 表示输出矩阵,H 是输入矩阵,可以表示为:

$$

H(w_1,…, w_L; b_1,…, b_L; x_1,…, x_N) =

\begin{bmatrix}

g(w_1 \cdot x_1 + b_1) & \cdots & g(w_L \cdot x_1 + b_L) \

\vdots & \ddots & \vdots \

g(w_1 \cdot x_N + b_1) & \cdots & g(w_L \cdot x_N + b_L)

\end{bmatrix}_{N×L}

\quad (3)

$$

有一个结论在[16]中指出,对于一个标准的单隐层前馈网络,其具有n个输入神经元,m个输出神经元,以及L个隐藏层神经元,给定N个不同观测值{xi, yi},如果激活函数g: R → R在任意区间内无限可微,则我们可以根据任意连续概率分布随机获取wi和bi,并得到结果:输入矩阵H是几乎必然可逆的,并且b可根据最小二乘解解析计算得出。因此我们得到公式(4)。

$$

\hat{b} = H^\dagger Y = \min_b ((Hb - Y) = 0) \quad (4)

$$

可根据公式(4)判断,不同的H†会导致不同的网络输出,此外,不同数量的隐含层神经元需要采用不同的方法来计算H†[17],例如奇异值分解、正交投影和迭代方法[18, 19],因此如何求解H†十分重要,一种流行且高效的闭式解为:

$$

\hat{b} =

\begin{cases}

H^T(I/C + HH^T)^{-1}T, & \text{if } N \leq L \

(I/C + H^TH)^{-1}H^TT, & \text{if } N > L

\end{cases}

\quad (5)

$$

其中C是用于控制训练误差和输出权重范数之间权衡的参数[20, 21],它可以显著提高网络精度。

2.2 极限学习机建模中的主要问题

方程(4)揭示了ELM具有快速训练速度的原因,但也暴露了精度和稳定性方面的两个问题。第一个问题是关于数量L以及输入矩阵W的权值,如果我们能选择它们的适当值,模型精度将得到提高;第二个问题是关于矩阵b,如上所述,b本质上由H决定,不同的H导致不同的b,但随机的W和传统的H†求解方法无法保证得到更好的b,尤其是当训练数据被污染时,因此我们需要一种新方法来获得更好的b。

3 提高模型稳定性的方法

3.1 ME‐ELM的设计

公式(4–5)表明仿真结果受训练数据影响很大,噪声数据不可避免地导致性能不佳。M估计器是一种稳健估计器,擅长从不良数据(特别是异常值)中得出可靠结论。因此,尝试将M估计器与极限学习机结合,通过采用估计函数和最小二乘准则,在迭代过程中调整输出矩阵参数,以减小噪声的影响,该方法被嵌入到ELM训练算法中,称为ME‐ELM。

考虑训练目标 $(Hb - Y) = 0$,公式(4) 可表示如下:

$$

\hat{b} = (H^TPH)^{-1}H^TPT \quad (6)

$$

其中P为调整矩阵,它可以通过自适应地改变其值来减小异常值的影响。如果样本没有偏差,则P中相关的系数均为1,这意味着ME‐ELM的工作方式与极限学习机相同;如果部分样本受到中等程度的污染,则矩阵P中对应的系数将小于1,以削弱噪声影响;对于含有粗大误差的样本,相应系数趋近于零,从而大幅降低不良影响。因此P在此起着重要作用,其值由估计函数 w进行调节,为了清晰描述,首先引入统计函数(x)。

$$

Q(b) = \sum_{i=1}^{N} q(e_i) = \sum_{i=1}^{N} q(T_i - H_ib_i) \quad (7)

$$

其中Q(x) 为优化目标函数,方程 (7) 的解称为M估计量:

$$

\hat{b} = \arg \min_b \left( \sum_{i=1}^{N} q(T_i - H_ib) \right) \quad (8)

$$

定义估计函数 $w(x) = \frac{\partial q(x)}{\partial b}$,因此最小的 b 为:

$$

\frac{\partial Q(b)}{\partial b} = 0 \Rightarrow \sum_{i=1}^{N} w(T_i - H_ib)H_i = 0 \quad (9)

$$

有几种常用的估计函数w,在效率和偏差方面使用其中一种可获得类似结果,Huber函数的表达式如公式(10)所示[24]。

$$

w(x) =

\begin{cases}

x, & |x| \leq k \

k, & |x| > k

\end{cases}; \quad

q(x) =

\begin{cases}

x^2/2, & |x| \leq k \

k|x| - k^2/2, & |x| > k

\end{cases}; \quad k = 1.345 \quad (10)

$$

ME‐ELM算法可设计如下:

步骤1

确定网络结构,使用普通ELM获取初始值:$b_0 = H^\dagger T$ 和 $e_0 = T - H^\dagger b_0$

步骤2

设置初始参数,例如调整因子 k = 1.345 和误差变量 e = 1

步骤3

迭代过程:

当 $((e < 1e^{-4})$ 或 $(N < 100))$ 时

(a) 将 $e_i$ 标准化为 $e_i = e_i/s = 0.6745e_i/\text{med}(|e_i|)$,其中 $\text{med}(|e_i|)$ 是 $|e_i|$ 的中位数。

(b) 调整 $W_i = w(u_i)$,并使用Huber函数计算 $\hat{b}(i) = (H^TW_iH)^{-1}H^TW_iT$。

(c) 更新变量:$e_i = T - H\hat{b}(i), N = N + 1, e = |\hat{b}(i) - \hat{b}(i-1)|$

结束循环

3.2 稳定性实验

为了验证ME‐ELM在提升稳定性方面的能力,采用了一些常用算法进行对比,包括ELM、ELM‐C、B_ELM和BP神经网络。这些网络基于含噪声的样本构建,并使用无噪声数据进行测试,然后通过均方根误差(RMSE)和偏差(DEV)来区分其稳定性性能。Sinc函数定义如下:

$$

y(x) =

\begin{cases}

\sin x / x, & x \neq 0 \

1, & x = 0

\end{cases}

\quad (11)

$$

首先,随机生成5000组数据,然后向自变量中添加白高斯噪声,通过选择不同的噪声分布范围[−0.2 0.2],[0 2],和[−2 2],准备三批5000个训练数据,在使用不同算法构建网络模型后,可用无噪声数据检验其稳定性性能。将 ME‐ELM与其他一些算法(如ELM‐C、BP神经网络)进行比较,隐层神经元数量固定为20,为考察ME‐ELM的通用性,测试了多个线性和非线性多变量函数,y= exp(x1/2) x1+ sin(x2) 的结果也列于表1中。

此外,为了避免ME‐ELM中出现秩亏问题,可以在式(10)的基础上向调整值添加随机微小值,表达如下。

$$

w(x) =

\begin{cases}

x, & |x| < k(k>0) \

k + 0.1 \times \text{rank}(0), & |x| > k(k>0)

\end{cases}

\quad (12)

$$

从图2中可以明显看出稳定性性能的差异,其中极限学习机[16]和ME‐ELM用于对添加了高斯噪声的训练数据建模Sinc函数,噪声分布区间为[0 2]。

从上述对比可以明显看出,ME‐ELM具有良好的降噪能力,能够生成性能远优于ELM、ELM‐C和B‐ELM的更优模型。

| Function | Testing error | ELM | ELM−C | B-ELM | BP | ME-ELM | Noise distribution |

|---|---|---|---|---|---|---|---|

| y = sinc(x) | RMSE | 0.002498 | 0.075118 | 0.365096 | 0.03426 | 0.000121 | [-0.2 0.2] |

| Dev | 0.000044 | −0.002815 | 0.105855 | −0.000025 | −0.000001 | ||

| RMSE | 0.102556 | 0.123228 | 0.329231 | 0.109186 | 0.002475 | [0 2] | |

| Dev | −0.100852 | −0.098573 | 0.005053 | −0.102048 | 0.000630 | ||

| RMSE | 0.020395 | 0.074426 | 0.3352543 | 0.037857 | 0.001051 | [-2 2] | |

| Dev | 0.002487 | 0.004764 | 0.072820 | 0.002093 | −0.000035 | ||

| y = exp(x1/2) × x1 + sin(x2) | RMSE | 0.002307 | 0.056295 | 0.073086 | 0.006358 | 0.000030 | [-0.2 0.2] |

| Dev | 0.0000078 | 0.000599 | −0.033326 | 0.000113 | 0 | ||

| RMSE | 0.101063 | 0.115764 | 0.486288 | 0.111284 | 0.000576 | [0 2] | |

| Dev | 0.099678 | −0.100685 | −0.415225 | −0.102691 | −0.000111 | ||

| RMSE | 0.016717 | 0.057668 | 0.093592 | 0.045291 | 0.000105 | [-2 2] | |

| Dev | −0.000287 | −0.001082 | 0.074013 | −0.000445 | 0.000013 |

Bold numbers are the best ones with least errors in different trials

4 钨极惰性气体保护焊建模与焊缝形状预测研究

焊接是一个复杂的时间变化过程,焊缝形状与许多变量相关[25, 26]。此外,焊缝形状容易受到干扰,即使电网的波动也可能导致几何形状发生变化,因此所有训练数据不可避免地会被污染,如何保证模型性能变得非常重要。

4.1 实验设计和数据采集

设计实验时,应首先确定影响因素及其相应水平,然后采用正交法安排实验设计矩阵,该项工作通常按以下步骤进行:

1. 确定重要的工艺参数。

2. 找出不同参数水平下的上下限。

3. 根据正交表确定设计矩阵。

4. 按照设计矩阵进行实验,如有需要,重复特定实验。

5. 必要时进行试样制备,并在不同样本上测量焊道形状。

6. 对数据进行滤波处理,并记录这些响应值。

为了便于比较,采用文献 [27] 中发布的钨极惰性气体保护焊数据,该数据也在 [28] 中使用,其中钨极惰性气体保护焊变量包括焊接速度 (S)、送丝速度 (WS)、清理百分比 (CP)、焊接电流 (C) 和电弧间隙 (G),焊道形状参数包括正面高度 (FH)、正面宽度 (FW)、背面高度 (BH) 和背面宽度 (BW),如表 2 所示。

| Number | Speed/ (cm.min⁻¹) | Wire speed/ (cm.min⁻¹) | Cleaning/ (%) | Gap/ (mm) | Current/ (V) | Front height/ (mm) | Front width/ (mm) | Back height/ (mm) | Back width/ (mm) |

|---|---|---|---|---|---|---|---|---|---|

| 1 | 24 | 1.5 | 30 | 2.4 | 80 | −0.149 | 6.09 | 0.672 | 5.664 |

| 2 | 24 | 1.5 | 30 | 3.2 | 80 | 0.027 | 6.411 | 0.412 | 5.197 |

| 3 | −0.179 | 7.058 | |||||||

| 4 | −0.306 | 6.895 | |||||||

| 5 | 0.155 | 5.96 | |||||||

| 6 | 24 | 2.5 | 30 | 3.2 | 80 | 0.099 | 6.824 | 0.803 | 5.732 |

| 7 | 24 | 2.5 | 70 | 2.4 | 80 | −0.129 | 7.009 | 0.878 | 6.989 |

| 8 | 24 | 2.5 | 70 | 3.2 | 80 | −0.077 | 7.46 | 0.82 | 7.809 |

| 9 | 24 | 1.5 | 30 | 2.4 | 95 | −0.017 | 8.664 | 0.437 | 8.75 |

| 10 | −0.25 | 9.993 | |||||||

| 11 | −0.553 | 9.993 | |||||||

| 12 | −0.42 | 10.687 | |||||||

| 13 | −0.345 | 10.237 | |||||||

| 14 | −0.043 | 9.076 | |||||||

| 15 | 24 | 2.5 | 70 | 2.4 | 95 | −0.134 | 9.75 | 0.798 | 9.465 |

| 16 | 24 | 2.5 | 70 | 3.2 | 95 | −0.168 | 10.348 | 0.708 | 10.193 |

| 17 | 24 | 1.5 | 30 | 2.4 | 110 | −0.599 | 11.348 | 0.805 | 11.679 |

| 18 | 24 | 1.5 | 30 | 3.2 | 110 | −0.745 | 11.491 | 1.1 | 11.848 |

| 19 | −0.254 | 12 | |||||||

| 20 | −0.683 | 13.921 | |||||||

| 21 | −0.232 | 10.611 | |||||||

| 22 | −0.557 | 12.403 | |||||||

| 23 | −0.623 | 12.86 | |||||||

| 24 | 24 | 2.5 | 70 | 3.2 | 110 | −0.617 | 12.533 | 1.084 | 13.346 |

| 25 | 35 | 1.5 | 30 | 2.4 | 80 | 0.123 | 5.355 | 0.245 | 4.104 |

| 26 | 0.108 | 3.418 | |||||||

| 27 | −0.044 | 4.875 | |||||||

| 28 | −0.09 | 5.082 | |||||||

| 29 | 0.251 | 4.37 | |||||||

| 30 | 35 | 2.5 | 30 | 3.2 | 80 | 0.23 | 5.562 | 0.593 | 3.948 |

| 31 | 35 | 2.5 | 70 | 2.4 | 80 | 0.18 | 5.711 | 0.45 | 5.085 |

| 32 | 35 | 2.5 | 70 | 3.2 | 80 | 0.12 | 5.85 | 0.626 | 4.989 |

| 33 | 35 | 1.5 | 30 | 2.4 | 95 | −0.213 | 6.348 | 0.458 | 5.874 |

| 34 | −0.19 | 6.74 | |||||||

| 35 | −0.152 | 6.994 | |||||||

| 36 | −0.213 | 7.019 | |||||||

| 37 | 35 | 2.5 | 30 | 2.4 | 95 | −0.164 | 7.288 | 0.715 | 6.724 |

| 38 | 35 | 2.5 | 30 | 3.2 | 95 | −0.113 | 6.966 | 0.746 | 6.433 |

| 39 | 35 | 2.5 | 70 | 2.4 | 95 | −0.107 | 7.055 | 0.696 | 7.24 |

| 40 | 35 | 2.5 | 70 | 3.2 | 95 | −0.018 | 7.549 | 0.591 | 7.166 |

| 41 | −0.575 | 8.763 | |||||||

| 42 | −0.267 | 8.58 | |||||||

| 43 | −0.385 | 9.652 | |||||||

| 44 | −0.564 | 9.952 | |||||||

| 45 | −0.556 | 8.853 | |||||||

| 46 | 35 | 2.5 | 30 | 3.2 | 110 | −0.188 | 9.442 | 0.666 | 9.614 |

| 47 | 35 | 2.5 | 70 | 2.4 | 110 | −0.309 | 9.015 | 0.784 | 9.041 |

| 48 | 35 | 2.5 | 70 | 3.2 | 110 | −0.318 | 9.297 | 0.785 | 9.47 |

| 49 | 46 | 1.5 | 30 | 2.4 | 80 | 0.357 | 4.982 | 0.001 | 2.255 |

| 50 | 0.168 | 2.998 | |||||||

| 51 | 0.088 | 3.302 | |||||||

| 52 | 0.09 | 3.172 | |||||||

| 53 | 0.39 | 1.33 | |||||||

| 54 | 0.487 | 1.6 | |||||||

| 55 | 46 | 2.5 | 70 | 2.4 | 80 | 0.38 | 5.231 | 0.397 | 2.817 |

| 56 | 46 | 2.5 | 70 | 3.2 | 80 | 0.394 | 5.337 | 0.378 | 3.041 |

| 57 | 46 | 1.5 | 30 | 2.4 | 95 | −0.321 | 5.847 | 0.44 | 5.332 |

| 58 | 46 | 1.5 | 30 | 3.2 | 95 | −0.152 | 5.704 | 0.386 | 5.35 |

| 59 | −0.155 | 5.415 | |||||||

| 60 | −0.09 | 5.319 | |||||||

| 61 | −0.236 | 5.531 | |||||||

| 62 | 46 | 2.5 | 30 | 3.2 | 95 | 0.067 | 6.03 | 0.575 | 5.636 |

| 63 | 46 | 2.5 | 70 | 2.4 | 95 | −0.075 | 5.562 | 0.816 | 4.835 |

| 64 | 46 | 2.5 | 70 | 3.2 | 95 | 0.138 | 6.546 | 0.575 | 6.285 |

| 65 | 46 | 1.5 | 30 | 2.4 | 110 | −0.217 | 6.092 | 0.359 | 6.419 |

| 66 | −0.339 | 7.52 | |||||||

| 67 | −0.249 | 7.706 | |||||||

| 68 | −0.396 | 7.601 | |||||||

| 69 | −0.01 | 6.197 | |||||||

| 70 | 0.074 | 6.072 | |||||||

| 71 | 46 | 2.5 | 70 | 2.4 | 110 | −0.201 | 7.052 | 0.658 | 7.48 |

| 72 | 46 | 2.5 | 70 | 3.2 | 110 | −0.358 | 7.759 | 0.798 | 7.917 |

4.2 TIG模型性能比较

为简便起见,仅给出ME‐ELM与BP、MNR和LR之间的比较。焊接数据首先进行归一化处理,然后分为两组:56条记录用于训练,其余16条记录用于测试。对于ME‐ELM,首先通过模拟退火算法(SA)将中间神经元数量设定为40,然后使用遗传算法(GA)获取合适的输入矩阵,最后采用M估计计算输出矩阵。BP网络设置为40个中间层节点数和4个输出数,激活函数和输出函数分别为“tansig”和“purelin”,比较结果如图3所示。

MNR模型始终优于线性回归[29],假设输入变量为X1、X2、X3、X4、X5,表示焊道形状的输出变量用FH、FW、BH和BW表示,则非线性回归形式可表示为:

$$

\begin{cases}

FH = g_1 x_1^{a_1} x_2^{a_2} x_3^{a_3} x_4^{a_4} x_5^{a_5} \

FW = g_2 x_1^{b_1} x_2^{b_2} x_3^{b_3} x_4^{b_4} x_5^{b_5} \

BH = g_3 x_1^{c_1} x_2^{c_2} x_3^{c_3} x_4^{c_4} x_5^{c_5} \

BW = g_1 x_1^{d_1} x_2^{d_2} x_3^{d_3} x_4^{d_4} x_5^{d_5}

\end{cases}

\quad (13)

$$

通过对原始数据进行适当处理,可以将其转换为:

$$

\begin{cases}

\lg(FH) = G_1 + a_1 \lg x_1 + a_2 \lg x_2 + a_3 \lg x_3 + a_4 \lg x_4 + a_5 \lg x_5 \

\lg(FW) = G_2 + b_1 \lg x_1 + b_2 \lg x_2 + b_3 \lg x_3 + b_4 \lg x_4 + b_5 \lg x_5 \

\lg(BH) = G_3 + c_1 \lg x_1 + c_2 \lg x_2 + c_3 \lg x_3 + c_4 \lg x_4 + c_5 \lg x_5 \

\lg(BW) = G_4 + d_1 \lg x_1 + d_2 \lg x_2 + d_3 \lg x_3 + d_4 \lg x_4 + d_5 \lg x_5

\end{cases}

\quad (14)

$$

其中 $ G_i = \lg(g_i) $;$ i = 1, 2, 3, 4 $

因此,可以根据最小二乘原理建立回归模型:

$$

\begin{cases}

FH = 0.7341 \times x_1^{-0.5667} \times x_2^{-0.3428} \times x_3^{-0.0874} \times x_4^{-0.0459} \times x_5^{-1.9754} \

FW = 7.8699 \times x_1^{-0.6622} \times x_2^{0.0392} \times x_3^{0.0844} \times x_4^{0.1290} \times x_5^{1.4149} \

BH = 0.7949 \times x_1^{-1.2730} \times x_2^{0.7392} \times x_3^{0.3809} \times x_4^{0.6715} \times x_5^{2.3903} \

BW = 7.6050 \times x_1^{-1.0607} \times x_2^{-0.0473} \times x_3^{0.01877} \times x_4^{0.1341} \times x_5^{2.5845}

\end{cases}

\quad (15)

$$

MNR、LR和ME‐ELM之间的比较结果如表3所示,较优的值以粗体显示,显然ME‐ELM算法具有更好的性能。

| Trial No. | Front height, FH/(mm) | Front width, FW/(mm) | Back height, BH/(mm) | Back width, BW/(mm) | ||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| MNR | LR[27] | ME-ELM | MNR | LR[27] | ME-ELM | MNR | LR[27] | ME-ELM | MNR | LR[27] | ME-ELM | |

| 1 | −0.1624 | −0.0006 | 0.0020 | 0.6293 | −0.0415 | 0.0019 | 0.0099 | −0.0034 | 0.00856 | 0.6206 | 0.1333 | 0.0046 |

| 2 | −0.0903 | 0.0164 | −0.0065 | −0.5725 | 1.2334 | 0.0003 | 0.1509 | 0 | −0.0027 | 0.5522 | 1.1617 | −0.0007 |

| 3 | −0.1112 | 0.0063 | 0.0029 | 0.2449 | −0.1281 | 0.0038 | −0.2356 | −0.0028 | 0.0153 | −0.496 | 0.2787 | 0.0013 |

| 4 | 0.0023 | −0.0088 | 0.0158 | −0.323 | 0.1066 | 0.00130 | 0.12986 | 0.0056 | 0.0130 | 1.2480 | −0.2834 | 0.0012 |

| 5 | −0.0074 | 0.0034 | 0.0010 | −0.1452 | −0.0647 | 0.0003 | −0.1127 | −0.0033 | 0.0070 | −0.495 | 0.18 | 0.0012 |

| 6 | 0.0708 | −0.0121 | −0.0113 | 0.4923 | 0.1534 | −0.0069 | −0.1654 | 0.0052 | −0.0030 | 0.2487 | −0.3809 | −0.0010 |

| 7 | 0.0335 | 0.1452 | −0.0050 | 0.2550 | 0.4801 | 0.00163 | 0.0299 | −0.1216 | −0.0024 | −1.1512 | 0.5552 | −0.0010 |

| 8 | 0.0214 | −0.0054 | −0.0299 | −0.3990 | 0.0601 | −0.0055 | −0.0909 | 0.0024 | −0.0248 | 0.3957 | −0.1491 | −0.0029 |

| 9 | 0.0660 | 0.0015 | −0.0069 | −0.7024 | 0.0001 | −0.0066 | −0.0604 | 0.0044 | −0.0047 | 1.0689 | −0.0704 | −0.0040 |

| 10 | 0.0053 | 0.0041 | −0.0072 | −0.1539 | −0.0572 | −0.0007 | −0.2244 | −0.0007 | −0.0002 | −0.8752 | 0.1368 | −0.0063 |

| 11 | 0.1061 | −0.0118 | 0.0075 | −1.0767 | 0.2149 | 0.0006 | 0.17868 | 0.0088 | −0.0015 | 0.52997 | −0.5185 | −0.0063 |

| 12 | −0.185 | 0.0077 | −0.0111 | 0.6632 | −0.2057 | −0.0047 | −0.06152 | −0.013 | −0.0040 | 0.04378 | 0.5619 | 0.0027 |

| 13 | 0.1110 | 0.0028 | −0.0103 | −1.0788 | −0.065 | 0 | 0.30235 | −0.0058 | −0.0034 | 1.61262 | 0.1894 | 0.0023 |

| 14 | −0.123 | 0.6169 | −0.0069 | −0.2866 | −0.371 | −0.0030 | −0.0428 | −0.0665 | 0.0024 | −0.2102 | −0.2039 | −0.0058 |

| 15 | 0.1397 | −0.0012 | 0.0207 | −0.1012 | −0.0114 | −0.0026 | 0.37200 | −0.002 | 0.0086 | 1.7290 | 0.0448 | −0.0028 |

| 16 | 0.0952 | −0.0014 | 0.0023 | 0.1103 | 0.0397 | −0.0043 | −0.0031 | 0.0045 | 0.0003 | −0.3124 | −0.1223 | −0.0081 |

Bold numbers are the best ones with least errors in different trials

5 ME‐ELM在水下焊接中的讨论

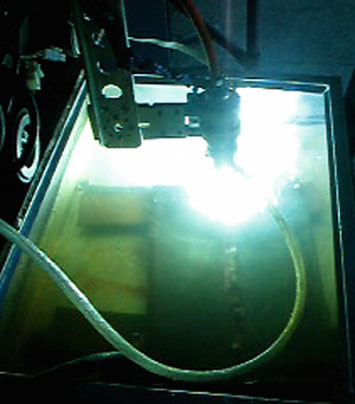

针对焊接参数优化方法的研究已开展较长时间,其中焊接模型至关重要,尤其是在水下焊接中[30]。水下焊接主要有三种方法,分别为湿法焊接、干法焊接和半干法焊接。与其他两种方法相比,湿法焊接过程中伴随大量气泡和湍流fluid,同时蒸发冷却对熔区影响显著,导致焊接性能较差,水平堆焊示意图如图4所示。因此,在建立湿法焊接模型时抑制噪声十分关键,初步研究表明ME‐ELM能够有效发挥作用,详细结果将在后续论文中给出。

6 结论

本文研究了提高模型精度和稳定性的方法,在基准问题、人工函数以及实际 TIG焊接过程上的对比结果表明,ME‐ELM能够有效工作。进一步得出以下结论:

- 在降低数据噪声和提高仿真精度方面,ME‐ELM优于BP神经网络、普通ELM及其修正方法(如ELM‐C、B‐ELM),适用于构建焊接模型。

- ME‐ELM中估计函数的参数k非常重要。较小的k会导致异常值的权值较小,从而对异常值的影响产生较强的抑制作用;相反,如果将k设置为较大的正数,则ME‐ELM将趋近于普通ELM。

- MNR和LR均为基于原型的方法,其性能主要依赖于类型假设,通常情况下,它们的仿真精度不如ME‐ELM。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?