本文系统地介绍了大语言模型(LLMs)的基础理论、架构设计、Prompt工程、参数高效微调以及模型编辑等关键技术,并探讨了这些技术在实际应用中的效果和挑战。通过详细的理论分析和实践案例,文章旨在为读者提供一个全面而深入的大语言模型知识体系。

(方便大家直接下载,这里给大家整理好了书籍的PDF,扫码即可↓↓↓↓)

各个主题总结

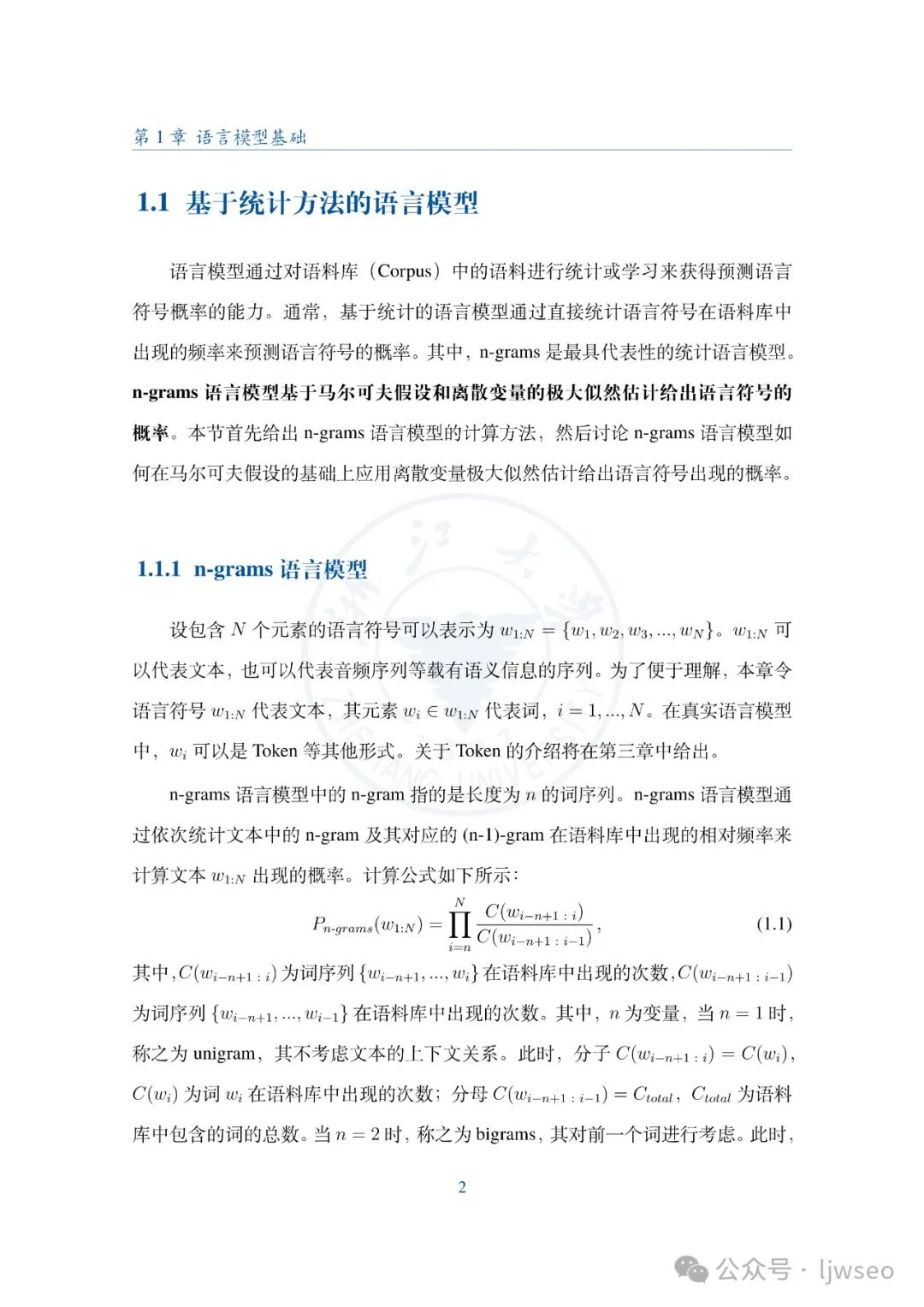

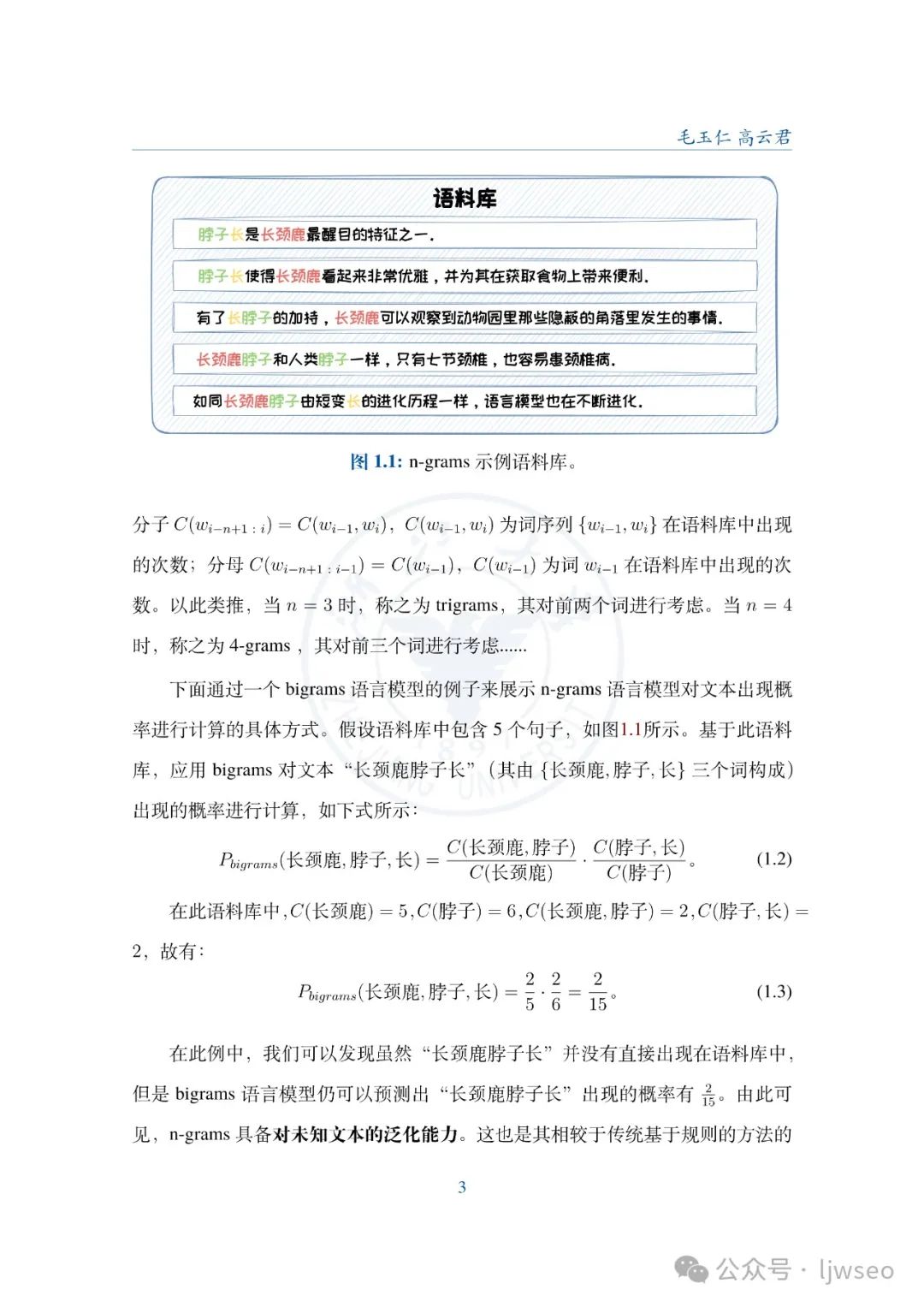

- 语言模型基础

-

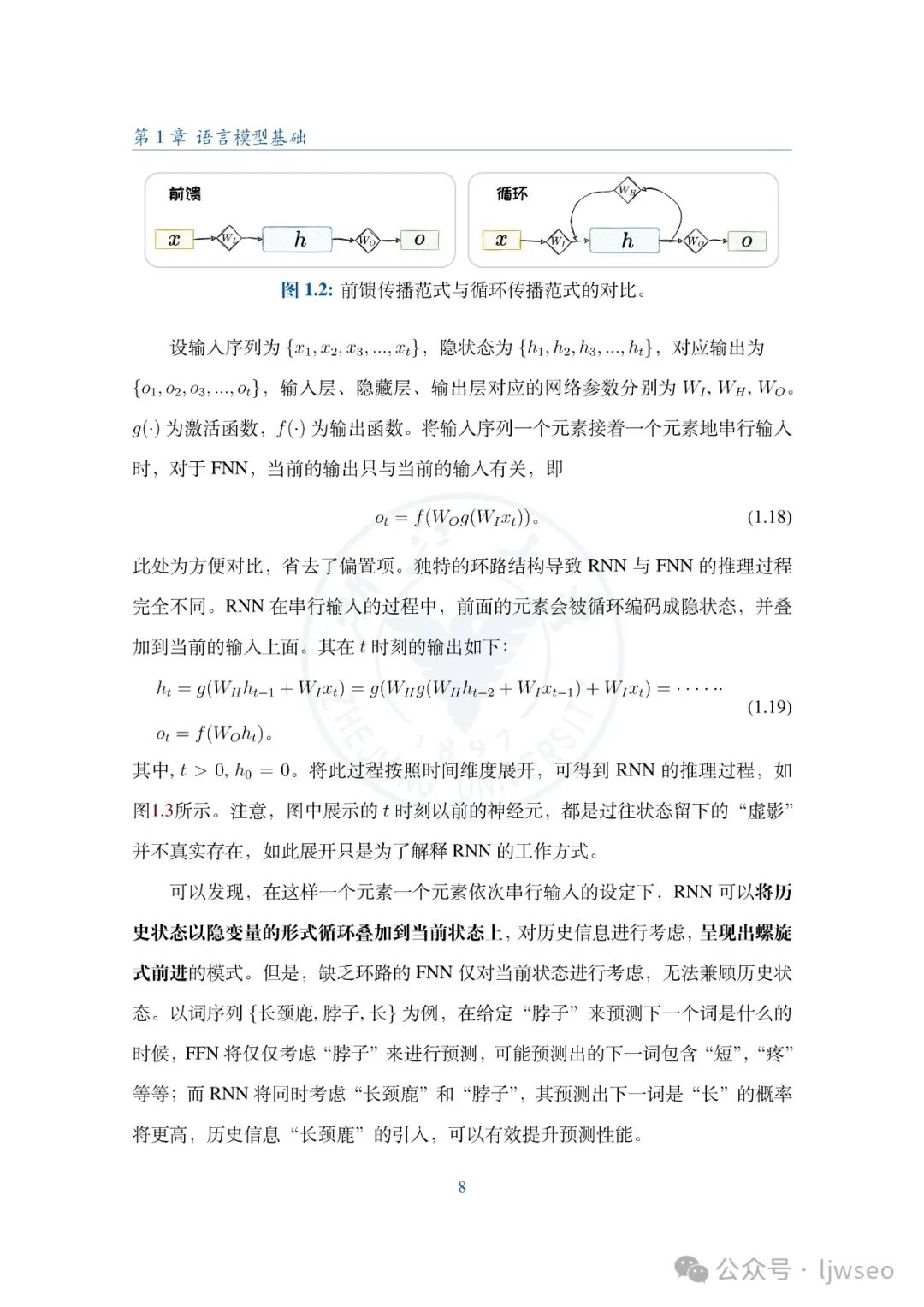

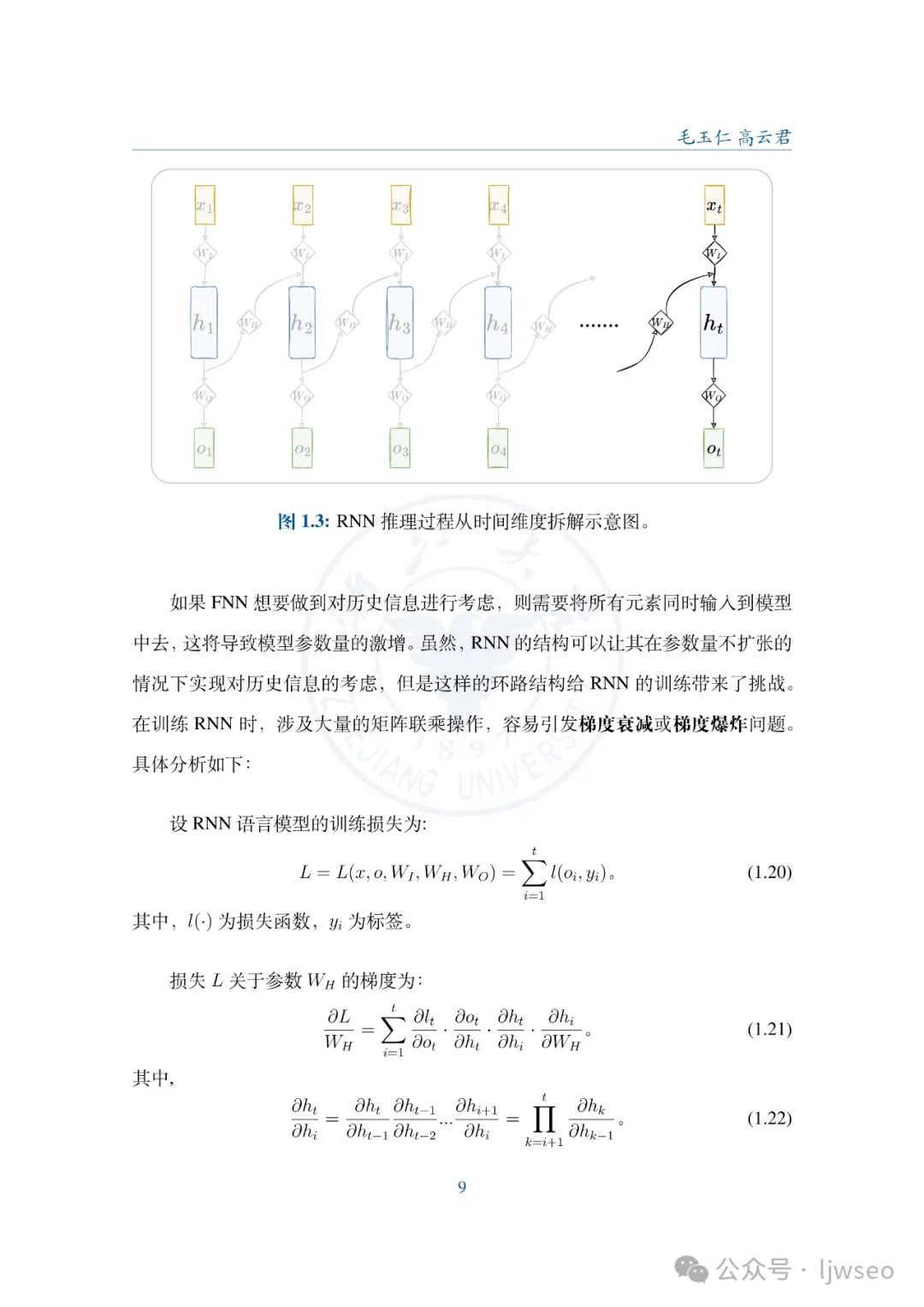

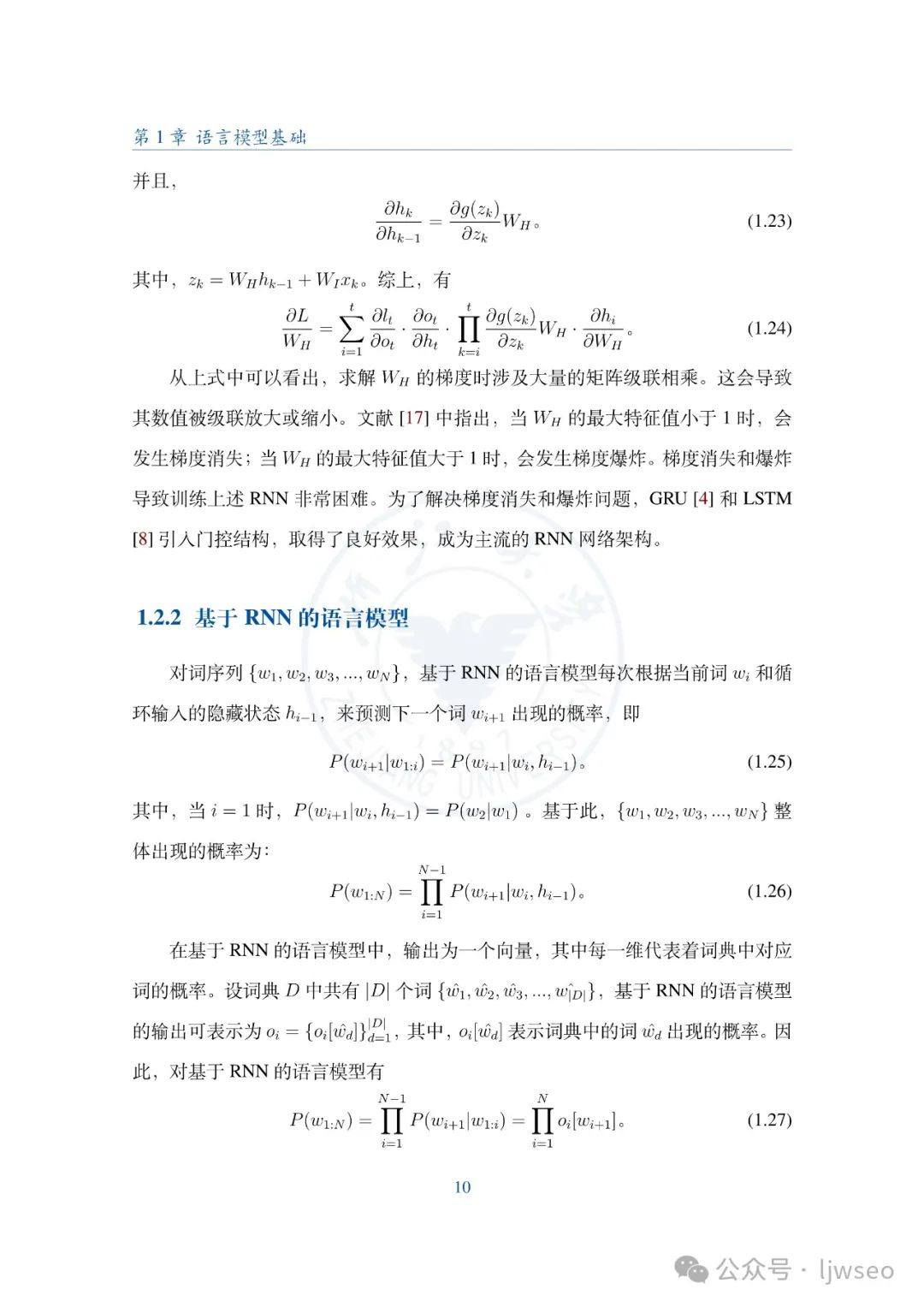

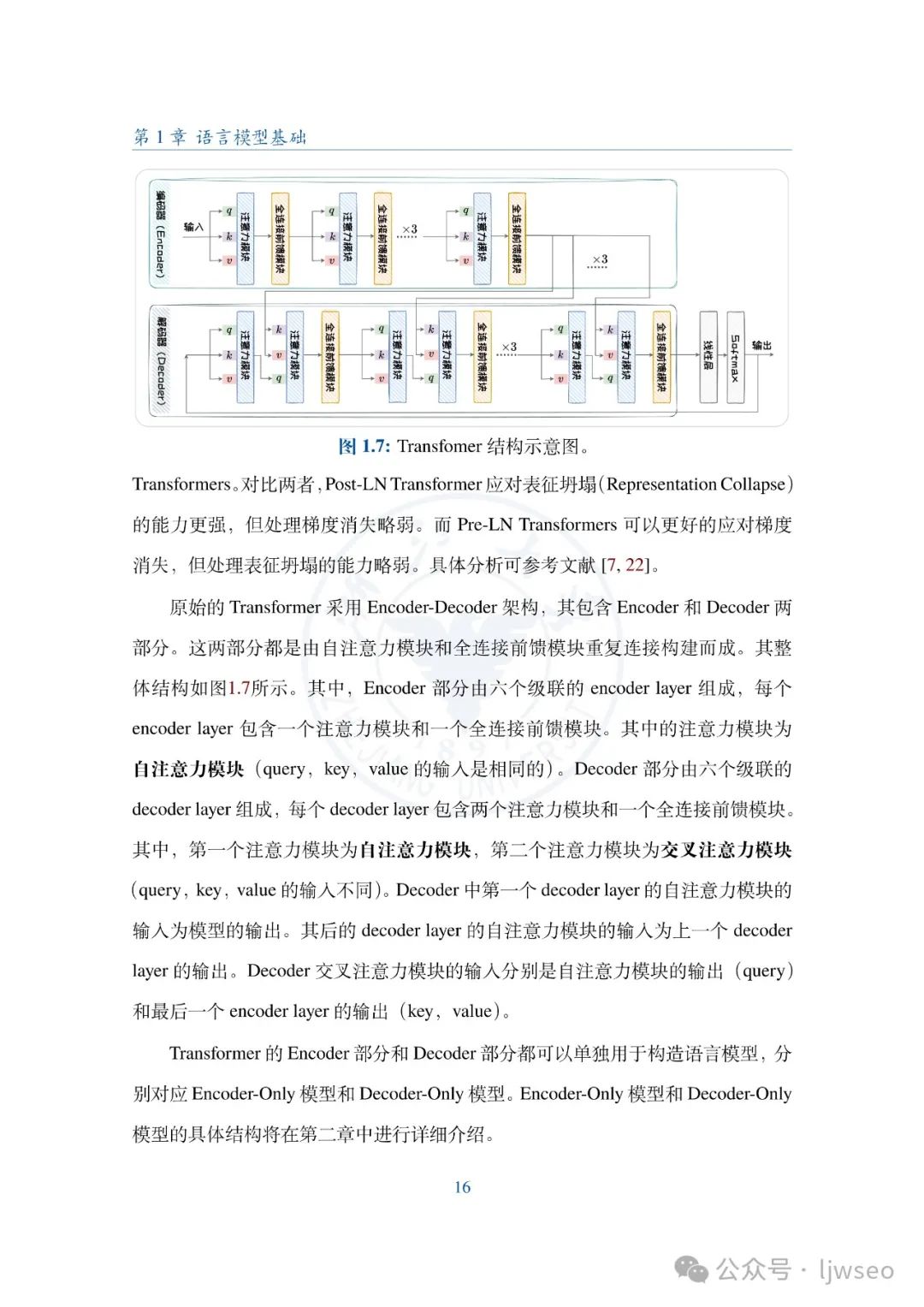

介绍了基于统计方法、RNN和Transformer的语言模型。

-

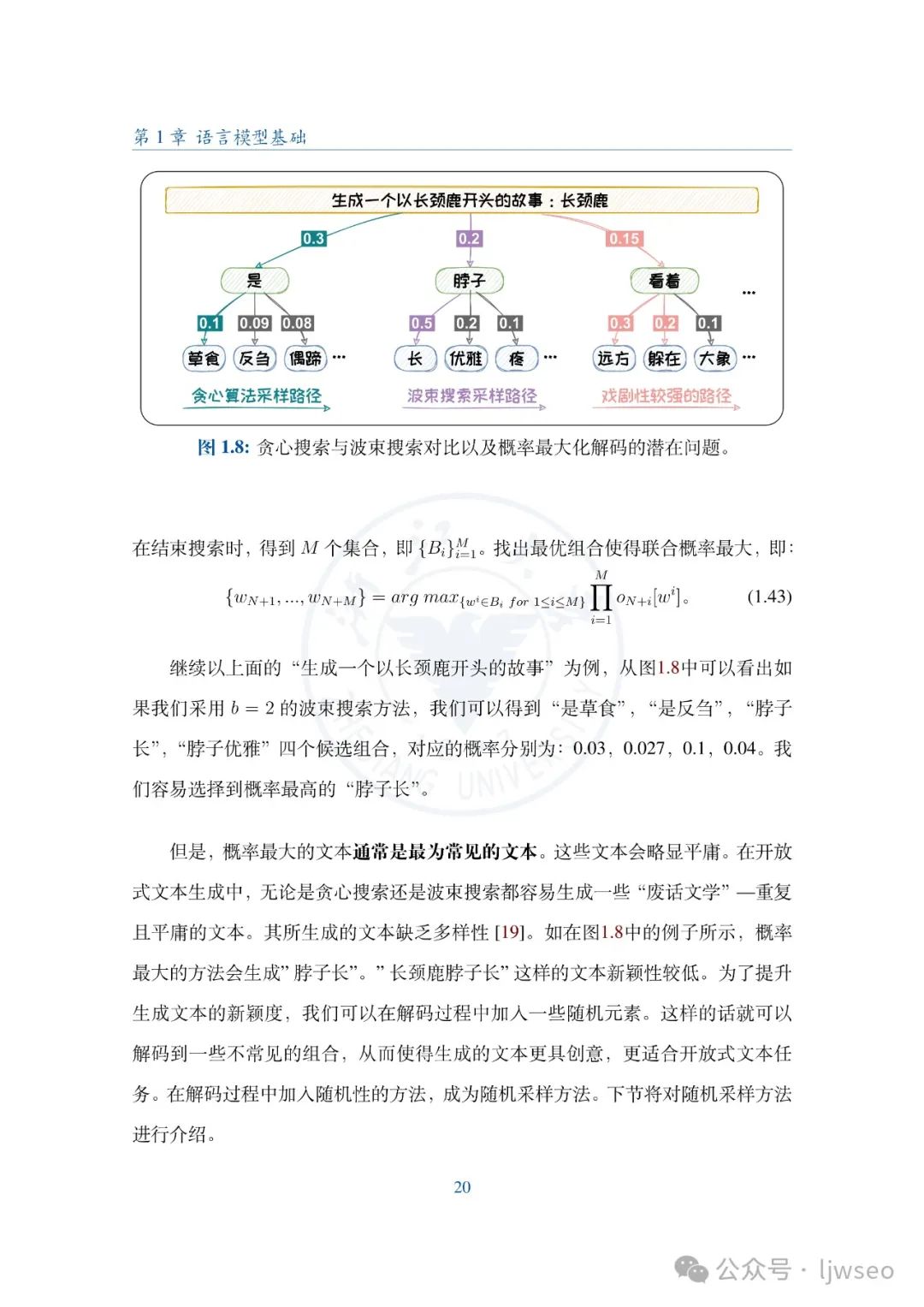

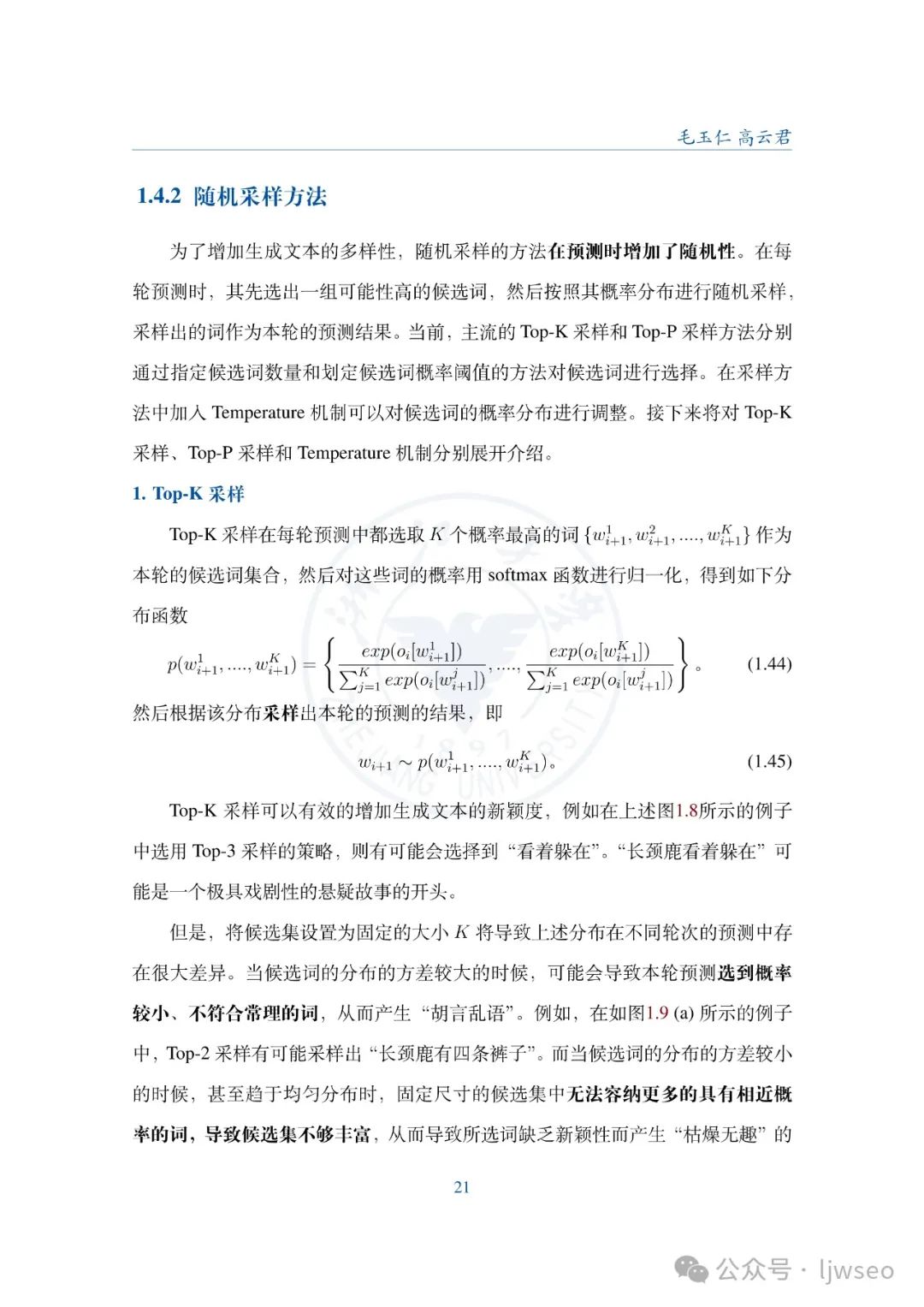

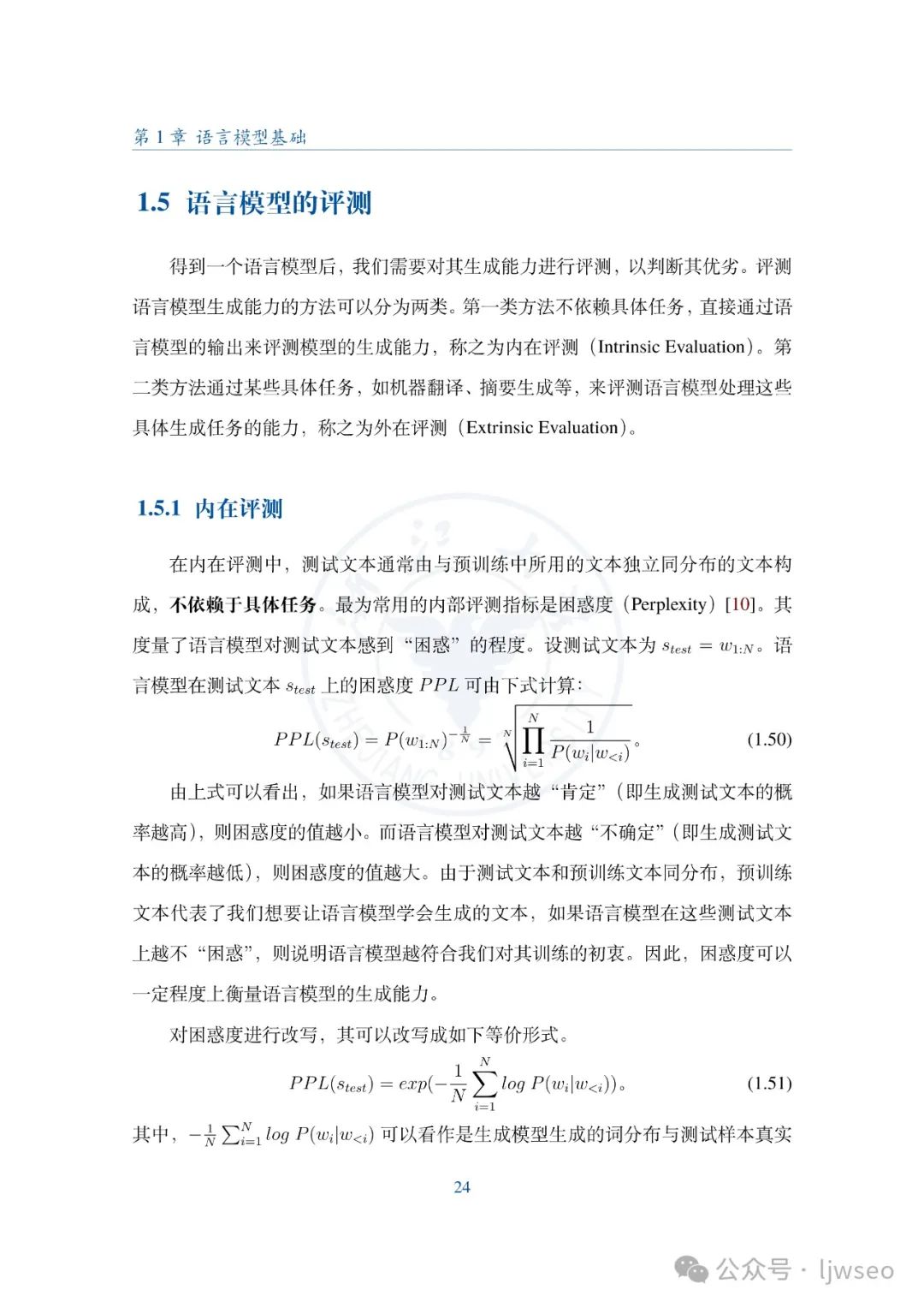

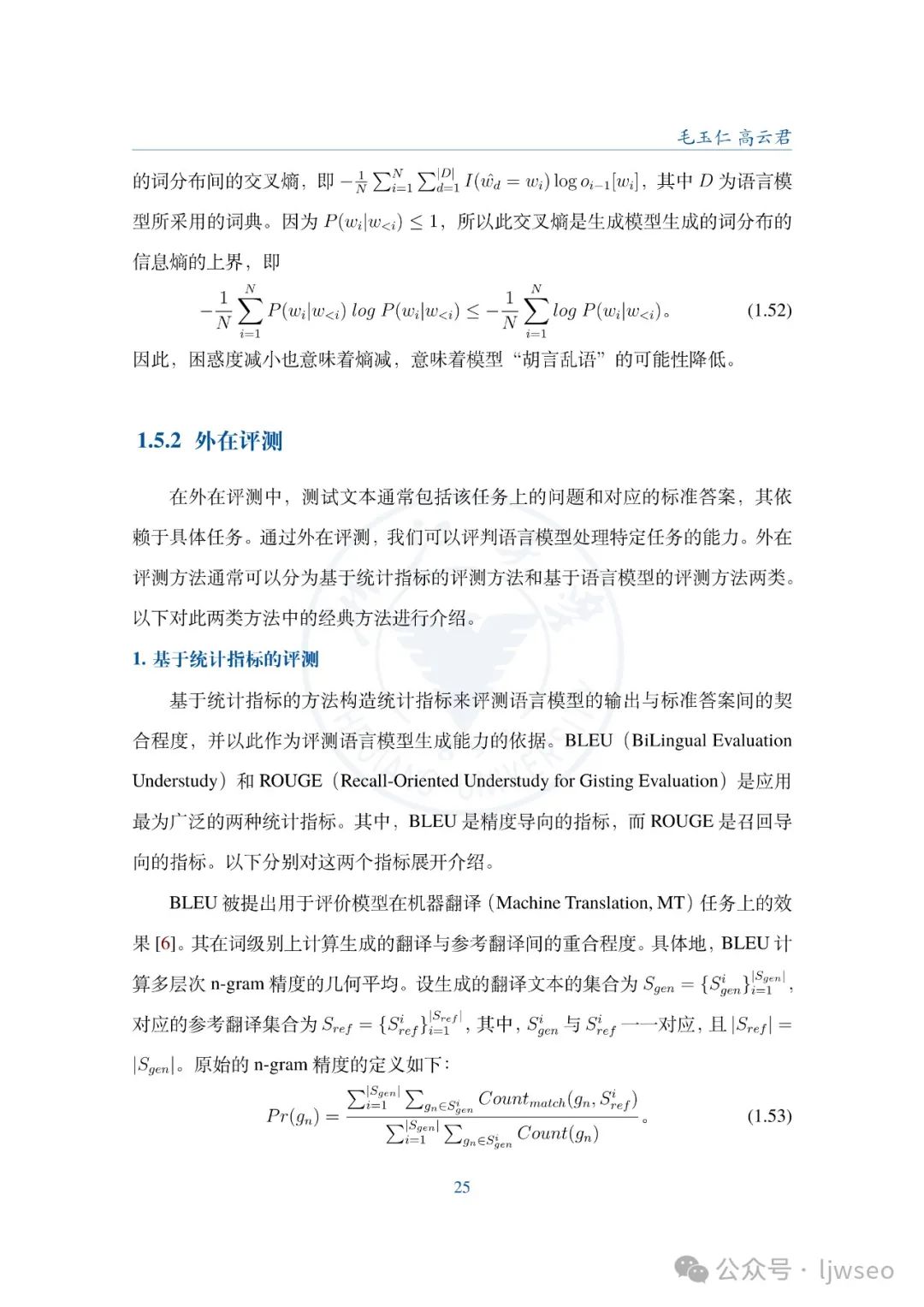

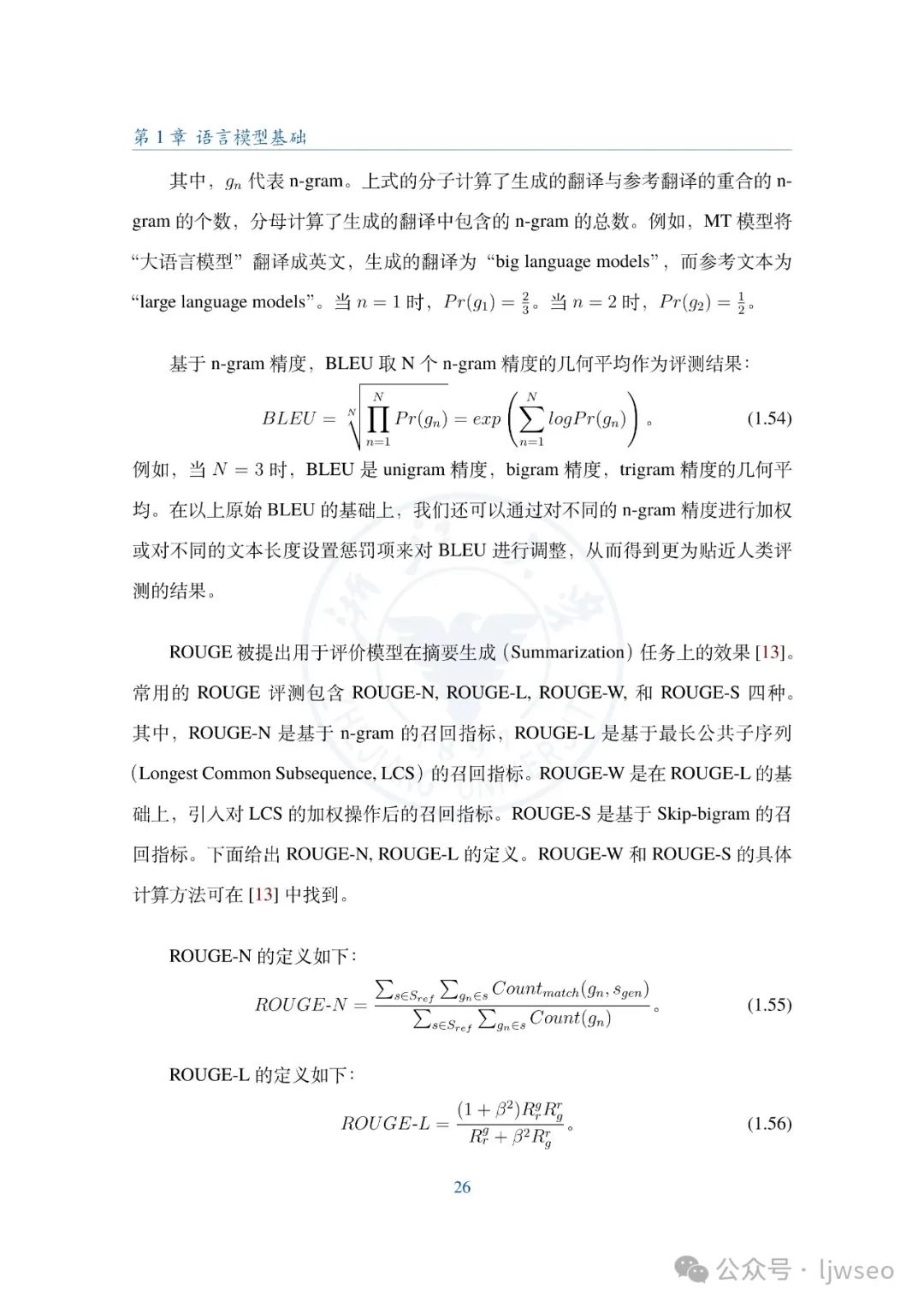

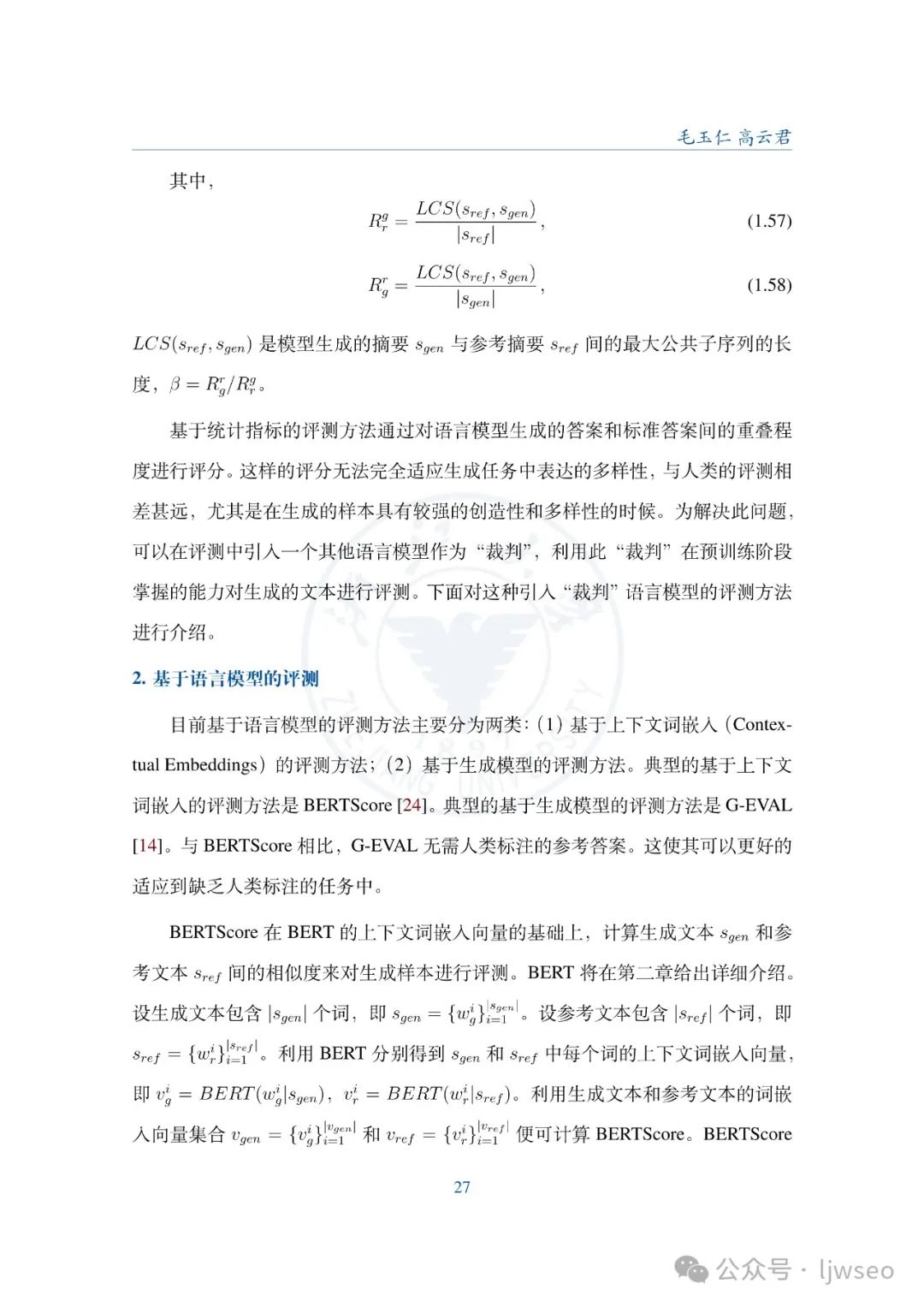

讨论了语言模型的采样方法和评测方法,包括内在评测和外在评测。

- 大语言模型架构

-

深入探讨了大数据和大模型如何推动新智能的涌现。

-

详细介绍了Encoder-only、Encoder-Decoder和Decoder-only三种主流模型架构及其代表性模型,如BERT、T5、GPT系列等。

-

讨论了非Transformer架构的模型,如状态空间模型(SSM)和训练时更新(TTT)。

- Prompt工程

-

定义了Prompt和Prompt工程的概念,强调了Prompt在大语言模型中的重要性。

-

介绍了上下文学习、思维链提示(CoT)等技术,以及如何通过Prompt工程提升模型的推理能力和任务适应性。

-

提供了Prompt编写的技巧和实际应用案例,如智能代理、数据合成、Text-to-SQL等。

- 参数高效微调

-

定义了参数高效微调(PEFT)的概念及其重要性。

-

详细介绍了参数附加方法、参数选择方法和低秩适配方法,如Prompt-tuning、Adapter-tuning、LoRA等。

-

讨论了PEFT在垂直领域的实际应用和优势。

- 模型编辑

-

介绍了模型编辑的概念和方法,包括外部拓展法和内部修改法。

-

详细介绍了定位编辑法(ROME)和附加参数法(T-Patcher)。

-

讨论了模型编辑在实际应用中的效果和挑战,如精准模型更新、保护被遗忘权和提升模型安全。

- 检索增强生成

-

介绍了检索增强生成(RAG)的背景和组成。

-

详细讨论了RAG的架构分类、知识检索和生成增强技术。

-

提供了RAG在实际应用中的案例,如搭建简单RAG系统和典型应用。

(方便大家直接下载,这里给大家整理好了书籍的PDF,扫码即可↓↓↓↓)

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?