线性回归:

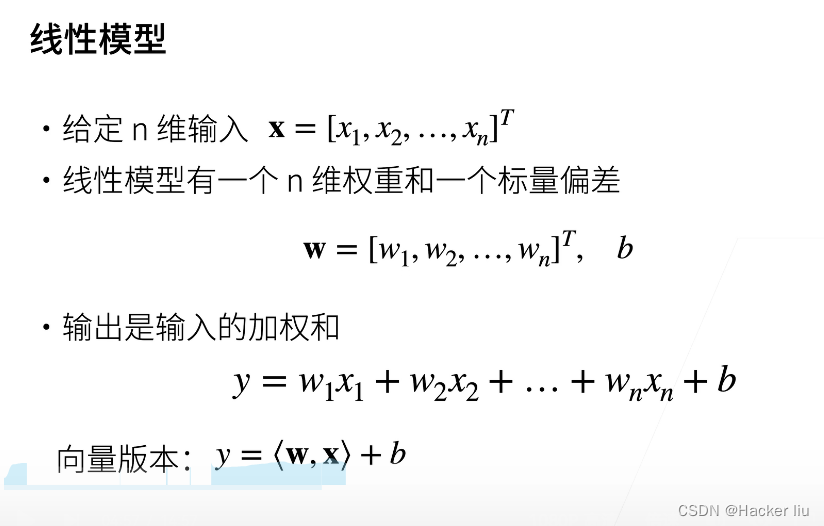

1.线性回归是对n维输入的加权,外加偏差。

2.使用平方损失来衡量预测值和真实值的差异

3.线性回归有显示解

4.线性回归可以看做是单层神经网络

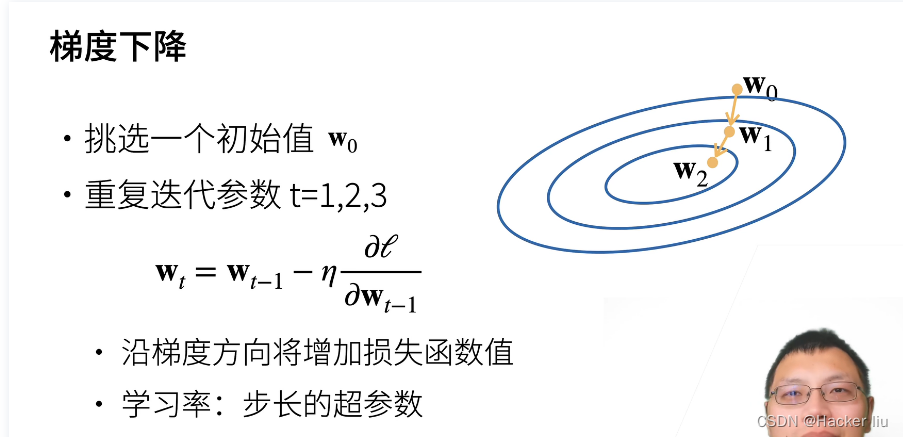

二、梯度下降 (就是算出最小的评价函数。)

求解Loss函数最小值可以这样实现:从当前的参数取值,一步步的按照下坡的方向下降,直到走到最低点。这种方法笔者称它为“盲人下坡法”。(学习率不能太大也不能太小)

随机梯度下降:将所有样本对梯度的贡献取平均,根据梯度更新参数。(由于参数每次只沿着梯度反方向更新一点点,因此方向并不需要那么精确。一个合理的解决方案是每次从总的数据集中随机抽取出小部分数据来代表整体,基于这部分数据计算梯度和损失来更新参数,这种方法被称作随机梯度下降法),以下是他用到的参数。

这篇博客探讨了线性回归的基本原理,包括输入的加权、平方损失函数以及存在解析解的特点。同时,解释了梯度下降作为求解最小损失函数的方法,通过逐步调整参数来逼近最优解。介绍了随机梯度下降的优化策略,强调了学习率的选择和小批量数据更新的重要性。

这篇博客探讨了线性回归的基本原理,包括输入的加权、平方损失函数以及存在解析解的特点。同时,解释了梯度下降作为求解最小损失函数的方法,通过逐步调整参数来逼近最优解。介绍了随机梯度下降的优化策略,强调了学习率的选择和小批量数据更新的重要性。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?