1 实验介绍

1.1 数据集介绍

本次实验使用百度与林业大学合作开发的林业病虫害防治项目中的昆虫数据集,AI识虫数据集结构如下:

- 提供了2183张图片,其中训练集1693张,验证集245,测试集245张。

- 包含7种昆虫,分别是Boerner、Leconte、Linnaeus、acuminatus、armandi、coleoptera和linnaeus。

- 包含了图片和标注,请读者先将数据解压,并存放在insects目录下。

将数据解压之后,可以看到insects目录下的结构如下所示。

insects

|---train

| |---annotations

| | |---xmls

| | |---100.xml

| | |---101.xml

| | |---...

| |

| |---images

| |---100.jpeg

| |---101.jpeg

| |---...

|

|---val

| |---annotations

| | |---xmls

| | |---1221.xml

| | |---1277.xml

| | |---...

| |

| |---images

| |---1221.jpeg

| |---1277.jpeg

| |---...

|

|---test

|---images

|---1833.jpeg

|---1838.jpeg

|---...

insects包含train、val和test三个文件夹。train/annotations/xmls目录下存放着图片的标注。每个xml文件是对一张图片的说明,包括图片尺寸、包含的昆虫名称、在图片上出现的位置等信息。

<annotation>

<folder>刘霏霏</folder>

<filename>100.jpeg</filename>

<path>/home/fion/桌面/刘霏霏/100.jpeg</path>

<source>

<database>Unknown</database>

</source>

<size>

<width>1336</width>

<height>1336</height>

<depth>3</depth>

</size>

<segmented>0</segmented>

<object>

<name>Boerner</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>500</xmin>

<ymin>893</ymin>

<xmax>656</xmax>

<ymax>966</ymax>

</bndbox>

</object>

<object>

<name>Leconte</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>622</xmin>

<ymin>490</ymin>

<xmax>756</xmax>

<ymax>610</ymax>

</bndbox>

</object>

<object>

<name>armandi</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>432</xmin>

<ymin>663</ymin>

<xmax>517</xmax>

<ymax>729</ymax>

</bndbox>

</object>

<object>

<name>coleoptera</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>624</xmin>

<ymin>685</ymin>

<xmax>697</xmax>

<ymax>771</ymax>

</bndbox>

</object>

<object>

<name>linnaeus</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>783</xmin>

<ymin>700</ymin>

<xmax>856</xmax>

<ymax>802</ymax>

</bndbox>

</object>

</annotation>

上面列出的xml文件中的主要参数说明如下:

- size:图片尺寸。

- object:图片中包含的物体,一张图片可能中包含多个物体。

- name:昆虫名称;

- bndbox:物体真实框;

- difficult:识别是否困难。

1.2 yolov3介绍

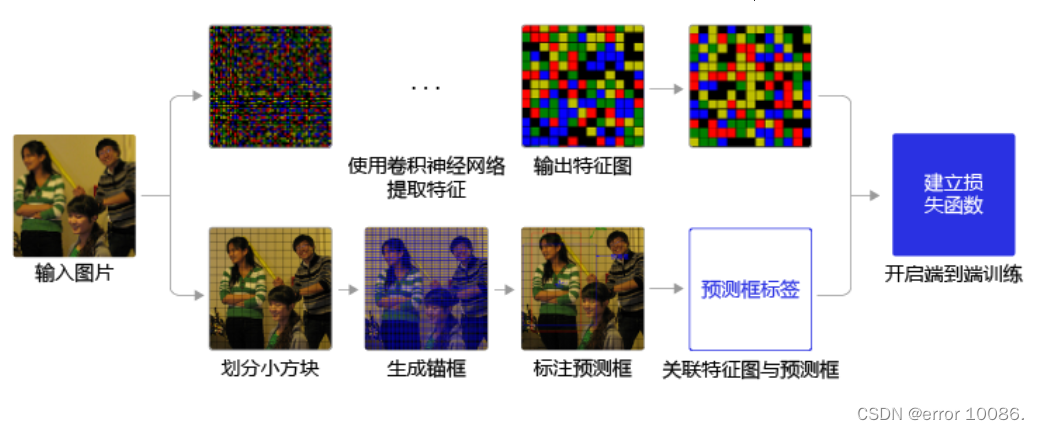

YOLOv3算法的基本思想可以分成两部分:

- 按一定规则在图片上产生一系列的候选区域,然后根据这些候选区域与图片上物体真实框之间的位置关系对候选区域进行标注。跟真实框足够接近的那些候选区域会被标注为正样本,同时将真实框的位置作为正样本的位置目标。偏离真实框较大的那些候选区域则会被标注为负样本,负样本不需要预测位置或者类别。

- 使用卷积神经网络提取图片特征并对候选区域的位置和类别进行预测。这样每个预测框就可以看成是一个样本,根据真实框相对它的位置和类别进行了标注而获得标签值,通过网络模型预测其位置和类别,将网络预测值和标签值进行比较,就可以建立起损失函数。

YOLOv3算法训练过程的流程图如 图1 所示:

图1:YOLOv3算法训练流程图

- **图1 左边是输入图片,上半部分所示的过程是使用卷积神经网络对图片提取特征,随着网络不断向前传播,特征图的尺寸越来越小,每个像素点会代表更加抽象的特征模式,直到输出特征图,其尺寸减小为原图的132321。

- **图1 下半部分描述了生成候选区域的过程,首先将原图划分成多个小方块,每个小方块的大小是32×3232×32,然后以每个小方块为中心分别生成一系列锚框,整张图片都会被锚框覆盖到。在每个锚框的基础上产生一个与之对应的预测框,根据锚框和预测框与图片上物体真实框之间的位置关系,对这些预测框进行标注。

- 将上方支路中输出的特征图与下方支路中产生的预测框标签建立关联,创建损失函数,开启端到端的训练过程。

2 实验过程

2.1 使用PaddlePaddle框架实现AI识虫

使用PaddlePaddle框架进行数据读取与预处理,以及YOLOv3模型的实现。使用到的数据增强操作包括:

- 随机改变图片亮度、对比度和颜色

- 随机填充

- 随机裁剪

- 随机缩放

- 随机翻转

- 随机打乱真实框排列顺序

YOLOv3的模型整体定义如下:

class YoloDetectionBlock(paddle.nn.Layer):

# define YOLOv3 detection head

# 使用多层卷积和BN提取特征

def __init__(self,ch_in,ch_out,is_test=True):

super(YoloDetectionBlock, self).__init__()

assert ch_out % 2 == 0, \

"channel {} cannot be divided by 2".format(ch_out)

self.conv0 = ConvBNLayer(

ch_in=ch_in,

ch_out=ch_out,

kernel_size=1,

stride=1,

padding=0)

self.conv1 = ConvBNLayer(

ch_in=ch_out,

ch_out=ch_out*2,

kernel_size=3,

stride=1,

padding=1)

self.conv2 = ConvBNLayer(

ch_in=ch_out*2,

ch_out=ch_out,

kernel_size=1,

stride=1,

padding=0)

self.conv3 = ConvBNLayer(

ch_in=ch_out,

ch_out=ch_out*2,

kernel_size=3,

stride=1,

padding=1)

self.route = ConvBNLayer(

ch_in=ch_out*2,

ch_out=ch_out,

kernel_size=1,

stride=1,

padding=0)

self.tip = ConvBNLayer(

ch_in=ch_out,

ch_out=ch_out*2,

kernel_size=3,

stride=1,

padding=1)

def forward(self, inputs):

out = self.conv0(inputs)

out = self.conv1(out)

out = self.conv2(out)

out = self.conv3(out)

route = self.route(out)

tip = self.tip(route)

return route, tip

# 定义YOLOv3模型

class YOLOv3(paddle.nn.Layer):

def __init__(self, num_classes=7):

super

该博客围绕AI识虫实验展开,使用百度与林业大学合作的昆虫数据集,分别用PaddlePaddle和PaddleX框架实现YOLOv3模型,还尝试了yolov5训练。分析了模型效果,进行优化和评估,指出选择合适骨干网络、检测架构等可提升性能,引入PaddleX框架可简化开发。

该博客围绕AI识虫实验展开,使用百度与林业大学合作的昆虫数据集,分别用PaddlePaddle和PaddleX框架实现YOLOv3模型,还尝试了yolov5训练。分析了模型效果,进行优化和评估,指出选择合适骨干网络、检测架构等可提升性能,引入PaddleX框架可简化开发。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?