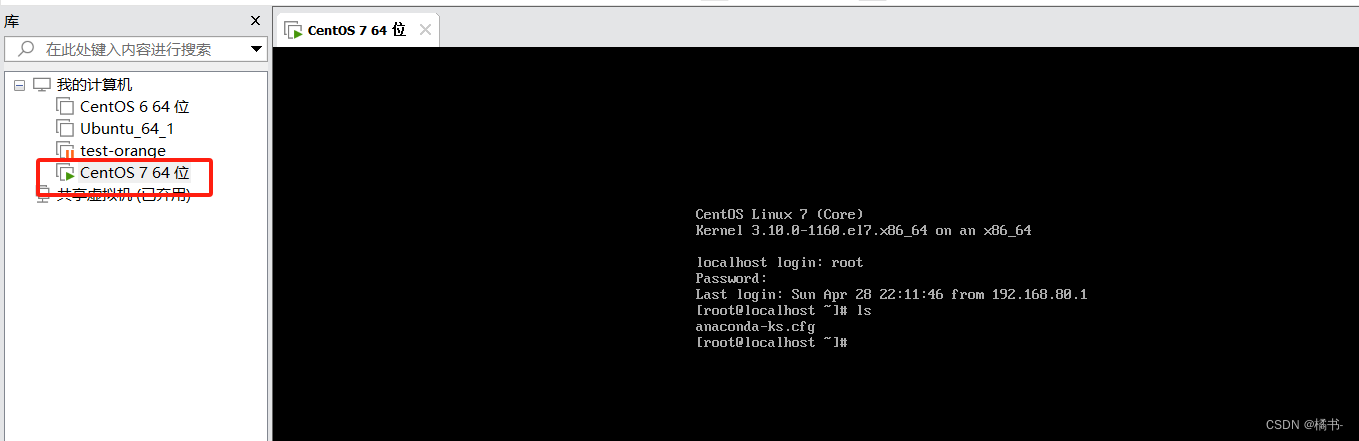

1.搭建一台服务器,我用的镜像是centos7

2.centos安装yum,可以从指定的服务器自动下载RPM包并且安装,自动处理依赖性关系并且直接安装所需要的所有依赖,省时省力

安装教程引用https://blog.youkuaiyun.com/weixin_45457922/article/details/116430625

3.安装docker,要注意安装新版,旧版本会导致maxkb无法安装

docker官网安装教程Install Docker Engine on CentOS | Docker Docs

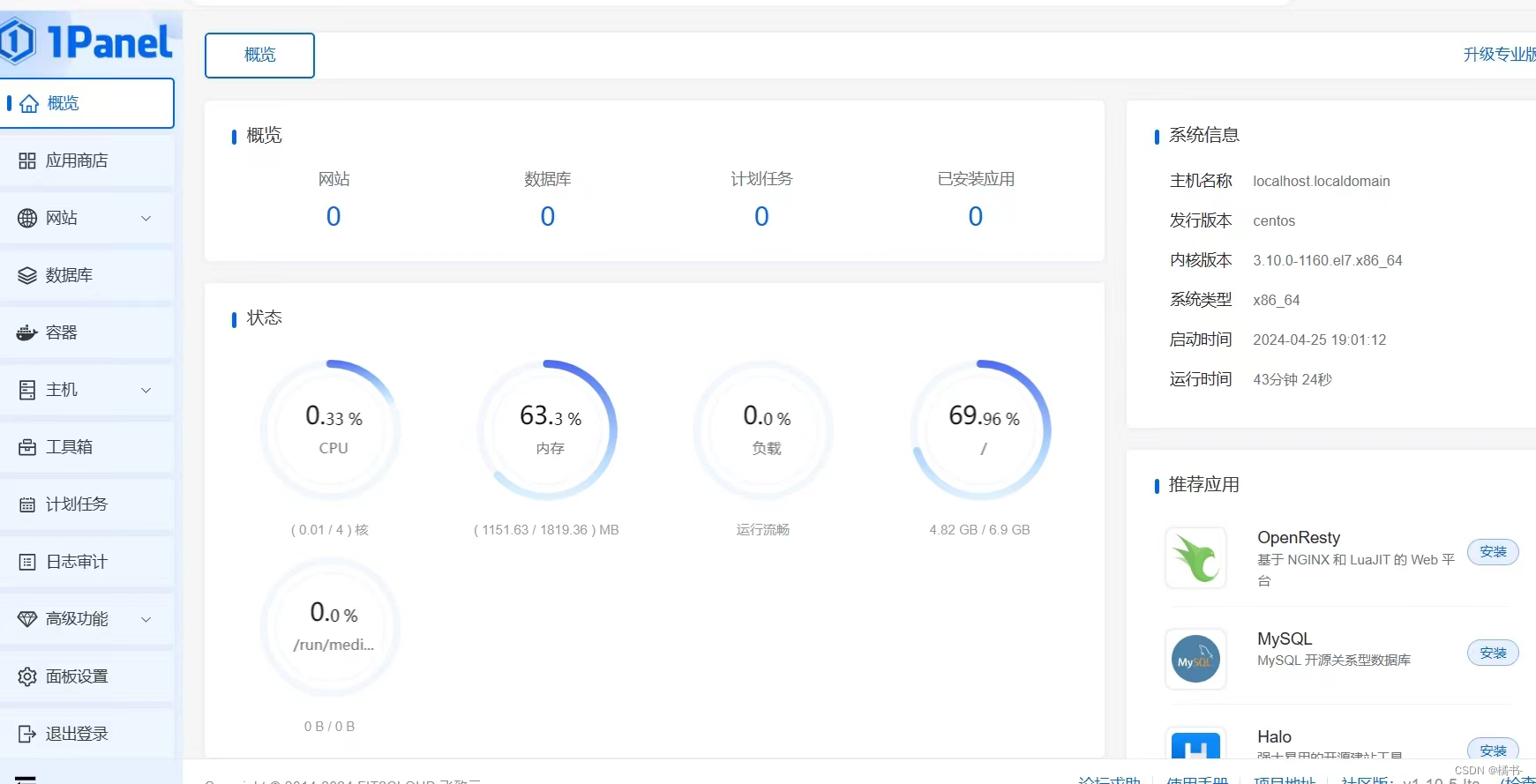

4.安装panel运行面板,安装完会给一个登录网址

curl -sSL https://resource.fit2cloud.com/1panel/package/quick_start.sh -o quick_start.sh && sh quick_start.sh

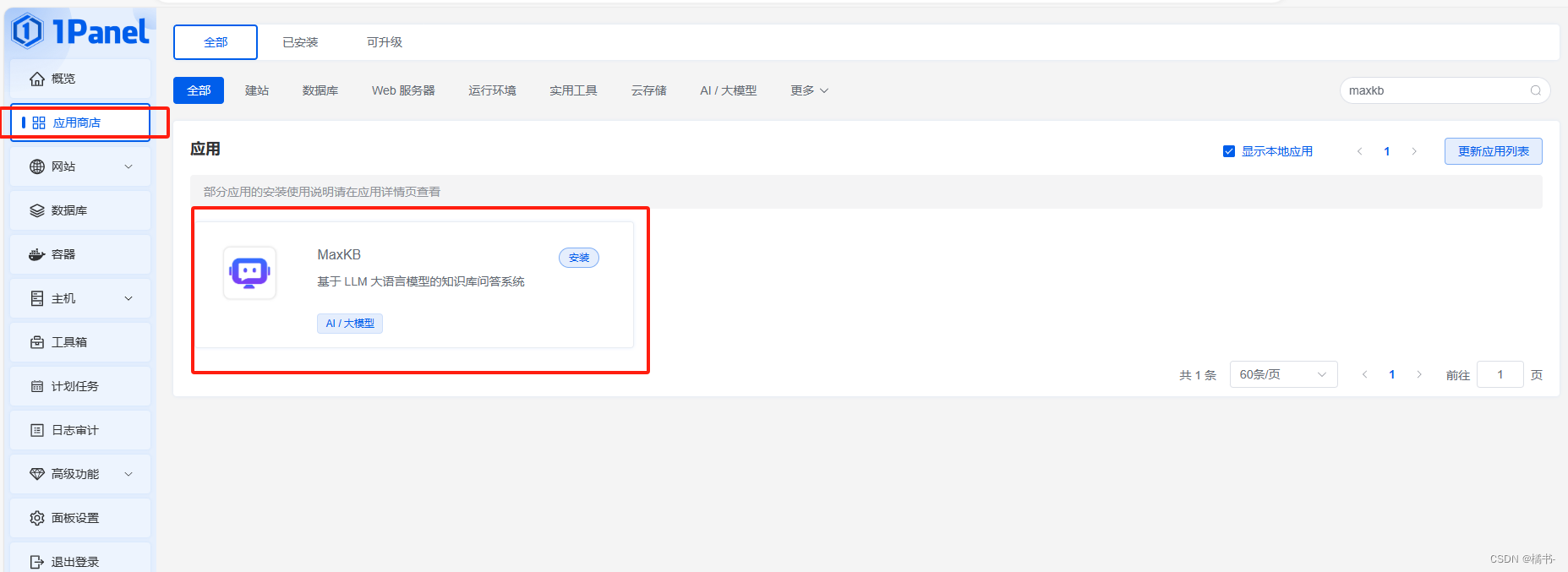

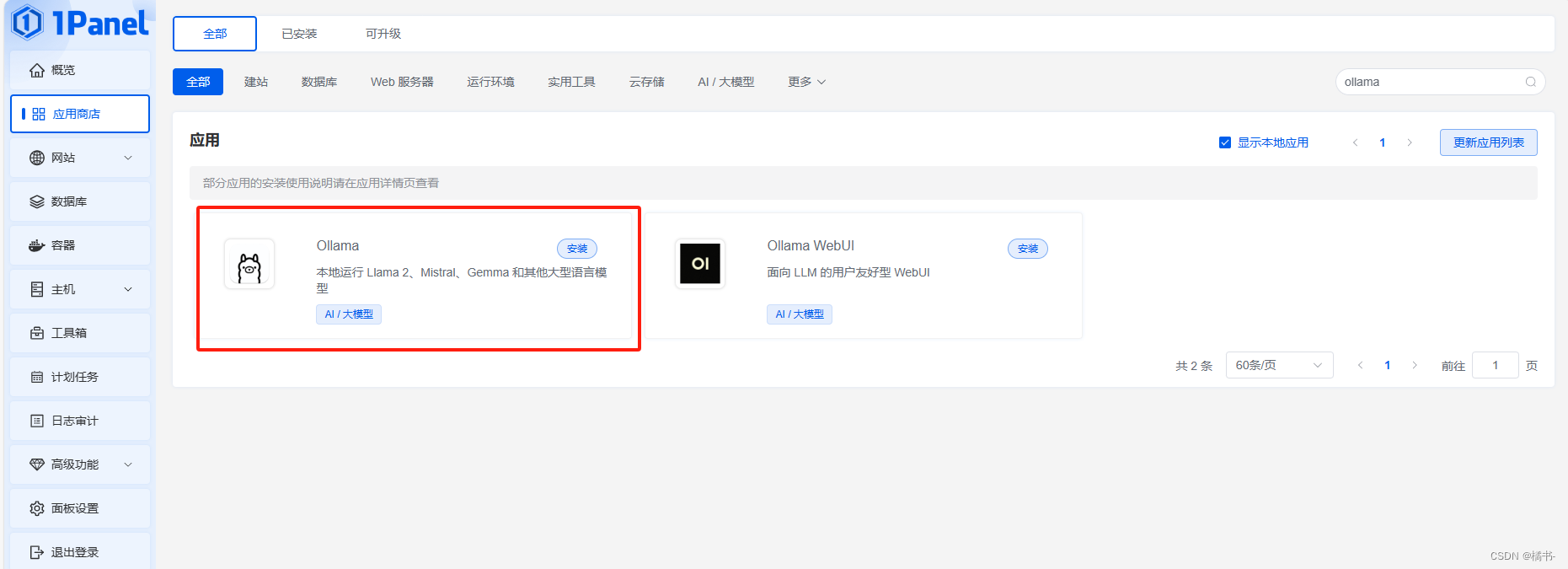

5.在面板的应用商店中可以下载安装maxkb和ollama

如果应用商店里没出现应用,可以通过命令去下载安装,默认有用户名密码

docker启动maxkb容器

docker run -d --name=maxkb -p 8080:8080 -v ~/.maxkb:/var/lib/postgresql/data 1panel/maxkb

# 用户名: admin

# 密码: MaxKB@123..下载安装ollama

curl -fsSL https://ollama.com/install.sh | sh

docker 启动ollama容器

docker run -d -v /opt/ai/ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

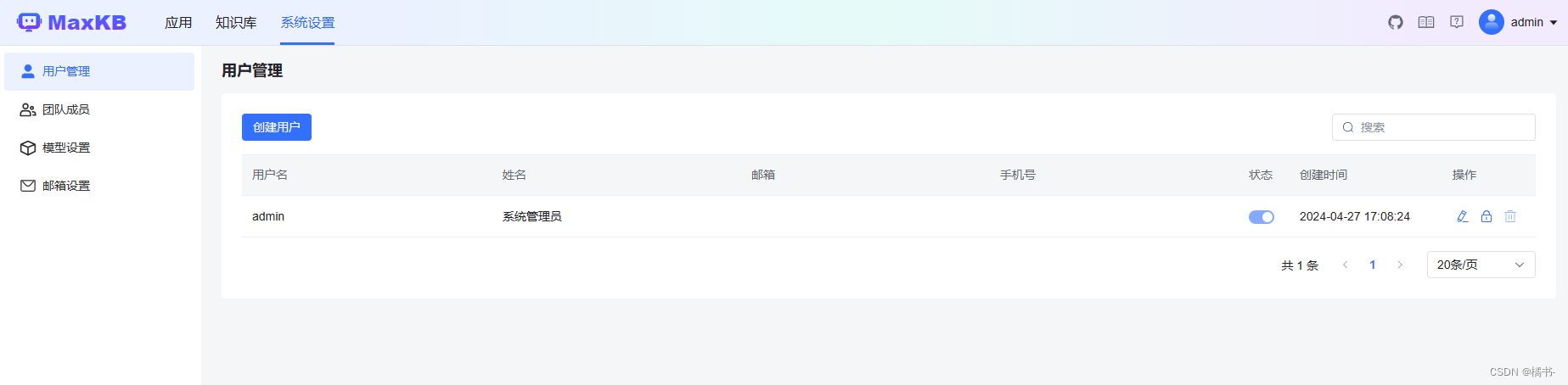

6.都安装完了可以打开maxkb,网址是http://服务器ip+maxkb端口号,登录输入默认的用户名密码

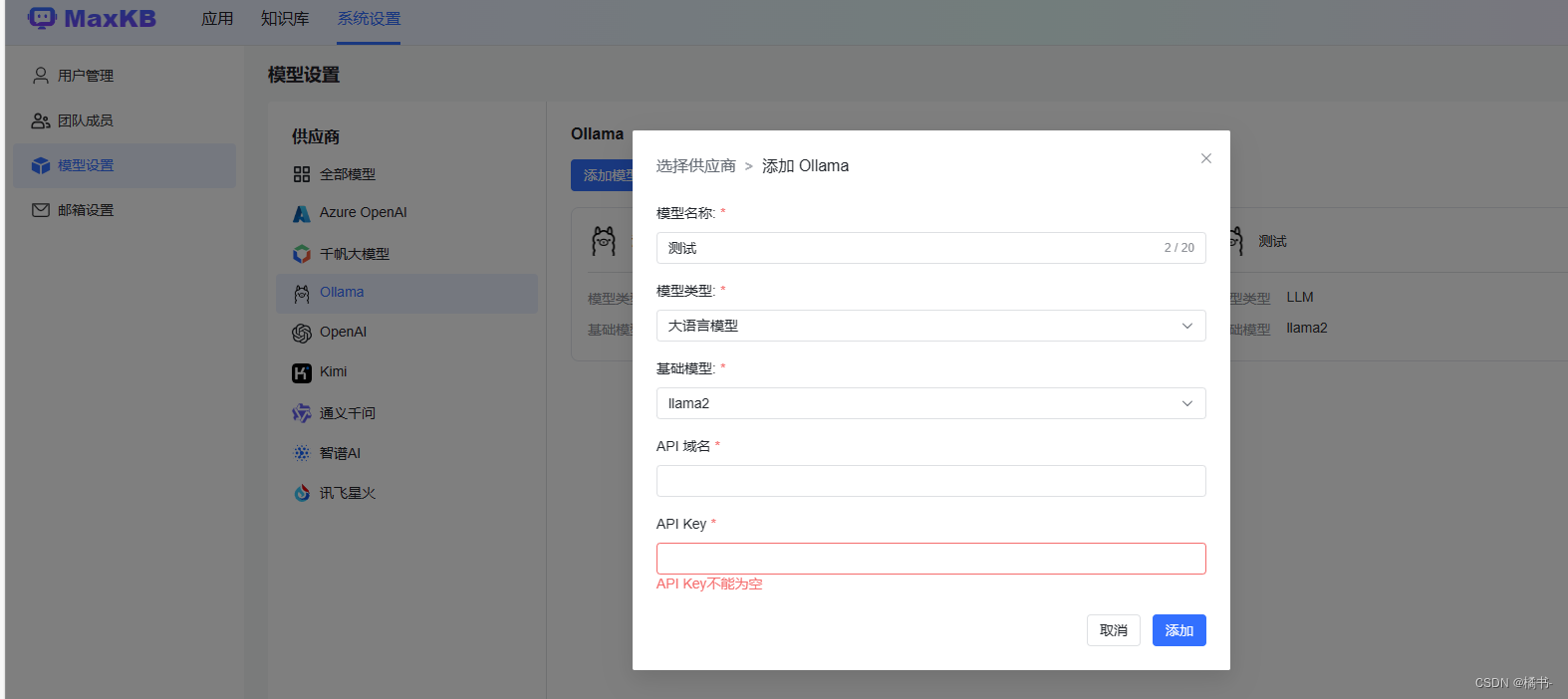

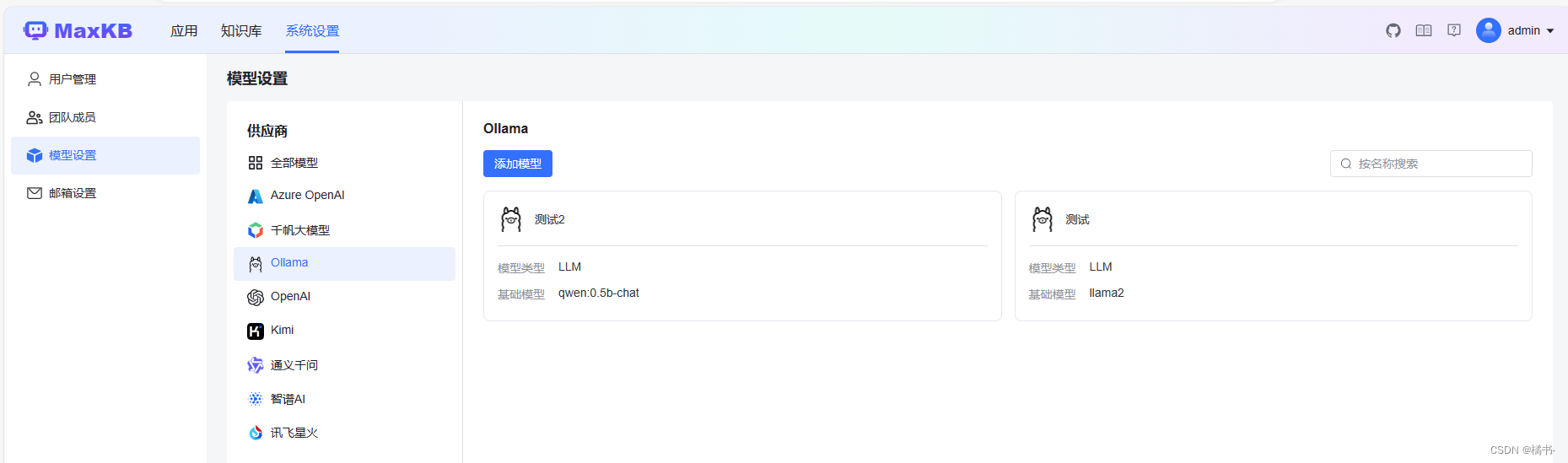

第一步模型设置,选择添加ollama模型,API Key随便输入,API域名是http://服务器ip+ollama端口号自己记住就行,添加完等待下载

第一步模型设置,选择添加ollama模型,API Key随便输入,API域名是http://服务器ip+ollama端口号自己记住就行,添加完等待下载

我先用的测试,基础模型是llama2,但是后续测试发现问题一直不回答,就换成了小模型qwen:0.5b-chat再测试就可以了

第二部创建知识库,根据你自己需要的内容去导入文档,不是所有的格式都能导入,我使用的是txt

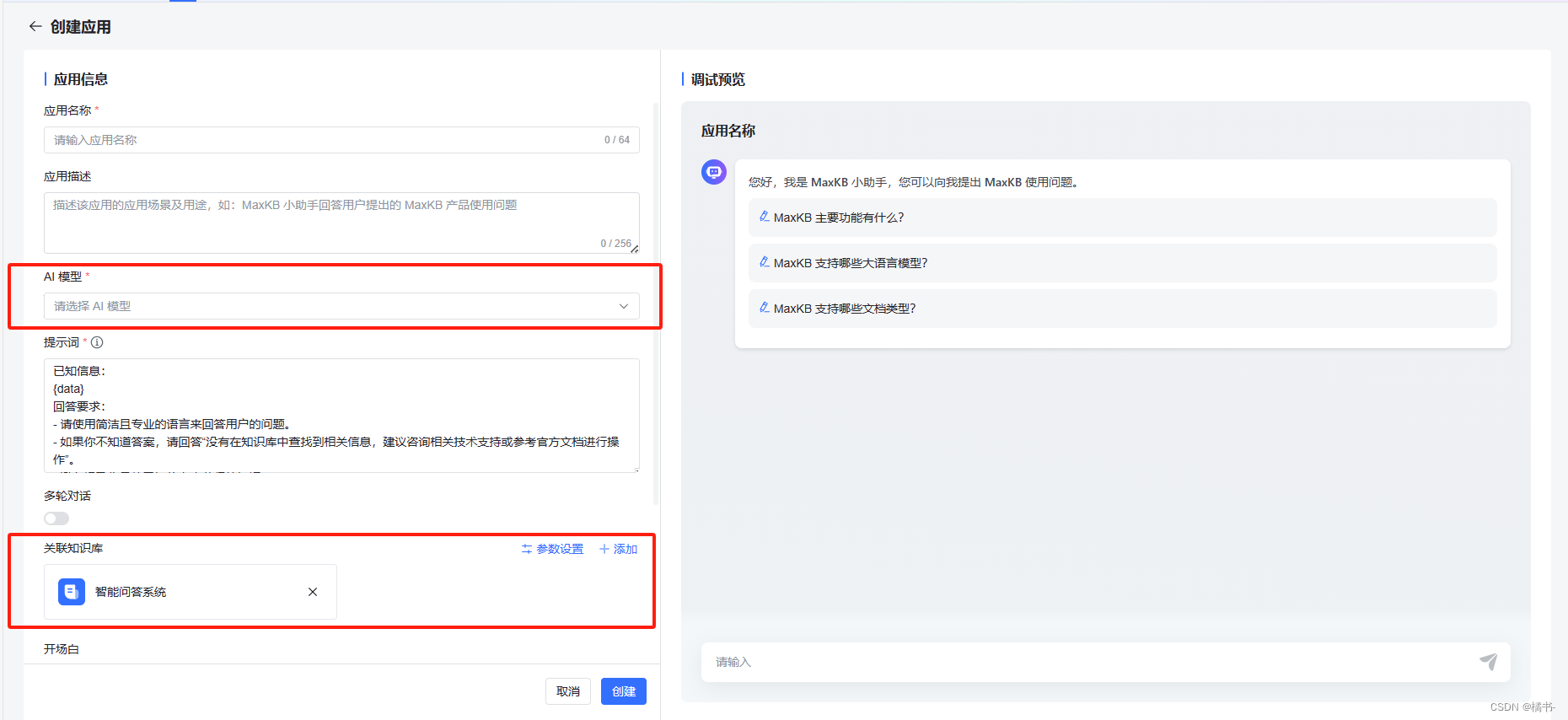

第三步创建应用 AI模型就选择一开始创建的ollama模型,关联创建的知识库

第四步创建完成,演示功能

总结一下,问了几个问题,有点傻瓜了,回答的牛头不对马嘴,应该是模型知识库的比较杂乱的原因

本文详细介绍了如何在CentOS7上搭建服务器,包括使用yum自动安装RPM包、Docker的最新版安装、Panel的安装及应用商店中的MaxKB和Ollama部署。作者还分享了模型设置和知识库创建的过程,以及遇到的问题解决方案。

本文详细介绍了如何在CentOS7上搭建服务器,包括使用yum自动安装RPM包、Docker的最新版安装、Panel的安装及应用商店中的MaxKB和Ollama部署。作者还分享了模型设置和知识库创建的过程,以及遇到的问题解决方案。

2935

2935

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?