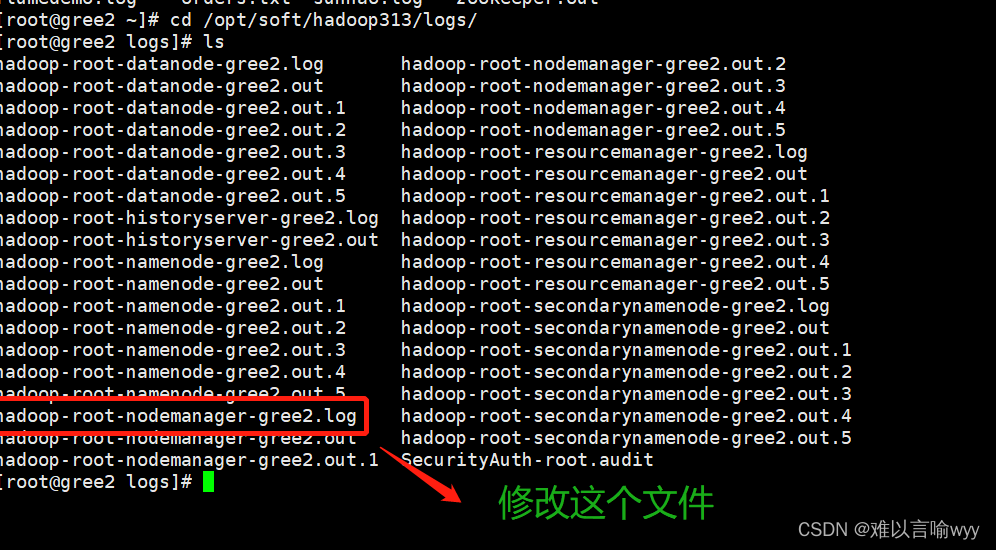

一.查找需要清洗的文件

1.1查看hadoopnamenode-log文件位置

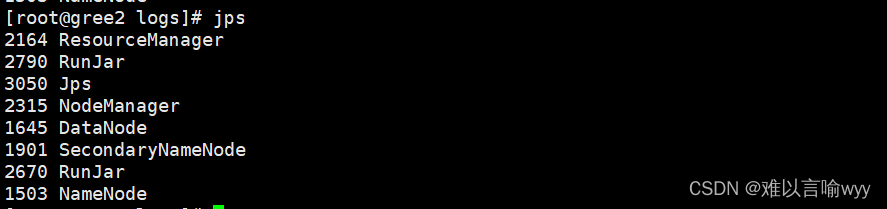

1.2 开启Hadoop集群和Hive元数据、Hive远程连接

具体如何开启可以看我之前的文章:(10条消息) SparkSQL-liunx系统Spark连接Hive_难以言喻wyy的博客-优快云博客

1.3 将这个文件传入到hdfs中:

hdfs dfs -put hadoop-root-namenode-gree2.log /tmp/hadoopNamenodeLogs/hadooplogs/hadoop-root-namenode-gree2.log

二.日志分析

将里面部分字段拿出来分析:

2023-02-10 16:55:33,123 INFO org.apache.hadoop.hdfs.server.namenode.NameNode: registered UNIX signal handlers fo

本文介绍了如何在Linux环境下使用SparkSQL清洗HadoopNameNode的日志,通过过滤和截取含有特定字段(如INFO、WARN、ERROR)的行,然后将清洗后的数据转换为DataFrame并展示。最后,通过jdbcUtils将清洗后的数据导入到MySQL数据库中。

本文介绍了如何在Linux环境下使用SparkSQL清洗HadoopNameNode的日志,通过过滤和截取含有特定字段(如INFO、WARN、ERROR)的行,然后将清洗后的数据转换为DataFrame并展示。最后,通过jdbcUtils将清洗后的数据导入到MySQL数据库中。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

185

185

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?