miccai2021CoTr:有效地连接CNN和Transformer用于三维医学图像分割

https://github.com/YtongXie/CoTr

网络中使用的卷积运算由于其局部性和权值共享的归纳偏差,在建模远程依赖时不可避免地存在局限性。虽然Transformer的诞生是为了解决这个问题

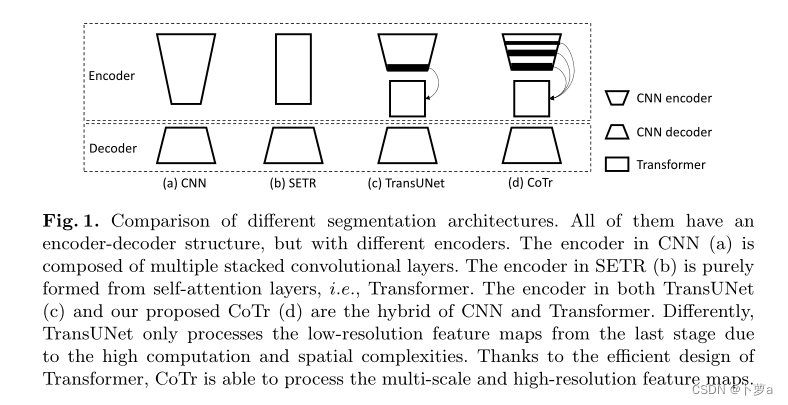

在本文中,我们提出了一个新的框架,有效地连接卷积神经网络和变压器(CoTr),以实现精确的三维医学图像分割。在该框架下,构造CNN来提取特征表示,并构建一个有效的可变形变压器(DeTrans)来建模对提取的特征映射的远程依赖。

与普通的Transformer对所有图像位置一视同仁不同,我们的DeTrans通过引入可变形的自我注意机制,只注意一小部分关键位置。

因此,DeTrans的计算和空间复杂性已经大大降低,使其能够处理多尺度和高分辨率的特征图,这通常是图像分割的最重要的。

我们对覆盖11个主要人体器官的颅穹外多图谱标记(BCV)数据集进行了广泛的评估。结果表明,在三维多器官分割任务中,我们的CoTr方法比其他基于cnn、基于变压器和混合方法的性能有了显著提高。

为了扩大CNN的接受域,从而提高其上下文建模能力,人们做出了许多努力。

Yu等[22]提出了扩展速率可调的atrous卷积,在语义分割[5]上表现出了优越的性能。

Zhao等[26]采用多特征尺度的金字塔池法聚合多尺度的全球信息。

Wang等[20]提出了非局部操作,该操作通常嵌入在编码器的末端,以捕获远程依赖性。

虽然在一定程度上改进了上下文建模,但这些模型仍然不可避免地受到CNN体系结构的限制,接受范围有限。

Transformer中的自注意机制可以根据输入内容动态调整接收域,因此在建模长期依赖关系方

提出了一种新的框架CoTr,将CNN与Transformer有效结合,用于三维医学图像分割。该框架利用CNN提取特征,并通过引入可变形Transformer降低计算复杂度,实现高效远程依赖建模。

提出了一种新的框架CoTr,将CNN与Transformer有效结合,用于三维医学图像分割。该框架利用CNN提取特征,并通过引入可变形Transformer降低计算复杂度,实现高效远程依赖建模。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1984

1984

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?