一、贝叶斯定理

贝叶斯定理是关于随机事件和 B的条件概率的一则定理。其中 P( A| B)是在 B发生的情况下 A发生的可能性。

二、朴素贝叶斯分类算法原理

朴素贝叶斯分类算法是基于贝叶斯定理和特征条件独立假设的分类方法。对于给定的训练数据集,首先基于特征条件独立假设学习输入输出的联合概率分布;然后基于此模型,对给定的输入x,利用贝叶斯定理求出后验概率最大的输出y。

朴素:假设的各个特征之间相互独立

相关概念

先验概率P(X):先验概率是指根据以往经验和分析得到的概率。

后验概率P(Y|X):事情已发生,要求这件事情发生的原因是由某个因素引起的可能性的大小,后验分布P(Y|X)表示事件X已经发生的前提下,事件Y发生的概率,称事件X发生下事件Y的条件概率。朴素贝叶斯公式

设有样本数据集D{d1,d2,d3,..,dn},对应样本数据的特征属性集X={x1,x2,x3,...,xn},类变量为Y={y1,y2,y3,...,yn},即D可以分为yn个类别。其中x1,x2,x3,...,xn相互独立且随机,则Y的先验概率P1=P(Y),Y的后验概率P2=P(Y|X),由朴素贝叶斯算法可得,后验概率可以由先验概率P1=P(Y)、证据P(X)、类条件概率P(X|Y)计算出:

朴素贝叶斯基于各特征之间相互独立,在给定类别为y的情况下,上式可以进一步表示为式:

由以上两式可以计算出后验概率为:

其中d为属性数目,xi为第i个属性上的值。

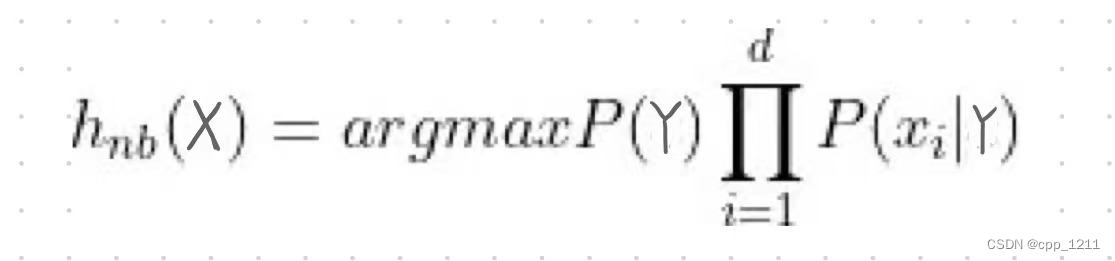

由于对所有的类别P(X)相同,因此最终的朴素贝叶斯表达式就为:

三、拉普拉斯修正

拉普拉斯修正:若某个属性值在训练集中没有与某个类同时出现过,则训练后的模型会出现 over-fitting 现象。比如训练集中没有该样例,因此连乘式计算的概率值为0

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2194

2194

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?