Weighted Nuclear Norm Minimization with Application to Image Denoising

研究背景

核范数平等的正则化每一个奇异值,限制了处理实际问题的能力,在实际情况中,奇异值具有明确的物理意义,应该用不同的方式对待,更大的奇异值通常与主要投影元素有关,因此最好缩小得更少。因此本文研究了加权核范数最小化,给奇异值分配不同的权重,并且利用图像非局部自相似性将WNNM算法用于图像去噪。

加权核范数

为了提高核范数的灵活性,提出了加权核范数并研究了其极小化问题。矩阵X的加权核范数定义为

∥

X

∥

w

,

∗

=

∑

i

∣

w

i

σ

i

(

X

)

∣

1

,

\|X\|_{w,*}=\sum_i|w_i\sigma_i(X)|_1,

∥X∥w,∗=i∑∣wiσi(X)∣1,

式中:

w

=

[

w

1

,

…

,

w

n

]

\boldsymbol{w}=[w_1,\ldots,w_n]

w=[w1,…,wn],

w

i

≥

0

w_{i}\geq0

wi≥0为分配给

σ

i

(

X

)

\sigma_i(X)

σi(X)的非负权重。因此NNM的求解

X

^

=

arg

min

X

∥

Y

−

X

∥

F

2

+

λ

∥

X

∥

∗

,

(

1

)

\hat{X}=\arg\min_X\|Y-X\|_F^2+\lambda\|X\|_*,\quad(1)

X^=argXmin∥Y−X∥F2+λ∥X∥∗,(1)

就可以变成:

min

X

∥

Y

−

X

∥

F

2

+

∥

X

∥

W

,

∗

.

(

2

)

\min_X\|\boldsymbol{Y}-\boldsymbol{X}\|_F^2+\|\boldsymbol{X}\|_{\boldsymbol{W},*}.\quad(2)

Xmin∥Y−X∥F2+∥X∥W,∗.(2)

然而,由于( 2 )式中的目标函数一般不是凸的,因此WNNM问题比NNM更难优化。次梯度条件不再满足,类似的推导无法应用于WNNM。

WNNM的最优化过程

在分析WNNM的优化之前,我们首先给出了以下三个引理

**引理1 **:

∀

A

,

B

∈

ℜ

m

×

n

\forall A,B\in\Re^{m\times n}

∀A,B∈ℜm×n,当满足

A

T

B

=

0

A^{T}B=0

ATB=0时,我们有

(

1

)

∥

A

+

B

∥

w

,

∗

≥

∥

A

∥

w

,

∗

;

(

2

)

∥

A

+

B

∥

F

≥

∥

A

∥

F

.

\begin{aligned}&(1)\|A+B\|_{w,*}\geq\|A\|_{w,*};\\&(2)\|A+B\|_F\geq\|A\|_F.\end{aligned}

(1)∥A+B∥w,∗≥∥A∥w,∗;(2)∥A+B∥F≥∥A∥F.

证明:(1) : ∥ A + B ∥ w , ∗ ≥ ∥ A ∥ w , ∗ :\|A+B\|_{w,*}\geq\|A\|_{w,*} :∥A+B∥w,∗≥∥A∥w,∗

首先,考虑矩阵𝐴和 𝐵的奇异值分解:

A = U A Σ A V A T , B = U B Σ B V B T , A=U_A\Sigma_AV_A^T,\quad B=U_B\Sigma_BV_B^T, A=UAΣAVAT,B=UBΣBVBT,

由于 A T B = 0 A^TB=0 ATB=0,则

V A Σ A T U A T U B Σ B V B T = 0. V_A\Sigma_A^TU_A^TU_B\Sigma_BV_B^T=0. VAΣATUATUBΣBVBT=0.

这意味着 U A T U B U_A^TU_B UATUB是一个零矩阵,因为 Σ A \Sigma_{A} ΣA 和 Σ B \Sigma_{B} ΣB 是对角矩阵且非零元素不同。因此, U A U_{A} UA和 U B U_{B} UB是正交的基,即 U A T U B = 0 U_{A}^{T}U_{B}=0 UATUB=0和 V A T V B = 0 V_A^TV_B=0 VATVB=0。这使得 𝐴 和 𝐵的奇异值向量可以直接相加:

Σ A + B = Σ A 2 + Σ B 2 . \Sigma_{A+B}=\sqrt{\Sigma_A^2+\Sigma_B^2}. ΣA+B=ΣA2+ΣB2.

因此,对于 𝐴+𝐵的加权奇异值范数有:

∥ A + B ∥ w , ∗ = ∑ i ∣ w i σ i ( A + B ) ∣ = ∑ i ∣ w i σ i ( A ) 2 + σ i ( B ) 2 ∣ . \|A+B\|_{w,*}=\sum_i|w_i\sigma_i(A+B)|=\sum_i|w_i\sqrt{\sigma_i(A)^2+\sigma_i(B)^2}|. ∥A+B∥w,∗=i∑∣wiσi(A+B)∣=i∑∣wiσi(A)2+σi(B)2∣.

由于 σ i ( A ) 2 + σ i ( B ) 2 ≥ σ i ( A ) \sqrt{\sigma_i(A)^2+\sigma_i(B)^2}\geq\sigma_i(A) σi(A)2+σi(B)2≥σi(A),且 w i ≥ 0 w_{i}\geq0 wi≥0,所以

∑ i ∣ w i σ i ( A ) 2 + σ i ( B ) 2 ∣ ≥ ∑ i ∣ w i σ i ( A ) ∣ = ∥ A ∥ w , ∗ . \sum_i|w_i\sqrt{\sigma_i(A)^2+\sigma_i(B)^2}|\geq\sum_i|w_i\sigma_i(A)|=\|A\|_{w,*}. i∑∣wiσi(A)2+σi(B)2∣≥i∑∣wiσi(A)∣=∥A∥w,∗.

因此得证 ∥ A + B ∥ w , ∗ ≥ ∥ A ∥ w , ∗ . \|A+B\|_{w,*}\geq\|A\|_{w,*}. ∥A+B∥w,∗≥∥A∥w,∗.(2): ∥ A + B ∥ F ≥ ∥ A ∥ F \|A+B\|_F\geq\|A\|_F ∥A+B∥F≥∥A∥F

Frobenius 范数定义为:

∥ X ∥ F = ∑ i , j X i j 2 . \|X\|_F=\sqrt{\sum_{i,j}X_{ij}^2}. ∥X∥F=i,j∑Xij2.

所以原式证明可以转化为:

∥ A + B ∥ F 2 ≥ ∥ A ∥ F 2 . \|A+B\|_F^2\geq\|A\|_F^2. ∥A+B∥F2≥∥A∥F2.

首先计算 ∥ A + B ∥ F 2 \|A+B\|_F^2 ∥A+B∥F2:

∥ A + B ∥ F 2 = ∑ i , j ( A i j + B i j ) 2 = ∑ i , j ( A i j 2 + 2 A i j B i j + B i j 2 ) . \|A+B\|_F^2=\sum_{i,j}(A_{ij}+B_{ij})^2 =\sum_{i,j}(A_{ij}^2+2A_{ij}B_{ij}+B_{ij}^2). ∥A+B∥F2=i,j∑(Aij+Bij)2=i,j∑(Aij2+2AijBij+Bij2).

因为 A T B = 0 : A^{T}B=0{:} ATB=0:,所以 ∑ i , j A i j B i j = 0 \sum_{i,j}A_{ij}B_{ij}=0 ∑i,jAijBij=0

∥ A + B ∥ F 2 = ∑ i , j ( A i j 2 + 2 A i j B i j + B i j 2 ) = ∑ i , j A i j 2 + ∑ i , j B i j 2 + 2 ⋅ 0 = ∥ A ∥ F 2 + ∥ B ∥ F 2 . \|A+B\|_F^2=\sum_{i,j}(A_{ij}^2+2A_{ij}B_{ij}+B_{ij}^2)=\sum_{i,j}A_{ij}^2+\sum_{i,j}B_{ij}^2+2\cdot0=\|A\|_F^2+\|B\|_F^2. ∥A+B∥F2=i,j∑(Aij2+2AijBij+Bij2)=i,j∑Aij2+i,j∑Bij2+2⋅0=∥A∥F2+∥B∥F2.

又因为 ∥ B ∥ F 2 ≥ 0 \|B\|_{F}^{2}\geq0 ∥B∥F2≥0,所以

∥ A + B ∥ F 2 ≥ ∥ A ∥ F 2 , \|A+B\|_F^2\geq\|A\|_F^2, ∥A+B∥F2≥∥A∥F2,

去平方根后得证.

引理2:

∀

M

=

[

A

B

C

D

]

\forall\boldsymbol{M}=\left[\begin{array}{cc}A&B\\C&D\end{array}\right]

∀M=[ACBD],其中

A

∈

ℜ

m

×

m

A\in\Re^{m\times m}

A∈ℜm×m、$\boldsymbol{D}\in\Re^{n\times n}

,如果权重满足

,如果权重满足

,如果权重满足w_{1}\geq\cdot\cdot\cdot\geq w_{m+n}\geq0$,可得

∥

M

∥

w

,

∗

≥

∥

A

∥

w

1

,

∗

+

∥

D

∥

w

2

,

∗

,

\|M\|_{w,*}\geq\|A\|_{{w_{1},*}}+\|D\|_{{w_{2},*}},

∥M∥w,∗≥∥A∥w1,∗+∥D∥w2,∗,

其中

w

=

[

w

1

,

…

,

w

m

+

n

]

\boldsymbol{w}=[w_1,\ldots,w_{m+n}]

w=[w1,…,wm+n],

w

1

=

[

w

1

,

…

,

w

m

]

\boldsymbol{w}_1=[w_1,\ldots,w_m]

w1=[w1,…,wm]、

w

2

=

[

w

m

+

1

,

…

,

w

m

+

n

]

\boldsymbol{w}_2=[w_{m+1},\ldots,w_{m+n}]

w2=[wm+1,…,wm+n]

证明:

对于分块矩阵M,其奇异值与其子块矩阵 𝐴A 和 𝐷D 的奇异值满足如下关系:

假设 σ i ( X ) \sigma_i(X) σi(X) 表示矩阵 𝑋的第 𝑖大奇异值,那么有

σ i ( M ) ≥ σ i ( A ) f o r i = 1 , 2 , … , m σ i ( M ) ≥ σ i ( D ) f o r i = 1 , 2 , … , n \sigma_i(\boldsymbol{M})\geq\sigma_i(A)\quad\mathrm{for~}i=1,2,\ldots,m\\\sigma_i(\boldsymbol{M})\geq\sigma_i(D)\quad\mathrm{for~}i=1,2,\ldots,n σi(M)≥σi(A)for i=1,2,…,mσi(M)≥σi(D)for i=1,2,…,n

利用上述不等式和权重 w i w_{i} wi的非递增性,我们可以得出:

∥ M ∥ w , ∗ = ∑ i = 1 m + n w i σ i ( M ) ∥ A ∥ w 1 , ∗ = ∑ i = 1 m w i σ i ( A ) ∥ D ∥ w 2 , ∗ = ∑ i = 1 n w m + i σ i ( D ) \begin{aligned}\|\boldsymbol{M}\|_{w,*}&=\sum_{i=1}^{m+n}w_i\sigma_i(\boldsymbol{M})\\\|A\|_{w_1,*}&=\sum_{i=1}^mw_i\sigma_i(A)\\\|D\|_{w_2,*}&=\sum_{i=1}^nw_{m+i}\sigma_i(D)\end{aligned} ∥M∥w,∗∥A∥w1,∗∥D∥w2,∗=i=1∑m+nwiσi(M)=i=1∑mwiσi(A)=i=1∑nwm+iσi(D)

分别对 𝐴和 𝐷的奇异值与其对应权重乘积求和:

∑ i = 1 m w i σ i ( A ) ≤ ∑ i = 1 m w i σ i ( M ) ∑ i = 1 n w m + i σ i ( D ) ≤ ∑ i = 1 n w m + i σ m + i ( M ) \sum_{i=1}^mw_i\sigma_i(A)\leq\sum_{i=1}^mw_i\sigma_i(\boldsymbol{M})\\\sum_{i=1}^nw_{m+i}\sigma_i(D)\leq\sum_{i=1}^nw_{m+i}\sigma_{m+i}(\boldsymbol{M}) i=1∑mwiσi(A)≤i=1∑mwiσi(M)i=1∑nwm+iσi(D)≤i=1∑nwm+iσm+i(M)

所以 ∥ M ∥ w , ∗ ≥ ∥ A ∥ w 1 , ∗ + ∥ D ∥ w 2 , ∗ \|\boldsymbol{M}\|_{w,*}\geq\|A\|_{w_1,*}+\|D\|_{w_2,*} ∥M∥w,∗≥∥A∥w1,∗+∥D∥w2,∗,得证

引理3 .设

∀

A

∈

ℜ

n

×

n

\forall A\in\Re^{n\times n}

∀A∈ℜn×n,和具有非升序的有序对角元的对角非负矩阵

W

∈

ℜ

n

×

n

\boldsymbol{W}\in\Re^{n\times n}

W∈ℜn×n。令

A

=

X

Φ

Y

T

\boldsymbol{A}=\boldsymbol{X}\boldsymbol{\Phi}\boldsymbol{Y}^{T}

A=XΦYT是A的奇异值分解,有

∑

i

σ

i

(

A

)

σ

i

(

W

)

=

max

U

T

U

=

I

,

V

T

V

=

I

t

r

[

W

U

T

A

V

]

,

\sum_i\sigma_i(A)\sigma_i(W)=\max_{\boldsymbol{U}^T\boldsymbol{U}=\boldsymbol{I},\boldsymbol{V}^T\boldsymbol{V}=\boldsymbol{I}}tr[\boldsymbol{W}\boldsymbol{U}^T\boldsymbol{A}\boldsymbol{V}],

i∑σi(A)σi(W)=UTU=I,VTV=Imaxtr[WUTAV],

其中I是单位矩阵,

σ

i

(

A

)

\sigma_i(A)

σi(A)和

σ

i

(

W

)

\sigma_i(W)

σi(W)分别是矩阵A和W的第i个奇异值.当U = X,V = Y时,

t

r

[

W

U

T

A

V

]

tr[\boldsymbol{WU}^T\boldsymbol{AV}]

tr[WUTAV]达到最大值。

证明:

需要证明当 U=X 和 V**=Y 时, tr [ W U T A V ] \operatorname{tr}[\boldsymbol{WU}^T\boldsymbol{AV}] tr[WUTAV]达到最大值。

利用一个重要的矩阵分析结果,即对于任何对角矩阵 D 和任意正交矩阵 P,有

tr [ D P ] ≤ ∑ i d i λ i ( P ) , \operatorname{tr}[\boldsymbol{DP}]\leq\sum_id_i\lambda_i(\boldsymbol{P}), tr[DP]≤i∑diλi(P),

其中 𝑑𝑖是 𝐷的对角元,而 𝜆𝑖(𝑃) 是 𝑃的奇异值。当 𝑃P 是正交矩阵时,其奇异值都是 1,所以对任意正交矩阵𝑈和 𝑉,有

tr [ W U T A V ] ≤ ∑ i = 1 n w i σ i ( A ) . \operatorname{tr}[\boldsymbol{W}\boldsymbol{U}^T\boldsymbol{A}\boldsymbol{V}]\leq\sum_{i=1}^nw_i\sigma_i(A). tr[WUTAV]≤i=1∑nwiσi(A).

当 U**=X、**V=Y 时,这个上界可以达到,因为此时

KaTeX parse error: Can't use function '$' in math mode at position 106: …oldsymbol{AY}]=$̲\mathrm{tr}[\bo…

**定理1:**令

∀

Y

∈

ℜ

m

×

n

,

\forall Y\in\Re^{m\times n},

∀Y∈ℜm×n,,用

Y

=

U

Σ

V

T

Y=U\boldsymbol{\Sigma}V^T

Y=UΣVT表示其SVD。对于(2)式中权重向量w非负的WNNM问题,其解

X

^

\hat{\boldsymbol{X}}

X^可写为

X

^

=

U

B

^

V

T

\hat{X}=U\hat{\boldsymbol{B}}V^T

X^=UB^VT,其中

B

^

\hat{\boldsymbol{B}}

B^为下面优化问题的解

B

^

=

arg

min

B

∥

Σ

−

B

∥

F

2

+

∥

B

∥

w

,

∗

.

(

3

)

\hat{\boldsymbol{B}}=\arg\min_{\boldsymbol{B}}\|\boldsymbol{\Sigma}-\boldsymbol{B}\|_F^2+\|\boldsymbol{B}\|_{\boldsymbol{w},*}.\quad(3)

B^=argBmin∥Σ−B∥F2+∥B∥w,∗.(3)

证明:用 U ⊥ U_{\perp} U⊥表示U的补空间的正交基集合

令 X = U A 1 + U ⊥ A 2 X=UA_{1}+U_\perp A_2 X=UA1+U⊥A2,式中: A 1 A_{1} A1和 A 2 A_{2} A2分别为X在子空间U和 U ⊥ U_{\perp} U⊥中的分量。那么我们就有了

f ( X ) = ∥ Y − X ∥ F 2 + ∥ X ∥ w , ∗ = ∥ U Σ V T − U A 1 − U ⊥ A 2 ∥ F 2 + ∥ U A 1 + U ⊥ A 2 ∥ w , ∗ ≥ ∥ U Σ V T − U A 1 ∥ F 2 + ∥ U A 1 ∥ w , ∗ ( L e m m a 1 ) . \begin{aligned}f(\boldsymbol{X})=&\|\boldsymbol{Y}-\boldsymbol{X}\|_F^2+\|\boldsymbol{X}\|_{\boldsymbol{w},*}\\=&\|\boldsymbol{U}\boldsymbol{\Sigma}V^T-\boldsymbol{U}\boldsymbol{A}_1-\boldsymbol{U}_\perp\boldsymbol{A}_2\|_F^2+\|\boldsymbol{U}\boldsymbol{A}_1+\boldsymbol{U}_\perp\boldsymbol{A}_2\|_{\boldsymbol{w},*}\\\geq&\|\boldsymbol{U}\boldsymbol{\Sigma}V^T-\boldsymbol{U}\boldsymbol{A}_1\|_F^2+\|\boldsymbol{U}\boldsymbol{A}_1\|_{\boldsymbol{w},*}\quad(Lemma\quad\boxed{1}).\end{aligned} f(X)==≥∥Y−X∥F2+∥X∥w,∗∥UΣVT−UA1−U⊥A2∥F2+∥UA1+U⊥A2∥w,∗∥UΣVT−UA1∥F2+∥UA1∥w,∗(Lemma1).

类似地,对于行空间基V,有

f ( X ) ≥ ∥ U Σ V T − U B V T ∥ F 2 + λ ∥ U B V T ∥ w , ∗ . f(\boldsymbol{X})\geq\|\boldsymbol{U}\boldsymbol{\Sigma}\boldsymbol{V}^T-\boldsymbol{U}\boldsymbol{B}\boldsymbol{V}^T\|_F^2+\lambda\|\boldsymbol{U}\boldsymbol{B}\boldsymbol{V}^T\|_{\boldsymbol{w},*}. f(X)≥∥UΣVT−UBVT∥F2+λ∥UBVT∥w,∗.

正交矩阵U和V不会改变F -范数和加权核范数,因此有

f ( X ) ≥ ∥ Σ − B ∥ F 2 + λ ∥ B ∥ w , ∗ . f(X)\geq\|\Sigma-B\|_F^2+\lambda\|B\|_{w,*}. f(X)≥∥Σ−B∥F2+λ∥B∥w,∗.

因此,如果我们有(3)中极小化问题的解,那么( 2 )中原始WNNM问题的解可以表示为 X ^ = U B ^ V T \hat{X}=U\hat{\boldsymbol{B}}V^T X^=UB^VT.

基于上述引理和定理,我们分3种情况讨论WNNM问题的解:权重 w 1 ≥ ⋅ ⋅ ⋅ ≥ w n ≥ 0 w_1\geq\cdot\cdot\cdot\geq w_n\geq0 w1≥⋅⋅⋅≥wn≥0分别为非升序、任意序和非降序。

非升序

根据定理1,当 w 1 ≥ ⋅ ⋅ ⋅ ≥ w n ≥ 0 w_1\geq\cdot\cdot\cdot\geq w_n\geq0 w1≥⋅⋅⋅≥wn≥0时,有(2)式中WNNM问题的全局最优解。我们有如下定理。

定理2:若权重满足

w

1

≥

⋅

⋅

⋅

≥

w

n

≥

0

w_1\geq\cdot\cdot\cdot\geq w_n\geq0

w1≥⋅⋅⋅≥wn≥0,则式( 2 )中的WNNM问题存在全局最优解:

X

^

=

U

S

w

(

Σ

)

V

T

,

\hat{X}=U\mathcal{S}_w(\Sigma)V^T,

X^=USw(Σ)VT,

式中:

Y

=

U

Σ

V

T

Y=U\Sigma V^T

Y=UΣVT为Y的SVD,

S

w

(

Σ

)

\mathcal{S}_w(\boldsymbol{\Sigma})

Sw(Σ)为带权向量w的广义软阈值算子

S

w

(

Σ

)

i

i

=

max

(

Σ

i

i

−

w

i

,

0

)

.

\mathcal{S}_{\mathbf{w}}(\boldsymbol{\Sigma})_{ii}=\max(\boldsymbol{\Sigma}_{ii}-w_i,0).

Sw(Σ)ii=max(Σii−wi,0).

证明:考虑(3)中的优化问题,假设

Λ

B

\boldsymbol{\Lambda_{B}}

ΛB是对角矩阵,且

Λ

B

\boldsymbol{\Lambda_{B}}

ΛB的对角元素与矩阵B的对角元素相同,我们有

∥

Σ

−

B

∥

F

2

+

λ

∥

B

∥

w

,

∗

=

∥

Σ

−

Λ

B

−

(

B

−

Λ

B

)

∥

F

2

+

∥

Λ

B

+

(

B

−

Λ

B

)

∥

w

,

∗

≥

∣

Σ

−

Λ

B

∥

F

2

+

∥

Λ

B

∥

w

,

∗

(

L

e

m

m

a

2

)

.

\begin{aligned}&\|\boldsymbol{\Sigma}-\boldsymbol{B}\|_F^2+\lambda\|\boldsymbol{B}\|_{\boldsymbol{w},*}\\=&\|\boldsymbol{\Sigma}-\boldsymbol{\Lambda}_{\boldsymbol{B}}-(\boldsymbol{B}-\boldsymbol{\Lambda}_{\boldsymbol{B}})\|_{F}^{2}+\|\boldsymbol{\Lambda}_{\boldsymbol{B}}+(\boldsymbol{B}-\boldsymbol{\Lambda}_{\boldsymbol{B}})\|_{\boldsymbol{w},*}\\\geq&|\boldsymbol{\Sigma}-\boldsymbol{\Lambda}_{\boldsymbol{B}}\|_F^2+\|\boldsymbol{\Lambda}_{\boldsymbol{B}}\|_{\boldsymbol{w},*}&(Lemma\quad\boxed{2}).\end{aligned}

=≥∥Σ−B∥F2+λ∥B∥w,∗∥Σ−ΛB−(B−ΛB)∥F2+∥ΛB+(B−ΛB)∥w,∗∣Σ−ΛB∥F2+∥ΛB∥w,∗(Lemma2).

因此,在这样的权重条件下,( 3 )式的最优解具有对角形式

Λ

B

\boldsymbol{\Lambda_{B}}

ΛB。Σ和

Λ

B

\boldsymbol{\Lambda_{B}}

ΛB都是对角矩阵,可以通过对每个元素进行软阈值操作得到解。根据定理1的结论,( 2 )式的最优解为

X

^

=

U

S

w

(

Σ

)

V

T

\hat{\boldsymbol{X}}=\boldsymbol{U}\mathcal{S}_{\boldsymbol{w}}(\boldsymbol{\Sigma})\boldsymbol{V}^T

X^=USw(Σ)VT。

任意顺序

在权重 w i = 1 ⋯ n w_{i=1\cdots n} wi=1⋯n不是非升序而是任意序的情况下,( 5 )中的WNNM问题是非凸的,因此不能有全局最小值。我们提出了一个迭代算法来求解它

在定理1中,我们已经证明了( 2 )的解可以通过求解( 3 )得到。令

B

=

P

Λ

Q

T

B=P\Lambda Q^T

B=PΛQT为B的奇异值分解。我们迭代求解下面的优化问题

(

P

^

,

Λ

^

,

Q

^

)

=

arg

min

P

,

Λ

,

Q

∥

P

Λ

Q

T

−

Σ

∥

F

2

+

∥

P

Λ

Q

T

∥

W

,

∗

,

s

.

t

.

P

T

P

=

I

,

Q

T

Q

=

I

(

4

)

\begin{aligned}(\hat{\boldsymbol{P}},\hat{\boldsymbol{\Lambda}},\hat{\boldsymbol{Q}})&=\arg\min_{\boldsymbol{P},\boldsymbol{\Lambda},\boldsymbol{Q}}\|\boldsymbol{P}\boldsymbol{\Lambda}\boldsymbol{Q}^T-\boldsymbol{\Sigma}\|_F^2+\|\boldsymbol{P}\boldsymbol{\Lambda}\boldsymbol{Q}^T\|_{\boldsymbol{W},*},\\&s.t.\boldsymbol{P}^T\boldsymbol{P}=\boldsymbol{I},\boldsymbol{Q}^T\boldsymbol{Q}=\boldsymbol{I}\end{aligned}\quad(4)

(P^,Λ^,Q^)=argP,Λ,Qmin∥PΛQT−Σ∥F2+∥PΛQT∥W,∗,s.t.PTP=I,QTQ=I(4)

迭代过程:

-

给定非负对角矩阵Λ,我们求解

( P ^ , Q ^ ) = arg min P , Q ∥ P Λ Q T − Σ ∥ F 2 (\hat{\boldsymbol{P}},\hat{\boldsymbol{Q}})=\arg\min_{\boldsymbol{P},\boldsymbol{Q}}\|\boldsymbol{P\Lambda Q}^T-\boldsymbol{\Sigma}\|_F^2 (P^,Q^)=argP,Qmin∥PΛQT−Σ∥F2

基于Frobenius范数的定义,有

min P , Q ∥ P Λ Q T − Σ ∥ F 2 = min P , Q t r [ ( P Λ Q T − Σ ) ( P Λ Q T − Σ ) T ] = t r [ Λ Λ + Σ Σ ] − 2 max P , Q t r [ P Λ Q T Σ T ] = t r [ Λ Λ + Σ Σ ] − 2 ∑ i σ i ( Σ ) σ i ( Λ ) ( L e m m a 3 ) \begin{aligned} &\min_{\boldsymbol{P},\boldsymbol{Q}}\|\boldsymbol{P\Lambda Q}^T-\boldsymbol{\Sigma}\|_F^2 \\ &= \min_{\boldsymbol{P},\boldsymbol{Q}}tr[(\boldsymbol{P\Lambda Q}^T-\boldsymbol{\Sigma})(\boldsymbol{P\Lambda Q}^T-\boldsymbol{\Sigma})^T] \\ &= tr[\boldsymbol{\Lambda}\boldsymbol{\Lambda}+\boldsymbol{\Sigma}\boldsymbol{\Sigma}]-2\operatorname*{max}_{\boldsymbol{P},\boldsymbol{Q}}tr[\boldsymbol{P}\boldsymbol{\Lambda}\boldsymbol{Q}^T\boldsymbol{\Sigma}^T] \\ &= tr[\boldsymbol{\Lambda}\boldsymbol{\Lambda}+\boldsymbol{\Sigma}\boldsymbol{\Sigma}]-2\sum_{i}\sigma_{i}(\boldsymbol{\Sigma})\sigma_{i}(\boldsymbol{\Lambda})\quad(Lemma\quad\boxed{3}) \end{aligned} P,Qmin∥PΛQT−Σ∥F2=P,Qmintr[(PΛQT−Σ)(PΛQT−Σ)T]=tr[ΛΛ+ΣΣ]−2P,Qmaxtr[PΛQTΣT]=tr[ΛΛ+ΣΣ]−2i∑σi(Σ)σi(Λ)(Lemma3)

P和Q的最优解分别为矩阵Λ的SVD的列基和行基。由于Λ已经是对角矩阵,P和Q是置换矩阵,使得对角矩阵 P Λ Q T \boldsymbol{P}\boldsymbol{\Lambda}{\boldsymbol{Q}^T} PΛQT具有非升序的对角元素。 -

给定正交矩阵P和Q,求解

Λ ^ = arg min Λ ∥ P Λ Q T − Σ ∥ F 2 + ∥ P Λ Q T ∥ w , ∗ . \hat{\boldsymbol{\Lambda}}=\arg\min_{\boldsymbol{\Lambda}}\|\boldsymbol{P}\boldsymbol{\Lambda}\boldsymbol{Q}^T-\boldsymbol{\Sigma}\|_F^2+\|\boldsymbol{P}\boldsymbol{\Lambda}\boldsymbol{Q}^T\|_{\boldsymbol{w},*}. Λ^=argΛmin∥PΛQT−Σ∥F2+∥PΛQT∥w,∗.

由于 P Λ Q T \boldsymbol{P\Lambda}\boldsymbol{Q}^{T} PΛQT是具有非升序元素的对角矩阵,我们有

Λ ^ = arg min Λ ∑ i ∥ ( P Λ Q T ) i i − Σ i i ∥ 2 2 + ∣ w i ⋅ ( P Λ Q T ) i i ∣ 1 . \hat{\boldsymbol{\Lambda}}=\arg\min_{\boldsymbol{\Lambda}}\sum_i\|(\boldsymbol{P}\boldsymbol{\Lambda}\boldsymbol{Q}^T)_{ii}-\boldsymbol{\Sigma}_{ii}\|_2^2+|w_i\cdot(\boldsymbol{P}\boldsymbol{\Lambda}\boldsymbol{Q}^T)_{ii}|_1. Λ^=argΛmini∑∥(PΛQT)ii−Σii∥22+∣wi⋅(PΛQT)ii∣1.

可以对对角矩阵 P Λ Q T \boldsymbol{P}\boldsymbol{\Lambda}{\boldsymbol{Q}^T} PΛQT的每个元素进行软阈值操作。因为P和Q是只改变对角元素位置的置换矩阵,所以有

Λ ^ = P T S w ( Σ ) Q . \hat{\boldsymbol{\Lambda}}=\boldsymbol{P}^T\mathcal{S}_{\boldsymbol{w}}(\boldsymbol{\Sigma})\boldsymbol{Q}. Λ^=PTSw(Σ)Q.

通过迭代上述两个步骤,(6)可以通过对对角元素排序和奇异值收缩来迭代求解:

{ ( P ( k + 1 ) T , Φ , Q ( k + 1 ) T ) = S V D ( Λ ( k ) ) ; Λ ( k + 1 ) = P ( k + 1 ) T S w ( Σ ) Q ( k + 1 ) . ( 5 ) \begin{cases}(\boldsymbol{P}_{(k+1)}^T,\boldsymbol{\Phi},\boldsymbol{Q}_{(k+1)}^T)=SVD(\boldsymbol{\Lambda}_{(k)});\\\boldsymbol{\Lambda}_{(k+1)}=\boldsymbol{P}_{(k+1)}^T\boldsymbol{S}_{\boldsymbol{w}}(\boldsymbol{\Sigma})\boldsymbol{Q}_{(k+1)}.\end{cases}\quad(5) {(P(k+1)T,Φ,Q(k+1)T)=SVD(Λ(k));Λ(k+1)=P(k+1)TSw(Σ)Q(k+1).(5)

基于定理1的结论,可以得到 X ^ \hat{\boldsymbol{X}} X^的最终估计为

X ^ = U P ^ T S w ( Σ ) Q ^ V T . \hat{X}=\boldsymbol{U}\hat{\boldsymbol{P}}^T\mathcal{S}_\mathbf{w}(\boldsymbol{\Sigma})\hat{\boldsymbol{Q}}V^T. X^=UP^TSw(Σ)Q^VT.

非降序

最后,我们考虑另一种特殊但非常有用的情况,即权重 w i , . . . , n w_{i,...,n} wi,...,n是非降序排列的。基于任意顺序之中提出的迭代算法,我们有如下推论。

推论1 如果权重满足 0 ≤ w 1 ≤ … ≤ w n , 0\leq w_{1}\leq\ldots\leq w_{n}, 0≤w1≤…≤wn,,则任意顺序之中的迭代算法将有一个不动点 X ^ = U S w ( Σ ) V T . \hat{X}=U\mathcal{S}_{\boldsymbol{w}}(\boldsymbol{\Sigma})V^{T}. X^=USw(Σ)VT.

证明:在(5)式中,通过将 Λ ( 0 ) \Lambda_{(0)} Λ(0)初始化为具有非升序对角元的对角矩阵,我们有

{ ( P ( 1 ) = I , Φ = Λ ( 0 ) , Q ( 1 ) = I ) = S V D ( Λ ( 0 ) ) ; Λ ( 1 ) = I S w ( Σ ) I = S w ( Σ ) . \begin{cases}(\boldsymbol{P}_{(1)}=\boldsymbol{I},\boldsymbol{\Phi}=\boldsymbol{\Lambda}_{(0)},\boldsymbol{Q}_{(1)}=\boldsymbol{I})=SVD(\boldsymbol{\Lambda}_{(0)});\\\boldsymbol{\Lambda}_{(1)}=\boldsymbol{I}\boldsymbol{S}_{\boldsymbol{w}}(\boldsymbol{\Sigma})\boldsymbol{I}=\boldsymbol{S}_{\boldsymbol{w}}(\boldsymbol{\Sigma}).\end{cases} {(P(1)=I,Φ=Λ(0),Q(1)=I)=SVD(Λ(0));Λ(1)=ISw(Σ)I=Sw(Σ).

因此,令 ∀ 0 < i < j ≤ n , \forall0<i<j\leq n, ∀0<i<j≤n,,有 Σ i i ≥ Σ j j \Sigma_{ii}\geq\Sigma_{jj} Σii≥Σjj、 w i ≤ w j w_{i}\leq w_{j} wi≤wj。经过软阈值操作后, Λ ( 1 ) = S w ( Σ ) \Lambda_{(1)}=S_{\mathbf{w}}(\boldsymbol{\Sigma}) Λ(1)=Sw(Σ)仍然满足非升阶。因此在下一次迭代中,P和Q仍为单位矩阵,式( 4 )的优化达到一个固定点。基于定理1的结论,我们通过 X ^ = U S w ( Σ ) V T \hat{\boldsymbol{X}}=\boldsymbol{U}\mathcal{S}_{\boldsymbol{w}}(\boldsymbol{\Sigma})V^{T} X^=USw(Σ)VT得到X的不动点估计.

推论1中的结论是非常重要和有用的.矩阵的奇异值总是按照非升序排列,较大的奇异值通常对应于数据矩阵中较重要成分的子空间。因此,我们最好对较大的奇异值进行较小的收缩,即在加权核范数中对较大的奇异值赋予较小的权重。在这种情况下,推论1保证了我们提出的迭代算法有一个不动点。此外,该不动点具有解析形式(即( , X ^ = U S w ( Σ ) V T ,\hat{X}=U\mathcal{S}_{\mathbf{w}}(\boldsymbol{\Sigma})V^{T} ,X^=USw(Σ)VT )。因此,在实际中我们不需要真正地迭代,而是直接在一个步骤中得到想要的解,这使得我们提出的方法非常有效。

WNNM用于图像去噪

图像去噪的目的是从含噪图像

y

=

x

+

n

y = x + n

y=x+n中恢复出原始图像x。其中n是均值为零,方差为

σ

n

2

\sigma_n^2

σn2的加性高斯白噪声。对于图像y中的一个局部块

y

j

y_j

yj,我们可以通过块匹配等方法在图像(在实际中,在足够大的局部窗口内)中搜索它的非局部相似块。通过将这些非局部相似块堆叠成一个矩阵,记为Yj,得到:

Y

j

=

X

j

+

N

j

\boldsymbol{Y}_j=\boldsymbol{X}_j+\boldsymbol{N}_j

Yj=Xj+Nj

其中

X

j

X_j

Xj和

N

j

N_j

Nj分别是原始图像和噪声的块矩阵。

将提出的WNNM模型应用于

Y

j

Y_j

Yj来估计

X

j

X_j

Xj,用于图像去噪。通过使用噪声方差

σ

n

2

\sigma_n^2

σn2来归一化F范数数据保真项

∥

Y

j

−

X

j

∥

F

2

\|\boldsymbol{Y}_j-\boldsymbol{X}_j\|_F^2

∥Yj−Xj∥F2,我们有如下能量函数:

X

^

j

=

arg

min

X

j

1

σ

n

2

∥

Y

j

−

X

j

∥

F

2

+

∥

X

j

∥

W

,

∗

.

(

6

)

\hat{\boldsymbol{X}}_j=\arg\min_{\boldsymbol{X}_j}\frac{1}{\sigma_n^2}\|\boldsymbol{Y}_j-\boldsymbol{X}_j\|_F^2+\|\boldsymbol{X}_j\|_{\boldsymbol{W},*}.\quad(6)

X^j=argXjminσn21∥Yj−Xj∥F2+∥Xj∥W,∗.(6)

显然,现在的关键问题是权重向量w的确定。对于自然图像,我们有一个普遍的先验知识,即

X

j

X_j

Xj的较大奇异值比较小的奇异值更重要,因为它们代表了

X

j

X_j

Xj的主要成分的能量。在去噪应用中,奇异值越大,应收缩的越少。因此,一个自然的想法是,分配给

X

j

X_j

Xj的第i个奇异值

σ

i

(

X

j

)

\sigma_i(\boldsymbol{X}_j)

σi(Xj)的权重应该与

σ

i

(

X

j

)

\sigma_i(\boldsymbol{X}_j)

σi(Xj)成反比。令

w

i

=

c

n

/

(

σ

i

(

X

j

)

+

ε

)

,

(

7

)

w_i=c\sqrt{n}\Big/(\sigma_i(\boldsymbol{X}_j)+\varepsilon),\quad(7)

wi=cn/(σi(Xj)+ε),(7)

其中c > 0是常数,n是

Y

j

Y_j

Yj中相似块的个数,

ε

=

1

0

−

16

\varepsilon=10^{-16}

ε=10−16是为了避免除以零.

根据此权重可以用非降序的WNNM算法用于模型(7),然而,仍然存在一个问题,即奇异值 σ i ( X j ) \sigma_i(\boldsymbol{X}_j) σi(Xj)不可用。我们假设噪声能量均匀分布在由U和V的基对张成的每个子空间上。

则初始σ i ( Xj )可以估计为:

σ

^

i

(

X

j

)

=

max

(

σ

i

2

(

Y

j

)

−

n

σ

n

2

,

0

)

,

\hat{\sigma}_i(\boldsymbol{X}_j)=\sqrt{\max(\sigma_i^2(\boldsymbol{Y}_j)-n\sigma_n^2,0)},

σ^i(Xj)=max(σi2(Yj)−nσn2,0),

其中

σ

i

(

Y

j

)

\sigma_i(\boldsymbol{Y}_j)

σi(Yj)是

Y

j

Y_j

Yj的第i个奇异值.注意,由于

σ

i

(

Y

j

)

\sigma_i(\boldsymbol{Y}_j)

σi(Yj)总是按非升序排序,所以得到的权重

w

i

=

1

,

.

.

.

,

n

w_{i=1,...,n}

wi=1,...,n是保证非降序的

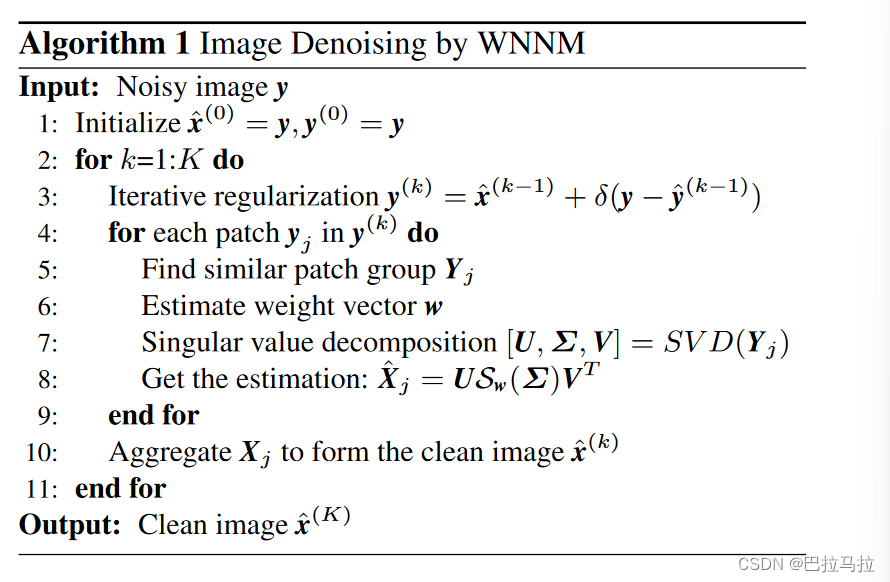

算法如下:

ps:

补空间的正交集合指的是给定向量空间 𝑉中的子空间 𝑈** 的正交补空间。具体来说,如果 𝑈⊆𝑉是 𝑉的子空间,则 U ⊥ U_{\perp} U⊥是满足以下条件的向量集合:

- U ⊥ U_{\perp} U⊥包含所有与 𝑈中每个向量正交的 𝑉中的向量。

- 如果 v ∈ U ⊥ v\in U_{\perp} v∈U⊥,那么对于 u ∈ U u\in U u∈U,有 ⟨ v , u ⟩ = 0 \langle v,u\rangle=0 ⟨v,u⟩=0,即 𝑣 和 𝑈中所有向量正交。

更具体地说, U ⊥ U_{\perp} U⊥是满足 U ⊥ = { v ∈ V ∣ ⟨ v , u ⟩ = 0 , ∀ u ∈ U } U^\perp=\{v\in V\mid\langle v,u\rangle=0,\forall u\in U\} U⊥={v∈V∣⟨v,u⟩=0,∀u∈U}的向量集合。

性质和特点

- U ⊥ U_{\perp} U⊥是是 𝑉的一个子空间。

- U ∩ U ⊥ = { 0 } U\cap U^\perp=\{0\} U∩U⊥={0},即 𝑈和 U ⊥ U_{\perp} U⊥中的向量只有零向量共同。

- 对于 𝑉中的任意向量𝑣,可以唯一地表示为 v = u + w , v=u+w, v=u+w,其中 $u\in U\text{ 且 }w\in U_\perp $。

2785

2785

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?